隨著人工智能技術的快速發展,語音成為一種新型的人機交流方式,如我們手機上的語音助手Apple Siri、Google Assistant和Microsoft Cortana等,智能音箱Google Home、Amazon Echo、阿里巴巴的天貓精靈和小米的小愛同學等等。它們方便了人類與機器交互的同時,不僅連接了Twitter、Facebook這樣的社交網絡,也將汽車、智能門鎖和智能電視等物聯網設備連接起來。

由此可見,語音交互越來越多地關系著人們的生命和財產安全,因此,智能語音的安全性也成為工業界和學術界的研究重點。

圖1 智能語音的應用

傳統攻擊通過安裝惡意應用和傳播病毒等途徑入侵到系統中,但是如何實現智能化的攻擊方式還未知。既然聲音成為人機交互的新型方式,那么利用聲音欺騙人工智能系統成為一種攻擊方法,同時能夠突破傳統方式需要接觸設備的局限性。為了在人耳無法覺察的情況下讓智能語音設備識別出里面的指令,加州伯克利分校和浙江大學的研究學者分別將語音信息嵌入到了噪聲和超聲波之中,從而控制智能語音助手和音箱[1][2]。

結合日常生活中大家喜歡聽音樂的習慣,中國科學院信息工程研究所陳愷研究員和波士頓大學Shengzhi Zhang教授等人實現了利用音樂為載體攻擊語音識別系統的研究[3],這種特殊修改過的音樂被稱為是“惡魔音樂”。試想,如果我們在開車或者家中聽的廣播是攻擊者精心制作的“惡魔音樂”,人耳聽起來并不能覺察出什么異常,但是智能語音系統卻能識別出其中“開門”的控制命令,那么將對我們的安全構成難以控制的威脅。

圖2 “惡魔音樂”在人們享受音樂的時候與智能語音系統對話

對抗攻擊:類似于生活中人類感觀誤識別的問題,智能系統也有一定的誤判。因此,研究者想到通過對一個正常樣本做微小的修改,然后在人們感觀覺察不出來有什么差異的情況下對智能系統造成對抗攻擊,這種欺騙人工智能系統的特殊樣本被稱為是“對抗樣本”。從2013年開始大家特別關注對抗攻擊,利用梯度下降算法自動化地在原始樣本上加微小擾動形成對抗樣本,在人類無法覺察的同時讓機器識別錯誤,從而造成逃逸攻擊。

圖3 對抗樣本攻擊

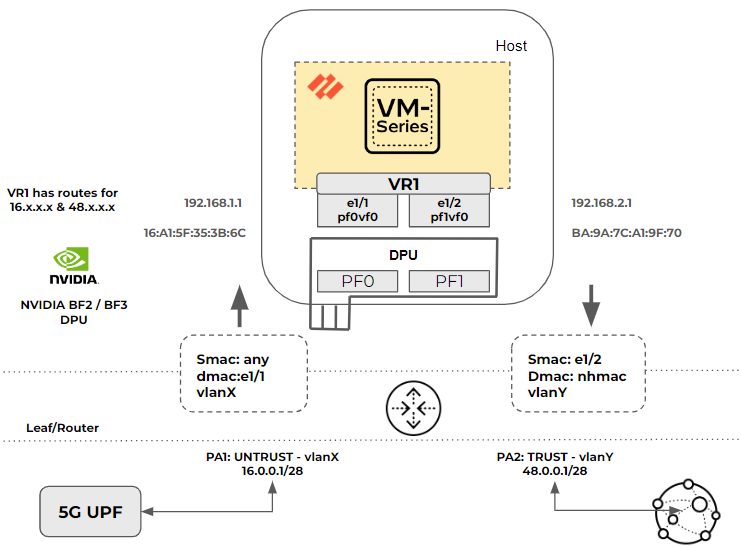

針對智能語音的對抗攻擊:如果把語音識別系統看成一個API接口,音頻以wav格式為代表,那么音頻wav有兩種途徑傳輸給語音識別系統API(1)直接輸入(2)播放音樂并通過實際應用環境中的物理設備采集之后再輸入給API。因此,對抗樣本攻擊分別可以視為“Wav-to-API(WTA)攻擊”和“Wav-air-API(WAA)攻擊”。

圖4 “惡魔音樂”直接上傳給語音識別API的WTA攻擊

圖5 “惡魔音樂”在實際環境中播放再由智能設備采集識別的

WAA攻擊

智能語音對抗攻擊存在下面四個挑戰:

自動化:需要找到合適的目標函數,利用梯度下降方法在原始樣本上添加擾動逼近目標函數,使最終生成的對抗樣本可以被識別為特殊的文本結果。

物理攻擊:實際應用中播放、錄音設備以及周圍環境噪聲會對樣本的特征造成干擾,難以實現物理攻擊。

隱蔽性:在保證成功率的前提下盡可能小地修改原始樣本,逃過人耳的覺察。

遷移性:在一個平臺上攻擊成功的對抗樣本同樣可能攻擊其他平臺,但是由于平臺之間的差異性,樣本的遷移性通常比較低。

語音識別原理

傳統語音識別包括特征提取、聲學模型和語言模型三個模塊。其中特征提取是對時域信號分幀并計算每幀的頻域特征,通過一系列的變換最終得到模擬人耳的聽覺特征。聲學模型描述的是特征的統計特性和實際發聲的音素對應關系,音素是組成單詞的最小單元,這一模型由神經網絡訓練得到。由于語言有一定的語法、詞法規則,人們訓練出語言模型表示音素、字、詞、句之間的關聯關系,語言模型由加權有限狀態轉換器表示。具體來看這個語音識別過程:首先提取音頻的特征向量,然后計算觀察狀態的統計特性,對應出這些狀態代表音素的可能性概率值,進而計算音素上下文關聯的狀態轉換關系,最后計算出特征向量對應音素序列概率最大的路徑,這個路徑對應的句子就是識別(解碼)結果。

圖6 語音識別原理

音頻直接上傳給系統的WTA攻擊

語音識別不同于圖像識別的是:聲學模型需要結合后面的語言模型共同決定識別結果,而且由于發音的延續性,語音識別受一定的上下文關系影響。由于語言模型結構復雜,攻擊者可以首先逆向分析出什么樣的聲學模型輸出結果(神經網絡的計算結果)一定會被解碼成目標文本,然后以這樣的輸出結果作為目標函數修改原始音頻,直到生成的對抗樣本達到或者非常接近這個目標,那么這個對抗樣本就能夠被識別為想要的文本。確定目標函數后,進一步用梯度下降算法修改x(t)逼近這個目標函數,從而生成修改幅度較小的對抗樣本x‘(t)=x(t)+δ(t),即直接將音頻上傳給語音識別系統API的WTA攻擊已經成功。

圖7 WTA攻擊原理圖

物理世界的WAA攻擊

考慮到實際生活應用中,音樂通常是被播放出來再被語音識別系統錄音接收的,這里播放和錄音設備的電子噪聲以及環境的背景噪聲均會對嵌入音頻的特征進行破壞,直接的辦法是在對抗樣本生成過程中引入“噪聲模型”模擬這種影響。即在對抗樣本生成過程中加入模擬的噪聲,保證這樣之后仍然能夠被系統識別為目標指令,那么嵌入到音樂中的音頻特征就足夠強到可以抵抗實際噪聲的破壞。但是由于對實際應用中噪聲建模需要大量工作,可以采用“隨機噪聲”代替,從而很大程度上簡化噪聲模型的構建過程,同時由于隨機噪聲不拘泥于模擬特殊的設備和環境影響,這種方式生成的對抗樣本具有更強的適應能力,可以很好地實現多種設備及多種環境下的物理攻擊。

圖8 WAA攻擊原理圖

智能語音安全問題越來越多地受人們重視,本文介紹了一種針對傳統語音識別的對抗攻擊方法。通過逆向分析語音識別算法,挖掘深度神經網絡的脆弱性,然后采用梯度下降算法自動化地修改音樂生成對抗樣本,即生成“惡魔音樂”在人們無法覺察的情況下攻擊語音識別系統。進一步通過引入噪聲模型模擬實際應用場景中設備和環境噪聲的影響,提升對抗樣本的魯棒性,從而能夠在實際應用中攻擊商業化平臺(如科大訊飛的訊飛輸入法),而且這種攻擊通過網絡或者無線信號傳播之后攻擊仍然有效。

對抗樣本是人工智能安全應用的一個重要威脅,挖掘深度學習算法的脆弱性,研究深度學習的對抗攻防技術對于人工智能落地具有重要意義。目前來看,提高對抗樣本的隱蔽性、遷移性和物理攻擊成功率還有很遠的路要走。

-

語音識別

+關注

關注

38文章

1757瀏覽量

113244 -

智能語音

+關注

關注

10文章

789瀏覽量

49027

原文標題:CommanderSong:“惡魔音樂”攻擊智能語音識別系統

文章出處:【微信號:bdtdsj,微信公眾號:中科院半導體所】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

《具身智能機器人系統》第10-13章閱讀心得之具身智能機器人計算挑戰

浪潮信息剖析智能時代數據存儲領域面臨的挑戰與機遇

Ampere 年度展望:2025年重塑IT格局的四大關鍵趨勢

UVLED固化機結構的四大模塊

光伏電站智能運維系統的四大功能

智能語音對抗攻擊面臨的四大挑戰

智能語音對抗攻擊面臨的四大挑戰

評論