一年不算短,但也不算長。一年時間,可以讓Swift從11位跌倒13位,也可以讓PyTorch從第4位飆升194%至第2位!

PyTorch狂漲194%,逼近TensorFlow份額

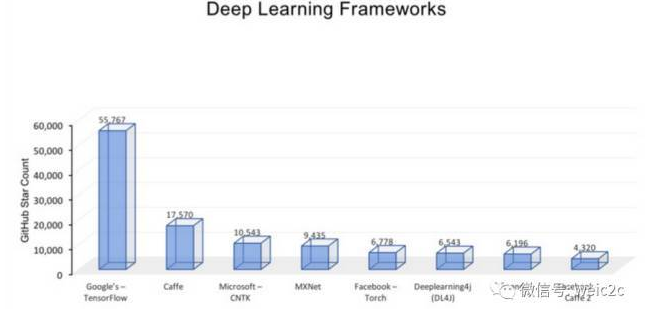

UC伯克利RISELab的在讀博士Caroline Lemieux,分享了他們團(tuán)隊(duì)收集的深度學(xué)習(xí)框架和數(shù)據(jù)科學(xué)庫使用情況的統(tǒng)計(jì)數(shù)據(jù)。O'Reilly Media的首席數(shù)據(jù)科學(xué)家Ben Lorica根據(jù)RISELab團(tuán)隊(duì)的數(shù)據(jù),做了一張圖:

圖中可以看到,TOP 3框架在過去一年中均有增長。表現(xiàn)最為亮眼的PyTorch在過去的一年里增速高達(dá)194%,成功超越Keras和Caffe,直逼第一名TensorFlow。

當(dāng)了多年老大的TensorFlow只有23%的增長,低于第三名Keras的26%。而第四名Caffe不增反降,跌了29%。

除了份額外,從上圖中的增長曲線還可以看出,PyTorch從去年開始發(fā)力,在今年第一季度獲得了一個非常陡的增長曲線,甚至幾度超越TensorFlow。

不知道TF有沒有感覺到背后的寒意。

Reddit網(wǎng)友的吐槽或許也能從一個層面,反映出為什么使用人數(shù)最多的TensorFlow反而不受待見、新晉黑馬PyTorch卻備受擁戴的個中緣由:

probablyuntrue:TensorFlow太讓人抓狂了,PyTorch比TF好太多!

bunny113:TF簡直翔一樣!我從GitHub上“偷”的1.0代碼,在其他版本上都用不了,PyTorch比TF好太多!

yusuf-bengio:TF的常量老變來變?nèi)サ模瑹┧懒耍yTorch比TF好太多!

mexiKobe:老變就是因?yàn)閺牡讓泳陀新┒床坏貌恢貥?gòu)啊。PyTorch比TF好太多!

ML_me_a_sheep:TF背后絕對是一幫天才。他們并不是像你們說的那樣胡搞瞎搞,TF很好的貼合了谷歌的需求,并不是我們這幫凡夫俗子能夠完全理解的。所以,我用PyTorch。PyTorch比TF好太多!(這位sheep請你坐下!)

rjurney:連個像樣的tf.keras文檔都沒有。PyTorch比TF好太多!

…

不知道TF有沒有再次感覺到背后的寒意。

不過整體來看,排名和去年相比變化不大。前四依然被TensorFlow、PyTorch、Keras和Caffe牢牢把持;MXNet超越了Theano上升了一位。

數(shù)據(jù)權(quán)威性和科學(xué)性

數(shù)據(jù)來源

據(jù)悉,RISELab團(tuán)隊(duì)使用的數(shù)據(jù),是基于知名電子出版服務(wù)arXiv.org上所發(fā)布論文的簡單全文搜索結(jié)果進(jìn)行統(tǒng)計(jì)的。

也就是說,這個數(shù)據(jù)反映了每個框架在論文的全文中被提及的數(shù)量。搜索結(jié)果顯示,最受論文作者們歡迎的深度學(xué)習(xí)框架是TensorFlow和PyTorch。

從2019年1月到6月底,大約1800篇論文提到了TensorFlow,而PyTorch被提及的數(shù)量和TensorFlow差距不大。

Lorica認(rèn)為,在某種程度上,研究人員和高校教師所使用的工具都是非常前衛(wèi)的,并且能夠強(qiáng)烈影響未來專業(yè)人士的框架使用情況,PyTorch和TensorFlow將在未來成為企業(yè)的首選。

發(fā)布機(jī)構(gòu)

該數(shù)據(jù)的發(fā)布機(jī)構(gòu)RISELab,前身是大數(shù)據(jù)領(lǐng)域世界頂尖的實(shí)驗(yàn)室之一、UC伯克利大學(xué)的AMPLab。AMPLab曾推出過多項(xiàng)世界知名技術(shù),比如Apache Spark、Apache Mesos和Alluxio。

AMPLab是加州大學(xué)伯克利分校一個為期五年的計(jì)算機(jī)研究計(jì)劃,初衷是使用數(shù)據(jù)去訓(xùn)練更加豐富的模型,從而理解人和機(jī)器如何進(jìn)行合作以解決數(shù)據(jù)中的問題,包括有效的數(shù)據(jù)清理、進(jìn)行可衡量的數(shù)據(jù)擴(kuò)展等。

AMPLab在2017年年底被關(guān)閉,接任者RISELab專注于提供SRDS,即安全實(shí)時的決策堆棧。RISELab團(tuán)隊(duì)的任務(wù)是將大數(shù)據(jù)分析推向一個更深度的次元,在這個次元中,傳感器無所不在,AI是真實(shí)可觸碰的、世界是可編程的。

RISELab是UC伯克利最新的五年期項(xiàng)目,有著強(qiáng)力的財(cái)政支持,將聚焦于提供安全執(zhí)行的實(shí)時人工智能系統(tǒng)。

企業(yè)方面的調(diào)查結(jié)果卻有點(diǎn)不一樣

最近O'Reilly也發(fā)布了一份有關(guān)機(jī)器學(xué)習(xí)框架使用情況的調(diào)查,有超過1300名行業(yè)人士返回了有效結(jié)果。

這份調(diào)查面向的不是學(xué)術(shù)界,而是企業(yè)。結(jié)果顯示,其中近半數(shù)受訪者稱在使用TensorFlow或scikit-learn,而使用PyTorch有29%,Keras略高達(dá)到34%。

Keras作者Fran?ois Chollet認(rèn)為,Keras的使用在產(chǎn)業(yè)界和整個數(shù)據(jù)科學(xué)圈中最占主流,產(chǎn)業(yè)既包括大公司也包括創(chuàng)業(yè)公司。不過,在研究社區(qū),Keras的份額要小很多。這或許就是在企業(yè)中Keras的份額仍然高于PyTorch的原因之一。

在你爭我搶,合縱連橫之下,中國的開源框架,什么時候才能在這樣的排名上擁有自己的姓名呢?

-

數(shù)據(jù)庫

+關(guān)注

關(guān)注

7文章

3794瀏覽量

64362 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5500瀏覽量

121113 -

tensorflow

+關(guān)注

關(guān)注

13文章

329瀏覽量

60528

原文標(biāo)題:ArXiv最火深度學(xué)習(xí)框架:TensorFlow第一,PyTorch第二!

文章出處:【微信號:aicapital,微信公眾號:全球人工智能】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

相關(guān)推薦

11種深度學(xué)習(xí)框架影響力對比

Nanopi深度學(xué)習(xí)之路(1)深度學(xué)習(xí)框架分析

單片機(jī)到底是需要學(xué)習(xí)什么

你最看好哪個深度學(xué)習(xí)框架呢?

機(jī)器學(xué)習(xí)與深度學(xué)習(xí)之間比較

深度學(xué)習(xí)框架你了解多少

現(xiàn)在ArXiv最火的深度學(xué)習(xí)框架到底是什么?

現(xiàn)在ArXiv最火的深度學(xué)習(xí)框架到底是什么?

評論