顯著性檢測的主要任務是檢測出圖像中具有最獨特視覺特征的目標區域,它在視覺內容編輯、目標檢測、渲染、分割等領域有著重要的應用。深度學習特別是全卷積神經網絡的發展極大地促進了顯著性檢測的進步,但目前的方法對于目標邊緣的處理還比較粗糙。 為了獲取更為精確的顯著性目標區域,來自南開大學的研究人員利用顯著性邊緣和顯著性目標間的互補性提出了一種邊緣引導的顯著性目標檢測網絡EGNet,大幅度改進了顯著性檢驗的邊緣效果和定位效果,并在多個數據集上取得了優異的結果。

EGNet

對于顯著性目標檢測來說,先前的方法都沒有重視顯著性邊緣檢測與顯著性目標檢測間的互補性。一個優異的顯著性邊緣檢測算法將有效地在定位和分割方面促進顯著性目標檢測算法,反之亦然。在這種思想的指導下,研究人員開始探索利用單個網絡融合顯著性邊緣信息與顯著性目標信息來實現更好的端到端顯著性檢測。

這一網絡的主要任務在于對互補信息建模,并利用兩種顯著性信息來提升檢測的性能。網絡的框架如下圖所示,包含了主干網絡和用于互補信息融合顯著性檢測的多個模塊。

研究人員首先使用VGG作為相對獨立的主干網絡對圖像進行不同層級的信息抽取,并將這五路不同層級的旁支特征送入后續的融合與檢測模塊中。其中Conv1-2感受野太小沒有被采用,而Conv2-2則主要包含邊緣信息,用于后續的邊緣顯著性檢測和顯著性目標檢測。

隨后需要分別對圖像中的顯著性目標特征和邊緣特征進行有效抽取和融合。研究人員采用了漸進式的屬性目標特征抽取(PSFEM部分)和非局域的顯著性邊緣特征抽取(NLSEM)。

研究人員使用了U-Net架構來抽取多分辨率特征,以便獲取更豐富的紋理信息。在原始U-Net的基礎上,在旁支上添加了三個卷積層以獲取更為魯棒的顯著性信息。最終每一層級輸出mask并與GT值進行比較以獲取目標特征損失。

為了構建并抽取邊緣特征,研究人員使用了VGG中的Conv2-2輸出特征來進行處理。然而局域信息不足以獲取完整的顯著性邊緣特征,所有還需要結合頂部的語義信息。此外最頂層的層感受野最大定位也最為準確,于是研究人員設計了一種自定向下的定位信息傳輸機制,將Conv6-3經過卷積后的特征與Conv2-2進行結合,最后利用GT的顯著性邊緣來獲取邊緣損失。

在獲取互補的顯著性邊緣及目標特征后,就可以利用邊緣信息來引導顯著性特征信息實現更好的檢測。研究人員將不同層級目標特征的結果與邊緣特征FE進行融合實現特征提升。隨后得到不同層級特征下獲取的掩膜結果,同時在每個結果上添加監督信號。最終將多尺度的掩膜融合起來得到最終的融合結果。

優異結果

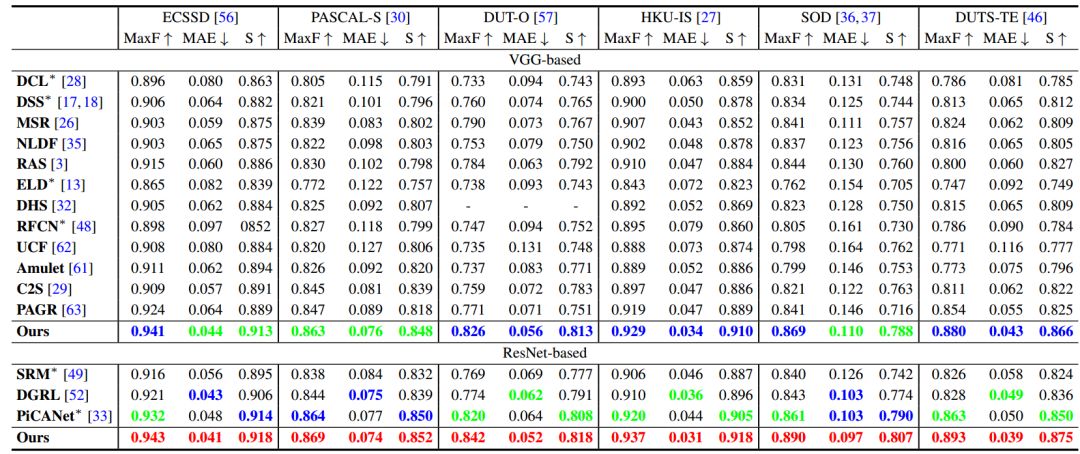

由于需要對算法性能進行測試,研究人員首先在DUST數據集上進行了訓練,并在ECSSD,PASCAL-S,DUT-OMRON,SOD,HKUIS,DUTS,ECSSD等六個數據集上進行了測評。測評的指標主要是描述平均精度和召回率的F值,描述預測結果準確性的MAE和描述結構信息的S值。

在與15種現有算法的比較后表明,本文提出的方法在各個數據集上都能獲得優秀的檢測結果。在比較中分別使用了restnet和vgg作為主干網抽取特征,其中箭頭的上或下表示結果相較于之前取得大幅或小幅進展:

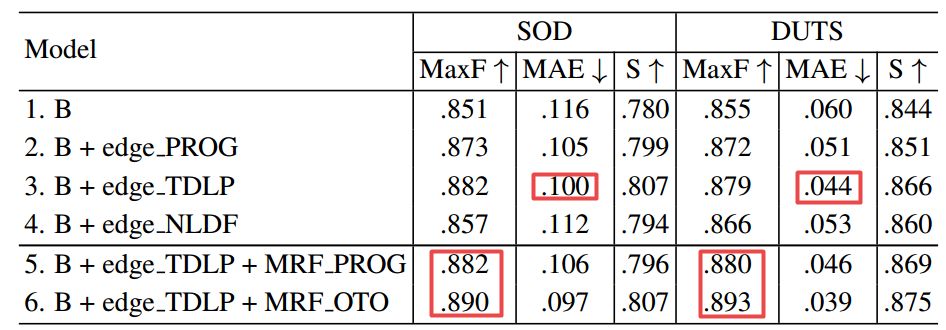

在消融性分析中研究人員還發現邊緣信息對于顯著性預測十分有效,同時將頂層語義信息傳到底層可以得到更為精確的定位信息。邊緣信息的融合也有助于最終顯著性檢測結果。互補信息可以同時提高分割和定位的效果。下表有效說明了各個模塊帶來的性能提升。

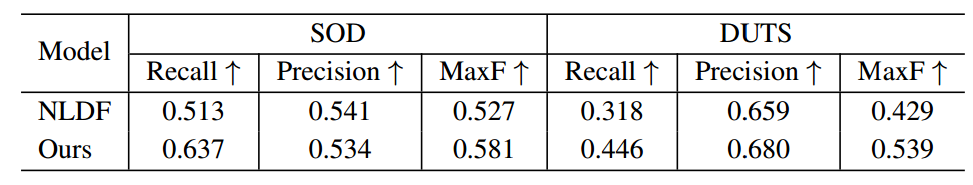

顯著性邊緣檢測的效果也因為互補信息的輔助而得到了提升:

與多種先進的顯著性檢測模型相比,EGNet在各種指標和視覺效果上都有了明顯的提升:

-

算法

+關注

關注

23文章

4620瀏覽量

93049 -

圖像

+關注

關注

2文章

1087瀏覽量

40501 -

數據集

+關注

關注

4文章

1208瀏覽量

24737

原文標題:邊緣互補新方法助力顯著性檢測更上一層樓

文章出處:【微信號:thejiangmen,微信公眾號:將門創投】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

AI模型部署邊緣設備的奇妙之旅:目標檢測模型

一種基于因果路徑的層次圖卷積注意力網絡

邊緣計算對網絡延遲的影響

慧視小目標識別算法 解決目標檢測中的老大難問題

邊緣計算與智能化網絡的結合可以實現以下哪些優勢

基于助聽器開發的一種高效的語音增強神經網絡

智能邊緣網關功能、重要性及應用

邊緣計算是什么意思?邊緣計算的應用

基于FPGA的實時邊緣檢測系統設計,Sobel圖像邊緣檢測,FPGA圖像處理

邊緣計算網關的用途及其使用方法

一種邊緣引導的顯著性目標檢測網絡EGNet

一種邊緣引導的顯著性目標檢測網絡EGNet

評論