漫畫摳圖是漢化組翻譯中必不可少而又工作量很大的一項工作,主要內容是將漫畫中的文字摳去,以便替換成另一種語言。現在,這項工作可以自動化地完成了,一位韓國的開發者開源了一款工具,借助深度學習模型可以一鍵摳去漫畫中的文字,連背景圖中的文字都可以被摳去,效果十分驚人。

很多人都喜歡看日本漫畫,不少作品已經成為很多人心中的童年回憶。但是對于漫畫的翻譯人員來說,他們需要去除原有漫畫的對話框和背景文字,并將其替換為讀者使用的語言。由于一本漫畫可能有數萬個對話框和對話,因此工作量是很大的。

現在,摳圖的工作人員可以基本上解放他們的雙手了。只要你有 TensorFlow,就可以快速實現一鍵摳圖,將漫畫圖像中的所有文字一鍵去除。

SickZil-Machine,一鍵摳圖

SickZil 是韓文中的作者提供了一個視頻,用于展示這一工具的效果。

作者同時提供了自動工具摳圖的案例。

對話框中的文字可以被完全消除。

有時候會有些文字消除不干凈的情況,但基本不影響畫面(漫畫右上角標題符號)。同時,背景中被去掉文字后,背景畫面可以被自動補全,基本不改變畫面效果(畫面右上角背景文字)。

從視頻中可以看出,這一工具非常的方便。只需要選擇待處理的漫畫,然后運行工具即可。如果有一些畫面被誤去除,或者有一些去除不干凈的情況下,用戶可以手動修改需要被去除的文字。

那么,這一工具背后是什么技術呢?

技術

模型架構

據項目作者介紹,這一工具背后使用了兩個模型,第一個是 Seg Net,用于檢測漫畫中的問題。另一個則是 Compl Net,用于處理漫畫圖像,去除文字并補全缺失的圖像部分。

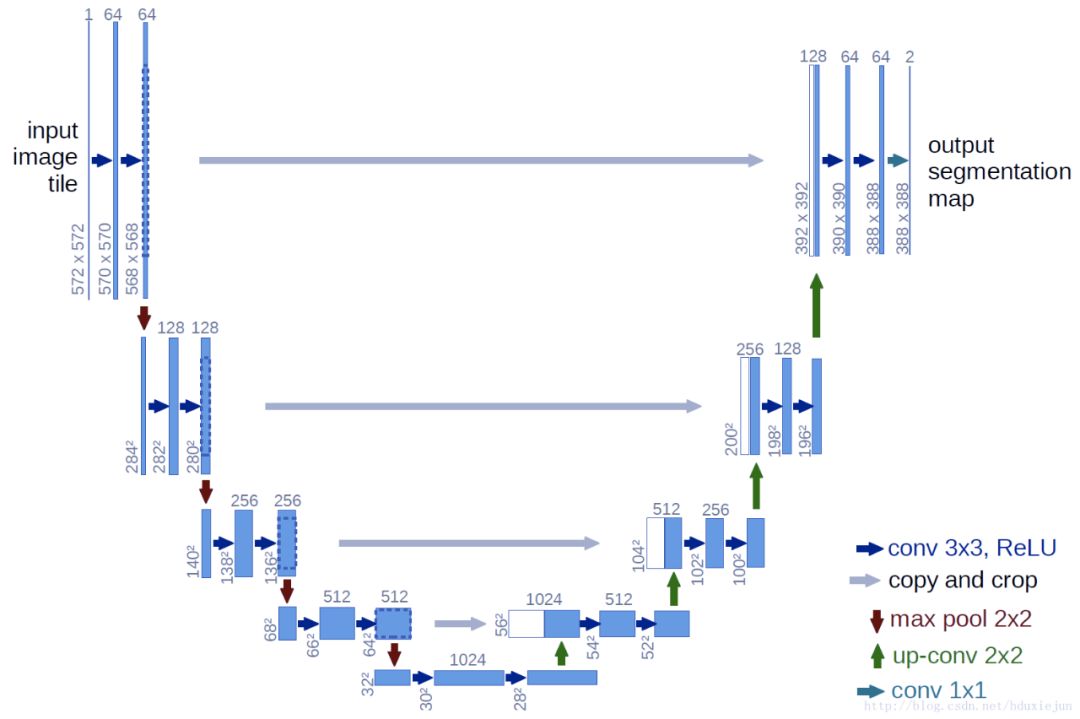

Seg Net 使用的是 U-NET。這是一種編碼器-解碼器架構。編碼器逐漸減少池化層的空間維度,解碼器逐步修復物體的細節和空間維度。

U-Net 的架構,將輸入圖像逐步池化后進行上采樣,從而還原圖像細節。

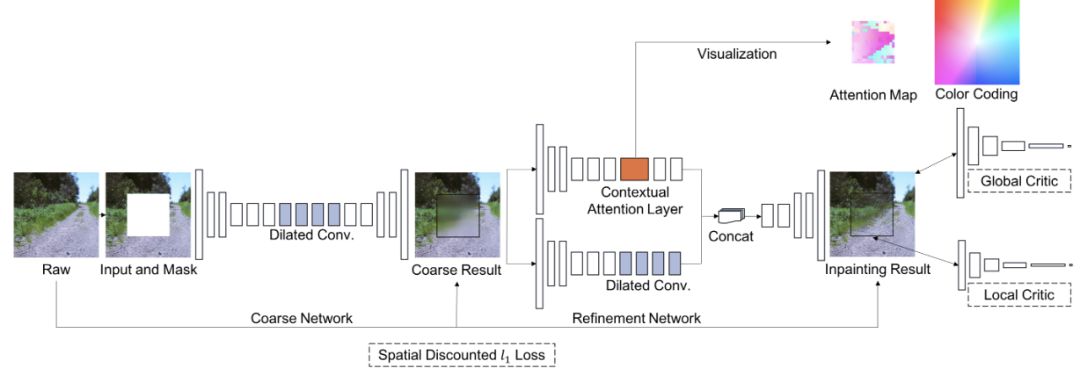

而 Compl Net 使用的是 deepfill v2,這是一個用于對任意被 mask 的圖像進行修復的模型,可以適應各種 mask 的方式(塊狀遮蓋或線條遮蓋都可以)。deepfill 是 Adobe 等機構提出一系列圖像修復工具,機器之心也曾用過 deepfill v1,但是效果似乎沒有論文展示的那么好。

目前 deepfill v2 并沒有官方開源,但 GitHub 上有其他開發者復現。

deepfill v2 的模型架構,可以進行圖像修復。

有了這兩大神器,基本上可以實現漫畫文字的檢測識別和去除文本后的圖像補全。

數據集和訓練

有了模型還不夠,很多讀者想知道,整個系統是怎樣訓練的。

在 Seg Net 上,作者使用了原始的漫畫圖像和文本內容遮蓋數據,用于覆蓋原始漫畫中所有的文字部分。在 Compl Net 上,模型的輸入為被移除了文字的漫畫圖像。模型使用了 285 個圖像-遮蓋對和 31500 張漫畫圖像,其中有將近 12000 張漫畫是有文字的,因此訓練的數據比較平衡。

安裝和使用

作者沒有透露訓練模型的相關參數,但是提供了開發者需要準備的硬件配置。 對于開發者而言,運行代碼需要準備 NVIDIA 驅動 410.x,CUDA 10.0,CUDNN >= 7.4.1,TensorFlow 需要大于 1.13 版本。

配置代碼步驟如下:

首先克隆相關代碼:git clone https://github.com/KUR-creative/SickZil-Machine.git; cd SickZil-Machine

下載 zip 文件,地址:https://github.com/KUR-creative/SickZil-Machine/releases。

解壓并復制文件:SickZil-Machine-0.1.1-pre0-win64-cpu-eng/resource/cnet 和 SickZil-Machine-0.1.1-pre0-win64-cpu-eng/resource/snet 到文件目錄:SickZil-Machine/resource.

進入目錄并安裝:pip install -r requirements.txt

運行主程序:cd src; python main.py

-

模型

+關注

關注

1文章

3254瀏覽量

48894 -

代碼

+關注

關注

30文章

4793瀏覽量

68701 -

深度學習

+關注

關注

73文章

5504瀏覽量

121246

原文標題:漫畫漢化組福音:深度學習工具一鍵摳圖

文章出處:【微信號:almosthuman2014,微信公眾號:機器之心】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

一款支持USB攝像頭輸入錄像的高清錄播機

谷歌發布“深度研究”AI工具,利用Gemini模型進行網絡信息檢索

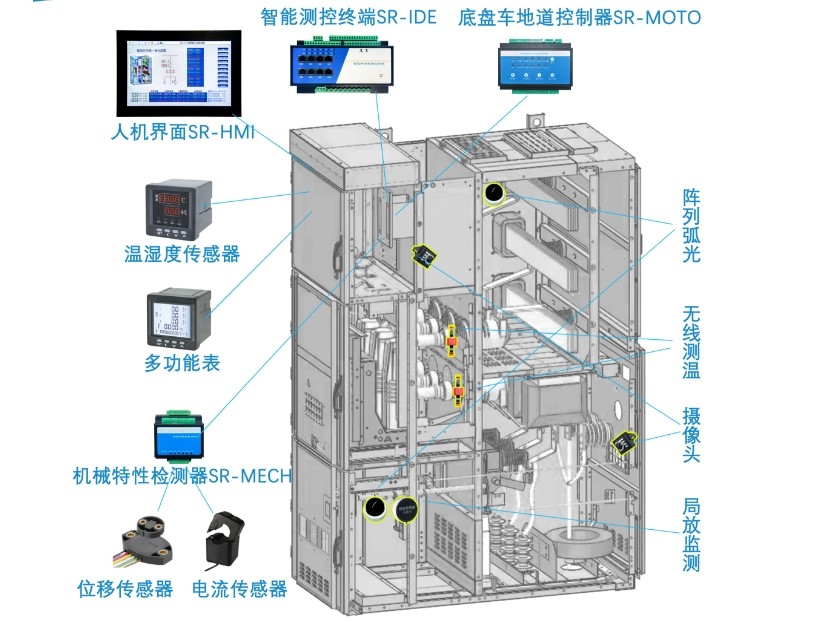

在中壓開關柜上使用微機五防鎖是否可以實現一鍵順控

LoRa無線一鍵報警安防建設系統

一鍵斷電開關的種類有哪些

一鍵斷電開關的控制原理是什么

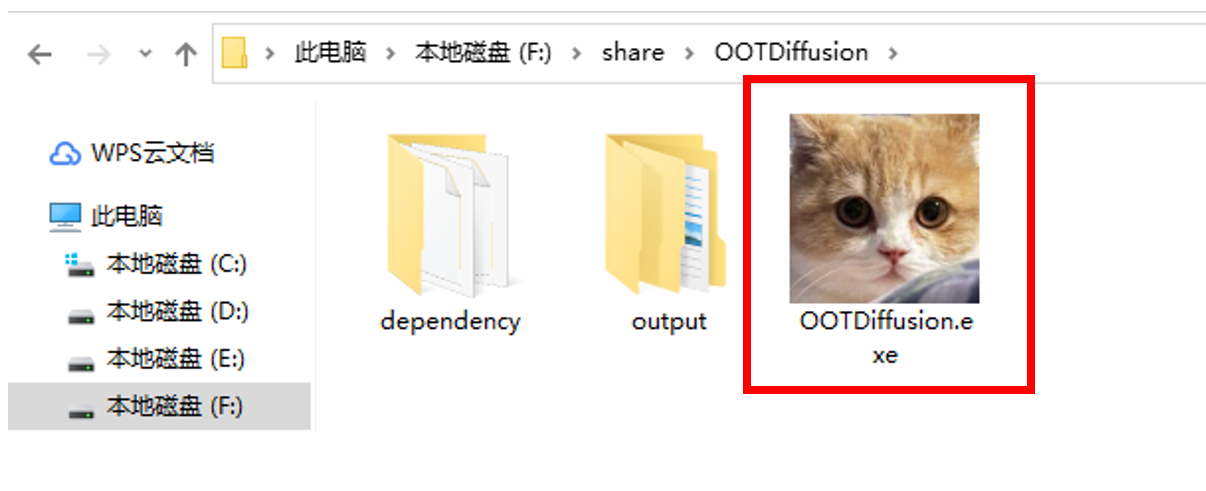

OOTDiffusion整合包一鍵AI換裝, 免費生成高端服裝模特照! 電商必備省錢工具!

2021款路虎攬勝運動版車遙控及一鍵起動功能失效

寶塔面板Docker一鍵安裝:部署GPTAcademic,開發私有GPT學術優化工具

一款工具,借助深度學習模型可以一鍵摳去漫畫中的文字

一款工具,借助深度學習模型可以一鍵摳去漫畫中的文字

評論