俗話說“耳聽為虛,眼見為實”,如今在人工智能技術的影響下,“眼見”也不一定為實。在近日熱播的英劇《真相捕捉(The Capture)》中,視頻里的人都可以被換臉,即使是實時的監控錄像也能被篡改,只要擁有一個人的聲音或面部圖像數據,就可以制造假視頻作為假證據。雖然故事是虛擬的,但細思極恐,人工智能技術的突飛猛進的當下,我們必須警惕伴隨AI 技術發展而產生的AI技術被濫用的問題。

事實上,《真相捕捉》里的場景從技術角度看并非遙不可及,此前DeepFake事件已經給了人們一次提醒微軟總裁Brad Smith 也在其新書《工具,還是武器?》中呼吁大家直面這些人類科技最緊迫的爭議性問題。微軟亞洲研究院計算機視覺組一直試圖從技術角度去鑒別人臉圖像、視頻的真假,FaceX-Ray 便是微軟亞洲研究院在這一領域的最新突破。該技術的相關論文已被CVPR 2020收錄。

Face X-Ray:可解釋、且可信賴

Face X-Ray,顧名思義就是要給人臉圖像、視頻做“X 光檢測”。微軟亞洲研究院常務副院長郭百寧表示,“X-Ray 最大的突破在于:無論換臉圖像是采用已知還是未知的換臉算法,它都可以有較高的識別率,平均達到95%以上;而且還能告訴你為什么,這個方法在某種程度上解決了 AI 模型的傳統‘黑盒’問題,可解釋、且可信賴。”

傳統的 AI 換臉一般分三步走:(1)檢測目標圖像的面部區域;(2)利用 AI 換臉算法生成新的面部及一部分周圍區域;(3)將生成的新面部融合到原圖像中,替換原圖像中的面部。

此前的換臉鑒別方法主要從第二步入手,通過基于數據集的有監督訓練學習大量換臉圖像,檢測換臉過程中產生的瑕疵,判斷真偽。但是,不同的換臉算法合成時的瑕疵各不相同,因此針對一種換臉算法進行訓練后,應用于另外一種算法上時準確率明顯下降,這就是已有換臉鑒別算法不具通用性的原因。

對此,微軟亞洲研究院視覺計算組的研究員另辟蹊徑,在FaceX-Ray中通過一種全新的方式去判斷一張人臉圖像是否被更換過。Face X-Ray不需要事先知道操作方法或人工監督,而是從第三步入手,通過生成灰度圖像,顯示該圖像是否可以分解為來自不同來源的兩個圖像的混合,從而檢測出換臉的邊界,就像照 X 光一樣,讓這個邊界清晰可見(如下圖所示)。

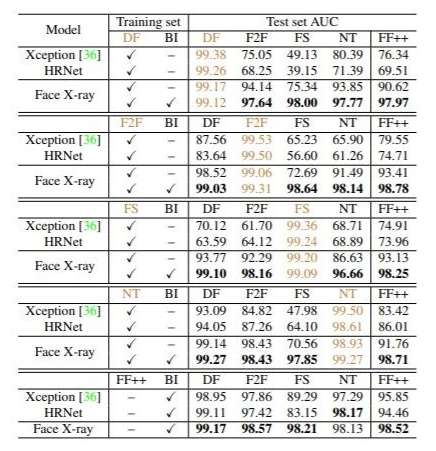

算法預測出的融合邊界。BI 表示人工合成人臉。DF、F2F、FS、NT 分別表示 DeepFakes、Face2Face、FaceSwap、NeuralTextures 算法生成的人臉。

除此之外,由于 Face X-Ray 不是通過“學習”大量換臉圖像去提高識別率的,訓練數據也不依賴特定的換臉技術所生成的圖像,而是直接采用普通的人臉照片進行訓練,而且它還能標出換臉的邊界在哪里,不再像以往的算法那樣,是個只顯示識別結果,卻無法說出為什么的“黑盒”。

(a)行是真實圖像,(b)行是合成圖像,中間一列為噪聲分析,右側一列是誤差水平分析

對未知換臉算法,檢測精度高達95%以上

Face X-Ray 算法依然基于 FaceForensics 數據集進行了測試,但采用了與之前的換臉鑒別算法不同的方式。但與此前的換臉鑒別算法采用數據集中的四種換臉算法生成的人臉圖像進行訓練不同的是,Face X-Ray 只在其中一種算法(例如 DeepFakes)合成的圖像上訓練,然后再在另外三種數據上測試,測試結果都可以達到95%以上的識別率。這在“通用”換臉鑒別算法中,無疑是一大創新突破。

測試結果表明,Face X-Ray 的識別率均達到95%以上

包括換臉在內的安全問題,將是一場長期的戰斗

《工具,還是武器?》一書說到,即使是最好的科技,也可能帶來意想不到的后果;人類需要認真觀察后視鏡,以便能夠利用過去的經驗,去預測轉彎之處的問題。書中還強調,人工智能的道德問題將不可避免地從一般性討論轉變為具體議題。而現階段,換臉圖像便是具體議題之一,與此同時,文字、語音、視頻的虛構、嫁接問題也會接踵而至。

從技術上看,文字、聲音屬于一維信號,圖像屬于二維信號,視頻則是三維信號,維度越高,識別難度就越大,因此圖像的鑒別是一個攻堅課題,如果它有所突破,便意味著鑒別技術的整體進步。Face X-Ray 的通用性和可解釋性的提升,也讓換臉圖像的鑒別距離真正的應用越來越近。

郭百寧表示,在研究換臉圖像/視頻鑒別的同時,微軟亞洲研究院也在研究真假語音的鑒別。對微軟亞洲研究院來說,這只是一個開始。本質上這些都屬于安全問題,就像 PC、互聯網時代的病毒和殺毒軟件一樣,實際上是一場貓與鼠之間的較量,而這也將是計算機科學領域科研人員的一場長期戰斗!

-

微軟

+關注

關注

4文章

6591瀏覽量

104027 -

AI

+關注

關注

87文章

30758瀏覽量

268902

發布評論請先 登錄

相關推薦

X-RAY檢測設備用于檢測集成電路缺陷瑕疵

SMT加工質量新保障:X-ray檢測設備的作用與重要性

X-RAY與SAT檢測原理:為什么X-RAY只能掃描空洞不能掃描分層

X-ray在芯片失效分析中的應用

這些因素影響X-RAY射線檢測設備的價格

TLV8544 X-RAY框架變動,是否是因為DC差距導致的變動呢?

x-ray射線無損檢測第三方檢測機構廠家

德國進口X-RAY射線掃描測量機

X-RAY檢測設備操作指南

X-ray射線無損檢測設備檢測印制電路板

無損檢測技術中工業CT檢測與X-RAY射線檢測

廣東東莞X-ray射線檢測設備廠家無損高效測量

X-RAY射線檢測設備的性能特點

微軟Face X-Ray能識別換臉圖像

微軟Face X-Ray能識別換臉圖像

評論