3月13日消息,谷歌宣布推出 MediaPipe Objectron,這是一種適用于日常物體的移動(dòng)端實(shí)時(shí)3D目標(biāo)檢測(cè) pipeline,它能夠檢測(cè) 2D 圖像中的目標(biāo),并通過(guò)新創(chuàng)建 3D 數(shù)據(jù)集上訓(xùn)練的機(jī)器學(xué)習(xí)模型來(lái)估計(jì)這些目標(biāo)的姿態(tài)和大小。它在安卓、IOS 網(wǎng)頁(yè)等各種平臺(tái)上都能應(yīng)用機(jī)器學(xué)習(xí)媒體模型,并加入了移動(dòng)端試試 3D 檢測(cè)模型。目前 MediaPipe包含人臉檢測(cè)、手部檢測(cè)、頭發(fā)分割和視頻自動(dòng)橫豎屏轉(zhuǎn)換等功能。

MediaPipe 是一個(gè)用于構(gòu)建 pipeline 進(jìn)而處理不同模態(tài)感知數(shù)據(jù)的跨平臺(tái)開(kāi)源框架,Objectron 則在 MediaPipe 中實(shí)現(xiàn),其能夠在移動(dòng)設(shè)備上實(shí)時(shí)計(jì)算目標(biāo)的定向 3D 邊界框。從單個(gè)圖像進(jìn)行 3D 目標(biāo)檢測(cè)。MediaPipe 可以在移動(dòng)端上實(shí)時(shí)確認(rèn)目標(biāo)對(duì)象的位置、方向以及大小。整個(gè)模型非常精簡(jiǎn),速度也非常快,研究者將整套方案都開(kāi)源了出來(lái)。

獲取真實(shí)的3D訓(xùn)練數(shù)據(jù)

隨著依賴(lài)于 3D 傳感器(如 LIDAR)的自動(dòng)駕駛行業(yè)發(fā)展普及,現(xiàn)在已有大量街道場(chǎng)景的 3D 數(shù)據(jù),但對(duì)于日常生活中擁有更細(xì)顆粒度的目標(biāo)來(lái)說(shuō),有標(biāo)注的 3D 數(shù)據(jù)集就非常有限了。所以,為了解決此問(wèn)題,谷歌團(tuán)隊(duì)使用了 AR 會(huì)話(huà)(Session)數(shù)據(jù)開(kāi)發(fā)了一種全新的數(shù)據(jù) Pipeline。

此外,隨著 ARCore 以及 ARkit 的出現(xiàn),數(shù)億體量的智能手機(jī)擁有了 AR 功能,并且能夠通過(guò) AR 會(huì)話(huà)取獲取更多的信息,包括相機(jī)姿態(tài)、稀疏 3D 點(diǎn)云、光照估計(jì)以及平面區(qū)域估計(jì)。為了標(biāo)記真實(shí)數(shù)據(jù),團(tuán)隊(duì)構(gòu)建了一個(gè)全新的標(biāo)注工具,并且與 AR 會(huì)話(huà)數(shù)據(jù)一起使用,該標(biāo)注工具使標(biāo)注者得以快速標(biāo)記目標(biāo)的 3D 邊界框。

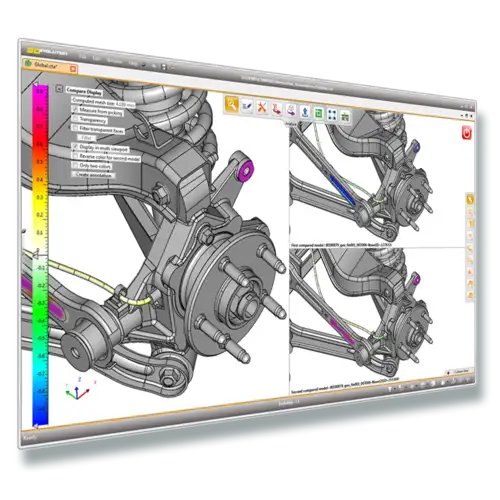

該工具使用了分屏視圖來(lái)顯示 2D 的視頻幀,同時(shí)在其左側(cè)疊加 3D 邊界框,并在右側(cè)顯示 3D 點(diǎn)云,攝像機(jī)方位以及所檢測(cè)到的水平面。標(biāo)注器在 3D 視圖中繪制 3D 邊界框,并通過(guò)查看 2D 視頻幀中的投影來(lái)驗(yàn)證其位置。

左:帶標(biāo)注的 3D 邊界框所形成的投影展示在邊界框頂部,更易于驗(yàn)證標(biāo)注;右:通過(guò)檢測(cè)到的目標(biāo)表面以及稀疏點(diǎn)云數(shù)據(jù),可以為不同的相機(jī)姿態(tài)標(biāo)注真實(shí)世界中的 3D 邊界框。

AR 合成數(shù)據(jù)

之前常用的方法會(huì)根據(jù)合成數(shù)據(jù)補(bǔ)充真實(shí)數(shù)據(jù),以提高預(yù)測(cè)的準(zhǔn)確性。然而這樣的做法通常會(huì)導(dǎo)致質(zhì)量低下、不真實(shí)的數(shù)據(jù),且如果要執(zhí)行圖像的真實(shí)感渲染,又需要更多的計(jì)算力。

研究者采用了另一種稱(chēng)之為 AR 合成數(shù)據(jù)(AR Synthetic Data Generation)的方法,只要將對(duì)象放到 AR 系統(tǒng)的工作場(chǎng)景中,我們就能利用相機(jī)姿態(tài)估計(jì)、水平面檢測(cè)、光照估計(jì)生成物理上可能存在的位置及場(chǎng)景。這種方法能生成高質(zhì)量合成數(shù)據(jù),并無(wú)縫匹配實(shí)際背景。通過(guò)結(jié)合真實(shí)數(shù)據(jù)與 AR 合成數(shù)據(jù),研究者能將模型的準(zhǔn)確性提高約 10%。

3D 目標(biāo)檢測(cè)的流程是什么樣的

對(duì)于 3D 目標(biāo)檢測(cè),研究者先構(gòu)建了一個(gè)單階段模型 MobilePose,以預(yù)測(cè)單張 RGB 圖像中某個(gè)目標(biāo)的姿態(tài)和物理大小。該模型的主干是一個(gè)編碼器-解碼器架構(gòu),其構(gòu)建在 MobileNet V2 的基礎(chǔ)上。研究者應(yīng)用了多任務(wù)學(xué)習(xí)方法,來(lái)從檢測(cè)與回歸的角度聯(lián)合預(yù)測(cè)目標(biāo)的形狀,且在預(yù)測(cè)形狀的過(guò)程中,其只依賴(lài)于標(biāo)注的分割圖像。

MobilePose-Shape 網(wǎng)絡(luò)在中間層會(huì)帶有形狀預(yù)測(cè)模塊。

在模型的訓(xùn)練中,如果數(shù)據(jù)沒(méi)有標(biāo)注形狀,那也是可行的。只不過(guò)借助檢測(cè)邊界框,研究者可以預(yù)測(cè)形狀中心與分布。

為了獲得邊界框的最終 3D 坐標(biāo),研究者利用了一種完善的姿態(tài)估計(jì)算法(EPnP),它可以恢復(fù)對(duì)象的 3D 邊界框,而無(wú)需知道對(duì)象維度這一先驗(yàn)知識(shí)。給定 3D 邊界框,我們可以輕松計(jì)算對(duì)象的姿態(tài)和大小。

下圖顯示了網(wǎng)絡(luò)架構(gòu)和后處理過(guò)程,該模型輕巧到可以在移動(dòng)設(shè)備上實(shí)時(shí)運(yùn)行(在 Adreno 650 mobile GPU 上以 26 FPS 的速度運(yùn)行)。

3D 目標(biāo)檢測(cè)的神經(jīng)網(wǎng)絡(luò)架構(gòu)與后處理過(guò)程。

模型的示例結(jié)果,其中左圖為估計(jì)邊界框的原始 2D 圖像,中間為帶高斯分布的目標(biāo)檢測(cè),最右邊為預(yù)測(cè)的分割 Mask。

在 MediaPipe 中進(jìn)行檢測(cè)和追蹤

當(dāng)模型對(duì)移動(dòng)設(shè)備獲得的每一幀圖像進(jìn)行計(jì)算的時(shí)候,它可能會(huì)遇到晃動(dòng)的情況,這是因?yàn)槊恳粠瑢?duì)目標(biāo)邊界框預(yù)測(cè)本身的模糊性造成的。為了緩解這個(gè)問(wèn)題,研究者采用了檢測(cè)+追蹤的框架,這一框架近期被用于 2D 檢測(cè)和追蹤中。這個(gè)框架減少了需要在每一幀上運(yùn)行網(wǎng)絡(luò)的要求,因此可以讓模型的檢測(cè)更為精確,同時(shí)保證在移動(dòng)端上的實(shí)時(shí)性。它同時(shí)還能保持識(shí)別幀與幀之間的目標(biāo),確保預(yù)測(cè)的連貫性,減少晃動(dòng)。

為了進(jìn)一步提升這一 pipeline 的效率,研究者設(shè)置模型在每幾幀后再進(jìn)行一次模型推理。之后,他們使用名為快速動(dòng)作追蹤(instant motion tracking)和 Motion Stills 技術(shù)進(jìn)行預(yù)測(cè)和追蹤。當(dāng)模型提出一個(gè)新的預(yù)測(cè)時(shí),他們會(huì)根據(jù)重疊區(qū)域?qū)z測(cè)結(jié)果進(jìn)行合并。

為了鼓勵(lì)研究者和開(kāi)發(fā)者基于這一 pipeline 進(jìn)行試驗(yàn),谷歌目前已經(jīng)將研究成果開(kāi)源到了 MediaPipe 項(xiàng)目中,包括端到端的移動(dòng)設(shè)備應(yīng)用 demo,以及在鞋、椅子兩個(gè)分類(lèi)中訓(xùn)練好的模型。研究者希望這一解決方案能夠更好地幫助到社區(qū),并產(chǎn)生新的方法、應(yīng)用和研究成果。團(tuán)隊(duì)也希望能夠擴(kuò)大模型到更多類(lèi)別中,進(jìn)一步提升在移動(dòng)端設(shè)備的性能表現(xiàn)。

責(zé)任編輯:gt

-

3D

+關(guān)注

關(guān)注

9文章

2954瀏覽量

110123 -

谷歌

+關(guān)注

關(guān)注

27文章

6227瀏覽量

107712

發(fā)布評(píng)論請(qǐng)先 登錄

?超景深3D檢測(cè)顯微鏡技術(shù)解析

SciChart 3D for WPF圖表庫(kù)

【RA-Eco-RA4E2-64PIN-V1.0開(kāi)發(fā)板試用】3D 圖形顯示

AI模型部署邊緣設(shè)備的奇妙之旅:目標(biāo)檢測(cè)模型

CASAIM自動(dòng)化檢測(cè)設(shè)備3D尺寸檢測(cè)形位公差測(cè)量設(shè)備

中興通訊攜手中國(guó)移動(dòng)推出AI裸眼3D創(chuàng)新產(chǎn)品

安寶特產(chǎn)品 安寶特3D Analyzer:智能的3D CAD高級(jí)分析工具

RT-Thread攜手進(jìn)迭時(shí)空:共建RISC-V實(shí)時(shí)計(jì)算生態(tài)

評(píng)論