從歷史上看,半導體行業逐年提高芯片速度的主要方法是通過縮小晶體管,使更多的晶體管可以安裝在處理器上。Cerebras Systems Inc.正在采取另一種方法:加利福尼亞的芯片初創公司沒有使晶體管變小,而是使處理器變大了-更大。

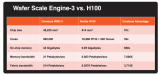

Cerebras今天發布了Wafer Scale Engine,這是一種人工智能芯片,其尺寸是Nvidia Corp.旗艦V100數據中心圖形卡的57倍。這家初創公司稱贊它是有史以來最大的處理器。

晶圓級引擎(Wafer Scale Engine,簡稱WSE)是一個8.5英寸乘8.5英寸的琥珀色磚(如圖),其中包含不少于1.2萬億個晶體管。相比之下,V100為211億。WSE的電路分為400,000個處理內核,這些內核專門針對AI和18 GB的高速板載內存進行了優化。

Cerebras將該芯片作為數據中心設備的一部分推向市場,該數據中心設備具有自己的水冷系統,可以吸收所有這些核心的熱量。這家初創公司的首席執行官安德魯·費爾德曼(Andrew Feldman)告訴《財富》雜志,該機器將提供具有多個Nvidia顯卡的服務器的150倍的計算能力。Cerebras稱磅一磅,它的設備消耗了具有相同處理能力的基于Nvidia的服務器場所需的2%至3%的空間和電力。

該效率是WSE超大型外形的直接結果。在由多個單獨的GPU組成的傳統AI環境中,要處理的數據必須通過相對較慢的網絡鏈路不斷在不同芯片之間傳輸,這會造成瓶頸。對于WSE而言,這不是問題,因為所有計算都在同一電路板上完成。

將處理操作集中在一個大芯片上以提高效率的想法已經存在了數十年。但是,由于實現此概念涉及巨大的技術挑戰,因此Cerebras之前沒有一家公司設法實現這一目標。

最大的障礙之一在于制造過程。即使在世界上最現代化的芯片制造工廠,也沒有辦法生產出WSE大小的處理器,而至少有1.2萬億個晶體管出現問題。有缺陷的晶體管通常會使整個處理器無法使用,但是Cerebras通過在WSE中建立一個可以在故障部件周圍路由數據的網絡來解決了這個問題。

Cerebras產品管理總監Andy Hock在一篇博客文章中寫道,該芯片的設計“具有核心,內存和互連的基本特性,并具有邏輯上的極限。” “通過將所有芯片連接起來,通信速度比InfiniBand等片外技術快了數千倍。”

這家初創公司的技術正引起業界的嚴重關注。Cerebras已經從包括早期Twitter Inc.支持者Benchmark,前Advanced Micro Devices Inc.首席技術官Fred Weber和OpenAI首席科學家Ilya Sutskever在內的投資者籌集了超過2億美元的資金。

Cerebras計劃從9月開始發貨其基于WSE的數據中心設備。該初創公司已向數家早期采用者提供了該機器的原型版本。

-

晶圓

+關注

關注

52文章

4890瀏覽量

127934 -

晶體管

+關注

關注

77文章

9682瀏覽量

138084 -

人工智能芯片

+關注

關注

1文章

120瀏覽量

29095

發布評論請先 登錄

相關推薦

卡諾模型為人工智能領域提供了一種全新的視角

嵌入式和人工智能究竟是什么關系?

《AI for Science:人工智能驅動科學創新》第6章人AI與能源科學讀后感

AI for Science:人工智能驅動科學創新》第4章-AI與生命科學讀后感

《AI for Science:人工智能驅動科學創新》第一章人工智能驅動的科學創新學習心得

risc-v在人工智能圖像處理應用前景分析

名單公布!【書籍評測活動NO.44】AI for Science:人工智能驅動科學創新

FPGA在人工智能中的應用有哪些?

人工智能初創企業Scale AI融資10億美元

5G智能物聯網課程之Aidlux下人工智能開發(SC171開發套件V2)

5G智能物聯網課程之Aidlux下人工智能開發(SC171開發套件V1)

Cerebras推出性能翻倍的WSE-3 AI芯片

最強AI芯片發布,Cerebras推出性能翻倍的WSE-3 AI芯片

Cerebras發布了Wafer Scale Engine,一種人工智能芯片

Cerebras發布了Wafer Scale Engine,一種人工智能芯片

評論