與人工智能的好處一樣強(qiáng)大,使用偏差數(shù)據(jù)和有缺陷的AI模型可能會(huì)造成很多損害。

斯坦福大學(xué)高級(jí)研究學(xué)者兼數(shù)字公民社會(huì)實(shí)驗(yàn)室主任露西·伯恩霍爾茲(圖)表示,為了解決這一日益嚴(yán)重的問題,必須將人的價(jià)值觀納入整個(gè)數(shù)據(jù)科學(xué)過程。

她說:“ [價(jià)值觀]不應(yīng)成為單獨(dú)的討論主題。” “我們需要就以下內(nèi)容進(jìn)行對(duì)話:我們要為什么而努力,我們要保護(hù)誰,如何試圖識(shí)別個(gè)人的人為因素,而這必須貫穿于整個(gè)數(shù)據(jù)科學(xué)之中。”

伯恩霍爾茲與之交談索尼婭Tagare,theCUBE,SiliconANGLE Media的移動(dòng)即時(shí)串流工作室主持人的女性數(shù)據(jù)科學(xué)大會(huì)在斯坦福大學(xué),加州期間,。他們討論了價(jià)值在數(shù)據(jù)科學(xué)中的重要性,為什么必須要有一個(gè)多元化的團(tuán)隊(duì)來構(gòu)建和分析算法以及數(shù)字公民社會(huì)實(shí)驗(yàn)室正在開展的工作。

根據(jù)伯恩霍爾茨的說法,所有數(shù)據(jù)都是有偏見的,因?yàn)槭侨藗冊(cè)谑占瘮?shù)據(jù)。她強(qiáng)調(diào)說:“而且我們正在將偏見建立到數(shù)據(jù)科學(xué)中,然后將這些工具導(dǎo)出到偏見系統(tǒng)中。” “你猜怎么著?問題變得越來越嚴(yán)重。因此,讓我們停止這樣做。”

Bernholz解釋說,在創(chuàng)建算法并進(jìn)行分析時(shí),數(shù)據(jù)科學(xué)家需要確保他們正在考慮數(shù)據(jù)集中所有不同類型的人,并在上下文中了解這些人。

“我們非常清楚,有色女性與白人男性面臨的環(huán)境不同;他們不會(huì)以同樣的方式走遍世界。”她解釋說。“而且認(rèn)為您的購(gòu)物算法不會(huì)影響他們?cè)诂F(xiàn)實(shí)世界中所經(jīng)歷的差異是荒謬的。”

她補(bǔ)充說,還必須讓參與算法創(chuàng)建以及公司管理的人員具有不同的個(gè)人資料,他們可以決定是否以及如何使用它們。

-

算法

+關(guān)注

關(guān)注

23文章

4608瀏覽量

92845 -

人工智能

+關(guān)注

關(guān)注

1791文章

47208瀏覽量

238294 -

數(shù)據(jù)科學(xué)

+關(guān)注

關(guān)注

0文章

165瀏覽量

10053

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

康謀方案 | 多源相機(jī)數(shù)據(jù)采集與算法集成測(cè)試方案

NVIDIA Isaac Sim滿足模型的多樣化訓(xùn)練需求

多樣化選擇:中國(guó)星坤X0517系列高溫材料連接器,適應(yīng)多種盒高!

博科測(cè)試IPO上市觀察:產(chǎn)品布局完善,可滿足多樣化檢測(cè)需求

室內(nèi)人行與導(dǎo)航系統(tǒng)有哪些多樣化的功能?

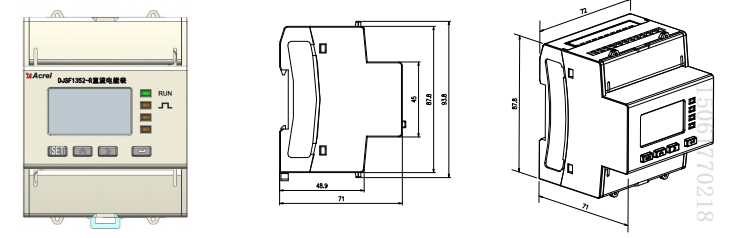

雙路設(shè)計(jì),滿足光伏電站與充電樁多樣化計(jì)量需求——安科瑞丁佳雯

潤(rùn)和軟件星閃業(yè)務(wù)閃耀海外,亮相“面向智能社會(huì)的技術(shù)多樣化與產(chǎn)品戰(zhàn)略論壇”

創(chuàng)新科技,精準(zhǔn)導(dǎo)航:大核桃單北斗手持終端的獨(dú)特優(yōu)勢(shì)與多樣化應(yīng)用場(chǎng)景

弧形導(dǎo)軌的多樣化驅(qū)動(dòng)方式

圖像識(shí)別算法的測(cè)試方法有哪些

SolidWorks教育版教學(xué)資源的多樣性

DC/AC電源模塊:實(shí)現(xiàn)電力系統(tǒng)的多樣化應(yīng)用

長(zhǎng)電科技為自動(dòng)駕駛芯片客戶提供多樣化高可靠性的封裝測(cè)試解決方案

多樣化的團(tuán)隊(duì)可以幫助減少偏見算法

多樣化的團(tuán)隊(duì)可以幫助減少偏見算法

評(píng)論