(文章來源:教育新聞網)

谷歌和加州大學伯克利分校的研究人員在本周在預印本服務器Arxiv.org上發表的兩篇論文中描述了新的AI和機器學習技術,這些技術使機器人能夠適應從未見過的任務并抓住被遮擋的物體。第一項研究詳細介紹了X射線,該算法在部署到機器人上時可以搜索對象的堆以掌握目標對象,而第二項研究則提出了一種策略適應技術,可以“教”機器人技能,而無需從頭開始進行模型訓練。

抓機器人是一個非常困難的挑戰。例如,機器人努力執行所謂的“機械搜索”,即當他們不得不從一堆其他對象中識別并拾取一個對象時。大多數機器人不是特別適應性強,并且缺乏足夠功能強大的AI模型來指導機械手進行機械搜索。X射線和策略調整步驟可以構成產品包裝系統的基礎,該產品包裝系統可以在無需人工監督的情況下發現,拾取和放下各種物體。

有關X射線的研究的合著者指出,由于缺乏合適的模型,機械搜索(在大量對象中找到對象)仍然具有挑戰性。X射線結合了遮擋推斷和假設預測來解決該問題,它可用來估計與對象最相似的邊界框(對象周圍矩形邊框的坐標)的占用率分布,同時考慮各種平移和旋轉。

X-Ray假定堆中至少有一個完全或部分被未知對象遮擋的目標對象,并且每個時間步最多可以抓取一個對象。以RGB圖像和目標對象為輸入,它可以預測場景的占用率分布和分割蒙版,并計算幾種潛在的抓握動作,以最高的成功概率執行該動作。為了訓練和驗證X射線,研究人員生成了10,000個增強深度圖像的語料庫,這些圖像標記有矩形框目標對象的對象占用分布。他們從Thingiverse上的1296個3D CAD模型的開放源數據集中進行采樣,選擇了10個大小相同,體積較小但厚度較小的盒子目標,因此它們更有可能被遮擋。這使他們總共獲得了100,000張圖像。

在這10,000張圖片中,約有8,000張被保留用于培訓,其余的則留作測試。使用一千個包含模擬對象(蓋子,多米諾骨牌和長笛)的其他圖像來評估X射線對看不見的形狀,對象,長寬比和比例尺的概括。在涉及帶有吸盤和平行顎式抓爪的真實ABB YuMi機器人的物理實驗中,研究人員要求X射線將物體裝滿垃圾箱,然后將垃圾箱傾倒在目標物體的頂部。在最初包含25個對象的堆中,系統在20次試驗中以5個動作的中位數提取了目標對象,成功率為100%。

合著者將精力放在未來的工作上,以提高X射線的訓練效率,并分析數據集大小以及用于生成訓練分布的平移和旋轉次數的影響。他們還計劃根據目標對象可見性的獎勵來探索強化學習策略。

在這兩篇論文的最新文章中,合著者試圖開發一種能夠不斷適應新的現實環境,物體和條件的系統。與大多數機器人相反,后者僅需訓練一次即可部署,而適應能力卻很少。研究人員對機器學習模型進行了預訓練,以在608,000次嘗試抓取的語料庫中抓取一系列對象,然后他們執行的任務是使用向其起始位置右移10厘米的抓手抓取對象。系統練習了一段時間(經過800次嘗試)并將這些嘗試記錄到新數據集(目標數據集)中之后,新嘗試在50%的時間內與原始數據集進行了混合,調整模型。

在五個不同的場景中重復了這些步驟-預訓練,嘗試新任務和微調。一方面,刺眼的光線阻礙了機器人的攝像頭。在另一種情況下,棋盤圖案的背景使模型難以識別對象。最后,實驗人員讓機器人抓住訓練中看不到的透明瓶子(眾所周知,透明物體很難抓住機器人,因為它們有時會混淆深度傳感器),并撿拾坐在高反射金屬板上的物體。

研究人員報告說,在實驗中,該模型成功地在苛刻的燈光下63%的時間,透明瓶子的74%的時間,棋盤墊板的時間的86%的時間,抓手擴展的88%的時間成功地捕獲了物體,和91%的時間使用偏置夾持器。而且,他們說,機器人適應新情況只需要花費1-4個小時的練習時間(相比之下,學習如何掌握的時間大約為6,000個小時),并且性能不會隨著所適應的模型而降低。

(責任編輯:fqj)

-

谷歌

+關注

關注

27文章

6161瀏覽量

105303 -

AI

+關注

關注

87文章

30728瀏覽量

268887

發布評論請先 登錄

相關推薦

【「具身智能機器人系統」閱讀體驗】+初品的體驗

《具身智能機器人系統》第1-6章閱讀心得之具身智能機器人系統背景知識與基礎模塊

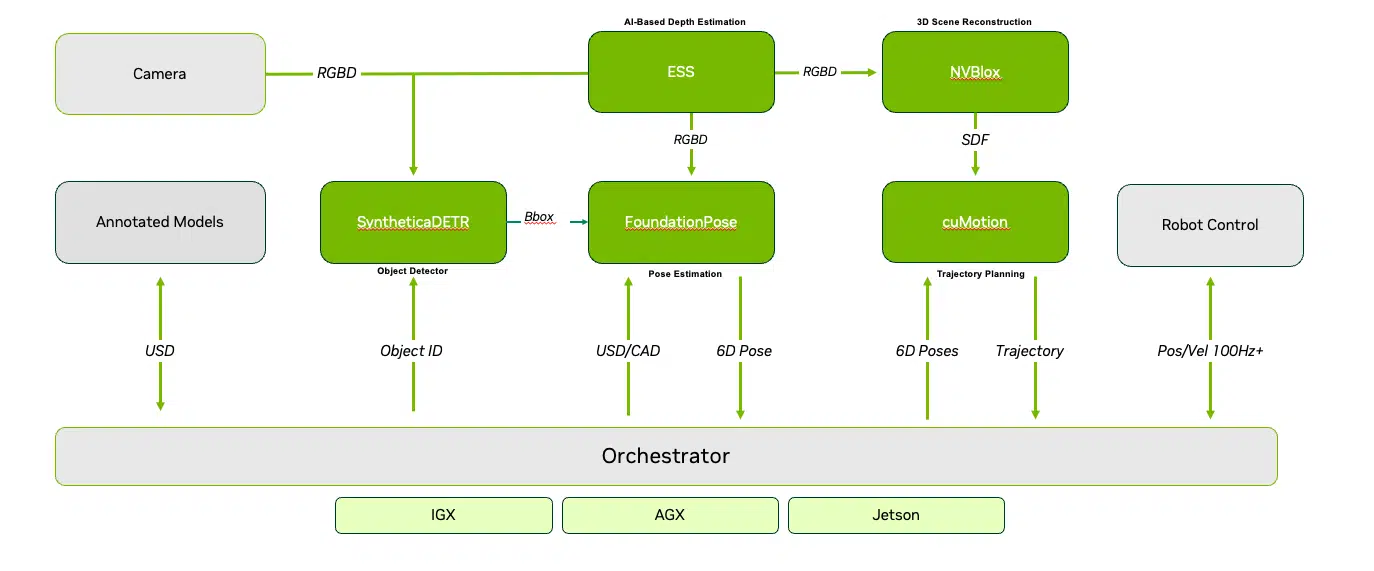

NVIDIA通過加速AWS上的機器人仿真推進物理AI的發展

【書籍評測活動NO.51】具身智能機器人系統 | 了解AI的下一個浪潮!

NVIDIA發布全新AI和仿真工具以及工作流

麻省理工學院推出新型機器人訓練模型

Google Cloud AI助力衛安智能推出機器人解決方案

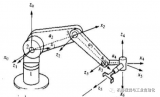

機器人的三大矩陣是什么及關系式

“卷不動了”?OTA來救場!智能機器人“永葆青春”的秘訣

Al大模型機器人

NVIDIA Isaac 機器人平臺利用最新的生成式 AI 和先進的仿真技術,加速 AI 機器人技術的發展

NVIDIA Isaac機器人平臺升級,加速AI機器人技術革新

機器人學習中主流智能抓取方案

Google的AI教會機器人學會了新的技能

Google的AI教會機器人學會了新的技能

評論