在5G·AR(增強現實)技術應用高峰論壇上,VR陀螺主編案山子以“蘋果在AR上的布局和戰略解讀”為主題發表了演講。在演講中,案山子對蘋果AR眼鏡形態發展作出了個人的分析:產品形態為以MicroLED+光波導為光學方案,加以3D空間聲場音頻和6DOF+眼動追蹤的無線分體式手機AR;當MicroLED及全息顯示成熟之后,未來,手勢識別將加入感知互動方式中,產品形態主要為一體式AR眼鏡。基于對蘋果AR產業鏈布局結構、在AR/VR領域的投資收購、硬件的核心器件和感知交互、軟件生態、內容以及應用生態的深度剖析,案山子總結蘋果產品思維具有“優化整合、追求極致、自建生態”的特點。

以下是演講實錄。

案山子:

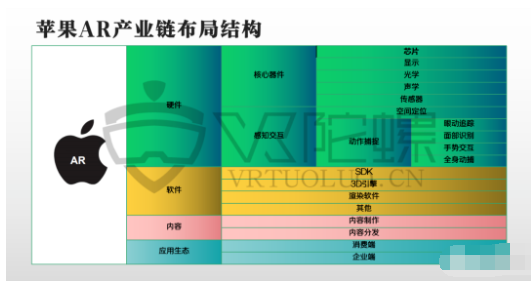

大家好,我是VR陀螺的主編案山子。蘋果會有什么產品出來是大家關心的話題。從蘋果現有的產業鏈布局來看,可以看到蘋果從硬件、軟件、內容、應用生態等各個層面都有它的布局。

蘋果的AR產業鏈布局

從整體上看,核心器件包括芯片、顯示光學聲學、傳感器,全部都已經有企業研發,甚至有產品出來;感知交互包括空間定位和動作捕捉,蘋果都有了相應的應用。軟件方面更多從工具上進行布局,包括SDK 3D引擎渲染軟件,以及其他輔助性軟件。內容制作上,蘋果2017年推出ARKit,這樣做的意義表現在了讓原來手游、app開發者加入了AR開發陣容中來。中游的內容分發集中在app store,而下游的應用生態集中在消費端和企業端。其中值得注意的是,iPhone使用中的面部追蹤和識別,現在目前推出的是人臉解鎖,實際上同時應用了眼動追蹤,如果眼睛不看向屏幕的話是不會解鎖的。

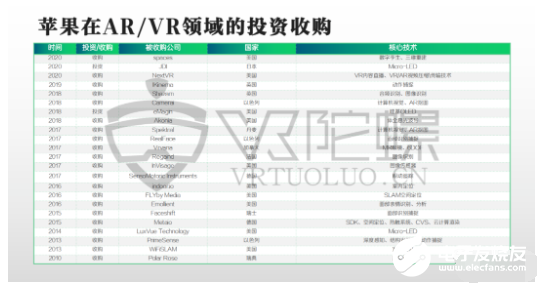

通過對蘋果在AR/VR領域的投資收購的整體分析,直觀上可以看到其實收購的并不多,大部分以收購形式進行都是底層公司。早些時候,從硬件底層來布局,比如2010收購面部識別硬件技術公司Polar Rose;到了近期,包括蘋果前陣子收購的NextVR等公司,是屬于內容端,收購的方向偏表層而且收購時間相對來說比較晚。

核心硬件技術:儲備、收購和開發

從硬件上來看,蘋果在核心器件上主要推仿生芯片,今年是A11仿生芯片,并且首次在手機端實現了ARKit功能。ARKit最早只能實現平面識別,環境和空間感知沒那么強,后來平面、側面識別和肢體手勢結合,可以實現人體骨骼動作,雖然沒有光學動捕那么深度,但現在已經能夠做到基礎交互了。

另一個核心芯片包含了UWB超寬頻芯片,這是一個無線傳輸技術,從A11開始采用。與藍牙相比,傳輸速度快了幾百倍(藍牙只能1m/s)。高效傳播速率、高精度定位、傳輸距離適中、低能耗是UWB超寬頻芯片的優勢,但使用者需對網絡重新進行部署,并且需要使用專用的信號測量設備,劣勢在于實現成本較高。

關于顯示屏。蘋果目前儲備Micro-LED技術,其中有潛力的是全息波導光學方案,而且收購的大部分是Micro-LED的企業。但技術難題是Micro-LED還沒有量產出來,全息眼鏡基本沒有量產的產品。說到屏幕的基本參數,從L-COS、DLP、硅基OLE,到Micro-LE,差異挺大的,可以看出Micro-LED優勢明顯,亮度上能達到100,000nit(全彩) 10,000,000nit(藍/綠)的量級。

2018年收購的光波導企業AKONIA,是蘋果在全息光波導上布局的一個重要企業。AKONIA的創始科學家都是貝爾實驗室全息技術研發團隊的核心成員,公司擁有原型設計和制造設備,以及200多項與全息系統和材料相關的專利。目前蘋果獲得美國專利局審批通過的光波導領域專利共有 5份;外媒和內媒等多方消息報道稱蘋果在與國內代工廠商試生產光波導鏡片等。雖然專利很多,但并不能代表蘋果完全生產出來,只能說明未來的技術路徑將會沿著這個方向走。

在聲學布局上,同步的視覺和聽覺沉浸感是真正實現虛擬現實體驗的關鍵。蘋果的全景聲效果采用了可追蹤定位的空間聲場技術,其Air pods產品融合追蹤定位的空間聲場技術,將為蘋果未來的AR眼鏡奠定音頻技術基礎,以保證全沉浸,并能夠跨設備無縫切換,實現空間音頻全景聲效果。其中的技術復雜度完全不亞于一臺iPhone手機。

在傳感器方面,蘋果于2013年收購了3D傳感器Prime Sense。3D傳感器用在人體動作捕捉、近距離的環境識別中,蘋果的Animoji也是用到這個技術。收購圖像傳感器廠商InViage,是Ar/Vr布局的一環。今年的蘋果發布會上,蘋果ipad pro有搭載 iphone逐步搭載TOF傳感器,不僅是簡單的環境識別,而是有深度的識別,能夠與虛擬物體進行交互,這對于實現混合現實很有利。

蘋果的技術儲備深厚,功能也逐漸上線了。眼動追蹤技術已應用于Face ID,面部識別比較成熟,手勢交互尚未落地使用,ARKit已支持動作捕捉功能。

軟件:AR軟件生態逐步完善

2017-2020年,ARKit軟件在三年內的升級迭代,總體上保持著一年一個迭代的節奏。值得注意的是,在2017年時候推出SDK,18年就推出了.usdz文件格式和AR Quick Look模型預覽工具。我們認為,.usdz是在AR時代定義AR文件格式的重要標志,像我們現在安卓app是.apk,ios是.ipa。2019年上線ARKit 3.0 Reality Kit(AR渲染平臺)以及Real it y Composer(3D開發工具),幫助開發者更快建模。后續上線的Reality Converter(AR格式轉換工具),也是幫助開發者更簡單地進行AR開發。ARKit的功能無論是環境識別還是人臉識別等方面,都需要大量的數據以達到更精準識別的效果。

蘋果AR軟件技術生態,說明蘋果的AR生產閉環已經形成了。App Clips或是AR眼鏡的app形態。像我們現在的東西是越來越輕的,未來到云端已是個趨勢,只是現在的5G或者5G手機還未普及。用這個技術的話讓你無需下載完整的應用就能與之互動,程序容量十分小。而App Clips程序體量小,如果功耗很大的話對設備是一個負擔,運算量小、可多渠道訪問的App Clips,是AR眼鏡的完美搭檔。

蘋果底層的鏈條布置完善,這兩年開始有內容生態上的動作。收購VR/AR直播企業Next VR、收購虛擬現實初創公司Spaces、Apple TV+流媒體視頻服務中增加VR/AR內容,在我們看來也是內容生態上重要的一步。

目前還沒有ios AR app最新的數據。從這幾年來看,App store的AR應用的量并不大,相比傳統手游,有一定局限性,但最火的AR app《Pokémon GO》全球銷量達30億美元。陸續出現的Niantic大規模的融資、哈利波特IP的AR游戲、任天堂的馬里奧AR,說明在賽道上的大家還蠻有興趣的。除此之外,蘋果在傳統游戲市場的關注度增高,內容產品主要針對C端市場。

蘋果的AR產品形態分析

蘋果產品思維:優化整合、追求極致、自建生態。我們認為,特點一:無線。把AR眼鏡作為與手機或類似iwatch手表的定位裝置,計算單元有可能是獨立的芯片。像目前部分AR眼鏡通過可穿戴的芯片進行計算,雖然計算性能不算高,但是在前期并不要求AR眼鏡實現非常酷炫的游戲效果,只要求其做到像手機在抬頭顯示時的顯示效果,或者其他輕度的交互,可以讓用戶先體驗到AR帶來的不同的特性,或習慣新的交互方式。特點二:無接口。無線傳輸十分成熟,很大可能可以用在AR眼鏡上,甚至可能在iPhone13之后會沒有接口。目前無線充電、藍牙耳機都已經很成熟了,按照蘋果的風格來看,他們并不是使用最新的東西,而是把現有的、成熟的技術用在產品生態上,這樣能帶來成熟的體驗,也能避免經常產生bug的情況。最后,蘋果目前還是自建閉環生態。

眼鏡形態的猜測,前期是分體式的(可穿戴式設備),當Micro-LED及全息顯示成熟之后,會做一體式的產品形態。前期偏輕便一些的抬頭顯示,以后戴上眼鏡后一抬頭就能看到手機上面的東西,至少對人體健康有意義。

責編AJX

-

蘋果

+關注

關注

61文章

24395瀏覽量

198561 -

Ar

+關注

關注

24文章

5095瀏覽量

169472 -

硬件

+關注

關注

11文章

3312瀏覽量

66201

發布評論請先 登錄

相關推薦

今日看點丨消息稱臺積電 2nm 芯片生產良率達 60% ;小米在調研是否兼容蘋果硬件

華秋電子 | 電子發燒友亮相OpenHarmony人才生態大會2024

OpenHarmony人才生態大會南向生態社區發展論壇在武漢圓滿舉辦

蘋果在中國布局顯示器研發,力推供應鏈多元化

蘋果布局未來AI戰略,Apple Intelligence引領智能新紀元

蘋果在深圳興建的研究實驗室將于本月底正式運營

蘋果AR眼鏡:技術突破引領未來視覺體驗新紀元

新火種AI|蘋果終于邁進了AI時代,是創新還是救贖?

蘋果市值蒸發逾3000億美元 蘋果在AI上的落后或是導火線

2024蘋果全面推進布局AI,Meta/微美全息AIGC戰略投資潛力持續釋放

OPPO發布1+N智能體生態戰略

佳禾智能加快AR/VR/MR領域戰略布局

多層面深度分析【HarmonyOS NEXT】開發者內容

從硬件、軟件、應用生態等多層面解讀蘋果在AR上的布局和戰略

從硬件、軟件、應用生態等多層面解讀蘋果在AR上的布局和戰略

評論