人工智能已經成為每個人生活中不可或缺的一部分。 從YouTube建議之類的簡單任務到諸如生成可治愈疾病的藥物之類的復雜的救生任務,它已經無處不在。 它以比我們意識到的更多的方式影響著我們的生活。

但是,人工智能公平嗎? 不,絕對不是。

定義一個公平的AI很難。 這是我能想到的最好的解釋。 如果輸出獨立于已經受到社會歧視影響的特定任務的敏感參數(例如性別,種族,性別,宗教信仰,殘疾等),則給定的AI模型是公平的。

在此文章中,我將撰寫有關AI偏差,AI偏差的現實示例以及解決方法的文章。

問題

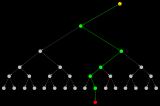

AI偏差是由于用于訓練模型的數據固有的偏見引起的,從而導致社會歧視。 這導致缺乏平等機會。

例如,假設我的任務是創建一個模型,以位置為參數來計算一個人的信用評分。 某些種族集中在某些地方。 這將使我的模型在種族上偏向那些種族群體,從而在獲得信用卡和銀行貸款時影響他們。

偏愛的AI模型加劇了當前的社會歧視,并為壓迫鋪平了道路。

現實生活中AI偏見的例子

這是AI偏見的一些現實例子:

COMPAS:COMPAS(替代性制裁的更正罪犯管理分析)是美國法院用來判斷被告(被控犯罪的人)成為累犯(重犯先前犯罪的行為)的軟件。 由于數據的嚴重偏差,該模型預測的黑人違犯累犯率是白人的兩倍。

亞馬遜的招聘:2014年,亞馬遜開發了一個AI招聘系統,以簡化其招聘流程。 由于用于訓練模型的數據來自過去10年,由于技術行業中男性占主導地位,因此大多數被選為男性的申請人被發現具有歧視性。 亞馬遜在2018年取消了該系統。

美國醫療保健:美國醫療保健系統使用的AI模型為黑人分配的相同疾病發病率低于白人。 這是因為該模型針對成本進行了優化,并且由于人們認為黑人支付能力較差,因此該模型將其健康風險等級低于白人。 這導致黑人的醫療保健標準降低。

Twitter圖像裁剪:2020年9月,Twitter用戶發現圖像裁剪算法更喜歡白臉而不是黑臉。 即,當將寬高比與預覽窗口不同的圖像發布到Twitter時,該算法會裁剪圖像的一部分,并僅顯示圖像的特定部分作為預覽。 這種AI模型經常在預覽窗口中以白色和黑色面孔顯示白色面孔。

Facebook的廣告算法:2019年,Facebook允許廣告商根據種族,性別和宗教信仰來定位人群。 這導致護理和秘書等工作針對女性,而看門人和出租車司機等工作針對男性,尤其是有色男人。 該模型還了解到,向白人展示房地產廣告時,其點擊率更高,從而導致向少數群體提供房地產廣告的情況有所減少。

這些只是AI偏見的一些常見示例。 無論是否有開發人員的知識,都有許多不公平的AI做法實例。

那么如何解決?

邁向公平AI的第一步就是承認這個問題。 人工智能是不完美的。 數據不完美。 我們的算法不完善。 我們的技術不完善。 假裝沒有問題,就不可能找到解決方案。

其次,問問自己這個解決方案是否需要AI。

存在一些不依賴于數據的問題。 諸如發現被告再犯的可能性之類的任務更多地取決于情感而不是數據。

第三,遵循負責任的AI實踐。 我在下面添加了Google負責任的AI實踐指南中的要點。

負責任的AI實踐:

使用以人為本的設計方法:內置適當披露的設計模型,并在部署之前合并測試人員的反饋。

確定多個度量標準以評估培訓和監視:使用適合任務的不同度量標準,以了解不同錯誤和經驗之間的權衡。 這些指標可以是來自消費者的反饋,誤報率和誤報率等。

如有可能,請檢查您的原始數據:AI模型反映了用于訓練模型的數據。 如果數據有問題,則模型也將有問題。 嘗試獲得平衡的數據。

了解模型的局限性:經過訓練可檢測相關性的模型不一定有助于建立因果關系。 例如,一個模型可能會得知購買籃球鞋的人通常平均會更高,但這并不意味著購買籃球鞋的用戶會因此變高。

測試:進行嚴格的單元測試以確定模型中的故障。

部署后繼續監視和更新模型:考慮用戶反饋,并在部署后根據此模型定期更新模型。

設計一個具有公平性和包容性具體目標的模型:與來自倫理學和社會研究領域的專家合作,以理解和解釋各種觀點。 嘗試使您的模型盡可能公平。

使用代表性的數據集來訓練和測試模型:嘗試評估數據的公平性。 即,尋找特征和標簽之間的偏見或歧視性關聯。

檢查是否存在不公正的偏見:從不同背景的測試人員那里獲得單元測試輸入。 這可以幫助確定該模型可能影響的人群。

分析效果:考慮不同的指標。 一個指標的改進可能會損害另一個指標的性能。

開發公平AI的工具

FATE:Microsoft提供的AI中的公平性,問責制,透明度和道德規范(FATE),由Microsoft提供評估可視化儀表板和緩解偏差算法的工具。 它主要用于比較系統的公平性和性能之間的權衡。

AI Fairness 360:AI Fairness 360是IBM提供的一個開源工具包,可幫助您檢查,報告和減輕機器學習模型中的歧視和偏見。

ML Fairness Gym:ML Fairness Gym是Google提供的一種工具,用于探索機器學習系統對AI偏見的長期影響。

結論

在過去的幾年中,公司和政府已經開始認真對待AI偏見。 許多公司已經開發了評估AI公平性的工具,并且正在竭盡全力對抗AI偏見。 盡管AI具有巨大的潛力,但對我們而言,現在要比以往任何時候都更加重要,要牢記AI系統的潛在歧視性危險并幫助開發公平的AI模型。

責編AJX

-

AI

+關注

關注

87文章

31042瀏覽量

269391 -

人工智能

+關注

關注

1792文章

47377瀏覽量

238882 -

模型

+關注

關注

1文章

3255瀏覽量

48905

發布評論請先 登錄

相關推薦

嵌入式和人工智能究竟是什么關系?

《AI for Science:人工智能驅動科學創新》第6章人AI與能源科學讀后感

AI for Science:人工智能驅動科學創新》第4章-AI與生命科學讀后感

《AI for Science:人工智能驅動科學創新》第一章人工智能驅動的科學創新學習心得

risc-v在人工智能圖像處理應用前景分析

人工智能ai4s試讀申請

名單公布!【書籍評測活動NO.44】AI for Science:人工智能驅動科學創新

報名開啟!深圳(國際)通用人工智能大會將啟幕,國內外大咖齊聚話AI

FPGA在人工智能中的應用有哪些?

5G智能物聯網課程之Aidlux下人工智能開發(SC171開發套件V2)

5G智能物聯網課程之Aidlux下人工智能開發(SC171開發套件V1)

嵌入式人工智能的就業方向有哪些?

人工智能在兵棋推演中的應用案例分享

為什么人工智能總是有缺陷,不能做到公平?

為什么人工智能總是有缺陷,不能做到公平?

評論