立體視覺處理是將世界從2D平面轉(zhuǎn)換為全3D環(huán)境,不僅提供了更豐富、更密集的目標(biāo)場(chǎng)景表示,還允許感測(cè)系統(tǒng)在未經(jīng)訓(xùn)練的情況下識(shí)別一般障礙物,使倉(cāng)庫(kù)機(jī)器人、自動(dòng)駕駛車輛等的導(dǎo)航更安全、更有效。

激光雷達(dá)(LiDAR)的競(jìng)爭(zhēng)者來了,本不是什么顛覆性技術(shù),但分辨率提升15倍,成本卻與便宜的固態(tài)LiDAR相仿;埃隆·馬斯克為其點(diǎn)贊,特斯拉也開始搭載,不過好像還沒有玩轉(zhuǎn)。要說真正量產(chǎn)搭載的還是傳統(tǒng)意義上的豪車:奔馳S級(jí)和E級(jí)、寶馬7系和5系、雷克薩斯LS、路虎Discovery Sport SUV、捷豹XFL、XE等。

從特斯拉的攝像頭說起

特斯拉的全電動(dòng)汽車以攝像頭數(shù)量多而聞名,其8個(gè)攝像頭主要用于崗哨模式(Sentry Mode),還有一個(gè)TeslaCam用作行車記錄儀。通常人們沒有注意的是,特斯拉在Model 3和Model Y中配備了第九個(gè)攝像頭,就在后視鏡上方,用來監(jiān)測(cè)車內(nèi)情況。

前不久,美國(guó)的Model 3車主Erik Martin曾見過一輛路測(cè)的Semi原型卡車,說它配備了26個(gè)攝像頭。事實(shí)上,量產(chǎn)版Semi車型最多也就配備10個(gè)攝像頭。

早在2016年,在Model S上測(cè)試的特斯拉Autopilot 2.0(AP)硬件就“在駕駛員側(cè)安裝了某種雙目攝像頭,看起來像一副小望遠(yuǎn)鏡。”

值得注意的是,特斯拉Model 3前視已搭載三個(gè)基于安森美半導(dǎo)體CMOS圖像傳感器的三目攝像頭(魚眼、中焦和長(zhǎng)焦)模塊,用三個(gè)不同焦距攝像頭覆蓋不同范圍場(chǎng)景,以解決攝像頭無法來回切換焦距的問題,通過立體視覺技術(shù)實(shí)現(xiàn)3D成像。

提供各類立體視覺解決方案的北京中科慧眼銷售總監(jiān)崔凱表示:“對(duì)于高級(jí)輔助駕駛系統(tǒng)(ADAS)單目就夠用,還便宜,而自動(dòng)駕駛更需要多傳感器融合。單目有一種配置叫三目,即單種焦距的單目,可以實(shí)現(xiàn)近距離寬視角和遠(yuǎn)距離的全覆蓋。但如果是三焦雙目就有很高的算力要求,開發(fā)難度很大。”

這話在特斯拉身上得到了應(yīng)驗(yàn),根據(jù)國(guó)外車友測(cè)試,發(fā)現(xiàn)搭載Autopilot 2.5硬件的Model 3,在開啟AP后,前置三目攝像頭中只有一個(gè)主攝像頭在工作,而長(zhǎng)焦和魚眼攝像頭都處于關(guān)閉狀態(tài)。

另外,去年年初國(guó)產(chǎn)特斯拉被暗中減配,混裝了HW2.5和HW3.0,后者是特斯拉自己專門為FSD打造的新計(jì)算平臺(tái),據(jù)稱其圖像處理能力是HW2.5的21倍,計(jì)算能力提升了大約7倍。但特斯拉中國(guó)卻表示:現(xiàn)階段如果沒有選裝FSD功能,使用HW2.5的Model 3車型與HW3.0的Model 3車型在駕乘體驗(yàn)和使用安全上“基本不存在區(qū)別”。由此可見,現(xiàn)在的三目攝像頭還是受制于算力。

的確有車主發(fā)現(xiàn),行車記錄儀拍下來的視頻中,除了正前方的視頻較為清晰外,其他角度的視頻都比較模糊。原因就在于HW2.5(自動(dòng)駕駛芯片)硬件算力不足,只有前置主攝像頭支持全分辨率輸出,剩下的5個(gè)攝像頭全部降低了分辨率輸出。這樣,想要實(shí)現(xiàn)對(duì)側(cè)前方、后方大量車輛的識(shí)別非常難。這也AP在面對(duì)側(cè)前方車輛加塞并線時(shí)反應(yīng)沒有那么靈敏的一個(gè)原因。

如果真是那樣,特斯拉的視覺還是2D的,想象一下八個(gè)攝像頭同時(shí)處理要消耗多少GPU資源。結(jié)果可想而知,還而知了不少。

有專業(yè)人士分析說,特斯拉方案的問題在于,其方案主要依靠視覺,所以環(huán)境感知3D重建是基于2D的。2D轉(zhuǎn)換為3D,必然要丟失信息。通過看實(shí)際視頻,發(fā)現(xiàn)特斯拉對(duì)遠(yuǎn)處物體有誤識(shí)別的情況,特別是有穿著黑衣服的行人在晚上突然過馬路時(shí)。毫米波雷達(dá)不是看人的,超聲波距離不夠,視覺兩眼一抹黑,這不就是視覺欺騙嗎?

剛剛的國(guó)產(chǎn)Model Y試駕所見,其內(nèi)后視鏡背面空空如也,并沒有搭載之前Model 3曾有的三目攝像頭。

我們還是先看看什么是立體視覺(StereoVision)技術(shù)吧。

原理并不復(fù)雜

早在1838年,物理學(xué)家惠斯登(Wheaston)發(fā)明了實(shí)體鏡,讓人們第一次知曉了立體視覺這一全新的深度知覺現(xiàn)象。1861年,美國(guó)人史高維(Scoville)利用兩個(gè)鏡頭仿照人體兩眼前的距離同時(shí)拍攝,發(fā)明了早期的立體攝影。其仿生的就是人眼三角測(cè)距。

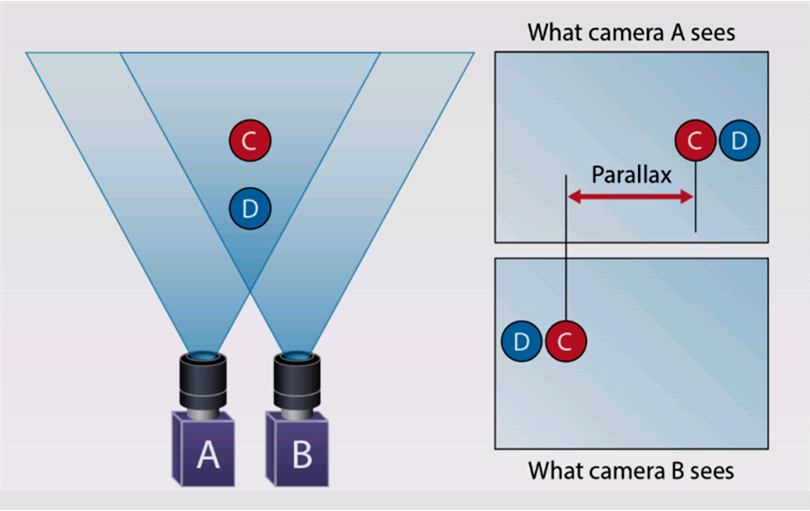

立體視覺是計(jì)算機(jī)視覺的一個(gè)重要模塊。人類之所以能看到各種物體,得益于我們的視覺系統(tǒng)。在發(fā)現(xiàn)了單目系統(tǒng)的缺陷之后,從一個(gè)攝像頭增加到兩個(gè)攝像頭,就構(gòu)成了一個(gè)立體系統(tǒng)。如果可以在兩幅圖像中找到對(duì)應(yīng)點(diǎn),就可以通過三角測(cè)量的方法來求得深度。

基于此,人們發(fā)明了用來測(cè)量距離的雙目攝像頭。近年來,伴隨計(jì)算機(jī)和自動(dòng)駕駛(AD)技術(shù)的發(fā)展,立體視覺已用于車輛的目標(biāo)感測(cè)和識(shí)別應(yīng)用。

立體視覺原理

立體視覺處理是將世界從2D平面轉(zhuǎn)換為全3D環(huán)境,不僅提供了更豐富、更密集的目標(biāo)場(chǎng)景表示,還允許感測(cè)系統(tǒng)在未經(jīng)訓(xùn)練的情況下識(shí)別一般障礙物,使倉(cāng)庫(kù)機(jī)器人、自動(dòng)駕駛車輛等的導(dǎo)航更安全、更有效。

早在1996年,德州儀器(TI)就在《用多個(gè)DSP實(shí)現(xiàn)快速3D視覺》的應(yīng)用報(bào)告中描述了一個(gè)具有移動(dòng)機(jī)器人引導(dǎo)和自動(dòng)車輛導(dǎo)航的立體視覺過程。

3D信息任務(wù)分配和數(shù)據(jù)傳輸

報(bào)告指出:“立體視覺過程通過在不同位置獲取兩幅圖像,并研究相應(yīng)立體點(diǎn)位置的差異來確定物體的距離。各種技術(shù)已經(jīng)發(fā)展到從一組亮度圖像推斷3D信息的階段。立體視覺的技術(shù),特別是它能夠在各種照明條件下和大深度范圍內(nèi)工作更適合測(cè)距應(yīng)用。”

自動(dòng)駕駛應(yīng)該百密而無一疏

自動(dòng)駕駛的一項(xiàng)基本任務(wù)是環(huán)境感知,即在行進(jìn)中解釋不斷變化的3D世界。車輛要使用一些方法來了解和響應(yīng)周圍環(huán)境,尤其是在運(yùn)動(dòng)中實(shí)現(xiàn)深度感知。如果路上的物體是陌生的怎么辦?也就是說,如果系統(tǒng)沒有被訓(xùn)練就去識(shí)別路上的特定障礙物就會(huì)出現(xiàn)偏差。

實(shí)現(xiàn)自動(dòng)駕駛的傳統(tǒng)方法是結(jié)合使用深度傳感技術(shù):LiDAR和雷達(dá)是最常見的(與全球定位系統(tǒng)(GPS)配合使用,再加上極其精確的地形圖)方法。對(duì)攝像頭數(shù)據(jù)進(jìn)行深度估計(jì)在業(yè)界也很流行,但是,顧名思義,這種技術(shù)提供的是距離估計(jì),而不是精確的測(cè)量。而立體攝像頭能夠精確地測(cè)量距離,為自動(dòng)駕駛應(yīng)用提供顯著的優(yōu)勢(shì)。

再看看特斯拉是怎么做的?去年,特斯拉收購(gòu)了研究高效DNN(深層神經(jīng)網(wǎng)絡(luò))的計(jì)算機(jī)視覺初創(chuàng)公司DeepScale,希望能夠沿著視覺算法這一技術(shù)路線圖,繼續(xù)推進(jìn)自動(dòng)駕駛技術(shù)的落地。之后,特斯拉Autopilot 2.0實(shí)現(xiàn)了利用攝像頭訓(xùn)練數(shù)據(jù)改進(jìn)的限速識(shí)別算法,以提高高速公路限速數(shù)據(jù)的準(zhǔn)確性。特斯拉一直在用神經(jīng)網(wǎng)絡(luò)計(jì)算機(jī)來加強(qiáng)算力,也一直在用幾個(gè)攝像頭觀測(cè)場(chǎng)景的數(shù)據(jù)來訓(xùn)練神經(jīng)網(wǎng)絡(luò)。訓(xùn)練者,難免百密而無一疏。

護(hù)欄屬于“未知物體”,失誤在所難免

致力于汽車智能化和輕量化產(chǎn)品的研發(fā)和制造保隆科技視覺產(chǎn)品總監(jiān)孫路認(rèn)為,特斯拉將增強(qiáng)型自動(dòng)駕駛輔助系統(tǒng)提供給用戶后,本地用戶便“心甘情愿”地通過眾包形式無限訓(xùn)練車輛,通過采集大量數(shù)據(jù)進(jìn)行大量訓(xùn)練,其方案結(jié)合幾何與網(wǎng)絡(luò)測(cè)距方法,適用于網(wǎng)絡(luò)調(diào)參,來增強(qiáng)模型的擬合能力,方案價(jià)格略高一些。

他指出:“但單目自身存在的問題不能完全杜絕,窮舉法不可能完全覆蓋,特斯拉仍然會(huì)出現(xiàn)一些場(chǎng)景的操控失誤風(fēng)險(xiǎn);而雙目具有一定技術(shù)門檻,不易實(shí)現(xiàn)高性能指標(biāo),行業(yè)還沒有專用芯片,目前普遍采用FPGA,工藝難度高。此外,結(jié)構(gòu)精度要求高,耐久性、一致性、溫度適應(yīng)性要求也高。需要自動(dòng)校準(zhǔn)(AA)算法、靜態(tài)標(biāo)定算法保存內(nèi)參等,投入很大。”

車用傳感器孰優(yōu)孰劣?

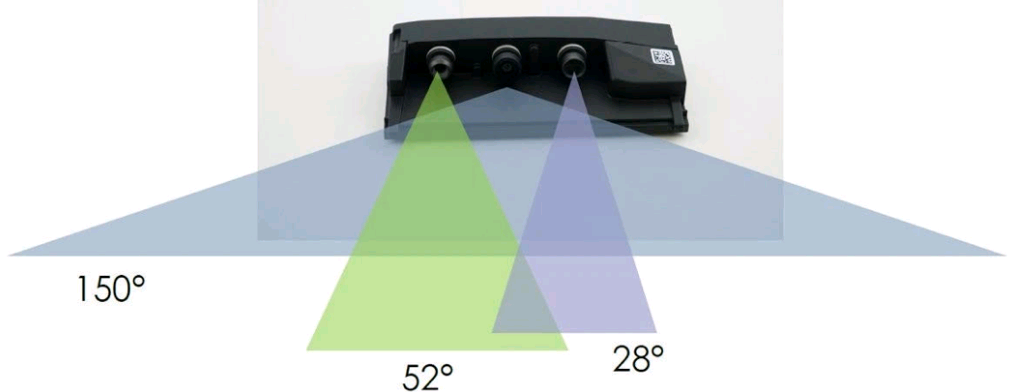

目前汽車中使用的傳感器主要是雷達(dá)、LiDAR和攝像頭,各有長(zhǎng)短,用處不同。這些傳感器協(xié)同工作,提供外部世界車輛、行人、騎自行車的人、標(biāo)志等原始數(shù)據(jù),其重疊功能會(huì)產(chǎn)生冗余(圖中顏色重疊部分),確保一個(gè)系統(tǒng)出現(xiàn)故障時(shí),另一個(gè)系統(tǒng)繼續(xù)運(yùn)行。

ADAS完整愿景將融合多種RF技術(shù)和立體視覺等傳感器,形成一個(gè)完整的360°數(shù)字處理環(huán)境

比較一下特斯拉的車載傳感器配置,距未來愿景主要是少了LiDAR,冗余也不夠,當(dāng)然未來數(shù)量還會(huì)不斷增加。

雷達(dá):只是一種成本較低而可靠的技術(shù),能夠在一定距離內(nèi)探測(cè)較大的物體,在弱光和惡劣天氣下表現(xiàn)良好,但它只適用于倒車或泊車時(shí)的安全輔助裝置,是主要感測(cè)方式的重要補(bǔ)充。由于使用無線電波而不是光來探測(cè)物體,所以雷達(dá)在雨、霧、雪和煙中都能“看”得很清楚。

LiDAR:通過測(cè)量激光信號(hào)從物體上返回到本地傳感器所需的時(shí)間來確定車輛與環(huán)境或物體之間的距離

立體視覺:它基于從相鄰的兩個(gè)視角(雙目或多目攝像頭)獲取同一環(huán)境的兩幅獨(dú)立圖像來估計(jì)距離,即視覺信息的三角測(cè)量。它是使用算法處理器對(duì)現(xiàn)實(shí)環(huán)境進(jìn)行密集的3D數(shù)字表示。

三目攝像頭示意圖

立體視覺和LiDAR都能進(jìn)行距離測(cè)量、深度估計(jì)和密集點(diǎn)云生成(即3D環(huán)境地圖)。兩者都可產(chǎn)生豐富的數(shù)據(jù)集,不僅可以用來感測(cè)物體,而且可以在高速、各種環(huán)境、長(zhǎng)距離和短距離下識(shí)別物體。作為車輛自動(dòng)駕駛的主要傳感器系統(tǒng),兩者也都可以同時(shí)部署以產(chǎn)生冗余。

因?yàn)檫@兩種感知方式都是光學(xué)技術(shù),所以與人眼一樣容易受到同樣的挑戰(zhàn):要“看到”道路,就要求有良好的視線,并且遠(yuǎn)離污垢和其他污染物。那么,兩者的利弊如何呢?

早期LiDAR優(yōu)勢(shì)明顯

不可否認(rèn),信號(hào)的數(shù)量越多,可能實(shí)現(xiàn)的距離測(cè)量數(shù)量就越多。LiDAR是通過多個(gè)旋轉(zhuǎn)(物理或通過邏輯)的激光器來實(shí)現(xiàn)的,以360度視野掃描車輛周圍環(huán)境。在自動(dòng)駕駛發(fā)展史上,LiDAR一直是一項(xiàng)重要的傳感技術(shù)。開創(chuàng)性的自動(dòng)駕駛原型依靠LiDAR實(shí)現(xiàn)了精確的距離測(cè)量、可靠性和易用性。例如,2004年開始的由美國(guó)國(guó)防部高級(jí)研究計(jì)劃局(DARPA)贊助的自動(dòng)駕駛挑戰(zhàn)賽中,大多數(shù)參賽者都依賴LiDAR技術(shù)。

LiDAR沒有辜負(fù)人們的期望,優(yōu)勢(shì)顯而易見,包括:

高精度(測(cè)量精度達(dá)到厘米級(jí))

高數(shù)據(jù)速率(機(jī)械式旋轉(zhuǎn)LiDAR每秒旋轉(zhuǎn)20轉(zhuǎn)以上)

經(jīng)驗(yàn)證穩(wěn)定可靠

感測(cè)效果不受溫度和光照的影響

盡管LiDAR有諸多優(yōu)點(diǎn),但也確實(shí)有一定的技術(shù)局限性:

在雨、霧和灰塵等惡劣天氣條件下會(huì)因反射造成誤報(bào)。專用算法處理可能解決這些問題,但比較復(fù)雜

眼睛安全條例對(duì)LiDAR的信號(hào)強(qiáng)度有所限制,使分辨率限制了視場(chǎng)和視場(chǎng)之間的距離

LiDAR測(cè)量的有效性與物體的反射率有關(guān)。如果信號(hào)遇到反射性差的障礙物,如黑色車輛,信號(hào)的能量只返回很小一部分,因此感測(cè)的可靠性會(huì)降低。幸運(yùn)的是,大多數(shù)交通參與者都有足夠的反射能力,所以LiDAR在的應(yīng)用相當(dāng)廣泛

立體視覺后來居上

在車輛自動(dòng)駕駛的早期(90年代末到21世紀(jì)初),計(jì)算機(jī)視覺科學(xué)還處于起步階段,加上半導(dǎo)體技術(shù)等因素造成的許多問題,阻礙了立體視覺作為自動(dòng)駕駛主要感測(cè)模式的采用。

這段時(shí)間,立體視覺最受詬病的問題是:

攝像頭分辨率低,遠(yuǎn)距離圖像質(zhì)量差

弱光環(huán)境下性能差

計(jì)算資源要求高(計(jì)算機(jī)視覺處理需要多臺(tái)PC機(jī))

駕駛過程中未經(jīng)校準(zhǔn)的攝像頭需要手動(dòng)調(diào)整

當(dāng)時(shí),這些問題的嚴(yán)重性足以阻礙立體視覺作為一種可行的自動(dòng)駕駛感知替代品的部署。在沒有競(jìng)爭(zhēng)者的情況下,LiDAR得以蓬勃發(fā)展。

不過,從那時(shí)起,立體視覺慢慢走上了更具吸引力的發(fā)展之路,出現(xiàn)了大逆轉(zhuǎn),目前已具備了和LiDAR競(jìng)爭(zhēng)的能力:

低成本、高分辨率攝像頭(目前為800萬像素?cái)z像頭)

適用于夜間駕駛的具有HDR(高動(dòng)態(tài)范圍圖像)和微光圖像處理功能的高級(jí)ISP(圖像信號(hào)處理

專門為實(shí)時(shí)計(jì)算機(jī)視覺處理而設(shè)計(jì)的嵌入式SoC(系統(tǒng)級(jí)芯片

自動(dòng)動(dòng)態(tài)攝像頭校準(zhǔn)

正是這些發(fā)展將立體視覺從一種小眾自動(dòng)駕駛技術(shù)變成了一種強(qiáng)有力的競(jìng)爭(zhēng)者,成為車輛自動(dòng)駕駛的主要感測(cè)方式。

為什么自動(dòng)駕駛更需要對(duì)象類型?

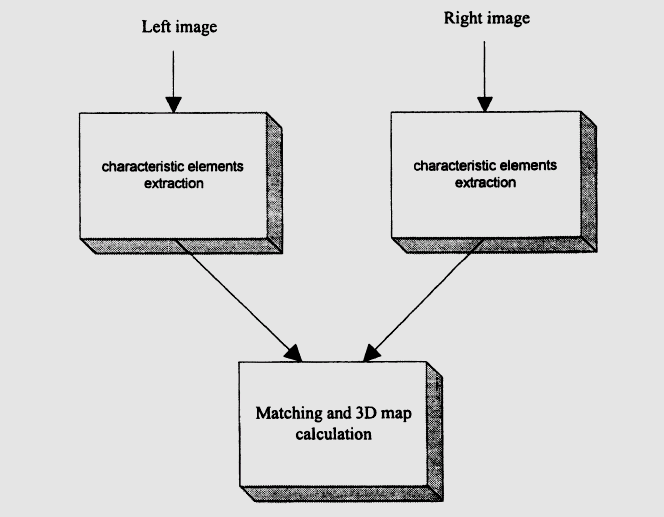

克魯日(Cluj-Napoca)技術(shù)大學(xué)的研究人員稱,密集立體視覺系統(tǒng)的一般處理流程是圖像采集、立體處理、視差到3D映射,最后是感測(cè)算法的應(yīng)用。

立體視覺硬件使用兩個(gè)攝像頭,以24fps的最大幀速率獲取一系列優(yōu)化的圖像。通過產(chǎn)生輸出函數(shù)的專用硬件板對(duì)被跟蹤圖像的進(jìn)行3D重建——可以是兩個(gè)處理后的圖像之間的視差圖或用于生成基于左攝像頭的X-Y坐標(biāo)系的Z-map。

立體視覺系統(tǒng)能夠生成兩種類型的環(huán)境數(shù)據(jù):一是基于高程(elevation)測(cè)量的復(fù)雜駕駛環(huán)境密度圖,二是由參數(shù)化車道、跟蹤長(zhǎng)方體和行人組成的一系列幾何元素。過去,傳統(tǒng)雙目攝像頭不區(qū)分對(duì)象類型,僅僅是將前方障礙物檢測(cè)或測(cè)量出來。這使其在實(shí)際應(yīng)用中存在一些問題。因?yàn)橛?jì)算元素既耗時(shí)又密集,為了根據(jù)接收到的環(huán)境數(shù)據(jù)進(jìn)行實(shí)時(shí)決策,系統(tǒng)需要大量的數(shù)據(jù)帶寬和處理能力,因此必須使用并行計(jì)算。

雖然LiDAR也是一種常用的測(cè)距技術(shù),也能夠精確地進(jìn)行3D物體感測(cè),而單目攝像頭也可以用來推斷或預(yù)測(cè)與深度相關(guān)的信息,但立體視覺在提供對(duì)3D環(huán)境的高度詳細(xì)和準(zhǔn)確的360度理解方面具有獨(dú)特優(yōu)勢(shì)。立體視覺利用兩個(gè)同步自動(dòng)校準(zhǔn)的攝像頭信息生成3D深度圖,是自動(dòng)駕駛系統(tǒng)中視覺感知、運(yùn)動(dòng)預(yù)測(cè)和路徑規(guī)劃的重要組成部分。

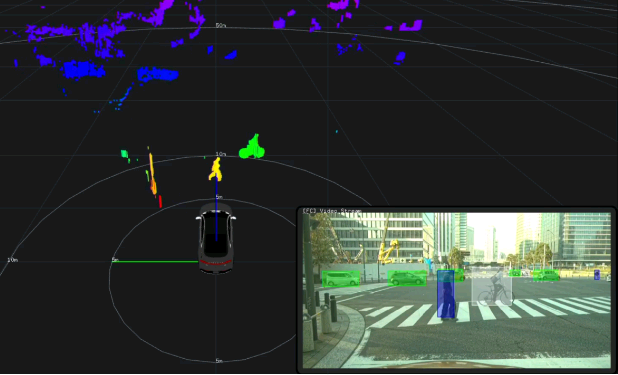

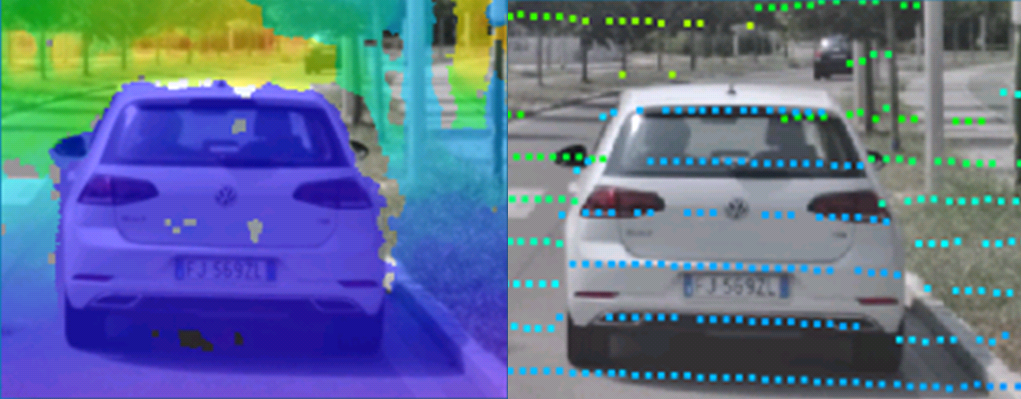

在一個(gè)城市交叉口的圖像中可以看到,包括車輛、行人、自行車和路標(biāo)、護(hù)欄等障礙物。

立體視覺視圖和嵌入圖像

將上圖中較大的立體視覺視圖與右下角的嵌入圖像進(jìn)行比較,可以清楚地區(qū)分左側(cè)的路標(biāo)、人行橫道上的行人、附近的騎車人、從左側(cè)進(jìn)入交叉口的最近的兩輛車,以及道路兩側(cè)的背景元素。立體視覺視圖中的顏色表示距離,較暖的顏色(如橙色)表示距離車輛較近,較冷的顏色(如紫色)表示距離較遠(yuǎn)。另外,小圖中3D邊界框顏色表示對(duì)象類型:車輛輪廓為綠色,行人輪廓為藍(lán)色,自行車輪廓為白色。

雖然道路場(chǎng)景很具有挑戰(zhàn)性,照明條件可能會(huì)發(fā)生很大變化,車輛、行人、自行車、碎片和其他障礙物是常態(tài),但立體視覺解決方案也能有效地在復(fù)雜環(huán)境中實(shí)現(xiàn)。以夜間駕駛為例,在黑暗中基于立體的障礙物感測(cè)(同時(shí)感測(cè)正面和負(fù)面障礙物,如坑洞)需要魯棒的深度估計(jì),包括視差有效性度量才能成功。

比如,計(jì)算機(jī)視覺芯片開發(fā)商Ambarella將短距離和長(zhǎng)距離立體攝像頭模塊的多個(gè)輸出組合在一起,通過生成密集點(diǎn)云以驚人的細(xì)節(jié)對(duì)環(huán)境可視化。其立體攝像頭生成的數(shù)據(jù)進(jìn)行了以下一些處理:

深度映射:創(chuàng)建深度映射可以感測(cè)場(chǎng)景中的一般對(duì)象(從車輛和行人到電線桿、垃圾箱、坑洞和碎片,包括其準(zhǔn)確大小、位置和距離,而無需對(duì)系統(tǒng)進(jìn)行明確訓(xùn)練

道路建模:對(duì)不同道路形狀精確建模,有助于下坡和上坡運(yùn)動(dòng)

數(shù)據(jù)融合:由于顏色相關(guān)信息與深度數(shù)據(jù)一起由同一傳感器提供,因此可以同時(shí)運(yùn)行單目算法(例如,通過卷積神經(jīng)網(wǎng)絡(luò)(CNN)進(jìn)行車道標(biāo)記或交通標(biāo)志感測(cè)),然后將此數(shù)據(jù)與深度圖融合

360度可視化:立體攝像頭可用于魚眼鏡頭的短程感知,在低速移動(dòng)時(shí)可360度查看場(chǎng)景

自動(dòng)駕駛,分辨率定輸贏

Ambarella總經(jīng)理、帕爾馬大學(xué)計(jì)算機(jī)工程教授Alberto Broggi認(rèn)為:“在當(dāng)今的自動(dòng)駕駛障礙物識(shí)別技術(shù)中,最重要的性能指標(biāo)就是分辨率,也就是圖像密度,即每秒可以提供距離測(cè)量數(shù)的多少。數(shù)值越高,汽車周圍的3D表現(xiàn)就越精確。”

一般來說,使用當(dāng)今攝像頭的立體視覺可以提供大約2000個(gè)垂直樣本/秒。LiDAR呢?才128個(gè)垂直樣本/秒,分辨率低了15倍以上。

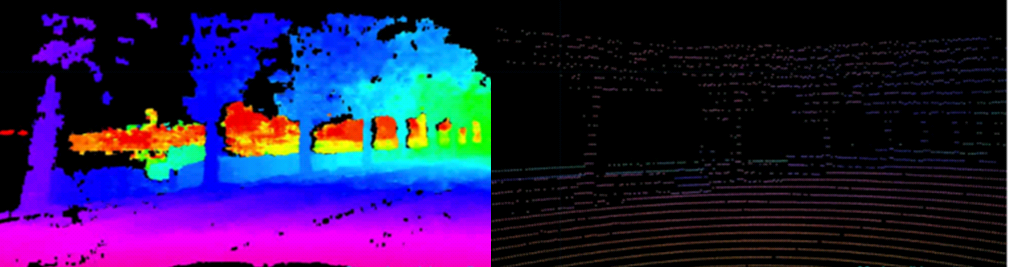

立體(上)和LiDAR(下)圖像密度比較

Broggi解釋道:“在兩幅圖像中,彩色像素表示傳感器的測(cè)量值,顏色表示每個(gè)傳感器標(biāo)度上的測(cè)量距離。我們可以看到,左側(cè)的立體解決方案提供了更大的環(huán)境覆蓋范圍,而右側(cè)的LiDAR輸出的區(qū)域覆蓋非常稀疏。”

由此可見兩者的明顯差異:立體視覺生成的數(shù)據(jù)更為豐富,從而使障礙物感測(cè)更容易。通過對(duì)上面兩張圖像的特寫對(duì)比,可以看到立體密度(左)和LiDAR密度(右)的區(qū)別。

立體和LiDAR的密度天壤之別

他指出,雖然這兩種技術(shù)都可用于自動(dòng)駕駛車輛的目標(biāo)感測(cè),但效果差異很大。上述演示發(fā)生在白天,而在弱光情況下,立體的分辨率也很高。下圖顯示了夜間駕駛時(shí)的密度對(duì)比。

夜間立體(左)和LiDAR(右)密度比較

Broggi解釋說,精度是另一個(gè)重要的衡量標(biāo)準(zhǔn),它提供的不是直接的距離測(cè)量,而是立體視覺。對(duì)于立體,距離是一個(gè)導(dǎo)出量,是通過處理兩個(gè)亮度圖像獲得的間接測(cè)量。不管怎樣,立體視覺在遠(yuǎn)距離(不強(qiáng)制要求精確測(cè)量距離)和短程(要求高精度執(zhí)行精確移動(dòng))方面都能提供自動(dòng)駕駛應(yīng)用所需的精度水平。例如,在短距離內(nèi),立體可以提供毫米級(jí)距離的感測(cè)。

除了分辨率和精度,現(xiàn)代立體視覺還有以下優(yōu)點(diǎn):

立體的一對(duì)攝像頭都可以作為獨(dú)立的單目攝像頭使用,提供內(nèi)置冗余

立體攝像頭提供的雙圖像可以在一個(gè)芯片上并行執(zhí)行單目CNN算法,如目標(biāo)分類

立體視覺提供了感測(cè)一般3D形狀的能力,即使那些沒有被歸類為已知障礙物的形狀,例如,從另一輛車上掉落的石頭、各種碎片或隨機(jī)物體(如梯子或床墊)會(huì)被立體系統(tǒng)感測(cè)到;即使是負(fù)面障礙,如坑洞,也可以準(zhǔn)確感測(cè)到

立體攝像頭相對(duì)便宜,是大容量應(yīng)用的重要考慮因素;也沒有移動(dòng)部件,可以自動(dòng)認(rèn)證,并消耗最少的電力

立體視覺以幀速率運(yùn)行(每秒30幀超高清圖像),因?yàn)榱Ⅲw引擎是硬連線到立體功能芯片,可以實(shí)現(xiàn)極高的數(shù)據(jù)率

立體攝像頭可以自動(dòng)校準(zhǔn),使兩個(gè)攝像頭的位置保持相對(duì)固定,否則測(cè)量數(shù)據(jù)將不正確

在典型駕駛條件下,振動(dòng)和沖擊是一種常態(tài),這對(duì)立體系統(tǒng)來說是一個(gè)挑戰(zhàn)。一些公司開發(fā)的實(shí)時(shí)自動(dòng)校準(zhǔn)程序可以補(bǔ)償通常在正常車輛運(yùn)行期間發(fā)生的攝像頭移動(dòng),確保立體視覺處理的精確度。

立體視覺是ADAS和AD的未來

如今,視覺感知已進(jìn)入深水區(qū),算法將決定誰是贏家。雙目的算法要求比普通單目要高,而且在車輛生命周期內(nèi)必須保持感測(cè)的穩(wěn)定性能,使兩個(gè)鏡頭保持位置相對(duì)不變才能感知準(zhǔn)確,或者采用自校準(zhǔn)能力很強(qiáng)的算法。Ambarella高級(jí)算法工程師Francesca Ghidini博士認(rèn)為,立體視覺可能是全自動(dòng)駕駛汽車的關(guān)鍵,它是互聯(lián)技術(shù)網(wǎng)格(mesh)的一部分,將為全自動(dòng)車輛鋪平道路。

崔凱認(rèn)為:“全球范圍能夠量產(chǎn)雙目的廠家也就是個(gè)位數(shù),預(yù)計(jì)L3級(jí)別以上自動(dòng)駕駛車輛采用雙目攝像頭會(huì)成為主流,而主機(jī)廠選擇雙目沒啥難度。”

孫路認(rèn)為:“感知的準(zhǔn)確性首先要提高算法的性能,同時(shí)要依賴結(jié)構(gòu)設(shè)計(jì)、產(chǎn)線設(shè)計(jì)多年積累的豐富經(jīng)驗(yàn)。主機(jī)廠采用雙目沒有難度,但由于尺寸較單目大,所以需要內(nèi)飾布置,一般不會(huì)集成到域控制器中。”

Cadence電氣工程技術(shù)專家Adrian Gibbons則表示:“過去幾年,ADAS一直在不斷發(fā)展,在現(xiàn)階段,立體視覺處理技術(shù)的下一步進(jìn)展將有助于ADAS的普及。”

責(zé)任編輯:xj

-

立體視覺

+關(guān)注

關(guān)注

0文章

36瀏覽量

9781 -

激光雷達(dá)

+關(guān)注

關(guān)注

968文章

3969瀏覽量

189830 -

LIDAR

+關(guān)注

關(guān)注

10文章

326瀏覽量

29414

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

激光雷達(dá)VS高分辨率感知雷達(dá):為更安全、更智能的汽車選擇合適的傳感器

激光雷達(dá)技術(shù)的基于深度學(xué)習(xí)的進(jìn)步

如何提升激光雷達(dá)數(shù)據(jù)的精度

激光雷達(dá)在地形測(cè)繪中的作用

物聯(lián)網(wǎng)系統(tǒng)中的自動(dòng)駕駛的“眼睛”_純固態(tài)激光雷達(dá)

激光雷達(dá)與毫米波雷達(dá)的優(yōu)缺點(diǎn)是什么

愛普生IMU產(chǎn)品在激光雷達(dá)測(cè)繪中的應(yīng)用

晶振在激光雷達(dá)系統(tǒng)中的作用有哪些

機(jī)載單光子激光雷達(dá)系統(tǒng)用于實(shí)現(xiàn)高分辨率3D成像

全固態(tài)激光雷達(dá)SPAD芯片量產(chǎn)落地!阜時(shí)科技芯片上車應(yīng)用

激光雷達(dá)分辨率對(duì)比方法與技巧詳解

Stellantis宣布投資高性能激光雷達(dá)傳感技術(shù)開發(fā)商SteerLight

激光雷達(dá)的應(yīng)用場(chǎng)景

汽車激光雷達(dá):競(jìng)爭(zhēng)格局和技術(shù)演進(jìn)

512線激光雷達(dá)還不是盡頭,1024線激光雷達(dá)早在兩年前已經(jīng)推出?

激光雷達(dá)的競(jìng)爭(zhēng)者來了,分辨率提升15倍

激光雷達(dá)的競(jìng)爭(zhēng)者來了,分辨率提升15倍

評(píng)論