在進行數(shù)據(jù)挖掘或者機器學習模型建立的時候,因為在統(tǒng)計學習中,假設(shè)數(shù)據(jù)滿足獨立同分布(i.i.d,independently and identically distributed),即當前已產(chǎn)生的數(shù)據(jù)可以對未來的數(shù)據(jù)進行推測與模擬,因此都是使用歷史數(shù)據(jù)建立模型,即使用已經(jīng)產(chǎn)生的數(shù)據(jù)去訓練,然后使用該模型去擬合未來的數(shù)據(jù)。 在我們機器學習和深度學習的訓練過程中,經(jīng)常會出現(xiàn)過擬合和欠擬合的現(xiàn)象。訓練一開始,模型通常會欠擬合,所以會對模型進行優(yōu)化,然而等到訓練到一定程度的時候,就需要解決過擬合的問題了。

一、模型訓練擬合的分類和表現(xiàn)

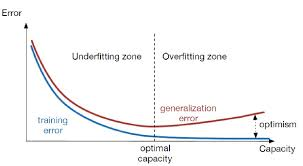

如何判斷過擬合呢?我們在訓練過程中會定義訓練誤差,驗證集誤差,測試集誤差(泛化誤差)。訓練誤差總是減少的,而泛化誤差一開始會減少,但到一定程序后不減反而增加,這時候便出現(xiàn)了過擬合的現(xiàn)象。

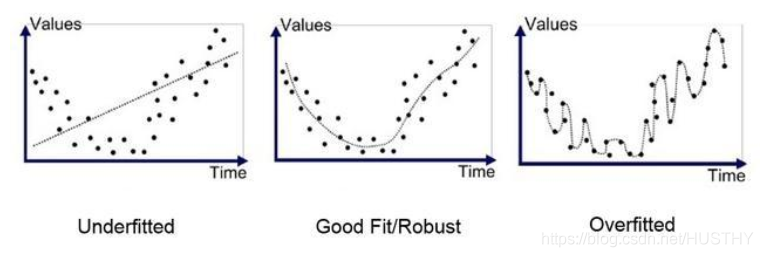

如下圖所示,從直觀上理解,欠擬合就是還沒有學習到數(shù)據(jù)的特征,還有待繼續(xù)學習,而過擬合則是學習進行的太徹底,以至于把數(shù)據(jù)的一些局部特征或者噪聲帶來的特征都給學到了,所以在進行測試的時候泛化誤差也不佳。

從方差和偏差的角度來說,欠擬合就是在訓練集上高方差、高偏差,過擬合也就是訓練集上高方差、低偏差。為了更加生動形象的表示,我們看一些經(jīng)典的圖:

對比這幾個圖,發(fā)現(xiàn)圖一的擬合并沒有把大體的規(guī)律給擬合出來,這個就是欠擬合。圖三則是擬合的太細致了,用的擬合函數(shù)太復雜了,在這些數(shù)據(jù)集上的效果很好,但是換到另外的一個數(shù)據(jù)集效果肯定可預見的不好。只有圖二是最好的,把數(shù)據(jù)的規(guī)律擬合出來了,同時在更換數(shù)據(jù)集后,效果也不會很差。

仔細想想圖片三中的模型,擬合函數(shù)肯定是一個高次函數(shù),其參數(shù)個數(shù)肯定肯定比圖二的要多,可以說圖三的擬合函數(shù)比圖二的要大,模型更加復雜。這也是過擬合的一個判斷經(jīng)驗,模型是否太復雜。另外,針對圖三,我們把一些高次變量對應的參數(shù)值變小,也就相當于把模型變簡單了。這個角度上看,可以減小參數(shù)值,也就是一般模型過擬合,參數(shù)值整體比較大。從模型復雜性來講,可以是:1、模型的參數(shù)個數(shù);2、模型的參數(shù)值的大小。個數(shù)越多,參數(shù)值越大,模型就越復雜。

二、欠擬合

1、欠擬合的表現(xiàn)

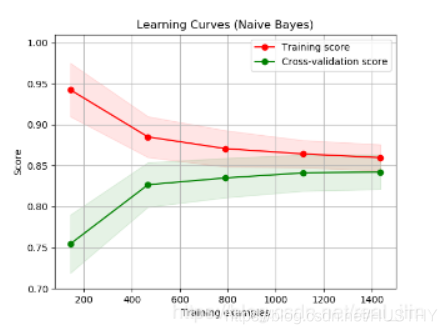

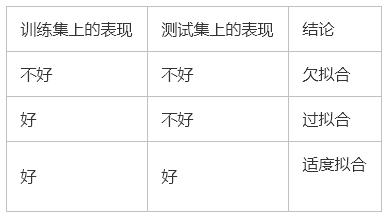

針對模型過擬合這個問題,有沒有什么方法來判定模型是否過擬合呢?其實一般都是依靠模型在訓練集和驗證集上的表現(xiàn)有一個大體的判斷就行了。如果要有一個具體的方法,可以參考機器學中,學習曲線來判斷模型是否過擬合。如下圖:

也就是看訓練集合驗證集隨著樣本數(shù)量的增加,他們之間的差值變化。如果訓練集和測試集的準確率都很低,那么說明模型欠擬合。

2、欠擬合的解決方案

欠擬合是由于學習不足,可以考慮添加特征,從數(shù)據(jù)中挖掘出更多的特征,有時候還需要對特征進行變換,使用組合特征和高次特征。

模型簡單也會導致欠擬合,例如線性模型只能擬合一次函數(shù)的數(shù)據(jù)。嘗試使用更高級的模型有助于解決欠擬合,如使用SVM,神經(jīng)網(wǎng)絡(luò)等。

正則化參數(shù)是用來防止過擬合的,出現(xiàn)欠擬合的情況就要考慮減少正則化參數(shù)。

三、過擬合

1、過擬合的定義

模型在訓練集上的表現(xiàn)很好,但在測試集和新數(shù)據(jù)上的表現(xiàn)很差。

2、過擬合的原因

1)數(shù)據(jù)量太小

這個是很容易產(chǎn)生過擬合的一個原因。設(shè)想,我們有一組數(shù)據(jù)很好的吻合3次函數(shù)的規(guī)律,現(xiàn)在我們局部的拿出了很小一部分數(shù)據(jù),用機器學習或者深度學習擬合出來的模型很大的可能性就是一個線性函數(shù),在把這個線性函數(shù)用在測試集上,效果可想而知肯定很差了。

2)訓練集和驗證集分布不一致

訓練集訓練出一個適合訓練集那樣分布的數(shù)據(jù)集,當你把模型運用到一個不一樣分布的數(shù)據(jù)集上,效果肯定大打折扣。這個是顯而易見的。

3)模型復雜度太大

在選擇模型算法的時候,首先就選定了一個復雜度很高的模型,然后數(shù)據(jù)的規(guī)律是很簡單的,復雜的模型反而就不適用了。

4)數(shù)據(jù)質(zhì)量很差

數(shù)據(jù)還有很多噪聲,模型在學習的時候,肯定也會把噪聲規(guī)律學習到,從而減小了具有一般性的規(guī)律。這個時候模型用來預測肯定效果也不好。

5)過度訓練

這個是同第4個是相聯(lián)系的,只要訓練時間足夠長,那么模型肯定就會吧一些噪聲隱含的規(guī)律學習到,這個時候降低模型的性能是顯而易見的。

3、解決方案

1)降低模型復雜度

處理過擬合的第一步就是降低模型復雜度。為了降低復雜度,我們可以簡單地移除層或者減少神經(jīng)元的數(shù)量使得網(wǎng)絡(luò)規(guī)模變小。與此同時,計算神經(jīng)網(wǎng)絡(luò)中不同層的輸入和輸出維度也十分重要。雖然移除層的數(shù)量或神經(jīng)網(wǎng)絡(luò)的規(guī)模并無通用的規(guī)定,但如果你的神經(jīng)網(wǎng)絡(luò)發(fā)生了過擬合,就嘗試縮小它的規(guī)模。

2)數(shù)據(jù)集擴增

在數(shù)據(jù)挖掘領(lǐng)域流行著這樣的一句話,“有時候往往擁有更多的數(shù)據(jù)勝過一個好的模型”。因為我們在使用訓練數(shù)據(jù)訓練模型,通過這個模型對將來的數(shù)據(jù)進行擬合,而在這之間又一個假設(shè)便是,訓練數(shù)據(jù)與將來的數(shù)據(jù)是獨立同分布的。即使用當前的訓練數(shù)據(jù)來對將來的數(shù)據(jù)進行估計與模擬,而更多的數(shù)據(jù)往往估計與模擬地更準確。因此,更多的數(shù)據(jù)有時候更優(yōu)秀。但是往往條件有限,如人力物力財力的不足,而不能收集到更多的數(shù)據(jù),如在進行分類的任務中,需要對數(shù)據(jù)進行打標,并且很多情況下都是人工得進行打標,因此一旦需要打標的數(shù)據(jù)量過多,就會導致效率低下以及可能出錯的情況。所以,往往在這時候,需要采取一些計算的方式與策略在已有的數(shù)據(jù)集上進行手腳,以得到更多的數(shù)據(jù)。

通俗得講,數(shù)據(jù)機擴增即需要得到更多的符合要求的數(shù)據(jù),即和已有的數(shù)據(jù)是獨立同分布的,或者近似獨立同分布的。

一般有以下方法:

從數(shù)據(jù)源頭采集更多數(shù)據(jù)

復制原有數(shù)據(jù)并加上隨機噪聲

重采樣

根據(jù)當前數(shù)據(jù)集估計數(shù)據(jù)分布參數(shù),使用該分布產(chǎn)生更多數(shù)據(jù)等

3)數(shù)據(jù)增強

使用數(shù)據(jù)增強可以生成多幅相似圖像。這可以幫助我們增加數(shù)據(jù)集規(guī)模從而減少過擬合。因為隨著數(shù)據(jù)量的增加,模型無法過擬合所有樣本,因此不得不進行泛化。計算機視覺領(lǐng)域通常的做法有:翻轉(zhuǎn)、平移、旋轉(zhuǎn)、縮放、改變亮度、添加噪聲等等

4)正則化

正則化方法是指在進行目標函數(shù)或代價函數(shù)優(yōu)化時,在目標函數(shù)或代價函數(shù)后面加上一個正則項,一般有L1正則與L2正則等。

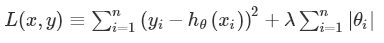

L1懲罰項的目的是使權(quán)重絕對值最小化。公式如下:

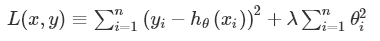

L2懲罰項的目的是使權(quán)重的平方最小化。公式如下:

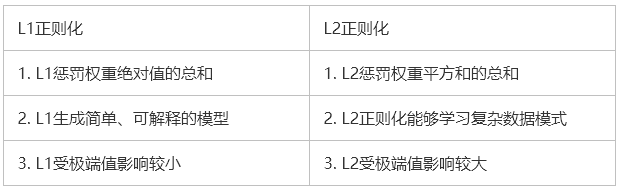

以下表格對兩種正則化方法進行了對比:

如果數(shù)據(jù)過于復雜以至于無法準確地建模,那么L2是更好的選擇,因為它能夠?qū)W習數(shù)據(jù)中呈現(xiàn)的內(nèi)在模式。而當數(shù)據(jù)足夠簡單,可以精確建模的話,L1更合適。對于我遇到的大多數(shù)計算機視覺問題,L2正則化幾乎總是可以給出更好的結(jié)果。然而L1不容易受到離群值的影響。所以正確的正則化選項取決于我們想要解決的問題。

總結(jié)

正則項是為了降低模型的復雜度,從而避免模型區(qū)過分擬合訓練數(shù)據(jù),包括噪聲與異常點(outliers)。從另一個角度上來講,正則化即是假設(shè)模型參數(shù)服從先驗概率,即為模型參數(shù)添加先驗,只是不同的正則化方式的先驗分布是不一樣的。這樣就規(guī)定了參數(shù)的分布,使得模型的復雜度降低(試想一下,限定條件多了,是不是模型的復雜度降低了呢),這樣模型對于噪聲與異常點的抗干擾性的能力增強,從而提高模型的泛化能力。還有個解釋便是,從貝葉斯學派來看:加了先驗,在數(shù)據(jù)少的時候,先驗知識可以防止過擬合;從頻率學派來看:正則項限定了參數(shù)的取值,從而提高了模型的穩(wěn)定性,而穩(wěn)定性強的模型不會過擬合,即控制模型空間。

另外一個角度,過擬合從直觀上理解便是,在對訓練數(shù)據(jù)進行擬合時,需要照顧到每個點,從而使得擬合函數(shù)波動性非常大,即方差大。在某些小區(qū)間里,函數(shù)值的變化性很劇烈,意味著函數(shù)在某些小區(qū)間里的導數(shù)值的絕對值非常大,由于自變量的值在給定的訓練數(shù)據(jù)集中的一定的,因此只有系數(shù)足夠大,才能保證導數(shù)的絕對值足夠大。

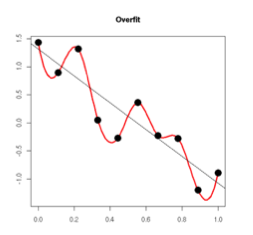

如下圖(引用知乎):

另外一個解釋,規(guī)則化項的引入,在訓練(最小化cost)的過程中,當某一維的特征所對應的權(quán)重過大時,而此時模型的預測和真實數(shù)據(jù)之間距離很小,通過規(guī)則化項就可以使整體的cost取較大的值,從而,在訓練的過程中避免了去選擇那些某一維(或幾維)特征的權(quán)重過大的情況,即過分依賴某一維(或幾維)的特征(引用知乎)。

L2與L1的區(qū)別在于,L1正則是拉普拉斯先驗,而L2正則則是高斯先驗。它們都是服從均值為0,協(xié)方差為1λ。當λ=0時,即沒有先驗)沒有正則項,則相當于先驗分布具有無窮大的協(xié)方差,那么這個先驗約束則會非常弱,模型為了擬合所有的訓練集數(shù)據(jù),參數(shù)可以變得任意大從而使得模型不穩(wěn)定,即方差大而偏差小。λ越大,標明先驗分布協(xié)方差越小,偏差越大,模型越穩(wěn)定。即,加入正則項是在偏差bias與方差variance之間做平衡tradeoff(來自知乎)。

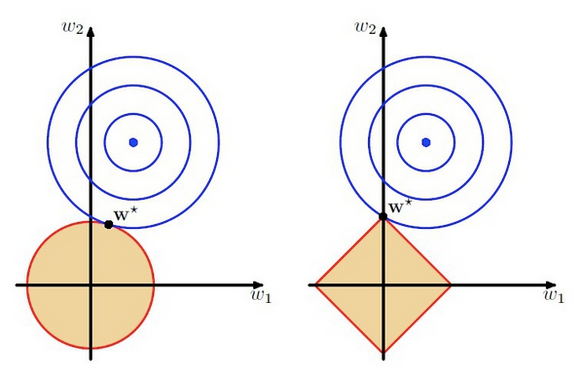

下圖即為L2與L1正則的區(qū)別:

上圖中的模型是線性回歸,有兩個特征,要優(yōu)化的參數(shù)分別是w1和w2,左圖的正則化是L2,右圖是L1。藍色線就是優(yōu)化過程中遇到的等高線,一圈代表一個目標函數(shù)值,圓心就是樣本觀測值(假設(shè)一個樣本),半徑就是誤差值,受限條件就是紅色邊界(就是正則化那部分),二者相交處,才是最優(yōu)參數(shù)。可見右邊的最優(yōu)參數(shù)只可能在坐標軸上,所以就會出現(xiàn)0權(quán)重參數(shù),使得模型稀疏。

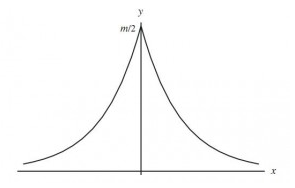

其實拉普拉斯分布與高斯分布是數(shù)學家從實驗中誤差服從什么分布研究中得來的。一般直觀上的認識是服從應該服從均值為0的對稱分布,并且誤差大的頻率低,誤差小的頻率高,因此拉普拉斯使用拉普拉斯分布對誤差的分布進行擬合,如下圖:

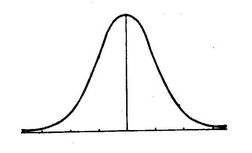

而拉普拉斯在最高點,即自變量為0處不可導,因為不便于計算,于是高斯在這基礎(chǔ)上使用高斯分布對其進行擬合,如下圖:

5)dropout

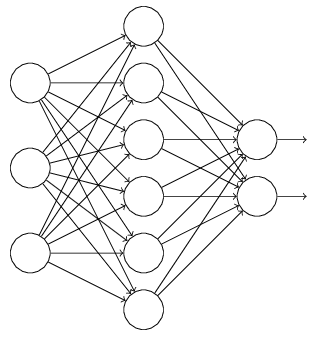

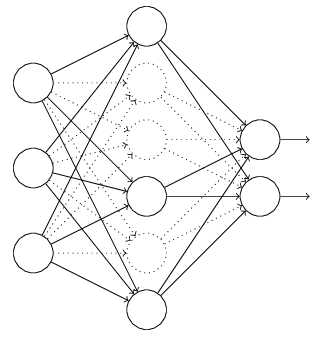

正則是通過在代價函數(shù)后面加上正則項來防止模型過擬合的。而在神經(jīng)網(wǎng)絡(luò)中,有一種方法是通過修改神經(jīng)網(wǎng)絡(luò)本身結(jié)構(gòu)來實現(xiàn)的,其名為Dropout。該方法是在對網(wǎng)絡(luò)進行訓練時用一種技巧(trick),對于如下所示的三層人工神經(jīng)網(wǎng)絡(luò):

對于上圖所示的網(wǎng)絡(luò),在訓練開始時,隨機得刪除一些(可以設(shè)定為一半,也可以為1/3,1/4等)隱藏層神經(jīng)元,即認為這些神經(jīng)元不存在,同時保持輸入層與輸出層神經(jīng)元的個數(shù)不變,這樣便得到如下的ANN:

然后按照BP學習算法對ANN中的參數(shù)進行學習更新(虛線連接的單元不更新,因為認為這些神經(jīng)元被臨時刪除了)。這樣一次迭代更新便完成了。下一次迭代中,同樣隨機刪除一些神經(jīng)元,與上次不一樣,做隨機選擇。這樣一直進行瑕疵,直至訓練結(jié)束。

這種技術(shù)被證明可以減少很多問題的過擬合,這些問題包括圖像分類、圖像切割、詞嵌入、語義匹配等問題。

6)早停

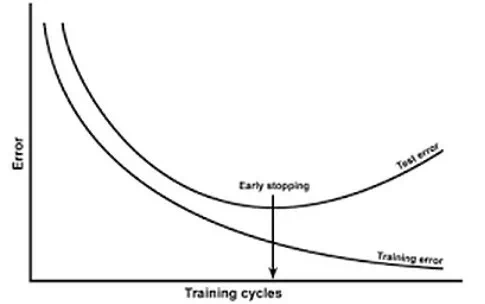

對模型進行訓練的過程即是對模型的參數(shù)進行學習更新的過程,這個參數(shù)學習的過程往往會用到一些迭代方法,如梯度下降(Gradient descent)學習算法。Early stopping便是一種迭代次數(shù)截斷的方法來防止過擬合的方法,即在模型對訓練數(shù)據(jù)集迭代收斂之前停止迭代來防止過擬合。

Early stopping方法的具體做法是,在每一個Epoch結(jié)束時(一個Epoch集為對所有的訓練數(shù)據(jù)的一輪遍歷)計算validation data的accuracy,當accuracy不再提高時,就停止訓練。這種做法很符合直觀感受,因為accurary都不再提高了,在繼續(xù)訓練也是無益的,只會提高訓練的時間。如下圖所示,在幾次迭代后,即使訓練誤差仍然在減少,但測驗誤差已經(jīng)開始增加了。

那么該做法的一個重點便是怎樣才認為validation accurary不再提高了呢?并不是說validation accuracy一降下來便認為不再提高了,因為可能經(jīng)過這個Epoch后,accuracy降低了,但是隨后的Epoch又讓accuracy又上去了,所以不能根據(jù)一兩次的連續(xù)降低就判斷不再提高。一般的做法是,在訓練的過程中,記錄到目前為止最好的validation accuracy,當連續(xù)10次Epoch(或者更多次)沒達到最佳accuracy時,則可以認為accuracy不再提高了。此時便可以停止迭代了(Early Stopping)。這種策略也稱為“No-improvement-in-n”,n即Epoch的次數(shù),可以根據(jù)實際情況取,如10、20、30……

7)重新清洗數(shù)據(jù)

把明顯異常的數(shù)據(jù)剔除

8)使用集成學習方法

把多個模型集成在一起,降低單個模型的過擬合風險

本文轉(zhuǎn)自:博客園 - 早起的小蟲子,轉(zhuǎn)載此文目的在于傳遞更多信息,版權(quán)歸原作者所有。

審核編輯:何安

-

深度學習

+關(guān)注

關(guān)注

73文章

5500瀏覽量

121117

發(fā)布評論請先 登錄

相關(guān)推薦

模型訓練擬合的分類和表現(xiàn)

模型訓練擬合的分類和表現(xiàn)

評論