上一篇我們講到了最簡單的詞向量表示方法——共現矩陣(沒有看的朋友可以點擊這里 小白跟學系列之手把手搭建NLP經典模型(含代碼) 回顧一下!)

共現矩陣簡單是簡單,但是有很嚴重的問題。

作者強調,自己動手的經驗、花時間思考的經驗,都是無法復制的。(所以,聽話,要自己嘗試敲1?敲代碼噢!

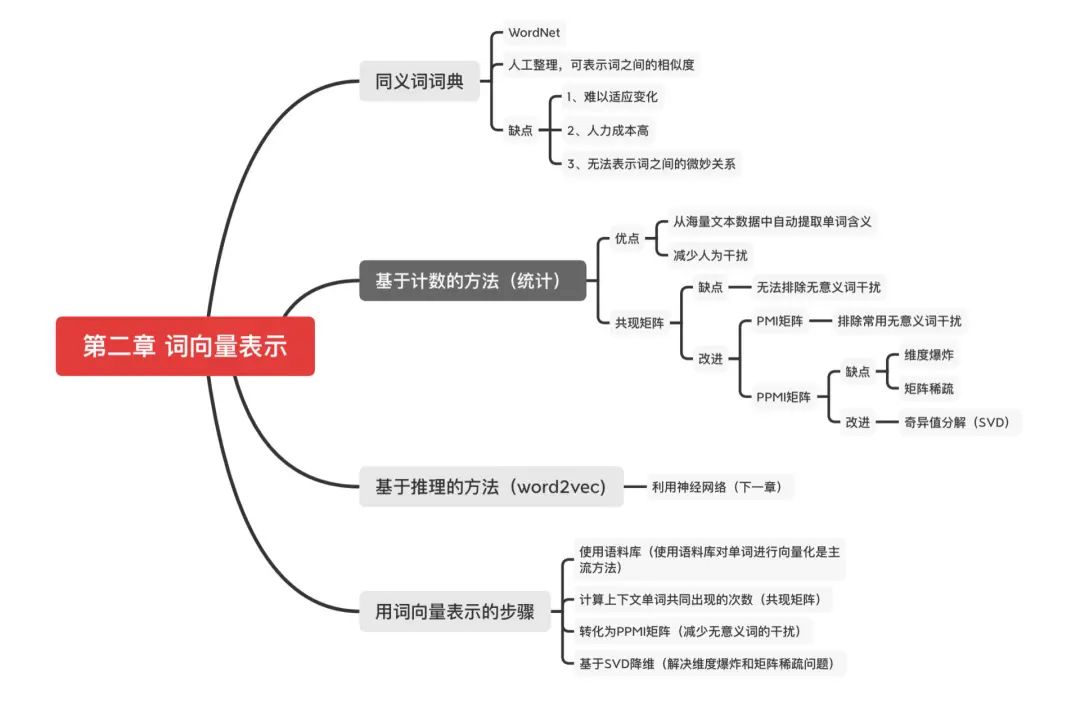

目錄

共現矩陣存在的問題:無意義詞干擾

余弦相似度:表示兩個詞向量的相似度

基于計數統計的方法改進

PMI矩陣(排除無意義詞干擾)

PPMI矩陣(排除負數)

SVD降維(解決維度爆炸和矩陣稀疏)

總結(用計數統計的方法表示詞向量的步驟)

共現矩陣存在的問題

!很多常用的無意義詞(比如“the car”)在文中出現次數太多的話,共現矩陣會認為“the”和“car”強相關,這是不合理的!

那怎么表示兩個向量之間的相似度呢?

余弦相似度

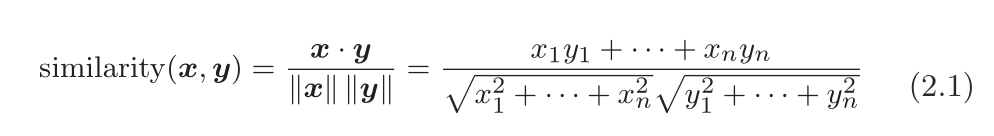

設有x = (x1,x2,x3,。..,xn)和y = (y1,y2,y3,。..,yn) 兩個向量,它們之間的余弦相似度如下式所示。

分子為內積,分母為L2范數。(范數表示向量的大小,L2 范數即向量各個元素的平方和的平方根。)

式 (2.1) 的要點是先對向量進行正規化,再求它們的內積。

余弦相似度:兩個向量在多大程度上指向同一方向。也就是說,余弦相似度越靠近1,兩個詞越相似;余弦相似度越靠近0,兩個詞越沒什么關系;

現在,我們來代碼實現余弦相似度。

def cos_similarity(x, y): # x 和 y 是 NumPy 數組 nx = x / np.sqrt(np.sum(x**2)) # x的正規化 ny = y / np.sqrt(np.sum(y**2)) # y的正規化 return np.dot(nx, ny)

為了防止除數為0(比如0向量),所以要給分母加個微小值eps=10^-8

修改后的余弦相似度的實現如下所示(common/util.py)。

def cos_similarity(x, y, eps=1e-8): nx = x / (np.sqrt(np.sum(x ** 2)) + eps) ny = y / (np.sqrt(np.sum(y ** 2)) + eps) return np.dot(nx, ny)

在絕大多數情況下,加上eps不會對最終的計算結果造成影響,因為根據浮點數的舍入誤差,這個微小值會被向量的范數“吸收”掉。而當向量的范數為 0 時,這個微小值可以防止“除數為 0”的錯誤。

利用這個cos_similarity函數,可以求得單詞向量間的相似度。我們嘗試求you 和I的相似度(ch02/similarity.py)。

import syssys.path.append(‘。.’)from common.util import preprocess, create_co_matrix, cos_similarity# 引入文本預處理,創建共現矩陣和計算余弦相似度的函數 text = ‘You say goodbye and I say hello.’corpus, word_to_id, id_to_word = preprocess(text) # 文本預處理vocab_size = len(word_to_id)C = create_co_matrix(corpus, vocab_size) # 創建共現矩陣 c0 = C[word_to_id[‘you’]] # you的詞向量c1 = C[word_to_id[‘i’]] # i的詞向量print(cos_similarity(c0, c1)) # 計算余弦相似度# 0.7071067691154799

從上面的結果可知,you 和 i 的余弦相似度是 0.70 。 . 。,接近1,即存在相似性。

說完單詞向量之間的相似度可以余弦相似度表示,用共現矩陣的元素表示兩個單詞同時出現的次數。而很多常用的無意義詞(比如“the car”)在文中出現次數太多的話,共現矩陣會認為“the”和“car”強相關,這是不合理的!

所以共現矩陣中無意義詞的干擾怎么解決呢?

基于計數的方法改進

接下來將對共現矩陣進行改進,并使用更實用的語料庫,獲得單詞“真實的”分布式表示。

點互信息

引入點互信息(Pointwise Mutual Information,PMI)這一指標。即考慮單詞單獨出現的次數。無意義詞(“the”)單獨出現次數肯定多,這點要考慮進去。

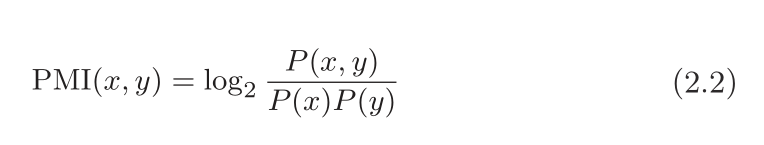

對于隨機變量 x 和 y,它們的 PMI 定義如下:

P(x) 表示 x 發生的概率,

P(y) 表示 y 發生的概率,

P(x, y) 表示 x 和 y 同時發生的概率。

PMI 的值越高,表明相關性越強。

例如設X = “the”,Y = “car”

P(“the”) = “the”出現的次數

P(“car”) = “car”出現的次數

P(“the car”) = “the car”共同出現的次數

“the”單獨出現的次數多,所以P(“the”)分母也就大,也就抵消掉了the的作用啦。

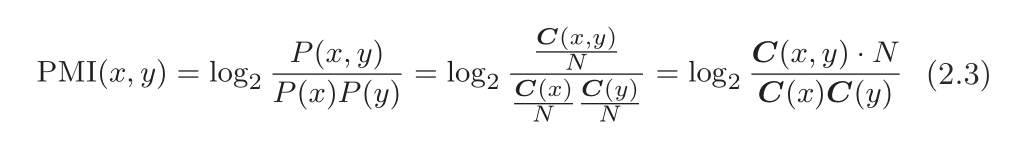

怎么表示概率呢?簡單的方式就是用共現矩陣來表示概率,因此也能表示出PMI。也就是用單詞出現的次數表示概率。

N:語料單詞總數;

C(X):X出現的次數 ;

C(X,Y):X,Y共現的次數;

舉個栗子:

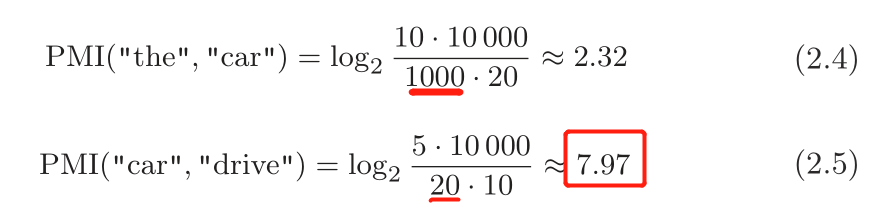

這里假設有一個文本語料庫。單詞總數量(N)為 10 000,the 出現 100 次,car 出現 20 次,drive 出現 10 次,the 和 car 共現 10 次,car 和 drive 共現 5 次。 這時,如果從共現次數的角度來看,the 和 car 的相關性更強。 而如果從 PMI 的角度來看,結果是怎樣的呢?

結果表明,在使用 PMI 的情況下,drive 和 car 具有更強的相關性。這是我們想要的結果。之所以出現這個結果,是因為我們考慮了單詞單獨出現的次數。因為 the 本身出現得多,所以 PMI的得分被拉低了。

但也存在一個問題。

當兩個單詞的共現次數為 0 時,log20 = ?∞。為了解決這個問題,實際上我們會使用正的點互信息(Positive PMI,PPMI)。

解決辦法

用PPMI (Positive PMI,正的點互信息)來表示詞之間的相關性

正的點互信息

PPMI(x,y) = max(0, PMI(x,y)) ,即當PMI為負數的時候,視作0。

所以,PPMI構建的矩陣要優于共現矩陣(因為排除了像the等無意義詞的干擾呀)。所以PPMI是更好的詞向量。

實現將共現矩陣轉化為PPMI 矩陣的函數為 ppmi(C, verbose=False, eps=1e-8)。這里不再贅述,我們只需要調用,需要看源代碼的去(common/util.py)

如何調用使用它呢?可以像下面這樣進行實現(ch02/ppmi.py)。

import syssys.path.append(‘。.’)import numpy as npfrom common.util import preprocess, create_co_matrix, cos_similarity,ppmi text = ‘You say goodbye and I say hello.’corpus, word_to_id, id_to_word = preprocess(text) # 文本預處理vocab_size = len(word_to_id)C = create_co_matrix(corpus, vocab_size) # 創建共現矩陣W = ppmi(C) # 將共現矩陣 ——》 PPMI 矩陣np.set_printoptions(precision=3) # 設置有效位數為3位print(‘covariance matrix’)print(C)print(‘-’*50)print(‘PPMI’)print(W)

運行該文件,可以得到:

covariance matrix[[0 1 0 0 0 0 0] [1 0 1 0 1 1 0] [0 1 0 1 0 0 0] [0 0 1 0 1 0 0] [0 1 0 1 0 0 0] [0 1 0 0 0 0 1] [0 0 0 0 0 1 0]]--------------------------------------------------PPMI[[ 0. 1.807 0. 0. 0. 0. 0. ] [ 1.807 0. 0.807 0. 0.807 0.807 0. ] [ 0. 0.807 0. 1.807 0. 0. 0. ] [ 0. 0. 1.807 0. 1.807 0. 0. ] [ 0. 0.807 0. 1.807 0. 0. 0. ] [ 0. 0.807 0. 0. 0. 0. 2.807] [ 0. 0. 0. 0. 0. 2.807 0. ]]

這樣一來,我們就成功的將共現矩陣轉化為了 PPMI 矩陣啦,也獲取了一個更好的單詞向量!

但是PPMI矩陣也存在很明顯的問題

維度爆炸

矩陣稀疏

如果語料庫的詞匯量達到10 萬,則詞向量的維數也同樣達到 10 萬。處理 10 萬維向量是不現實的。

另外,我們可以看得出該矩陣很多元素都是 0。這表明向量中的絕大多數元素并不重要,也就是說,每個元素擁有的“重要性”很低。這樣的向量也容易受到噪聲影響,穩健性差。

對于這些問題,一個常見的方法是向量降維。

解決辦法:降維

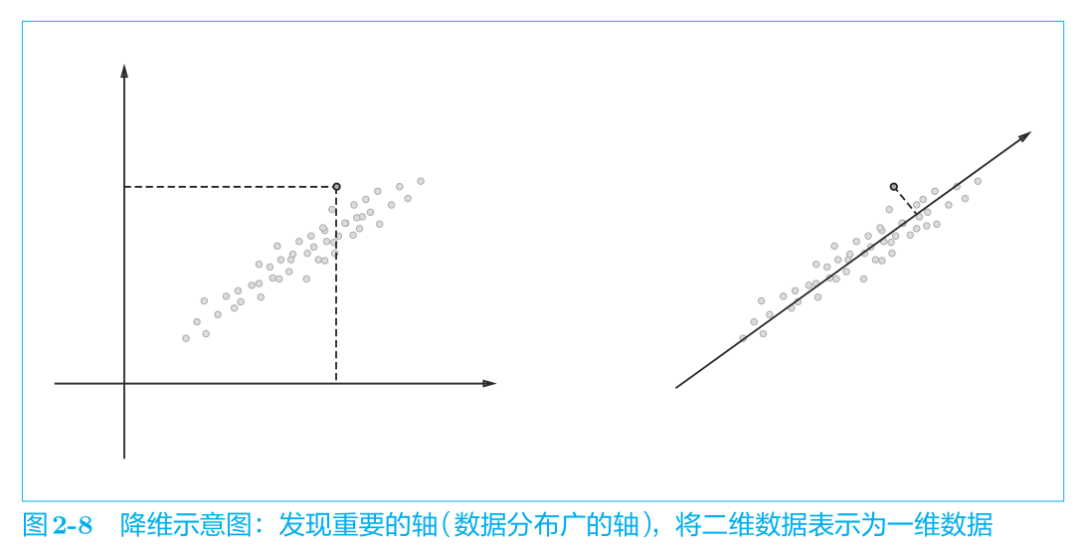

降維:減少向量維度(盡量保留重要信息)。發現重要的軸/分布廣的軸,將二維數據變一維數據。

目的:從稀疏矩陣中找到重要的軸,用更少的維度去表示詞向量。

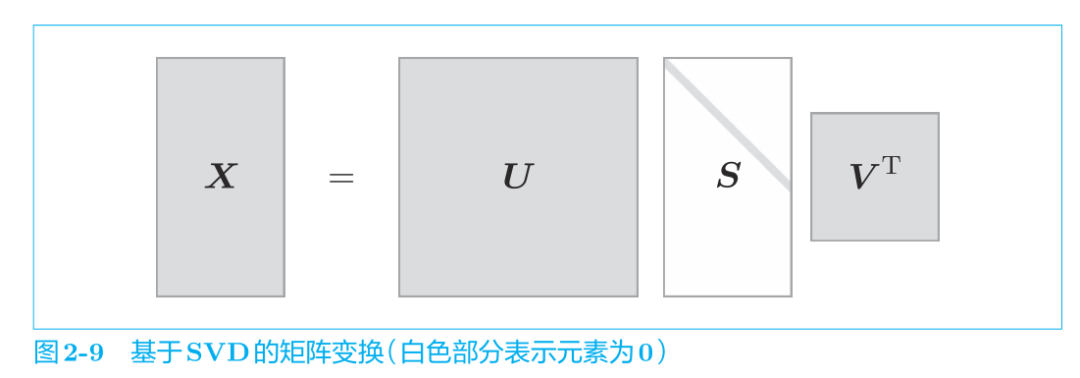

降維的方法有很多,這里我們使用奇異值分解(Singular Value Decomposition,SVD),如下式所示:

SVD 將任意的矩陣 X 分解為 U、S、V 這 3 個矩陣的乘積,其中 U 和 V 是列向量彼此正交的正交矩陣,S 是除了對角線元素以外其余元素均為 0 的對角矩陣。

在式 (2.7) 中,U 是正交矩陣。這個正交矩陣構成了一些空間中的基軸(基向量),我們可以將矩陣 U 作為“單詞空間”。

S 是對角矩陣,奇異值在對角線上降序排列。

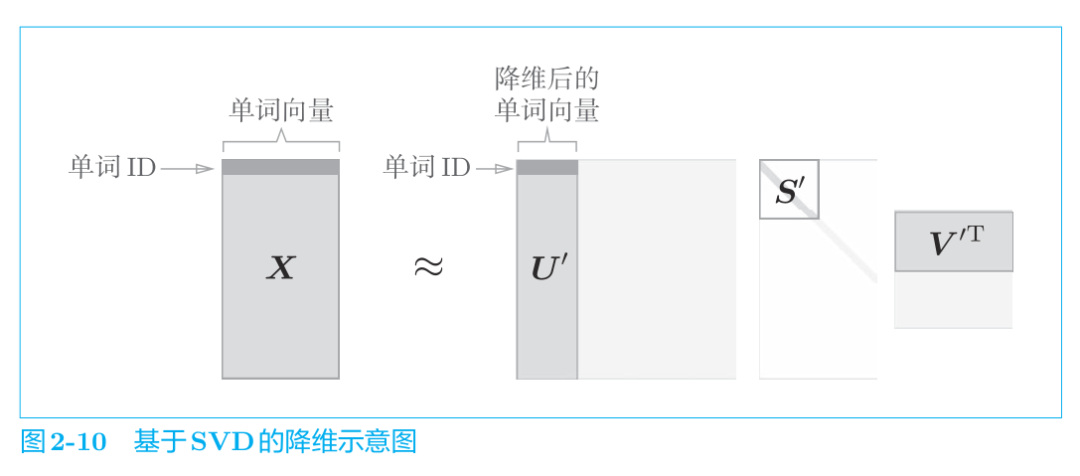

簡單地說,我們可以將奇異值視為“對應的基軸”的重要性。這樣一來,如圖 2-10 所示,減少非重要元素就成為可能。

如圖 2-10 所示,矩陣 S 的奇異值小,對應的基軸的重要性低,因此,可以通過去除矩陣 U 中的多余的列向量來近似原始矩陣。用我們正在處理的“單詞的 PPMI 矩陣”來說明的話,矩陣 X 的各行包含對應的單詞 ID的單詞向量,這些單詞向量使用降維后的矩陣 U‘表示。

想從數學角度仔細理解SVD的讀者,請參考文獻[20] 等。

接下來將用代碼實現 SVD ,這里可以使用 NumPy 的linalg模塊中的 svd 方法。linalg 是 linear algebra(線性代數)的簡稱。下面,我們創建一個共現矩陣,將其轉化為 PPMI 矩陣,然后對其進行 SVD降維(h02/count_method_small.py)。

import syssys.path.append(’。.‘)import numpy as npimport matplotlib.pyplot as pltfrom common.util import preprocess, create_co_matrix, ppmi text = ’You say goodbye and I say hello.‘corpus, word_to_id, id_to_word = preprocess(text)vocab_size = len(id_to_word)C = create_co_matrix(corpus, vocab_size, window_size=1)W = ppmi(C) # SVDU, S, V = np.linalg.svd(W) # 變量U已成為密集向量

SVD 執行完畢。上面的變量 U 包含經過 SVD 轉化的密集向量表示(稀疏的反義詞,就是沒那么多0啦)。現在,我們來看一下它的內容。單詞 ID 為 0 的單詞向量you如下。

print(C[0]) # 共現矩陣(簡單的用次數來表示)# [0 1 0 0 0 0 0] print(W[0]) # PPMI矩陣(用PPMI指標(概率)表示)# [ 0. 1.807 0. 0. 0. 0. 0. ] print(U[0]) # 做了SVD降維# [ 3.409e-01 -1.110e-16 -1.205e-01 -4.441e-16 0.000e+00 -9.323e-01# 2.226e-16]

如上所示,原先的稀疏向量 W[0] 經過 SVD 被轉化成了密集向量 U[0]。

但SVD同樣也有缺點:速度太慢

加快方法:采用Truncated SVD(截去奇異值較小的部分,實現高速化)

如果矩陣大小是 N,SVD 的計算的復雜度將達到 O(N3)。這意味著 SVD 需要與 N 的立方成比例的計算量。現實中這樣的計算量是做不到的,所以往往會使用 Truncated SVD等更快的方法。

Truncated SVD 通過截去(truncated)奇異值較小的部分,從而實現高速化。下面,我們將使用 sklearn庫的 Truncated SVD。

以上都是用的一句話語料來舉的例子,接下來要來“真的”了!

使用真的更大的語料庫:Penn Treebank(PTB數據集)

PTB數據集

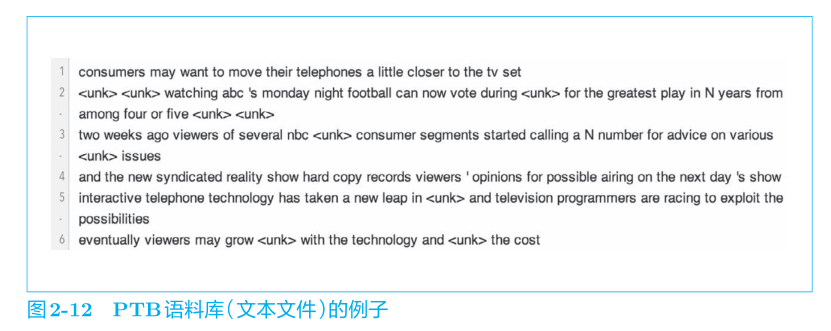

這個 PTB 語料庫是以文本文件的形式提供的,與原始的 PTB 的文章相比,多了若干預處理,包括將稀有單詞替換成特殊字符 《unk》( unknown 的簡稱),將具體的數字替換成“N”等。

作為參考,圖 2-12 給出了 PTB 語料庫的部分內容。一行保存一個句子。

這里,我們還要將所有句子連接起來,在每個句子的結尾處插入一個特殊字符 《eos》(end of sentence 的簡稱)。

接下來我們將代碼實現如何使用PTB數據集。

import syssys.path.append(’。.‘)from dataset import ptb corpus, word_to_id, id_to_word = ptb.load_data(’train‘) # 訓練用數據 print(’corpus size:‘, len(corpus))print(’corpus[:30]:‘, corpus[:30])print()print(’id_to_word[0]:‘, id_to_word[0])print(’id_to_word[1]:‘, id_to_word[1])print(’id_to_word[2]:‘, id_to_word[2])print()print(“word_to_id[’car‘]:”, word_to_id[’car‘])print(“word_to_id[’happy‘]:”, word_to_id[’happy‘])print(“word_to_id[’lexus‘]:”, word_to_id[’lexus‘])

結果如下所示:

corpus size: 929589 # 數據集中詞總數corpus[:30]: [ 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 1819 20 21 22 23 24 25 26 27 28 29] id_to_word[0]: aerid_to_word[1]: banknoteid_to_word[2]: berlitz word_to_id[’car‘]: 3856word_to_id[’happy‘]: 4428word_to_id[’lexus‘]: 7426

和之前一樣,corpus 中保存了單詞 ID 列表,id_to_word 是將單詞 ID 轉化為單詞的字典,word_to_id 是將單詞轉化為單詞 ID 的字典。

如上面的代碼所示,使用 ptb.load_data() 加載數據。此時,指定參數 ’train‘、’test‘ 和 ’valid‘ 中的一個,它們分別對應訓練用數據、測試用數據和驗證用數據中的一個。以上就是 ptb.py 文件的使用方法。

加載PTB數據集的代碼 :dataset/ptb.py

使用PTB數據集的例子:ch2/show_ptb.py

基于計數(統計)的方法利用PTB數據集的代碼:ch02/count_method_big.py

總結

詞向量表示總共介紹了:

基于同義詞詞典的方法

基于計數統計的方法

同義詞詞典需要人工定義詞之間的相關性,很費力;

使用計數統計的方法可以自動的獲取詞向量表示。

用計數統計的方法表示詞向量的步驟:

使用語料庫(使用語料庫對單詞進行向量化是主流方法)

計算上下文單詞共同出現的次數(共現矩陣)

轉化為PPMI矩陣(為了減少無意義詞的干擾)

基于SVD降維(解決維度爆炸和矩陣稀疏問題,以提高穩健性)

從而獲得了每個單詞的分布式表示,也就是詞向量表示,每個單詞表示為固定長度的密集向量。(單詞的分布式表示=詞向量表示)

在單詞的向量空間中,含義上接近的單詞距離上也更接近。

使用語料庫對單詞進行向量化是主流方法。

其實在海量數據的今天,基于計數統計的方法難以處理大規模的數據集,統計方法是需要一次性統計整個語料庫,需要一次性處理全部的數據,而SVD降維的復雜度又太大,于是將推出——基于推理的方法,也就是基于神經網絡的方法。

神經網絡一次只需要處理一個mini-batch的數據進行學習,并且反復更新網絡權重。

基于推理(神經網絡)的方法,最著名的就是Word2Vec。下一次我們會詳細的介紹它的優點缺點以及使用方法噢!

原文標題:小白跟學系列之手把手搭建NLP經典模型-2(含代碼)

文章出處:【微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

責任編輯:haq

-

神經網絡

+關注

關注

42文章

4772瀏覽量

100857 -

nlp

+關注

關注

1文章

489瀏覽量

22052

原文標題:小白跟學系列之手把手搭建NLP經典模型-2(含代碼)

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

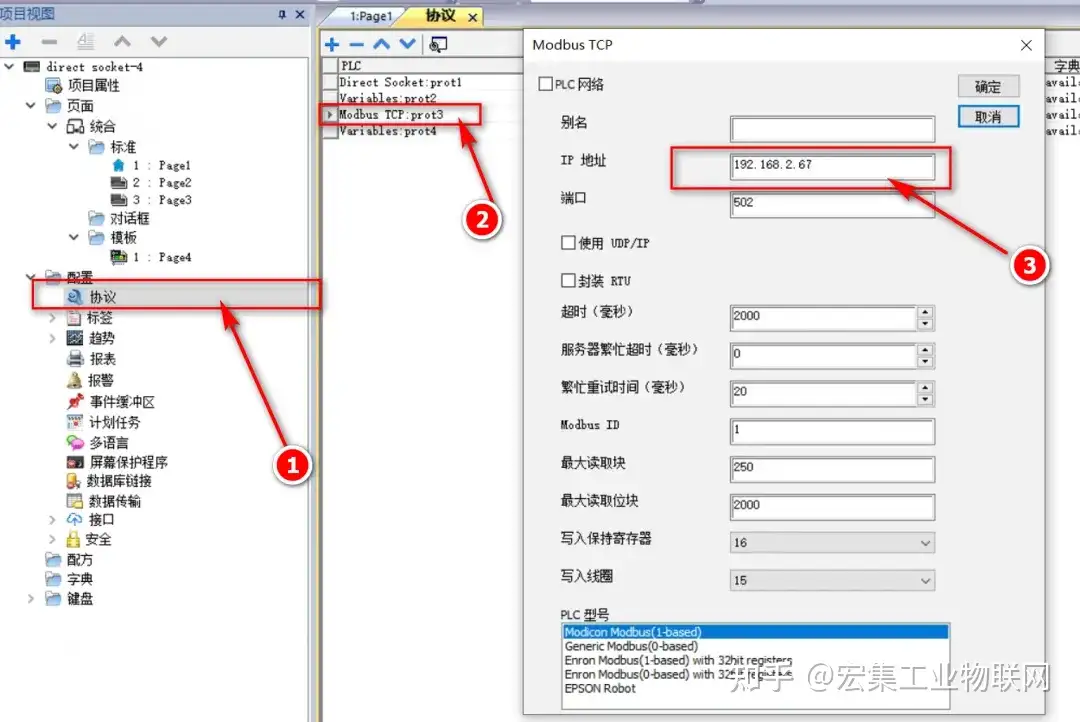

手把手教你通過宏集物聯網工控屏&網關進行協議轉換,將底層PLC/傳感器的數據轉換為TCP協議并傳輸到用戶

nlp邏輯層次模型的特點

nlp自然語言處理模型怎么做

使用PyTorch搭建Transformer模型

手把手教你使用物模型連接DDSU電表

手把手教你排序算法怎么寫

無刷電機無感FOC控制培訓系列課程

【飛騰派4G版免費試用】4.手把手玩轉QT界面設計

使用DPort-ECT搭建EtherCAT從站step by step

手把手教你搭建NLP經典模型

手把手教你搭建NLP經典模型

評論