2月17日新媒體專電 《俄羅斯報(bào)》近日發(fā)表文章稱,美國(guó)斯坦福大學(xué)學(xué)者邁克爾科辛斯基教授研發(fā)出了一種可根據(jù)人臉表情判斷其信仰傾向的人工智能技術(shù)。

報(bào)道稱,科辛斯基首先使用人臉照片庫(kù)來(lái)訓(xùn)練神經(jīng)網(wǎng)絡(luò),庫(kù)中包括大量信仰明確的人物。然后,他將這一神經(jīng)網(wǎng)絡(luò)投入使用,讓其根據(jù)數(shù)百萬(wàn)人的照片來(lái)將他們區(qū)分為自由派和保守分子。人工智能的識(shí)別正確率達(dá)到了72%。這一結(jié)果似乎并不太出色,但人的判斷力更糟糕,正確率只有55%,幾乎和拋硬幣差不多。

有趣的是,科辛斯基還試圖搞清楚神經(jīng)網(wǎng)絡(luò)的工作原理。他檢查了照片中的多項(xiàng)特征和因素,如面部汗毛的顏色、目光是否直視鏡頭以及各種表情,但發(fā)現(xiàn)這些因素都不起作用。這也就是說(shuō),神經(jīng)網(wǎng)絡(luò)找到了目前尚不為人知的其他某些特征。

值得指出的是,科辛斯基的神經(jīng)網(wǎng)絡(luò)幾年前已能通過人臉照片來(lái)確定人的性取向。在僅有一張照片可供識(shí)別的情況下,它對(duì)男性性取向的判斷正確率達(dá)到81%,對(duì)女性的判斷正確率為74%。如果有5張照片可供識(shí)別,它對(duì)男女性取向的判斷正確率將分別提高到91%和83%。如果由人根據(jù)單張照片來(lái)進(jìn)行判斷的話,他對(duì)男女性取向的判斷正確率分別只有61%和54%,這與過去的研究結(jié)果是一致的。

當(dāng)時(shí),科辛斯基的研究受到了同行們的嚴(yán)厲批評(píng),他們認(rèn)為這項(xiàng)技術(shù)可能危及他人的安全和隱私。但這項(xiàng)技術(shù)的研發(fā)者反駁說(shuō),自己沒有創(chuàng)造侵犯?jìng)€(gè)人隱私的工具,而是展示了“基本和廣泛使用的方法可能以何種方式威脅私人生活”。也就是說(shuō),他們對(duì)人工智能中包含的危險(xiǎn)發(fā)出了警告。

科辛斯基已向我們展示了其中一個(gè)危險(xiǎn)。神經(jīng)網(wǎng)絡(luò)把人變得透明化了:它能在人身上發(fā)現(xiàn)對(duì)方自己可能都不知道的東西。

許多學(xué)者表示,必須制定有關(guān)人工智能使用的法律規(guī)范。但要把已被放出來(lái)的精靈重新裝回瓶子里是難以想象的。

責(zé)任編輯:YYX

-

人工智能

+關(guān)注

關(guān)注

1800文章

48083瀏覽量

242164

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

斯坦福STANFORD FS725銣鐘

嵌入式和人工智能究竟是什么關(guān)系?

未來(lái)智慧建筑:人工智能技術(shù)的無(wú)限可能

AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第4章-AI與生命科學(xué)讀后感

《AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新》第一章人工智能驅(qū)動(dòng)的科學(xué)創(chuàng)新學(xué)習(xí)心得

risc-v在人工智能圖像處理應(yīng)用前景分析

名單公布!【書籍評(píng)測(cè)活動(dòng)NO.44】AI for Science:人工智能驅(qū)動(dòng)科學(xué)創(chuàng)新

FPGA在人工智能中的應(yīng)用有哪些?

人工智能技術(shù)在集成電路中的應(yīng)用

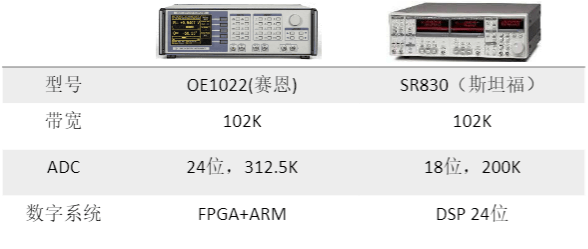

國(guó)產(chǎn)儀器崛起:斯坦福替代方案來(lái)了!

Google開發(fā)專為視頻生成配樂的人工智能技術(shù)

斯坦福團(tuán)隊(duì)抄襲國(guó)產(chǎn)大模型,主要責(zé)任人失聯(lián)

斯坦福大學(xué)研發(fā)全新AI輔助全息成像技術(shù)

斯坦福發(fā)布《2024 AI指數(shù)報(bào)告》

15 張圖,看懂人工智能現(xiàn)狀

斯坦福研發(fā)出可根據(jù)表情判斷其信仰的人工智能技術(shù)

斯坦福研發(fā)出可根據(jù)表情判斷其信仰的人工智能技術(shù)

評(píng)論