Twitter 上發現了一篇Hinton的新論文,作者只有Hinton本人,這篇論文沒有介紹具體的算法,而是描繪了一個關于表示的宏觀構想:如何在神經網絡中表示部分-整體層次結構。

AI科技評論在Twitter 上發現了一篇Hinton的新論文,作者只有Hinton本人,這篇論文沒有介紹具體的算法,而是描繪了一個關于表示的宏觀構想:如何在神經網絡中表示部分-整體層次結構。

值得一提的是,分享論文的Kosta Derpanis也在推特里介紹了Hinton的第一篇論文:“Using Relaxation To Find A Puppy”。Kosta Derpanis在論文里標記了一句話:“局部的模糊性必須必須通過尋找最佳的全局解釋來解決。”并表示,Hinton現在又回到了最初的起點。

Hinton第一篇論文:https://www.cs.toronto.edu/~hinton/absps/puppet.pdf

局部和整體的一致性表示似乎一直是Hinton的研究重點。比如,膠囊網絡通過局部到整體的動態路徑選擇一致性來學習識別,近期Hinton還將其擴展到了無監督學習,并應用了Transformer架構;對比學習則學習一種表示,使得同一幅圖像的的各個局部具有相似的表示;認知神經科學出身的Hinton還一直堅持探索著大腦的學習機制,比如back relaxation試圖在自頂向下表示和自底向上表示之間產生一致性,而這又和對比學習有聯系。

在這篇新論文中,Hinton又將為我們描繪出怎樣一幅圖景呢?

論文鏈接:https://arxiv.org/pdf/2102.12627.pdf

這篇論文沒有描述工作系統,而是單單提出了一個關于表示的想法。這個想法能夠把Transformer、神經場(neural fields)、對比表示學習、蒸餾和膠囊等先進觀點整合到一個名為“GLOM 1”的設想系統中。

一個具有固定架構的神經網絡如何將一張圖像解析成一個整體的分級體系(其中,每張圖像都有不同的結構)?針對這個問題,GLOM 給出了一個簡單的答案,即使用相同向量的孤島來表示解析樹中的節點。如果 GLOM 真的能夠正常運轉,那么,當它在視覺或語言上應用時,它能夠極大地提高類似Transformer的系統所生成的表示的可解釋性。

“GLOM”一詞源自一句俗語“ glom together”(“抓”到一起),可能是來源于“凝聚”(agglomerate)一詞。

1

觀點總覽

心理學提供了一個有力證據,表明:人們會將視覺場景解析為整個分層體系,并將部分與整體之間視角不變的空間關系,建模為他們分配給該部分和整體的內在坐標系之間的坐標轉換。

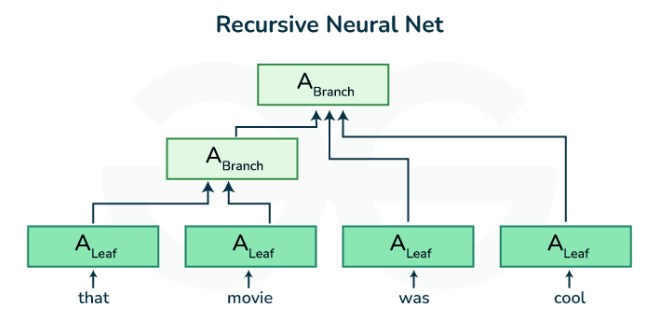

如果我們想要建立像人類一樣理解圖像的神經網絡,那么我們需要想明白:神經網絡是如何表示部分-整體的分層體系?這很困難,因為一個真實的神經網絡無法將一組神經元進行動態分配,以表示解析樹中的一個節點。

神經網絡無法動態分配神經元,也是一系列用到“膠囊”觀點的模型所出現的原因。這些模型會作出如下假設:被稱為“膠囊”的一組神經元會永遠成為圖像特定區域中的某一特定類型的一部分。通過激活這些預先存在的、類型特定的膠囊子集,以及膠囊之間的適合連接,可以構建一個解析樹。

這篇論文介紹了一種非常不同的方式,可以使用膠囊來表示神經網絡中的部分-整體分層體系。

雖然這篇論文主要討論了單個靜態圖像的感知,但我們可以簡單地將 GLOM 理解為用于處理一系列幀的管道,因此靜態圖像可以被視為一系列相同的幀。

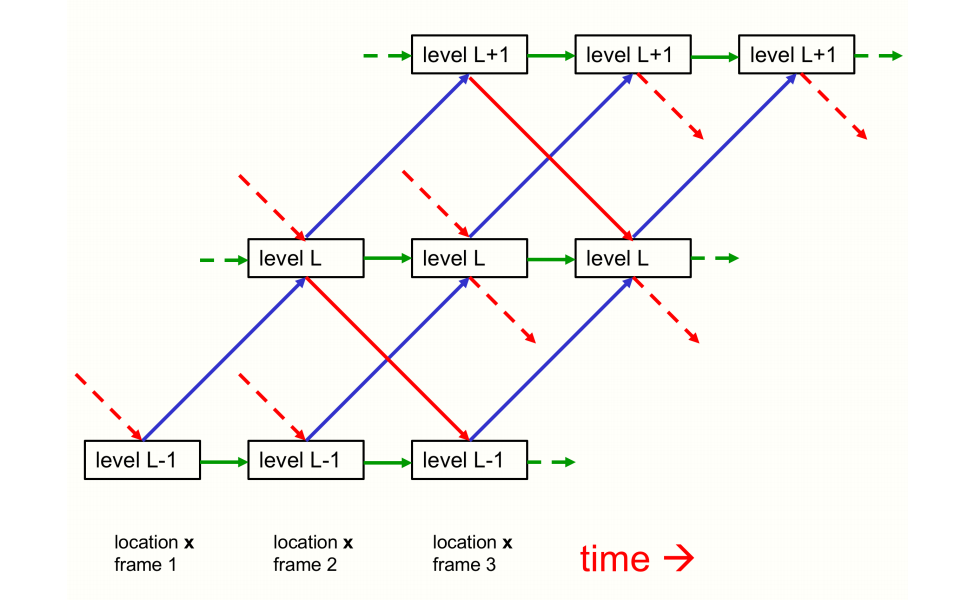

GLOM 架構由許多列(column)組成,所有列均使用完全相同的權重。每一列都是一堆空間局部自動編碼器,這些編碼器會學習小圖像塊(image patch)中的多個不同級別的表示。每個自動編碼器都會使用多層自下而上的編碼器和多層自上而下的解碼器,將同一個級別的嵌入轉換為相鄰級別的嵌入。這些級別與部分-整體分層體系中的級別一一對應。比如,顯示一張人臉圖像時,一個單列可能會收斂到表示一個鼻孔、一個鼻子、一張臉和一個人的嵌入向量上。圖 1 顯示了不同級別的嵌入如何在單列中進行交互。

圖1:單列中,GLOM架構的三個相鄰級別的自下而上、自上而下、同列的交互。

代表自下而上和自上而下交互的藍色和紅色箭頭是由兩個具有多個隱藏層的不同神經網絡來實現。這些網絡在成對的級別中有所差異,但它們可以跨列、跨時間步分享。自上而下的網絡也許應該使用正弦單位。對于靜態圖,綠色箭頭可以簡單看作按比例縮放的殘差連接,以實現每個級別的嵌入的時間平滑。對于視頻,綠色連接可以是基于多個先前狀態的膠囊來學習時間動態的神經網絡。不同列中,相同級別的的嵌入向量之間的交互可以通過非自適應的、注意力加權的局部平滑器(圖中沒有顯示)來實現。

圖 1 沒有顯示不同列中同一級別的嵌入之間的交互。這比同一列內的交互要簡單得多,因為它們不需要執行部分-整體坐標轉換。它們就像代表一個多頭 transformer 中不同單詞片段的列之間的注意力加權交互,但更簡單,因為查詢、鍵和值向量都與嵌入向量相同。列與列之間的交互作用是,通過使一個級別的每個嵌入向量向附近位置的其他類似向量回歸,從而在該級別上產生具有相同嵌入的島。這將創建多個局部“回音室”,其中一個級別的嵌入主要聽從其他想法相似的嵌入。

在每一段離散時間和每一列中,一個級別的嵌入將被更新為擁有四個貢獻(如下)的加權平均值:

自下而上的神經網絡在前一個時間作用于下層級別的嵌入而產生的預測;

自上而下的神經網絡在前一個時間作用于上層級別的嵌入而產生的預測;

上一個時間步的嵌入向量;

前一個時間在附近列相同級別的嵌入的注意力加權平均值。

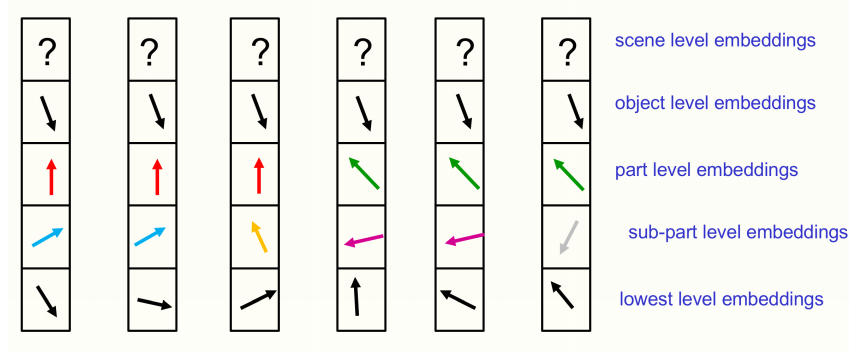

對于靜態圖,一個級別的嵌入應隨著時間的流逝而沉淀,以生成擁有幾乎相同向量的不同島。如圖 2 所示, 這些島在更高的級別上應該更大。使用相似的島來表示圖像的解析,避免了需要分配神經元組來動態表示正在運行的解析樹的節點,或預先為所有可能的節點設置神經元的情況。GLOM 系統不是分配神經硬件來表示解析樹中的節點,或為節點提供指向其祖先和后代的指針,而是分配了一個合適的活動向量來表示該節點,并在屬于該節點的所有位置上使用了相同的活動向量。訪問節點的祖先和后代的能力是通過自下而上和自上而下的神經網絡實現的,而不是通過使用 RAM 檢查表格來實現的。

圖 2:在特定時間里,6 個相鄰列的嵌入。

圖 2 所顯示的所有位置都屬于同一對象,且場景級別尚未在共享矢量上定居。通過將向量劃分為部分-整體分層體系中每個級別的單獨部分,然后將一個級別的的高維嵌入向量顯示為二維向量,那么每個位置的完整嵌入向量就可以顯示出來。這可以很好地解釋不同位置的嵌入向量的對齊。圖 2 所示的不同級別上向量相同的島,實則表示一棵解析樹。但是,相同的島比短語結構語法要強大得多。比如,在“這是否會減慢短語結構語法的速度”的問題上,它們可以毫不費力地表示斷開連接的對象。

就像BERT一樣,整個 GLOM 系統可以進行端到端的訓練,以在最后的時間步從缺少某一區域的輸入圖像中重建圖像。但是,目標函數還包含兩個倡導在每個級別上向量幾乎相同的島的正則化器(regularizer)。正則化器只是一個級別的新嵌入與自下而上、自上而下的預測之間的一致性。提高這個一致性能夠促進局部島的形成。

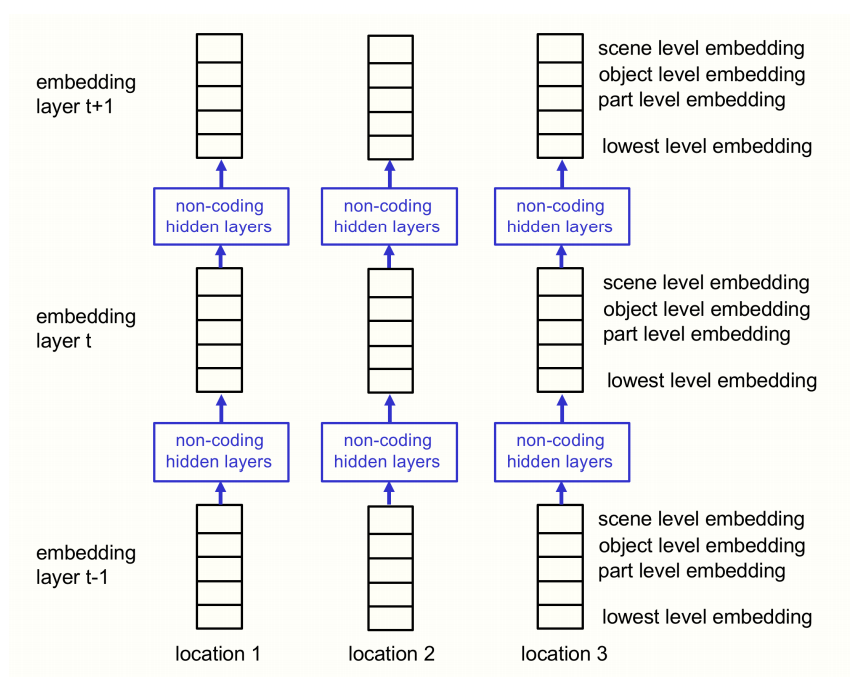

圖 4:這是將圖 1 所示架構進行可視化的另一種方式,可以使該架構與 transformer 之間的關系更加明顯。圖 1 中表示時間的水平尺寸變成了圖 4 中表示層的垂直尺寸。此時,在每一個位置,每一層都有部分-整體分層體系中所有級別的嵌入。這與垂直壓縮圖 1 中單個時間片內的級別描述一致。

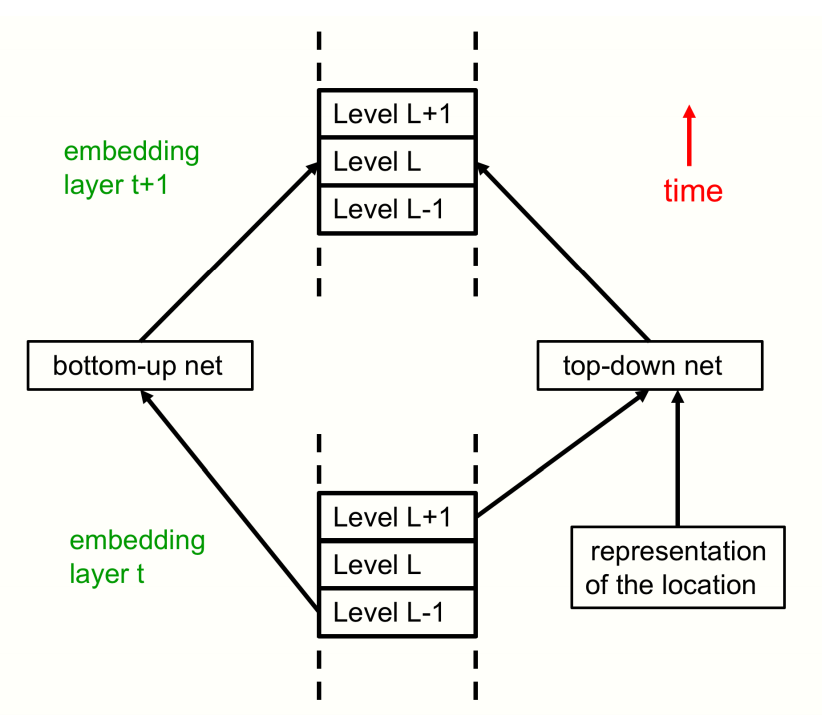

靜態圖的解釋僅需要使用該架構進行一次前向傳遞。這里將所有級別特定的自下而上和自上而下的神經網絡都顯示為單個神經網絡。圖 5 顯示了另一種查看 GLOM 架構的自下而上和自上而下的神經網絡。

圖 5:GLOM 在同一個位置(即單列的一部分)的兩個相鄰層。在前向傳遞的過程中,L 級的嵌入向量通過多層自下而上的神經網絡從上一層 L-1 級的嵌入向量中接收輸入。L 級還通過多層自上而下的神經網絡從上一層 L+1 級的嵌入中接收輸入。在前向傳遞的過程中,對上一層 L+1 級的依賴取得了自上而下的效果。嵌入在 t+1 層中的 L 級還取決于嵌入在 t 層中的 L 級嵌入和 t 層中其他附近位置的 L 級嵌入的注意力加權總和。圖中沒有顯示級內的交互。

2

責任編輯:lq

-

神經網絡

+關注

關注

42文章

4772瀏覽量

100838 -

算法

+關注

關注

23文章

4615瀏覽量

92979 -

函數

+關注

關注

3文章

4333瀏覽量

62687

原文標題:Hinton一作新論文:如何在神經網絡中表示“部分-整體層次結構”?

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

如何在神經網絡中表示部分-整體層次結構

如何在神經網絡中表示部分-整體層次結構

評論