電子發燒友網報道(文/周凱揚)人工智能在進化的過程中,最不可或缺的便是模型和算力。訓練出來的通用大模型省去了重復的開發工作,目前不少大模型都為學術研究和AI開發提供了方便,比如華為的盤古、搜狗的BERTSG、北京智源人工智能研究院的悟道2.0等等。

那么訓練出這樣一個大模型需要怎樣的硬件前提?如何以較低的成本完成自己模型訓練工作?這些都是不少AI初創企業需要考慮的問題,那么如今市面上有哪些訓練芯片是經得起考驗的呢?我們先從國外的幾款產品開始看起。

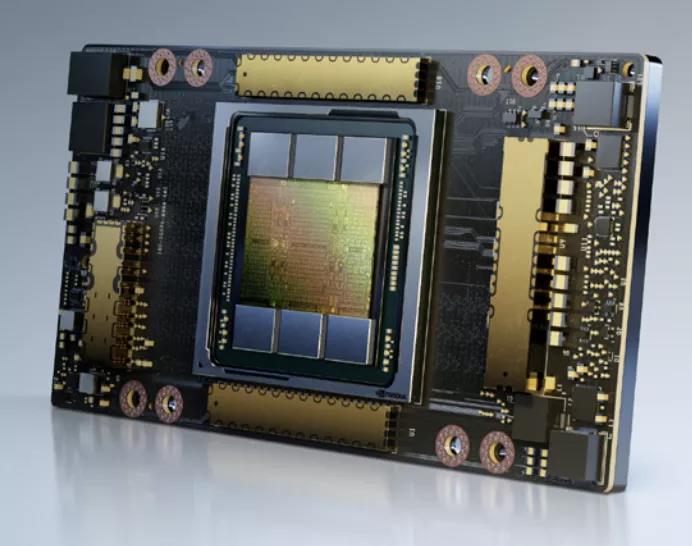

英偉達A100

英偉達的A100可以說是目前AI訓練界的明星產品,A100剛面世之際可以說是世界上最快的深度學習GPU。盡管近來有無數的GPU或其他AI加速器試圖在性能上撼動它的地位,但綜合實力來看,A100依然穩坐頭把交椅。

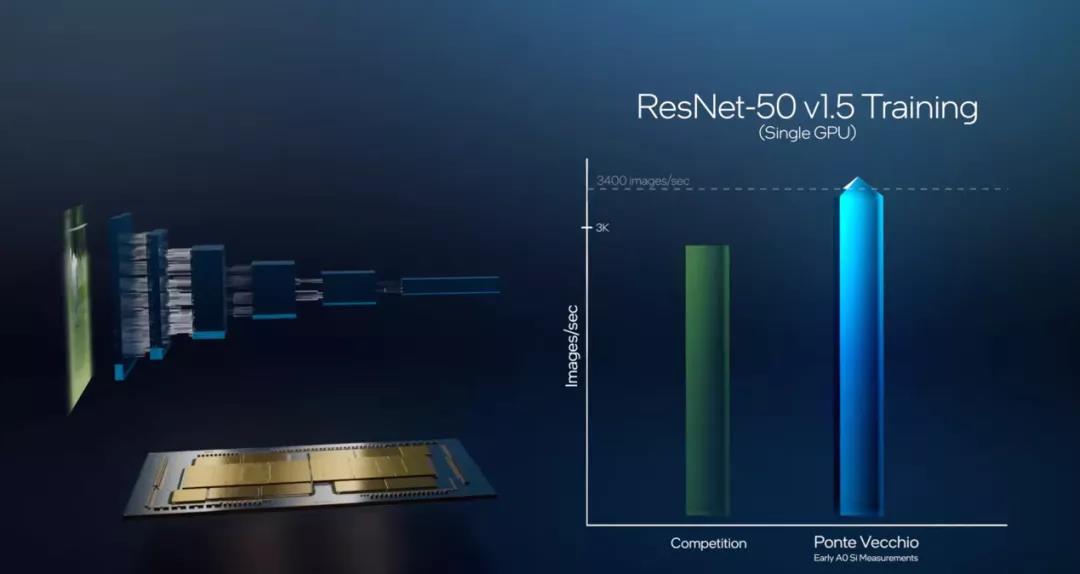

英特爾Gaudi和Ponte Vecchio

19年12月,英特爾收購了以色列的Habana Labs,將其旗下的AI加速器產品線納入囊中。Habana Labs目前推出了用于推理的Goya處理器和用于訓練的Gaudi處理器。盡管Habana Labs已經隸屬英特爾,但現有的產品仍然基于臺積電的16nm制程,傳言稱其正在開發的Gaudi2將用上臺積電的7nm制程。 目前Gaudi已經用于亞馬遜云服務AWS的EC2 DL1訓練實例中,該實例選用了AWS定制的英特爾第二代Xeon可擴展處理器,最多可配置8個Gaudi處理器,每個處理器配有32GB的HBM內存,400Gbps的網絡架構加上100Gbps的互聯帶寬,并支持4TB的NVMe存儲。

亞馬遜Trainium

最后我們以亞馬遜的訓練芯片收尾,亞馬遜提供的服務器實例可以說是最多樣化的,也包含了以上提到的A100和Gaudi。亞馬遜作為云服務巨頭,早已開始部署自己的服務器芯片生態,不僅在今年推出了第三代Graviton服務器處理器,也正式發布了去年公開的訓練芯片Trainium,并推出了基于該芯片的Trn1實例。

小結

GPU一時半會不會跌落AI訓練的神壇,但其他訓練芯片的推陳出新證明了他們面對A100和Ponte Vecchio這種大規模芯片同樣不懼,甚至還有自己獨到的優勢。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

gpu

+關注

關注

28文章

4830瀏覽量

129778 -

AI

+關注

關注

87文章

32439瀏覽量

271625

發布評論請先 登錄

相關推薦

GPU是如何訓練AI大模型的

在AI模型的訓練過程中,大量的計算工作集中在矩陣乘法、向量加法和激活函數等運算上。這些運算正是GPU所擅長的。接下來,AI部落小編帶您了解GPU

訓練AI大模型需要什么樣的gpu

訓練AI大模型需要選擇具有強大計算能力、足夠顯存、高效帶寬、良好散熱和能效比以及良好兼容性和擴展性的GPU。在選擇時,需要根據具體需求進行權衡和選擇。

PyTorch GPU 加速訓練模型方法

在深度學習領域,GPU加速訓練模型已經成為提高訓練效率和縮短訓練時間的重要手段。PyTorch作為一個流行的深度學習框架,提供了豐富的工具和

AI大模型的訓練數據來源分析

AI大模型的訓練數據來源廣泛且多元化,這些數據源對于構建和優化AI模型至關重要。以下是對AI大模型訓練數據來源的分析: 一、公開數據集 公開

GPU服務器在AI訓練中的優勢具體體現在哪些方面?

GPU服務器在AI訓練中的優勢主要體現在以下幾個方面: 1、并行處理能力:GPU服務器擁有大量的并行處理核心,這使得它們能夠同時處理成千上萬個計算任務,極大地加速

蘋果承認使用谷歌芯片來訓練AI

蘋果公司最近在一篇技術論文中披露,其先進的人工智能系統Apple Intelligence背后的兩個關鍵AI模型,是在谷歌設計的云端芯片上完成預訓練的。這一消息標志著在尖端AI訓練領域

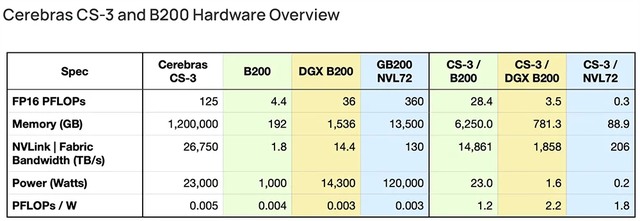

AI初出企業Cerebras已申請IPO!稱發布的AI芯片比GPU更適合大模型訓練

美國加州,專注于研發比GPU更適用于訓練AI模型的晶圓級芯片,為復雜的AI應用構建計算機系統,并與阿布扎比科技集團G42等機構合作構建超級計算機。基于其最新旗艦芯片構建的服務器可輕松高

摩爾線程與師者AI攜手完成70億參數教育AI大模型訓練測試

近日,國內知名的GPU制造商摩爾線程與全學科教育AI大模型“師者AI”聯合宣布,雙方已成功完成了一項重要的大模型訓練測試。此次測試依托摩爾線程夸娥(KUAE)千卡智算集群,充分展現

AI訓練,為什么需要GPU?

隨著由ChatGPT引發的人工智能熱潮,GPU成為了AI大模型訓練平臺的基石,甚至是決定性的算力底座。為什么GPU能力壓CPU,成為炙手可熱的主角呢?要回答這個問題,首先需要了解當前人

國產GPU在AI大模型領域的應用案例一覽

不斷推出新品,產品也逐漸在各個領域取得應用,而且在大模型的訓練和推理方面,也有所建樹。 ? 國產GPU在大模型上的應用進展 ? 電子發燒友此前就統計過目前國內主要的GPU廠商,也介紹了

FPGA在深度學習應用中或將取代GPU

對神經網絡進行任何更改,也不需要學習任何新工具。不過你可以保留你的 GPU 用于訓練。”

Zebra 提供了將深度學習代碼轉換為 FPGA 硬件指令的抽象層

AI 硬件前景

發表于 03-21 15:19

AI訓練勢起,GPU要讓位了?

AI訓練勢起,GPU要讓位了?

評論