作者最近兩年在研究分布式并行,經常使用PyTorch框架。一開始用的時候對于PyTorch的顯存機制也是一知半解,連蒙帶猜的,經常來知乎上來找答案,那么我就吸收大家的看法,為PyTorch的顯存機制做個小的總結吧。

01 理論知識1.1 深度學習訓練過程

開門見山的說,PyTorch在進行深度學習訓練的時候,有4大部分的顯存開銷,分別是模型參數(parameters),模型參數的梯度(gradients),優化器狀態(optimizer states)以及中間激活值(intermediate activations) 或者叫中間結果(intermediate results)。為了后面顯存分析闡述的方便,我將深度學習的訓練定義4個步驟:- 模型定義:定義了模型的網絡結構,產生模型參數;

- 前向傳播:執行模型的前向傳播,產生中間激活值;

- 后向傳播:執行模型的后向傳播,產生梯度;

- 梯度更新:執行模型參數的更新,第一次執行的時候產生優化器狀態。

1.2 前向傳播

拿Linear層(或者叫Dense層,前饋神經網絡,全連接層等等...)舉例:假設他的權重矩陣為W,偏置向量為b,那么他的前向計算過程就是:,這里的X為該層的輸入向量,Y為輸出向量(中間激活值)1.3 后向傳播(反向傳播)

參考了這篇文章《神經網絡反向傳播的數學原理》https://zhuanlan.zhihu.com/p/22473137后向傳播回來了一個第l+1層的輸出誤差矩陣,用以計算該層的梯度和輸入誤差1.4 梯度更新

接下來就是利用 W_diff 和 b_diff 進行更新了: 當然使用 Adam 優化器的時候,實際的更新過程并沒有上面的這么簡單。目前用的最多的是 AdamW ,可以看看這篇文章《當前訓練神經網絡最快的方式:AdamW優化算法+超級收斂》https://zhuanlan.zhihu.com/p/38945390)但是使用這一類優化器,也會帶來額外的顯存開銷。對于每一個參數,Adam都會為它準備對應的2個優化器狀態,分別是動量(momentum)和方差(variance),用以加速模型的訓練。02 顯存分析方法與Torch機制2.1 分析方法

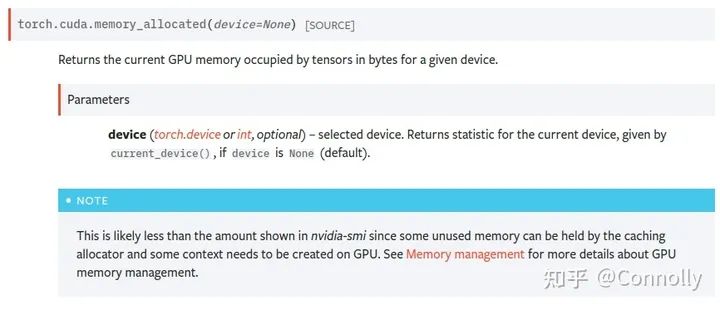

(1) No Nvidia-smi我看很多人現在還在用 nvidia-smi 來看 pytorch 的顯存占用,盯著跳來跳去的torch緩存區分析真的不累嗎。(貼一個Torch為什么不用Nvidia-smi看的圖)。而且PyTorch是有緩存區的設置的,意思就是一個Tensor就算被釋放了,進程也不會把空閑出來的顯存還給GPU,而是等待下一個Tensor來填入這一片被釋放的空間。有什么好處?進程不需要重新向GPU申請顯存了,運行速度會快很多,有什么壞處?他不能準確地給出某一個時間點具體的Tensor占用的顯存,而是顯示的已經分配到的顯存和顯存緩沖區之和。這也是令很多人在使用PyTorch時對顯存占用感到困惑的罪魁禍首。(2) torch.cuda is all you need在分析PyTorch的顯存時候,一定要使用torch.cuda里的顯存分析函數,我用的最多的是torch.cuda.memory_allocated()和torch.cuda.max_memory_allocated(),前者可以精準地反饋當前進程中Torch.Tensor所占用的GPU顯存,后者則可以告訴我們到調用函數為止所達到的最大的顯存占用字節數。還有像torch.cuda.memory_reserved()這樣的函數則是查看當前進程所分配的顯存緩沖區是多少的。memory_allocated+memory_reserved就等于nvidia-smi中的值啦。非~常~好~用chao dasheng Torch 官方文檔2.2 PyTorch context開銷-----之前沒有提到PyTorch context的開銷,做個補充...我注意到有很多同學在做顯存分析的時候是為了在訓練的時候可以把卡的顯存用滿,這個之前沒有考慮到呢。其實PyTorch context是我們在使用torch的時候的一個大頭開銷。主要參考的是論壇里的這篇討論:How do I create Torch Tensor without any wasted storage space/baggage?https://discuss.pytorch.org/t/how-do-i-create-torch-tensor-without-any-wasted-storage-space-baggage/131134什么是PyTorch context? 其實官方給他的稱呼是CUDA context,就是在第一次執行CUDA操作,也就是使用GPU的時候所需要創建的維護設備間工作的一些相關信息。如下圖所示這個值跟CUDA的版本,pytorch的版本以及所使用的設備都是有關系的。目前我在ubuntu的torch1.9上測過RTX 3090和V100的context 開銷。其中3090用的CUDA 11.4,開銷為1639MB;V100用的CUDA 10.2,開銷為1351MB。感興趣的同學可以在shell中執行下面這兩行代碼,然后用nvidia-smi去看看自己的環境里context的大小。然后用總大小減去context的大小再做顯存分析。

importtorch temp=torch.tensor([1.0]).cuda()我估計會有人問怎么去減小這個開銷...官方也給了一個辦法,看看自己有哪些cuda依賴是不需要的,比如cuDNN,然后自己重新編譯一遍PyTorch。編譯的時候把對應的包的flag給設為false就好了。我是還沒有試過,要搭編譯的環境太難受了,而且還要經常和庫做更新。

Torch 官方文檔2.2 PyTorch context開銷-----之前沒有提到PyTorch context的開銷,做個補充...我注意到有很多同學在做顯存分析的時候是為了在訓練的時候可以把卡的顯存用滿,這個之前沒有考慮到呢。其實PyTorch context是我們在使用torch的時候的一個大頭開銷。主要參考的是論壇里的這篇討論:How do I create Torch Tensor without any wasted storage space/baggage?https://discuss.pytorch.org/t/how-do-i-create-torch-tensor-without-any-wasted-storage-space-baggage/131134什么是PyTorch context? 其實官方給他的稱呼是CUDA context,就是在第一次執行CUDA操作,也就是使用GPU的時候所需要創建的維護設備間工作的一些相關信息。如下圖所示這個值跟CUDA的版本,pytorch的版本以及所使用的設備都是有關系的。目前我在ubuntu的torch1.9上測過RTX 3090和V100的context 開銷。其中3090用的CUDA 11.4,開銷為1639MB;V100用的CUDA 10.2,開銷為1351MB。感興趣的同學可以在shell中執行下面這兩行代碼,然后用nvidia-smi去看看自己的環境里context的大小。然后用總大小減去context的大小再做顯存分析。

importtorch temp=torch.tensor([1.0]).cuda()我估計會有人問怎么去減小這個開銷...官方也給了一個辦法,看看自己有哪些cuda依賴是不需要的,比如cuDNN,然后自己重新編譯一遍PyTorch。編譯的時候把對應的包的flag給設為false就好了。我是還沒有試過,要搭編譯的環境太難受了,而且還要經常和庫做更新。2.3Torch顯存分配機制

在PyTorch中,顯存是按頁為單位進行分配的,這可能是CUDA設備的限制。就算我們只想申請4字節的顯存,CUDA也會為我們分配512字節或者1024字節的空間。2.4Torch顯存釋放機制

在PyTorch中,只要一個Tensor對象在后續不會再被使用,那么PyTorch就會自動回收該Tensor所占用的顯存,并以緩沖區的形式繼續占用顯存。要是實在看緩沖區不爽的話,也可以用torch.cuda.empty_cache()把它歸零,但是程序速度會變慢哦03 訓練過程顯存分析為了讓大家方便理解,我這里用torch.nn.Linear(1024, 1024, bias=False) 來做例子。為了省事,loss函數則直接對輸出的樣本進行求和得到。沒辦法,想直接執行loss.backward()的話,loss得是標量才行呢。示例代碼: import torch model = torch.nn.Linear(1024,1024, bias=False).cuda() optimizer = torch.optim.AdamW(model.parameters()) inputs = torch.tensor([1.0]*1024).cuda() # shape = (1024) outputs = model(inputs) # shape = (1024) loss = sum(outputs) # shape = (1) loss.backward() optimizer.step()3.1 模型的定義

結論:顯存占用量約為參數量乘以4 import torch model = torch.nn.Linear(1024,1024, bias=False).cuda() print(torch.cuda.memory_allocated())打印出來的數值為4194304,剛好等于1024×1024×4。3.2 前向傳播過程

結論:顯存增加等于每一層模型產生的結果的顯存之和,且跟batch_size成正比。 inputs = torch.tensor([1.0]*1024).cuda() # shape = (1024) memory + 4096 outputs = model(inputs) # memory + 4096代碼中,outputs為產生的中間激活值,同時它也恰好是該模型的輸出結果。在執行完這一步之后,顯存增加了4096字節。(不算inputs的顯存的話)。3.3 后向傳播過程

后向傳播會將模型的中間激活值給消耗并釋放掉掉,并為每一個模型中的參數計算其對應的梯度。在第一次執行的時候,會為模型參數分配對應的用來存儲梯度的空間。 loss = sum(outputs) # memory + 512(torch cuda分配最小單位) temp = torch.cuda.memory_allocated() loss.backward() print(torch.cuda.memory_allocated() - temp) # 第一次增加4194304第一次執行時顯存增加:4194304字節 - 激活值大小;第二次以后執行顯存減少:激活值大小;Note:由于這個中間激活值被賦給了outputs,所以后面在后向傳播的時候會發現,這個outputs的顯存沒有被釋放掉。但是當層數變深的時候,就能明顯看到變化了。為了讓大家看到變化,再寫一段代碼~ import torch # 模型初始化 linear1 = torch.nn.Linear(1024,1024, bias=False).cuda() # + 4194304 print(torch.cuda.memory_allocated()) linear2 = torch.nn.Linear(1024, 1, bias=False).cuda() # + 4096 print(torch.cuda.memory_allocated()) # 輸入定義 inputs = torch.tensor([[1.0]*1024]*1024).cuda() # shape = (1024,1024) # + 4194304 print(torch.cuda.memory_allocated()) # 前向傳播 loss = sum(linear2(linear1(inputs))) # shape = (1) # memory + 4194304 + 512 print(torch.cuda.memory_allocated()) # 后向傳播 loss.backward() # memory - 4194304 + 4194304 + 4096 print(torch.cuda.memory_allocated()) # 再來一次~ loss = sum(linear2(linear1(inputs))) # shape = (1) # memory + 4194304 (512沒了,因為loss的ref還在) print(torch.cuda.memory_allocated()) loss.backward() # memory - 4194304 print(torch.cuda.memory_allocated())3.4 參數更新

optimizer.step()#第一次增加8388608,第二次就不增不減了哦第一次執行時,會為每一個參數初始化其優化器狀態,對于這里的AdamW而言,每一個參數需要4*2=8個字節。第二次開始,不會再額外分配顯存。顯存開銷:第一次: 增加8388608字節第二次及以后: 無增減3.5 Note由于計算機計算的特性,有一些計算操作在計算過程中是會帶來額外的顯存開銷的。但是這種開銷在torch.memory_allocated中是不能被察覺的。比如在AdamW在進行某一層的更新的時候,會帶來2倍該層參數量大小的臨時額外開銷。這個在max_memory_allocated中可以看到。在本例中就是8388608字節。

審核編輯 :李倩

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

神經網絡

+關注

關注

42文章

4812瀏覽量

103340 -

顯存

+關注

關注

0文章

112瀏覽量

13877 -

pytorch

+關注

關注

2文章

809瀏覽量

13899

原文標題:綜述:PyTorch顯存機制分析

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

熱點推薦

大模型推理顯存和計算量估計方法研究

隨著人工智能技術的飛速發展,深度學習大模型在各個領域得到了廣泛應用。然而,大模型的推理過程對顯存和計算資源的需求較高,給實際應用帶來了挑戰。為了解決這一問題,本文將探討大模型推理顯存和計算量的估計

發表于 07-03 19:43

利用Arm Kleidi技術實現PyTorch優化

PyTorch 是一個廣泛應用的開源機器學習 (ML) 庫。近年來,Arm 與合作伙伴通力協作,持續改進 PyTorch 的推理性能。本文將詳細介紹如何利用 Arm Kleidi 技術提升 Arm

PyTorch 2.5.1: Bugs修復版發布

? 一,前言 在深度學習框架的不斷迭代中,PyTorch 社區始終致力于提供更穩定、更高效的工具。最近,PyTorch 2.5.1 版本正式發布,這個版本主要針對 2.5.0 中發現的問題進行了修復

PyTorch 數據加載與處理方法

PyTorch 是一個流行的開源機器學習庫,它提供了強大的工具來構建和訓練深度學習模型。在構建模型之前,一個重要的步驟是加載和處理數據。 1. PyTorch 數據加載基礎 在 PyTorch 中

新手小白怎么通過云服務器跑pytorch?

安裝PyTorch的步驟可以根據不同的操作系統和需求有所差異,通過云服務器運行PyTorch的過程主要包括選擇GPU云服務器平臺、配置服務器環境、部署和運行PyTorch模型、優化性能等步驟。

顯存技術不斷升級,AI計算中如何選擇合適的顯存

電子發燒友網報道(文/李彎彎)顯存,是顯卡上用于存儲圖像數據、紋理、幀緩沖區等的內存。它的大小直接決定了顯卡能夠同時處理的數據量。 ? 在AI計算中,顯存的大小對處理大規模數據集、深度學習模型的訓練

pytorch怎么在pycharm中運行

第一部分:PyTorch和PyCharm的安裝 1.1 安裝PyTorch PyTorch是一個開源的機器學習庫,用于構建和訓練神經網絡。要在PyCharm中使用PyTorch,首先需

pycharm如何調用pytorch

引言 PyTorch是一個開源的機器學習庫,廣泛用于計算機視覺、自然語言處理等領域。PyCharm是一個流行的Python集成開發環境(IDE),提供了代碼編輯、調試、測試等功能。將PyTorch

pytorch環境搭建詳細步驟

PyTorch作為一個廣泛使用的深度學習框架,其環境搭建對于從事機器學習和深度學習研究及開發的人員來說至關重要。以下將介紹PyTorch環境搭建的詳細步驟,包括安裝Anaconda、配置清華鏡像源

PyTorch深度學習開發環境搭建指南

PyTorch作為一種流行的深度學習框架,其開發環境的搭建對于深度學習研究者和開發者來說至關重要。在Windows操作系統上搭建PyTorch環境,需要綜合考慮多個方面,包括軟件安裝、環境配置以及版本兼容性等。以下是一個詳細的PyTor

基于PyTorch的卷積核實例應用

在深度學習和計算機視覺領域,卷積操作是一種至關重要的技術,尤其在圖像處理和特征提取方面發揮著核心作用。PyTorch作為當前最流行的深度學習框架之一,提供了強大的張量操作功能和靈活的API,使得實現

pytorch如何訓練自己的數據

本文將詳細介紹如何使用PyTorch框架來訓練自己的數據。我們將從數據準備、模型構建、訓練過程、評估和測試等方面進行講解。 環境搭建 首先,我們需要安裝PyTorch。可以通過訪問PyTorch官網

pytorch中有神經網絡模型嗎

當然,PyTorch是一個廣泛使用的深度學習框架,它提供了許多預訓練的神經網絡模型。 PyTorch中的神經網絡模型 1. 引言 深度學習是一種基于人工神經網絡的機器學習技術,它在圖像識別、自然語言

PyTorch的介紹與使用案例

PyTorch是一個基于Python的開源機器學習庫,它主要面向深度學習和科學計算領域。PyTorch由Meta Platforms(原Facebook)的人工智能研究團隊開發,并逐漸發展成為深度

評論