在前面的兩文章中,我們研究了如何在主機和設(shè)備之間高效地移動數(shù)據(jù)。在我們的 CUDA C / C ++系列的第六篇文章中,我們將討論如何有效地從內(nèi)核中訪問設(shè)備存儲器,特別是全局內(nèi)存。

在 CUDA 設(shè)備上有幾種內(nèi)存,每種內(nèi)存的作用域、生存期和緩存行為都不同。到目前為止,在本系列中,我們已經(jīng)使用了駐留在設(shè)備 DRAM 中的全局內(nèi)存,用于主機和設(shè)備之間的傳輸,以及內(nèi)核的數(shù)據(jù)輸入和輸出。這里的名稱global是指作用域,因為它可以從主機和設(shè)備訪問和修改。全局內(nèi)存可以像下面代碼片段的第一行那樣使用__device__de Clara 說明符在全局(變量)范圍內(nèi)聲明,或者使用cudaMalloc()動態(tài)分配并分配給一個常規(guī)的 C 指針變量,如第 7 行所示。全局內(nèi)存分配可以在應(yīng)用程序的生命周期內(nèi)保持。根據(jù)設(shè)備的計算能力,全局內(nèi)存可能被緩存在芯片上,也可能不在芯片上緩存。

__device__ int globalArray[256];

void foo()

{

...

int *myDeviceMemory = 0;

cudaError_t result = cudaMalloc(&myDeviceMemory, 256 * sizeof(int));

...

}在討論全局內(nèi)存訪問性能之前,我們需要改進對 CUDA 執(zhí)行模型的理解。我們已經(jīng)討論了如何將線程被分組為線程塊分配給設(shè)備上的多處理器。在執(zhí)行過程中,有一個更精細的線程分組到warps。 GPU 上的多處理器以 SIMD (單指令多數(shù)據(jù))方式為每個扭曲執(zhí)行指令。所有當前支持 CUDA – 的 GPUs 的翹曲尺寸(實際上是 SIMD 寬度)是 32 個線程。

全局內(nèi)存合并

將線程分組為扭曲不僅與計算有關(guān),而且與全局內(nèi)存訪問有關(guān)。設(shè)備coalesces全局內(nèi)存加載并存儲由一個 warp 線程發(fā)出的盡可能少的事務(wù),以最小化 DRAM 帶寬(在計算能力小于 2 . 0 的舊硬件上,事務(wù)合并在 16 個線程的一半扭曲內(nèi),而不是整個扭曲中)。為了弄清楚 CUDA 設(shè)備架構(gòu)中發(fā)生聚結(jié)的條件,我們在三個 Tesla 卡上進行了一些簡單的實驗: a Tesla C870 (計算能力 1 . 0 )、 Tesla C1060 (計算能力 1 . 3 )和 Tesla C2050 (計算能力 2 . 0 )。

我們運行兩個實驗,使用如下代碼(GitHub 上也有)中所示的增量內(nèi)核的變體,一個具有數(shù)組偏移量,這可能導致對輸入數(shù)組的未對齊訪問,另一個是對輸入數(shù)組的跨步訪問。

#include #include // Convenience function for checking CUDA runtime API results // can be wrapped around any runtime API call. No-op in release builds. inline cudaError_t checkCuda(cudaError_t result) { #if defined(DEBUG) || defined(_DEBUG) if (result != cudaSuccess) { fprintf(stderr, "CUDA Runtime Error: %sn", cudaGetErrorString(result)); assert(result == cudaSuccess); } #endif return result; } template __global__ void offset(T* a, int s) { int i = blockDim.x * blockIdx.x + threadIdx.x + s; a[i] = a[i] + 1; } template __global__ void stride(T* a, int s) { int i = (blockDim.x * blockIdx.x + threadIdx.x) * s; a[i] = a[i] + 1; } template void runTest(int deviceId, int nMB) { int blockSize = 256; float ms; T *d_a; cudaEvent_t startEvent, stopEvent; int n = nMB*1024*1024/sizeof(T); // NB: d_a(33*nMB) for stride case checkCuda( cudaMalloc(&d_a, n * 33 * sizeof(T)) ); checkCuda( cudaEventCreate(&startEvent) ); checkCuda( cudaEventCreate(&stopEvent) ); printf("Offset, Bandwidth (GB/s):n"); offset<<>>(d_a, 0); // warm up for (int i = 0; i <= 32; i++) { checkCuda( cudaMemset(d_a, 0.0, n * sizeof(T)) ); checkCuda( cudaEventRecord(startEvent,0) ); offset<<>>(d_a, i); checkCuda( cudaEventRecord(stopEvent,0) ); checkCuda( cudaEventSynchronize(stopEvent) ); checkCuda( cudaEventElapsedTime(&ms, startEvent, stopEvent) ); printf("%d, %fn", i, 2*nMB/ms); } printf("n"); printf("Stride, Bandwidth (GB/s):n"); stride<<>>(d_a, 1); // warm up for (int i = 1; i <= 32; i++) { checkCuda( cudaMemset(d_a, 0.0, n * sizeof(T)) ); checkCuda( cudaEventRecord(startEvent,0) ); stride<<>>(d_a, i); checkCuda( cudaEventRecord(stopEvent,0) ); checkCuda( cudaEventSynchronize(stopEvent) ); checkCuda( cudaEventElapsedTime(&ms, startEvent, stopEvent) ); printf("%d, %fn", i, 2*nMB/ms); } checkCuda( cudaEventDestroy(startEvent) ); checkCuda( cudaEventDestroy(stopEvent) ); cudaFree(d_a); } int main(int argc, char **argv) { int nMB = 4; int deviceId = 0; bool bFp64 = false; for (int i = 1; i < argc; i++) { if (!strncmp(argv[i], "dev=", 4)) deviceId = atoi((char*)(&argv[i][4])); else if (!strcmp(argv[i], "fp64")) bFp64 = true; } cudaDeviceProp prop; checkCuda( cudaSetDevice(deviceId) ) ; checkCuda( cudaGetDeviceProperties(&prop, deviceId) ); printf("Device: %sn", prop.name); printf("Transfer size (MB): %dn", nMB); printf("%s Precisionn", bFp64 ? "Double" : "Single"); if (bFp64) runTest(deviceId, nMB); else runTest(deviceId, nMB);?

}此代碼可以通過傳遞“ fp64 ”命令行選項以單精度(默認值)或雙精度運行偏移量內(nèi)核和跨步內(nèi)核。每個內(nèi)核接受兩個參數(shù),一個輸入數(shù)組和一個表示訪問數(shù)組元素的偏移量或步長的整數(shù)。內(nèi)核在一系列偏移和跨距的循環(huán)中被稱為。

未對齊的數(shù)據(jù)訪問

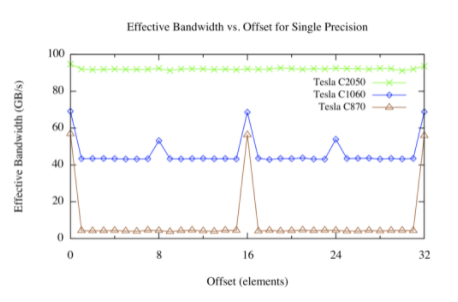

下圖顯示了 Tesla C870 、 C1060 和 C2050 上的偏移內(nèi)核的結(jié)果。

設(shè)備內(nèi)存中分配的數(shù)組由 CUDA 驅(qū)動程序與 256 字節(jié)內(nèi)存段對齊。該設(shè)備可以通過 32 字節(jié)、 64 字節(jié)或 128 字節(jié)的事務(wù)來訪問全局內(nèi)存。對于 C870 或計算能力為 1 . 0 的任何其他設(shè)備,半線程的任何未對齊訪問(或半扭曲線程不按順序訪問內(nèi)存的對齊訪問)將導致 16 個獨立的 32 字節(jié)事務(wù)。由于每個 32 字節(jié)事務(wù)只請求 4 個字節(jié),因此可以預(yù)期有效帶寬將減少 8 倍,這與上圖(棕色線)中看到的偏移量(不是 16 個元素的倍數(shù))大致相同,對應(yīng)于線程的一半扭曲。

對于計算能力為 1 . 2 或 1 . 3 的 Tesla C1060 或其他設(shè)備,未對準訪問的問題較少。基本上,通過半個線程對連續(xù)數(shù)據(jù)的未對齊訪問在幾個“覆蓋”請求的數(shù)據(jù)的事務(wù)中提供服務(wù)。由于未請求的數(shù)據(jù)正在傳輸,以及不同的半翹曲所請求的數(shù)據(jù)有些重疊,因此相對于對齊的情況仍然存在性能損失,但是這種損失遠遠小于 C870 。

計算能力為 2 . 0 的設(shè)備,如 Tesla C250 ,在每個多處理器中都有一個 L1 緩存,其行大小為 128 字節(jié)。該設(shè)備將線程的訪問合并到盡可能少的緩存線中,從而導致對齊對跨線程順序內(nèi)存訪問吞吐量的影響可以忽略不計。

快速內(nèi)存訪問

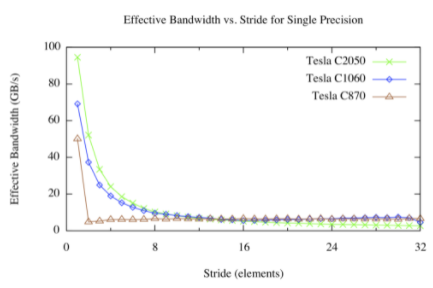

步幅內(nèi)核的結(jié)果如下圖所示。

對于快速的全局內(nèi)存訪問,我們有不同的看法。對于大步進,無論架構(gòu)版本如何,有效帶寬都很差。這并不奇怪:當并發(fā)線程同時訪問物理內(nèi)存中相距很遠的內(nèi)存地址時,硬件就沒有機會合并這些訪問。從上圖中可以看出,在 Tesla C870 上,除 1 以外的任何步幅都會導致有效帶寬大幅降低。這是因為 compute capability 1 . 0 和 1 . 1 硬件需要跨線程進行線性、對齊的訪問以進行合并,因此我們在 offset 內(nèi)核中看到了熟悉的 1 / 8 帶寬。 Compute capability 1 . 2 及更高版本的硬件可以將訪問合并為對齊的段( CC 1 . 2 / 1 . 3 上為 32 、 64 或 128 字節(jié)段,在 CC 2 . 0 及更高版本上為 128 字節(jié)緩存線),因此該硬件可以產(chǎn)生平滑的帶寬曲線。

當訪問多維數(shù)組時,線程通常需要索引數(shù)組的更高維,因此快速訪問是不可避免的。我們可以使用一種名為共享內(nèi)存的 CUDA 內(nèi)存來處理這些情況。共享內(nèi)存是一個線程塊中所有線程共享的片上內(nèi)存。共享內(nèi)存的一個用途是將多維數(shù)組的 2D 塊以合并的方式從全局內(nèi)存提取到共享內(nèi)存中,然后讓連續(xù)的線程跨過共享內(nèi)存塊。與全局內(nèi)存不同,對共享內(nèi)存的快速訪問沒有懲罰。我們將在下一篇文章中詳細介紹共享內(nèi)存。

概括

在這篇文章中,我們討論了如何從 CUDA 內(nèi)核代碼中有效地訪問全局內(nèi)存的一些方面。設(shè)備上的全局內(nèi)存訪問與主機上的數(shù)據(jù)訪問具有相同的性能特征,即數(shù)據(jù)局部性非常重要。在早期的 CUDA 硬件中,內(nèi)存訪問對齊和跨線程的局部性一樣重要,但在最近的硬件上,對齊并不是什么大問題。另一方面,快速的內(nèi)存訪問會損害性能,使用片上共享內(nèi)存可以減輕這種影響。在下一篇文章中,我們將詳細探討共享內(nèi)存,之后的文章中,我們將展示如何使用共享內(nèi)存來避免在矩陣轉(zhuǎn)置過程中出現(xiàn)跨步全局內(nèi)存訪問。

關(guān)于作者

Mark Harris 是 NVIDIA 杰出的工程師,致力于 RAPIDS 。 Mark 擁有超過 20 年的 GPUs 軟件開發(fā)經(jīng)驗,從圖形和游戲到基于物理的模擬,到并行算法和高性能計算。當他還是北卡羅來納大學的博士生時,他意識到了一種新生的趨勢,并為此創(chuàng)造了一個名字: GPGPU (圖形處理單元上的通用計算)。

審核編輯:郭婷

-

存儲器

+關(guān)注

關(guān)注

38文章

7653瀏覽量

167576 -

NVIDIA

+關(guān)注

關(guān)注

14文章

5315瀏覽量

106531

發(fā)布評論請先 登錄

請問STM32MP257中CM33內(nèi)核能否訪問以太網(wǎng)口Ethernet?

請問STM32MP257中CM33內(nèi)核能否訪問以太網(wǎng)口Ethernet?

請問STM32MP257中CM33內(nèi)核能否訪問以太網(wǎng)口Ethernet?

Linux系統(tǒng)中通過預(yù)留物理內(nèi)存實現(xiàn)ARM與FPGA高效通信的方法

如何在Linux內(nèi)核5.18版本之后和64位架構(gòu)中從內(nèi)核空間調(diào)用ioctl?

嵌入式學習-飛凌嵌入式ElfBoard ELF 1板卡-內(nèi)核空間與用戶空間的數(shù)據(jù)拷貝之數(shù)據(jù)拷貝介紹

飛凌嵌入式ElfBoard ELF 1板卡-內(nèi)核空間與用戶空間的數(shù)據(jù)拷貝之數(shù)據(jù)拷貝介紹

如何有效地提高傳感器的測試精度

如何有效地安裝孔隙水壓力計

如何使用內(nèi)存加速存儲訪問速度

嵌入式工程師都在找的【Linux內(nèi)核調(diào)試技術(shù)】建議收藏!

內(nèi)存管理的硬件結(jié)構(gòu)

評論