一般情況下,遙感目標檢測中,遙感圖像的圖片尺寸都會很大,且圖像中元素極為復雜,近期開賽的亞馬遜云科技【AI For Good - 2022 遙感光學影像目標檢測挑戰賽】也不例外,動輒超過10000 x 10000的衛星遙感圖像讓許多選手感到頭疼。同時遙感影像中目標尺寸差別大、小而密集、角度各異也導致常見的CV框架難以實現快速精準的目標識別。所以,如何實現遙感圖像等超大尺寸圖像快速識別?

目前比較成熟的衛星圖像識別算法并不少,但大多依托于強大的計算資源,為了用有限的計算資源實現大尺寸圖像識別,我們找到了一個可行的開源框架,給大尺寸圖像識別提供了不錯的思路。

YOLT 是一個基于YOLO v2的衛星圖像識別開源算法,核心思路是:

1. 通過圖片裁切和圖像網絡重構解決圖像尺寸問題;

2. 通過“上采樣”提升小而聚集的目標的檢測精度;

3. 通過將不同尺寸模型融合,提升整體檢測精度。

YOLT項目地址:GitHub - avanetten/yolt: You Only Look Twice: Rapid Multi-Scale Object Detection In Satellite Imagery

YOLO是經典的圖像識別算法,YOLT在YOLO的基礎上針對衛星圖像特有的問題提出了特定的解決思路。詳細思路參見論文「You Only Look Twice: Rapid Multi-Scale Object Detection In Satellite Imagery」(GitHub項目中附有論文鏈接)。

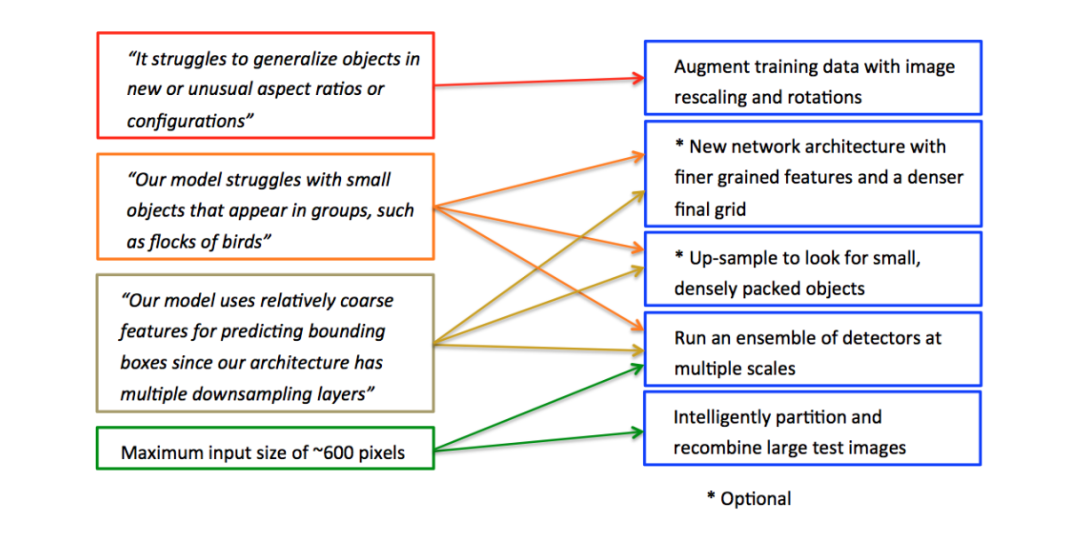

▲左側為常見問題,右側為解決辦法

1. 針對物體尺寸不規則、方向多樣的問題,YOLT對衛星圖像數據進行尺寸變換與旋轉等數據增強的處理。

2. 針對目標尺寸過小并聚集的問題,YOLT框架主要采用3種方式進行處理:

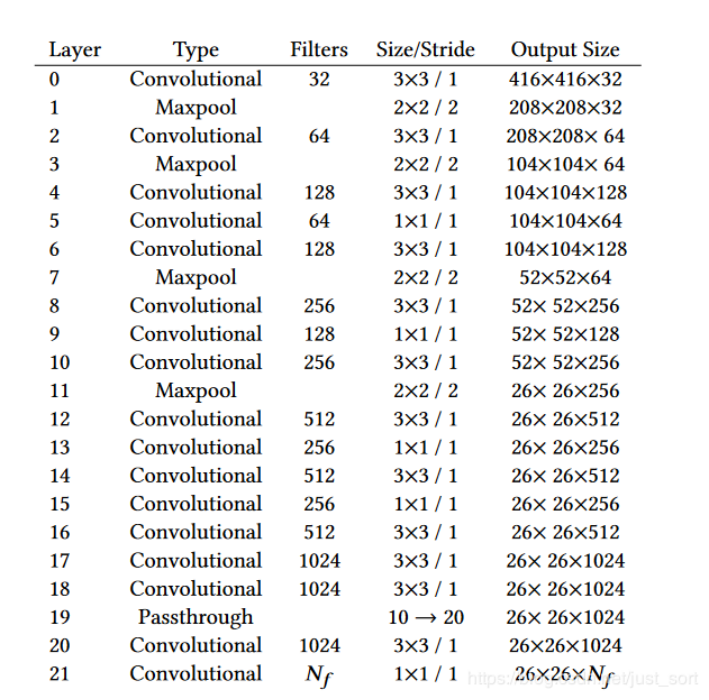

(1) 修改圖像網絡結構,將YOLO v2框架中的stride由32改為16,有利于檢測出大小在32 x 32以下的目標

(2) 對圖像進行上采樣,完成圖片的“解壓縮”操作,即把原先的圖片放大,以便檢測小而密集的物體

(3) 將不同尺寸的檢測模型進行融合,即Ensemble操作,由于不同目標的尺寸差異可能較大,如海港與船只、機場與飛機,Ensemble操作能夠提升大尺寸差異下的識別精度。

針對衛星圖像尺寸過大的問題,YOLT采用切塊的方式,將原始圖像切割成小塊后輸入模型進行訓練,并結合2-(3)進行模型融合。

▲ YOLT的網絡結構,輸出特征尺寸多為26 x 26,可以提升檢測精度

應用實例

從下面的檢測實例中,我們可以看到YOLT是如何工作的:

首先,開發團隊將一張衛星圖片調整至416 x 416大小(如上左),發現無法檢測出車輛目標;而從原圖中切割出416 x 416的區域(稱其為Chips)則可以實現部分車輛目標的檢測。

順著這個思路,開發團隊采用劃窗方式將原始圖像切割為許多chips,并使相鄰chips之間有一定重合(如上圖),以確保圖像檢測的完整性。再利用NMS算法將重復檢測過濾,最后將各塊的檢測結果進行融合,即可得出最后的結果。

▲ 檢測實例:采用YOLT v4識別機場中的飛機

YOLT的思路不止可以應用于衛星圖像識別,同樣可以在目標尺寸小且密集的其他類圖像識別問題中發揮作用。

對本次亞馬遜【AI For Good - 2022 遙感光學影像目標檢測挑戰賽】的選手而言,YOLT的解決思路能夠幫助大家越過圖片尺寸過大的第一道坎。

原文標題:如何實現超大尺寸圖像快速識別

文章出處:【微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

-

衛星

+關注

關注

18文章

1716瀏覽量

67092 -

模型

+關注

關注

1文章

3254瀏覽量

48878 -

遙感圖像

+關注

關注

0文章

40瀏覽量

10130

原文標題:如何實現超大尺寸圖像快速識別

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

如何實現遙感圖像等超大尺寸圖像快速識別

如何實現遙感圖像等超大尺寸圖像快速識別

評論