首先,對 AI 的幾點看法:用詞不當!人工智能既不是人工的,也不是智能的。如果沒有大量的人類訓練,人工智能就無法識別事物。人工智能在物體或場景的識別、理解和分類方面表現出與人類完全不同的邏輯。該標簽暗示人工智能類似于人類智能。

不是這樣。

人工智能通常缺乏常識,很容易被愚弄或破壞,并且可能以意想不到和不可預測的方式失敗。換句話說——謹慎行事。

本專欄探討人工智能技術如何影響汽車行業。我們將考慮這些問題:

人工智能如何解決問題?

人工智能在汽車中的優點和缺點是什么?

在汽車中使用人工智能有哪些獨特的挑戰?

哪些汽車電子領域正在使用人工智能?

未來哪些汽車電子領域將依賴人工智能技術?

AI 開發分為三個階段:構建 AI 模型,使用相關數據訓練 AI 模型,最后使用訓練好的模型解決問題,即推理階段。

大多數 AI 模型都基于多個版本的神經網絡和學習網絡。示例包括卷積神經網絡、生成對抗網絡、深度強化學習、聯邦學習、遷移學習等。每個都有不同的優點和缺點。一切都在迅速發展。

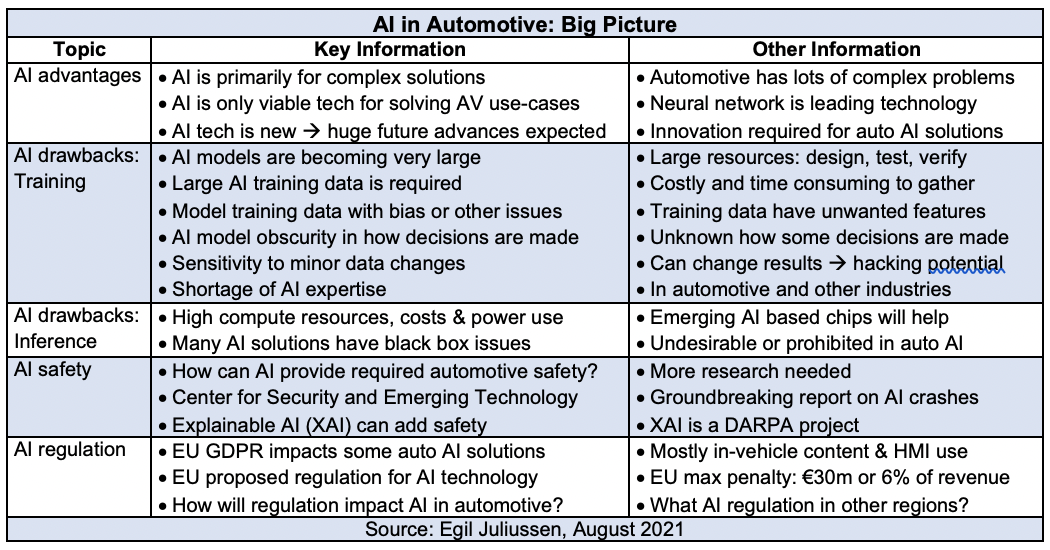

下表總結了人工智能技術的優缺點以及安全考慮和擬議法規。

點擊查看完整大小的圖片

人工智能優勢

人工智能主要用于解決復雜的問題。由于汽車行業存在許多難題,人工智能在推進汽車技術方面發揮著越來越重要的作用。部署自動駕駛汽車的承諾主要取決于新的人工智能技術。似乎幾乎達成共識,神經網絡的進步是實現未來 AV 部署成功的主要方法。

好消息是人工智能,尤其是神經網絡技術還處于研發階段。這意味著未來的進步將領先于預期的突破性創新。隨著全球范圍內持續廣泛的人工智能投資,人工智能和神經網絡將解決許多更復雜的問題,包括汽車行業的挑戰,這是一個不錯的選擇。

人工智能的缺點

開發和部署人工智能技術的挑戰之一是對神經網絡的充分訓練。一般來說,問題越復雜,神經網絡模型就必須越復雜。這意味著大型模型。培訓需要大量資源和專業知識來設計和測試依賴大型數據集的 AI 模型,以驗證模型是否像宣傳的那樣工作。

AI 模型需要大量訓練,這意味著需要獲取大型數據庫。更大的訓練數據集變得可用,但訓練仍然是一項耗時且昂貴的任務。大多數訓練數據也必須由人類標記,以使 AI 模型能夠學習并變得熟練。人們越來越擔心偏見正在蔓延到訓練數據中。

然后是黑盒問題:仍然很難確定 AI 模型如何做出決策。對于自治系統來說,這種模糊性仍然是一個大問題。需要更好的解決方案。

另一個問題涉及模型對微小數據變化的敏感性。該漏洞引發了安全問題,包括入侵自主系統的可能性以及由此產生的對 AV 安全的威脅。

缺乏人工智能專業知識是汽車和其他行業的另一個重大缺陷,這種技能差距不太可能很快得到彌補。

解決問題的推理階段也有缺點。大型模型,尤其是 AV 模型,需要巨大的計算資源來處理傳感器數據并支持復雜的軟件。這些資源還需要電力,這在汽車應用中總是有限的。

新興技術將提高能力并降低推理成本,包括新興的人工智能芯片技術、激光雷達價格的下降和傳感器性能的提高。

推理的最大缺點是黑盒問題或 AI 可解釋性。人工智能系統仍然無法解釋它們是如何做出決策的,從而產生了許多人工智能信任問題。對于汽車應用來說,這是行不通的。(我將在以后的專欄中探討有關 AI 可解釋性的問題。)

人工智能安全

與其他消費領域相比,汽車 AI 需要更高的安全性。因此,必須更加重視人工智能安全和研發。為此,喬治城大學安全與新興技術中心 (CSET) 發布了一份開創性報告,研究了人工智能的意外后果和潛在影響。

CSET 報告確定了三種基本類型的 AI 故障——穩健性、規范和保證故障。魯棒性故障意味著人工智能系統接收到異常或意外的輸入,導致它們發生故障。在規范失敗中,人工智能系統試圖實現與設計者的意圖略有不同的東西,從而導致意想不到的行為或副作用。保證失敗意味著人工智能系統在運行過程中無法得到充分的監控或控制

7 月份發布的報告包含了 AI 意外崩潰的示例(作者更喜歡“意外”一詞),并建議采取措施降低風險,同時使 AI 工具更值得信賴。

可解釋的 AI,即 XAI,是一種減輕黑盒效應的方法,可以更好地了解提高模型準確性所需的數據。由國防高級研究計劃局贊助的 XAI 研究旨在開發機器學習技術,以產生更多可解釋的模型,同時保持高水平的學習性能和準確性。XAI 還將使人類用戶能夠理解、信任和管理 AI 模型。XAI 還可以表征其自身的能力并提供對其未來行為的洞察。

人工智能監管

人工智能和通用數據保護條例密切相關。GDPR 影響歐洲和其他地區的人工智能發展。該法規明確涵蓋了自動化的個人決策和分析。該規則保護消費者免受兩者的法律后果。在這種情況下,自動化的個人決策包括人工智能平臺在沒有任何人工干預的情況下做出的決策。剖析是指自動處理個人數據以評估個人。

對于汽車應用,這主要影響內容交付系統和用戶界面。

歐盟正在準備一項類似于 GDPR 的 AI 法規,這一新規則的影響可能與 GDPR 一樣廣泛。代表監管人工智能的法律框架的提案草案于 4 月發布。

歐盟提案旨在確定高風險人工智能技術及其針對可能危及公民的交通等關鍵基礎設施的應用。這意味著自動駕駛汽車將成為人工智能監管的目標。

根據歐盟提議的人工智能立法,罰款可能高達 3000 萬歐元,或公司全球收入的 6%,以較高者為準。GDPR 規定的最高罰款為 2000 萬歐元,即全球收入的 4%。

汽車人工智能

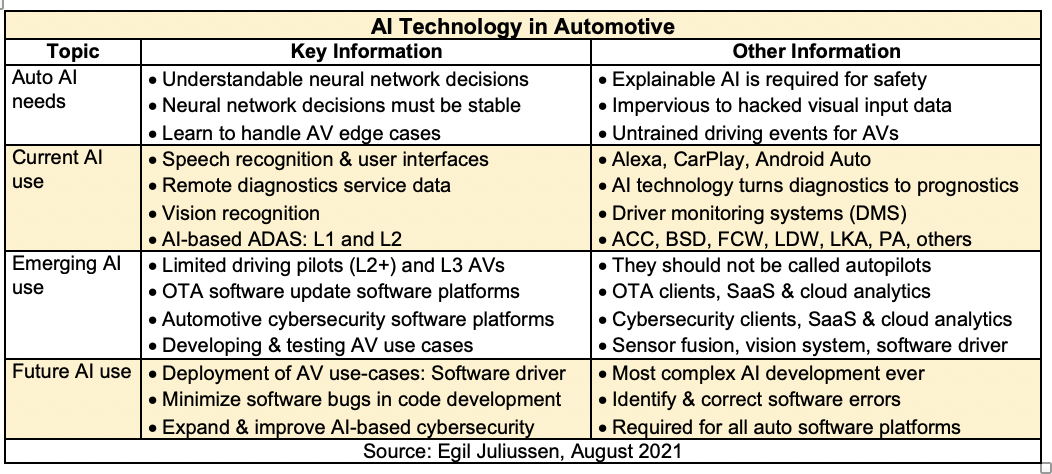

下表總結了與汽車電子集成的人工智能技術。不包括用于汽車制造、供應鏈管理、質量控制、營銷和人工智能做出重大貢獻的類似功能的人工智能。

點擊查看完整大小的圖片

神經網絡產生的決策必須是可以理解的。如果不是這樣,就很難理解它們是如何工作的并糾正錯誤或偏見。

神經網絡的決策也必須是穩定的——也就是說,盡管視覺數據存在微小差異,但仍保持不變。這對于 AV 尤其重要。停車標志上的小條黑白膠帶可以使它們對基于人工智能的視覺系統不可見。這是不可接受的神經網絡性能的一個例子。

AV 應用程序需要更好的技術來了解以前的軟件駕駛員培訓沒有經歷過的邊緣案例或新的駕駛事件。這仍然是大規模部署 AV 系統的關鍵限制因素。

當前的人工智能使用

語音識別和用戶界面一直是汽車領域最成功的基于人工智能的應用。這些應用程序利用智能手機和消費電子產品中使用的人工智能技術部署在信息娛樂和人機界面中。Alexa、CarPlay、Android Auto 和類似產品已在大多數新車型和車型更新中引入。

遠程診斷是領先的遠程信息處理應用程序。例如,添加人工智能技術可以幫助預測未來的設備故障。

基于人工智能的視覺系統用于配備 ADAS 的汽車的駕駛員監控系統。隨著人工智能技術的改進,DMS 有望實現快速增長。

許多 ADAS 功能也使用 AI 技術,包括自適應巡航控制到多個版本的停車輔助。L1 和 L2 ADAS 車輛將在新車型中使用越來越多的 AI 技術。

新興的人工智能使用

多家原始設備制造商正在涌現有限的駕駛飛行員。它們通常稱為 L2+,但該術語不包含在當前標準中。稱它們為自動駕駛儀是一個錯誤,因為它使消費者感到困惑,并暗示了比現有更多的能力。他們已經造成了崩潰。

L3 車輛已經面世多年,但由于監管限制,部署受到限制。允許 L3 AV 的法規正在出現,L3 車輛使用大量 AI 技術。

OTA 軟件和網絡安全功能都通過嵌入式軟件客戶端以及基于云的服務和分析軟件添加 AI 技術。

一個新興的 AI 應用是針對多個AV 用例的自動駕駛汽車開發和測試。大約 5,000 輛自動駕駛汽車處于測試或試點模式,主要在中國和美國。它們包括貨物自動駕駛汽車、自動駕駛卡車、機器人出租車和固定路線自動駕駛汽車。

未來的人工智能使用

AV 用例是 AI 技術最有價值和最困難的應用。我們的目標是開發出比最好的人類驅動程序更好的軟件驅動程序,并且沒有人類行為的任何缺點。

基于人工智能的技術改進的軟件開發已經成熟。通過創新的人工智能技術,識別和修復軟件錯誤可能會在未來十年發生。

審核編輯 黃昊宇

-

AI

+關注

關注

87文章

30728瀏覽量

268892 -

人工智能

+關注

關注

1791文章

47183瀏覽量

238266 -

汽車

+關注

關注

13文章

3493瀏覽量

37253

發布評論請先 登錄

相關推薦

嵌入式和人工智能究竟是什么關系?

智能制造在汽車行業的應用

Orin芯片在汽車行業的應用

對話華為大咖,探討油氣行業數字化轉型和人工智能技術的應用與實踐

AI for Science:人工智能驅動科學創新》第4章-AI與生命科學讀后感

《AI for Science:人工智能驅動科學創新》第一章人工智能驅動的科學創新學習心得

電動汽車與智能化浪潮:重塑汽車行業的未來圖景

Modbus轉Profibus網關在汽車行業的應用

行業案例:這些新能源汽車行業廠商,都在用agv叉車降本增效

人工智能技術如何影響汽車行業

人工智能技術如何影響汽車行業

評論