導(dǎo)讀】在CVPR 2022 ActivityNet: Tiny Actions Challenge賽道中,中國(guó)科學(xué)院深圳先進(jìn)技術(shù)研究院多媒體中心在低分辨率視頻行為識(shí)別任務(wù)的解決方案獲得冠軍。

安防監(jiān)控是智慧城市的重要組成部分。然而,在城市監(jiān)控場(chǎng)景下,行人目標(biāo)往往距離攝像頭遠(yuǎn),所占像素小,這為理解目標(biāo)的行為帶來(lái)了很大挑戰(zhàn)。

為此,CVPR 2022 ActivityNet: Tiny Actions Challenge引入了TinyVIRAT低分辨率行為識(shí)別視頻數(shù)據(jù)集。該數(shù)據(jù)集從監(jiān)控?cái)z像頭上截取視頻,沒(méi)有包含任何人為的下采樣和降質(zhì)處理,填補(bǔ)了真實(shí)場(chǎng)景下的低分辨率行為識(shí)別數(shù)據(jù)的空白。

TinyVIRAT數(shù)據(jù)集共有訓(xùn)練數(shù)據(jù)16950個(gè)、驗(yàn)證數(shù)據(jù)3308個(gè)、測(cè)試數(shù)據(jù)6097個(gè),平均每個(gè)視頻數(shù)據(jù)長(zhǎng)度在3秒左右。

這些低分辨視頻數(shù)據(jù)的分辨率從10x10像素到128x128像素不等,一共包含26種行為標(biāo)簽,包含人體動(dòng)作和汽車等交通工具行駛相關(guān)的類別[4]。

圖1 TinyVIRAT低分辨行為識(shí)別數(shù)據(jù)集示例

這個(gè)數(shù)據(jù)集存在兩個(gè)主要的識(shí)別難點(diǎn):

目標(biāo)離攝像頭的距離很遠(yuǎn),分辨率很低,行為細(xì)節(jié)模糊;

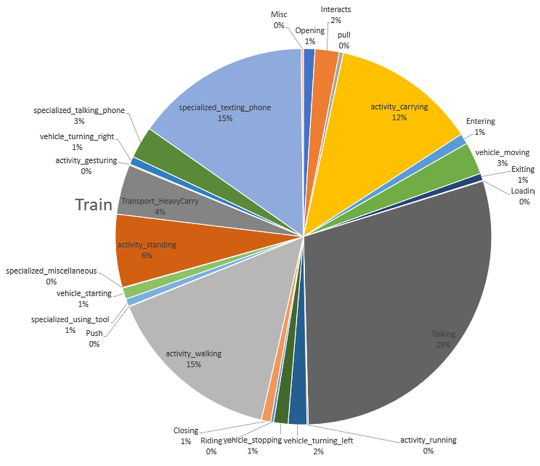

數(shù)據(jù)集呈現(xiàn)嚴(yán)重的類別不平衡現(xiàn)象。圖2展示了TinyVIRAT訓(xùn)練集的樣本比例分布。

圖2 TinyVIRAT訓(xùn)練集樣本分布比例圖

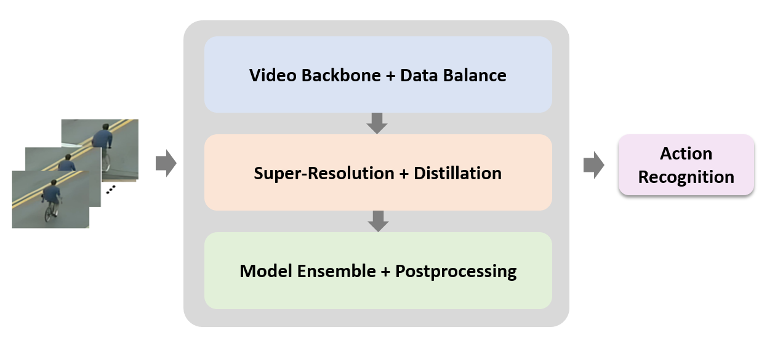

為了解決上述問(wèn)題,我們采用了如圖3所示識(shí)別流程:

通過(guò)精選識(shí)別骨干網(wǎng)絡(luò)并進(jìn)行數(shù)據(jù)增強(qiáng)和平衡來(lái)減輕數(shù)據(jù)集的過(guò)擬合;

設(shè)計(jì)了高低分雙模態(tài)行為識(shí)別框架,通過(guò)高分辨率識(shí)別網(wǎng)絡(luò)的知識(shí)指導(dǎo)低分辨率行為識(shí)別網(wǎng)絡(luò)的訓(xùn)練;

進(jìn)行模型融合和后處理應(yīng)對(duì)數(shù)據(jù)集的類別不均衡現(xiàn)象。

圖3 低分辨率行為識(shí)別方案流程圖

骨干網(wǎng)絡(luò)選擇和數(shù)據(jù)增強(qiáng)

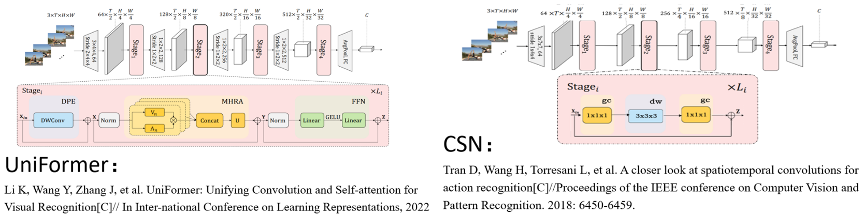

本方案中,我們選用魯棒高效的視頻表征模型ir-CSN-ResNet[1]和 Uniformer-Base[2]作為骨干網(wǎng)絡(luò)。這兩個(gè)網(wǎng)絡(luò)都包含時(shí)空建模的輕量化設(shè)計(jì),在TinyVIRAT數(shù)據(jù)集上的識(shí)別結(jié)果較好,過(guò)擬合程度較低。

圖4 Uniformer/CSN 行為識(shí)別網(wǎng)絡(luò)結(jié)構(gòu)示意圖

由于本數(shù)據(jù)集是真實(shí)場(chǎng)景下的低分辨率數(shù)據(jù)集,直接使用這兩種網(wǎng)絡(luò)效果并不是很好,需要進(jìn)行額外的參數(shù)設(shè)置。在訓(xùn)練和測(cè)試的過(guò)程中,我們把每個(gè)視頻平均分成16份,在每一份隨機(jī)選擇一幀得到視頻采樣數(shù)據(jù)。

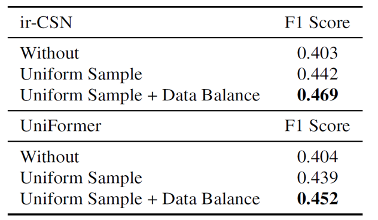

為了緩解數(shù)據(jù)集類別不平衡的現(xiàn)象,我們選出了訓(xùn)練集中的長(zhǎng)尾類別數(shù)據(jù),把它們進(jìn)行水平翻轉(zhuǎn)擴(kuò)充數(shù)據(jù)量。如表1所示,這兩種額外設(shè)置提升了Baseline結(jié)果。

表1 視頻骨干網(wǎng)絡(luò)和主要訓(xùn)練設(shè)定實(shí)驗(yàn)結(jié)果

高低分雙模態(tài)行為識(shí)別框架

如上所述,TinyVIRAT這個(gè)低分辨率數(shù)據(jù)集常常無(wú)法清晰的顯示行為主體的動(dòng)作細(xì)節(jié)。

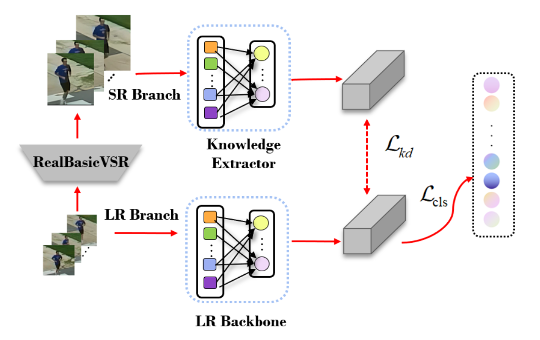

為了降低數(shù)據(jù)的噪聲,增強(qiáng)部分動(dòng)作細(xì)節(jié),我們提出一種高低分雙模態(tài)模型蒸餾訓(xùn)練框架,該框架以高分辨率視頻知識(shí)作為引導(dǎo),提升低分辨率目標(biāo)行為的識(shí)別精度。訓(xùn)練框架流程圖如圖5所示:

圖5 高低分雙模態(tài)模型蒸餾訓(xùn)練框架

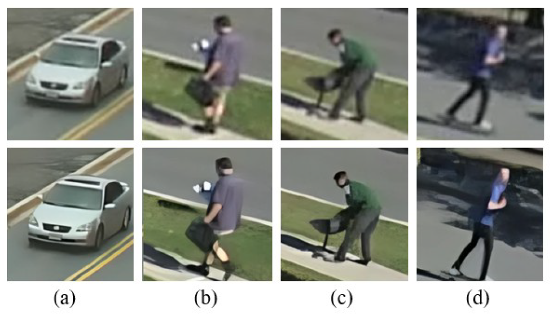

首先,我們應(yīng)用預(yù)訓(xùn)練的RealBasicVSR[3]視頻超分辨率模型,將低分辨率視頻轉(zhuǎn)化成分辨率較高、動(dòng)作細(xì)節(jié)較為清晰的訓(xùn)練數(shù)據(jù),如圖6所示。以這些視頻為基礎(chǔ),我們可以訓(xùn)練高分辨率視頻的特征提取網(wǎng)絡(luò)。

圖6 超分辨率數(shù)據(jù)和源數(shù)據(jù)對(duì)比圖

第二,對(duì)每一個(gè)低分辨率訓(xùn)練視頻,我們把它相對(duì)應(yīng)的高分辨率視頻送到高分辨率特征提取模型中,得到高分辨率分支的類別預(yù)測(cè)分?jǐn)?shù)(圖5上方分支)。同時(shí),我們也把原有的低分辨視頻送到低分辨率分支(圖5下方分支),得到相應(yīng)的類別預(yù)測(cè)分?jǐn)?shù)。

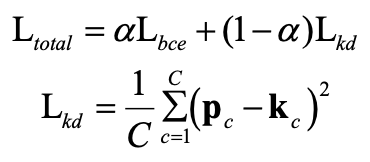

第三,我們使用兩種監(jiān)督信號(hào)進(jìn)行模型訓(xùn)練,使得高分辨率網(wǎng)絡(luò)的知識(shí)能夠指導(dǎo)低分辨率模型的學(xué)習(xí)。損失函數(shù)如式所示:

指的是知識(shí)蒸餾損失(例如MSE損失),p代表低分辨率分支的預(yù)測(cè)向量,k代表高分辨率分支得到的額外知識(shí)。

指的是知識(shí)蒸餾損失(例如MSE損失),p代表低分辨率分支的預(yù)測(cè)向量,k代表高分辨率分支得到的額外知識(shí)。 是預(yù)測(cè)向量和真實(shí)標(biāo)簽的交叉熵?fù)p失。

是預(yù)測(cè)向量和真實(shí)標(biāo)簽的交叉熵?fù)p失。

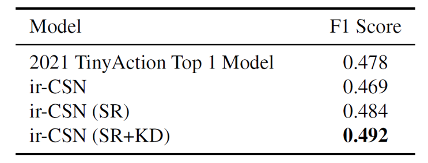

消融實(shí)驗(yàn)結(jié)果如表2所示。表中2021 TinyAction Top1 Model指的是2021年ActivityNet Tiny Actions Challenge的最佳團(tuán)隊(duì)模型[4],它在TinyVIRAT數(shù)據(jù)集上的識(shí)別F1 Score為0.478。

表中ir-CSN表示用低分辨率數(shù)據(jù)直接訓(xùn)練得到的模型,ir-CSN(SR)表示用超分辨率后的數(shù)據(jù)訓(xùn)練得到模型,ir-CSN(SR+KD)指的是用高低分雙模態(tài)模型蒸餾機(jī)制訓(xùn)練得到的模型。ir-CSN(SR+KD)模型取得了最佳的提交結(jié)果,在單模型上比去年的最佳方案提升了1.4%。

表2 高低分雙模態(tài)蒸餾框架消融實(shí)驗(yàn)結(jié)果

后處理與模型融合

該數(shù)據(jù)集的長(zhǎng)尾效應(yīng)比較嚴(yán)重。為此,我們?cè)O(shè)計(jì)后處理與模型融合方案,進(jìn)一步提升長(zhǎng)尾類別的識(shí)別準(zhǔn)確率。

第一,我們發(fā)現(xiàn),訓(xùn)練初期得到的模型在長(zhǎng)尾類別的識(shí)別上比經(jīng)過(guò)充分訓(xùn)練的模型效果好。因此,對(duì)于每一個(gè)網(wǎng)路結(jié)構(gòu),我們會(huì)選用多個(gè)不同訓(xùn)練階段的模型。經(jīng)過(guò)大量消融實(shí)驗(yàn)和提交,我們最終選用12個(gè)模型進(jìn)行融合。

第二,為了進(jìn)一步提高F1-Score,我們?yōu)樗械淖R(shí)別類別設(shè)定識(shí)別閾值。樣本數(shù)目大的類別應(yīng)用較大的閾值,長(zhǎng)尾類別設(shè)定較小的閾值。

最后,我們采用類別的先驗(yàn)知識(shí)輔助模型融合,進(jìn)一步提升長(zhǎng)尾類別的識(shí)別精度。例如,我們借鑒2021年DeepBlue AI冠軍團(tuán)隊(duì)的后處理方法[4],利用互斥標(biāo)簽輔助判定。假設(shè)texting_phone和talking_phone兩種互斥類別的預(yù)測(cè)分?jǐn)?shù)都高過(guò)設(shè)定閾值,只選擇預(yù)測(cè)分?jǐn)?shù)較高的那個(gè)類。

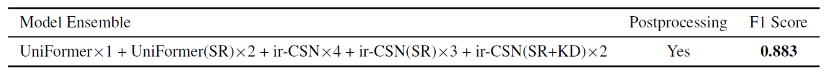

經(jīng)過(guò)模型融合與后處理,我們最終取得0.883的F1 Score,如表3所示。在榜單上排名第1。

表3 模型融合和后處理最終結(jié)果

實(shí)驗(yàn)總結(jié)與展望

本方案中,我們重點(diǎn)解決真實(shí)監(jiān)控場(chǎng)景下的低分辨率行為識(shí)別,主要的方案總結(jié)為以下三點(diǎn):

選擇了魯棒高效的行為識(shí)別骨干網(wǎng)絡(luò),對(duì)長(zhǎng)尾數(shù)據(jù)進(jìn)行平衡和增強(qiáng);

提出了高低分雙模態(tài)行為識(shí)別訓(xùn)練框架,用超分辨率網(wǎng)絡(luò)知識(shí)指導(dǎo)低分辨率行為識(shí)別;

設(shè)計(jì)面向長(zhǎng)尾類別的模型融合和后處理方案。

關(guān)于低分辨率行為識(shí)別相關(guān)技術(shù)的應(yīng)用范圍較為廣泛。在視頻輔助裁判方面,該技術(shù)對(duì)真實(shí)情況下分辨率較低的場(chǎng)景具有一定的數(shù)據(jù)增強(qiáng)和識(shí)別能力,可以輔助判斷一些離攝像機(jī)很遠(yuǎn)的動(dòng)作類別,減少因攝像機(jī)遠(yuǎn)或者模糊導(dǎo)致的誤判。

在面對(duì)龐大的低分辨視頻數(shù)據(jù)庫(kù)時(shí),該技術(shù)可以對(duì)低分辨率視頻進(jìn)行分類,方便搜索引擎搜索。在智能安防領(lǐng)域,此技術(shù)可以輔助監(jiān)控遠(yuǎn)離攝像頭的一些模糊信息,減少監(jiān)控探頭的監(jiān)控死角。

綜上所述,本文提出的低分辨率行為識(shí)別技術(shù)在現(xiàn)實(shí)生活中具有較為廣泛的應(yīng)用價(jià)值。

-

數(shù)據(jù)

+關(guān)注

關(guān)注

8文章

7259瀏覽量

92100 -

分辨率

+關(guān)注

關(guān)注

2文章

1081瀏覽量

42699 -

識(shí)別技術(shù)

+關(guān)注

關(guān)注

0文章

211瀏覽量

20042

原文標(biāo)題:CVPR 2022 ActivityNet競(jìng)賽冠軍:中科院深圳先進(jìn)院提出高低分雙模態(tài)行為識(shí)別框架

文章出處:【微信號(hào):CVSCHOOL,微信公眾號(hào):OpenCV學(xué)堂】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

如何構(gòu)建帶有VGA輸出的低分辨率熱成像

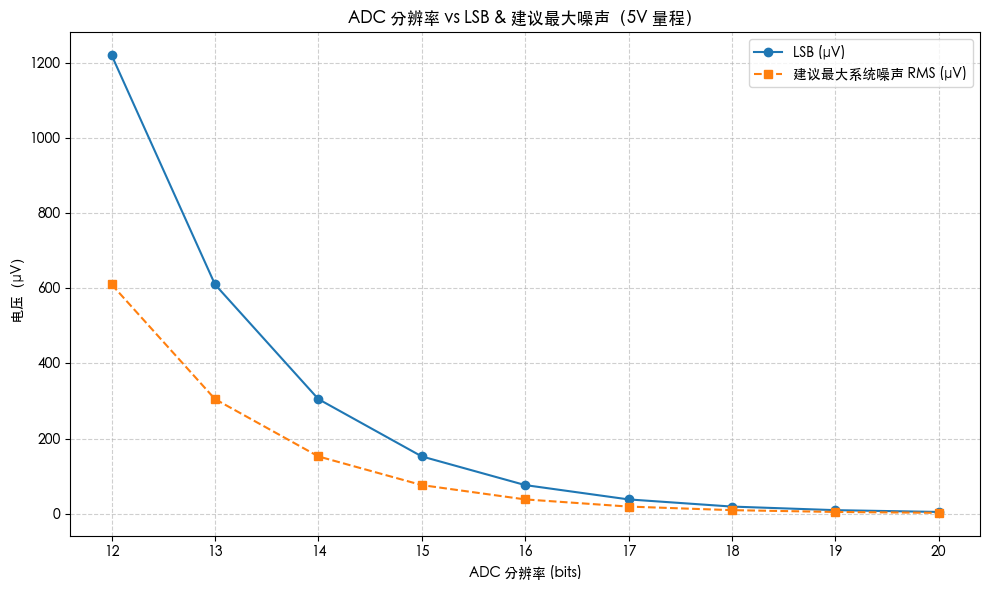

分辨率 vs 噪聲 —— ADC的挑戰(zhàn)

如何計(jì)算存儲(chǔ)示波器的垂直分辨率?

PC電腦USB3.0接口無(wú)法識(shí)別CX3設(shè)備分辨率怎么解決?

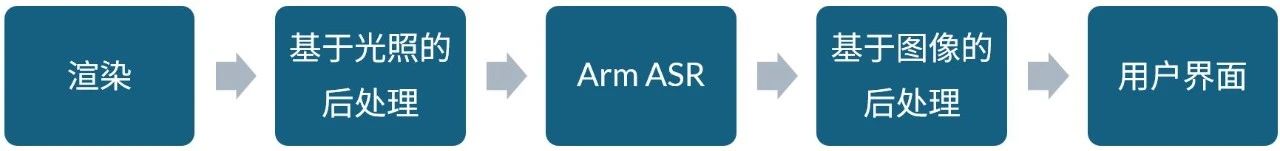

Arm精銳超級(jí)分辨率技術(shù)助力提升游戲性能

DLPDLCR3310EVM如何實(shí)現(xiàn)分辨率擴(kuò)展的?

如何提高透鏡成像的分辨率

如何選擇掃描電鏡的分辨率?

HDMI接口支持哪些視頻分辨率

視頻處理器的分辨率是如何管理的

視頻超分技術(shù)是指什么?

Arm精銳超級(jí)分辨率技術(shù)解析

高速、高分辨率光傳感器的價(jià)值

評(píng)論