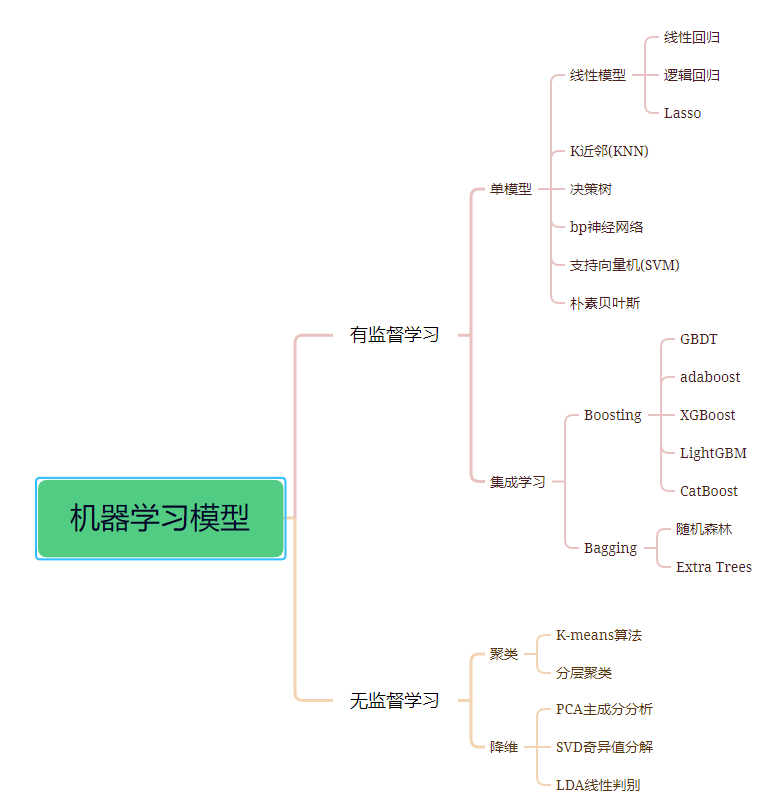

機器學習按照模型類型分為監督學習模型、無監督學習模型兩大類:

1. 有監督學習

有監督學習通常是利用帶有專家標注的標簽的訓練數據,學習一個從輸入變量X到輸入變量Y的函數映射。Y = f (X),訓練數據通常是(n×x,y)的形式,其中n代表訓練樣本的大小,x和y分別是變量X和Y的樣本值。

有監督學習可以被分為兩類:

分類問題:預測某一樣本所屬的類別(離散的)。比如判斷性別,是否健康等。

回歸問題:預測某一樣本的所對應的實數輸出(連續的)。比如預測某一地區人的平均身高。

除此之外,集成學習也是一種有監督學習。它是將多個不同的相對較弱的機器學習模型的預測組合起來,用來預測新的樣本。

1.1 單模型

1.11 線性回歸

線性回歸是指完全由線性變量組成的回歸模型。在線性回歸分析中,只包括一個自變量和一個因變量,且二者的關系可用一條直線近似表示,這種回歸分析稱為一元線性回歸分析。如果回歸分析中包括兩個或兩個以上的自變量,且因變量和自變量之間是線性關系,則稱為多元線性回歸分析。

1.12 邏輯回歸

用于研究Y為定類數據時X和Y之間的影響關系情況,如果Y為兩類比如0和1(比如1為愿意和0為不愿意,1為購買和0為不購買),此時就叫二元邏輯回歸;如果Y為三類以上,此時就稱為多分類邏輯回歸。

自變量并不一定非要定類變量,它們也可以是定量變量。如果X是定類數據,此時需要對X進行啞變量設置。

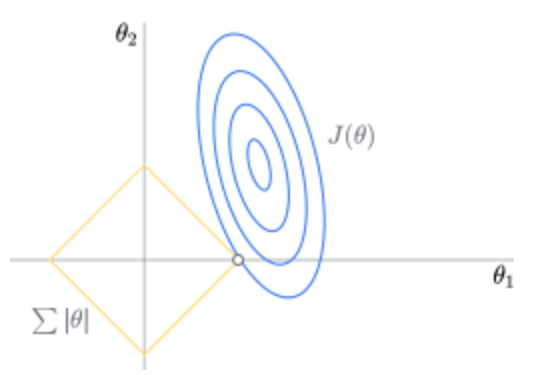

1.13 Lasso

Lasso方法是一種替代最小二乘法的壓縮估計方法。Lasso的基本思想是建立一個L1正則化模型,在模型建立過程中會壓縮一些系數和設定一些系數為零,當模型訓練完成后,這些權值等于0的參數就可以舍去,從而使模型更為簡單,并且有效防止模型過擬合。被廣泛用于存在多重共線性數據的擬合和變量選擇。

1.14 K近鄰(KNN)

KNN做回歸和分類的主要區別在于最后做預測時候的決策方式不同。KNN做分類預測時,一般是選擇多數表決法,即訓練集里和預測的樣本特征最近的K個樣本,預測為里面有最多類別數的類別。KNN做回歸時,一般是選擇平均法,即最近的K個樣本的樣本輸出的平均值作為回歸預測值。但它們的理論是一樣的。

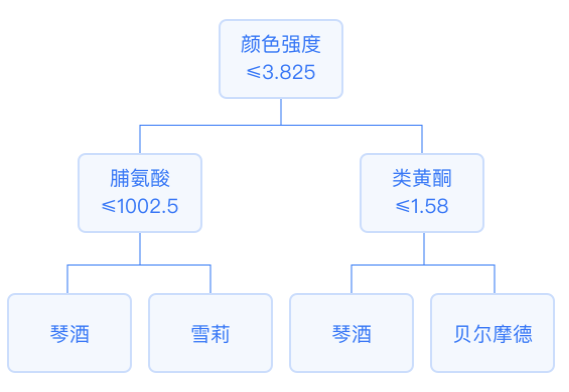

1.15 決策樹

決策樹中每個內部節點都是一個分裂問題:指定了對實例的某個屬性的測試,它將到達該節點的樣本按照某個特定的屬性進行分割,并且該節點的每一個后繼分支對應于該屬性的一個可能值。分類樹葉節點所含樣本中,其輸出變量的眾數就是分類結果。回歸樹的葉節點所含樣本中,其輸出變量的平均值就是預測結果。

1.16 bp神經網絡

bp神經網絡是一種按誤差逆傳播算法訓練的多層前饋網絡,是目前應用最廣泛的神經網絡模型之一。bp神經網絡的學習規則是使用最速下降法,通過反向傳播來不斷調整網絡的權值和閾值,使網絡的分類錯誤率最小(誤差平方和最小)。

BP 神經網絡是一種多層的前饋神經網絡,其主要的特點是:信號是前向傳播的,而誤差是反向傳播的。具體來說,對于如下的只含一個隱層的神經網絡模型:

BP 神經網絡的過程主要分為兩個階段,第一階段是信號的前向傳播,從輸入層經過隱含層,最后到達輸出層;第二階段是誤差的反向傳播,從輸出層到隱含層,最后到輸入層,依次調節隱含層到輸出層的權重和偏置,輸入層到隱含層的權重和偏置。

1.17 支持向量機(SVM)

支持向量機回歸(SVR)用非線性映射將數據映射到高維數據特征空間中,使得在高維數據特征空間中自變量與因變量具有很好的線性回歸特征,在該特征空間進行擬合后再返回到原始空間。

支持向量機分類(SVM)是一類按監督學習方式對數據進行二元分類的廣義線性分類器,其決策邊界是對學習樣本求解的最大邊距超平面。

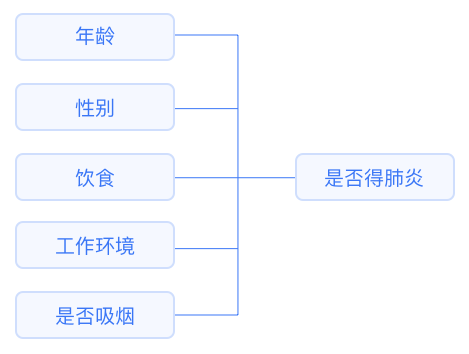

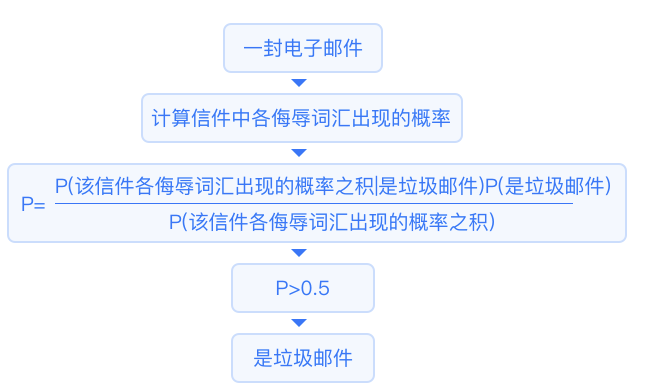

1.18 樸素貝葉斯

在給定一個事件發生的前提下,計算另外一個事件發生的概率——我們將會使用貝葉斯定理。假設先驗知識為d,為了計算我們的假設h為真的概率,我們將要使用如下貝葉斯定理:

該算法假定所有的變量都是相互獨立的。

1.2 集成學習

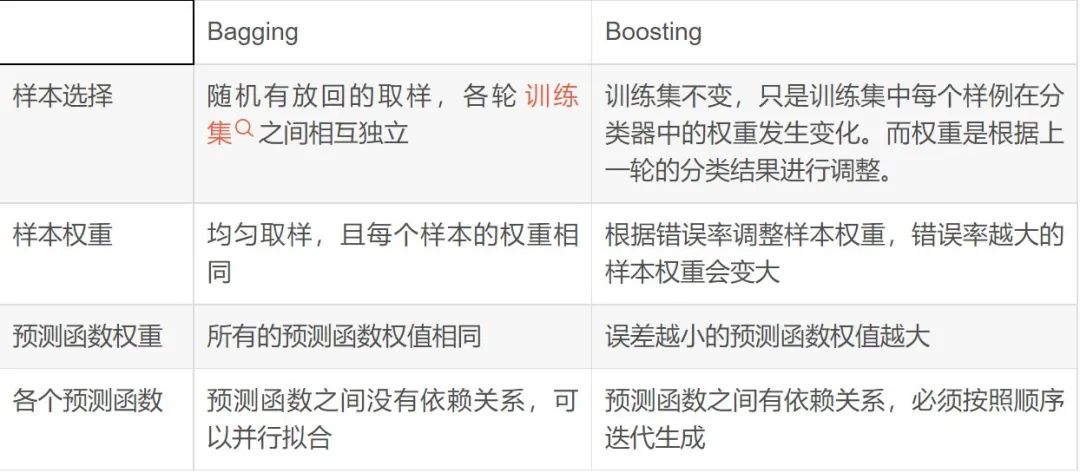

集成學習是一種將不同學習模型(比如分類器)的結果組合起來,通過投票或平均來進一步提高準確率。一般,對于分類問題用投票;對于回歸問題用平均。這樣的做法源于“眾人拾材火焰高”的想法。

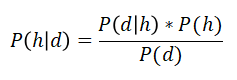

集成算法主要有三類:Bagging,Boosting 和Stacking。本文將不談及stacking。

Boosting

1.21 GBDT

GBDT 是以 CART 回歸樹為基學習器的 Boosting 算法,是一個加法模型,它串行地訓練一組 CART 回歸樹,最終對所有回歸樹的預測結果加和,由此得到一個強學習器,每一顆新樹都擬合當前損失函數的負梯度方向。最后輸出這一組回歸樹的加和,直接得到回歸結果或者套用 sigmod 或者 softmax 函數獲得二分類或者多分類結果。

1.22 adaboost

adaboost給予誤差率低的學習器一個高的權重,給予誤差率高的學習器一個低的權重,結合弱學習器和對應的權重,生成強學習器。回歸問題與分類問題算法的不同點在于誤差率計算的方式不同,分類問題一般都采用0/1損失函數,而回歸問題一般都是平方損失函數或者是線性損失函數。

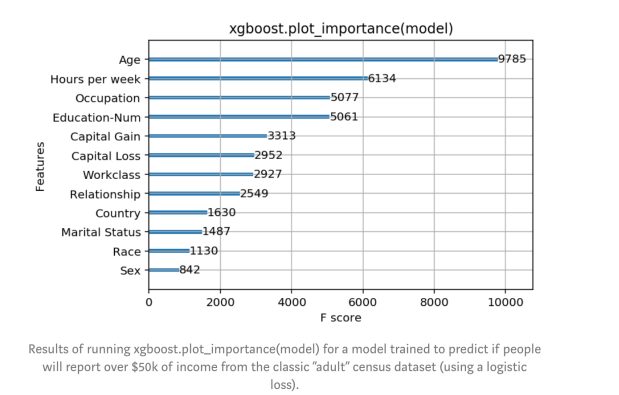

1.23 XGBoost

XGBoost 是"極端梯度上升"(Extreme Gradient Boosting)的簡稱,XGBoost 算法是一類由基函數與權重進行組合形成對數據擬合效果佳的合成算法。由于 XGBoost 模型具有較強的泛化能力、較高的拓展性、較快的運算速度等優勢, 從2015年提出后便受到了統計學、數據挖掘、機器學習領域的歡迎。

xgboost是GBDT的一種高效實現,和GBDT不同,xgboost給損失函數增加了正則化項;且由于有些損失函數是難以計算導數的,xgboost使用損失函數的二階泰勒展開作為損失函數的擬合。

1.24 LightGBM

LightGBM 是 XGBoost 一種高效實現,其思想是將連續的浮點特征離散成 k 個離散值,并構造寬度為 k 的直方圖。然后遍歷訓練數據,計算每個離散值在直方圖中的累計統計量。在進行特征選擇時,只需要根據直方圖的離散值,遍歷尋找最優的分割點;且使用帶有深度限制的按葉子生長(leaf-wise)策略,節省了不少時間和空間上的開銷。

1.25 CatBoost

catboost 是一種基于對稱決策樹算法的 GBDT 框架,主要解決的痛點是高效合理地處理類別型特征和處理梯度偏差、預測偏移問題,提高算法的準確性和泛化能力。

Bagging

1.26 隨機森林

隨機森林分類在生成眾多決策樹的過程中,是通過對建模數據集的樣本觀測和特征變量分別進行隨機抽樣,每次抽樣結果均為一棵樹,且每棵樹都會生成符合自身屬性的規則和分類結果(判斷值),而森林最終集成所有決策樹的規則和分類結果(判斷值),實現隨機森林算法的分類(回歸)。

1.27 Extra Trees

extra-trees (極其隨機的森林)和隨機森林非常類似,這里的“及其隨機”表現在決策樹的結點劃分上,它干脆直接使用隨機的特征和隨機的閾值劃分,這樣我們每一棵決策樹形狀、差異就會更大、更隨機。

2 無監督學習

無監督學習問題處理的是,只有輸入變量X沒有相應輸出變量的訓練數據。它利用沒有專家標注訓練數據,對數據的結構建模。

2.1 聚類

將相似的樣本劃分為一個簇(cluster)。與分類問題不同,聚類問題預先并不知道類別,自然訓練數據也沒有類別的標簽。

2.11 K-means算法

聚類分析是一種基于中心的聚類算法(K 均值聚類),通過迭代,將樣本分到 K 個類中,使得每個樣本與其所屬類的中心或均值的距離之和最小。與分層聚類等按照字段進行聚類的算法不同的是,快速聚類分析是按照樣本進行聚類。

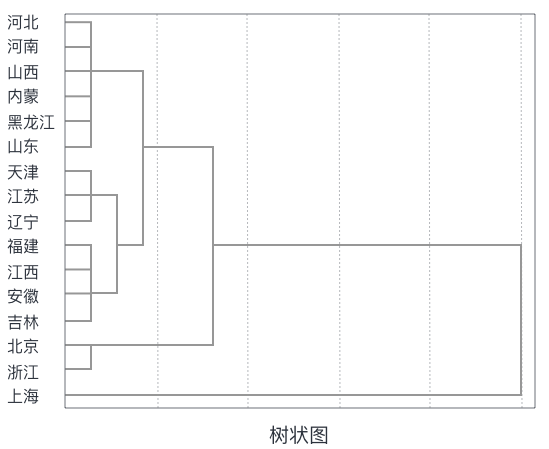

2.12 分層聚類

分層聚類法作為聚類的一種,是對給定數據對象的集合進行層次分解,根據分層分解采用的分解策略。層次聚類算法按數據分層建立簇,形成一棵以簇為節點的樹。如果按自底向上進行層次分解,則稱為凝聚的層次聚類,比如 AGNES。而按自頂向下的進行層次分解,則稱為分裂法層次聚類,比如 DIANA。一般用的比較多的是凝聚層次聚類。

2.2 降維

降維指減少數據的維度同時保證不丟失有意義的信息。利用特征提取方法和特征選擇方法,可以達到降維的效果。特征選擇是指選擇原始變量的子集。特征提取是將數據從高緯度轉換到低緯度。廣為熟知的主成分分析算法就是特征提取的方法。

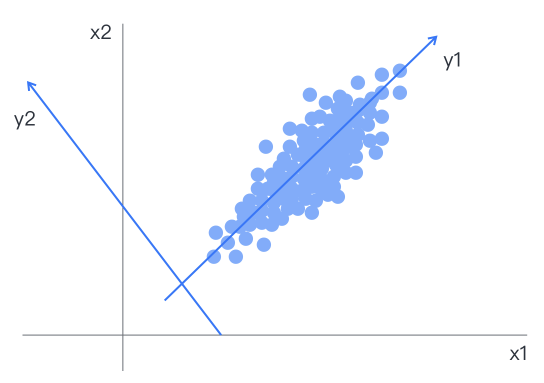

2.21 PCA主成分分析

主成分分析將多個有一定相關性的指標進行線性組合,以最少的維度解釋原數據中盡可能多的信息為目標進行降維,降維后的各變量間彼此線性無關,最終確定的新變量是原始變量的線性組合,且越往后主成分在方差中的比重也小,綜合原信息的能力越弱。

2.22 SVD奇異值分解

奇異值分解(SVD)是在機器學習領域廣泛運用的算法,他不光可以用在降維算法中的特征值分解,還可以用于推薦系統,以及自然語言處理等領域,是很多算法的基石。

2.23 LDA線性判別

線性判別的原理是將樣本投影到一條直線上,使得同類樣本的投影點盡可能接近,不同樣本的投影點盡可能遠離;在對新樣本進行分類時,將其投影到同樣的直線上,再根據投影點的位置來確定新樣本的類別。

-

函數

+關注

關注

3文章

4327瀏覽量

62573 -

模型

+關注

關注

1文章

3226瀏覽量

48809 -

機器學習

+關注

關注

66文章

8406瀏覽量

132567

原文標題:機器學習知識點全面總結(有監督+無監督)

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

機器學習的幾種模型類型介紹

機器學習的幾種模型類型介紹

評論