使用標準以太網網絡和現成的 3D 游戲 CPU/GPU 硬件,可以實現將傳感器數據分發到多個控制臺顯示器,以支持基于軟件的解壓縮和顯示組合。這減少了視頻處理和顯示系統對專有硬件技術的依賴。

現代計算平臺已經發生了重大變化,以滿足3D游戲市場的需求。因此,他們現在提供了一種高性能計算解決方案,非常適合將實時視頻和雷達數據從傳感器流式傳輸到顯示器的需求。

采用行業標準的處理和圖形架構可降低初始系統成本,并通過減少對專業專有硬件的依賴來簡化未來的技術增強。跨異構 CPU 和 GPU 硬件運行的靈活軟件也是關鍵。該軟件很容易在不同供應商的處理硬件之間移動,并且可以適應行業標準處理和顯示技術路線圖中的處理和顯示功能的升級。為了理解這種不斷變化的范式,討論了視頻解壓縮和顯示,以及軟件和中間件接口。

視頻解壓縮和顯示

圖形處理器單元(GPU)的不斷發展,例如3D游戲市場中使用的圖形處理器單元(GPU)使現代顯示客戶端能夠處理傳感器解壓縮和軟件中的顯示。使用標準客戶端顯示硬件,通過軟件進行配置以滿足不同的操作需求,意味著更多的通用性、更少的變體和更低的系統成本。多通道的全 H.264 解碼以及雷達解壓縮、掃描轉換和多窗口顯示均可使用使用標準 CPU 加 GPU 技術的行業標準硬件實現。將GPU用于多個應用的靈活性大大簡化了系統架構,因為通用的顯示架構可用于雷達、視頻和組合顯示位置。

由于壓縮的傳感器數據使用多播協議分發,因此網絡負載不受添加額外顯示客戶端的影響。基于PC或SBC的低成本顯示位置可以實現復雜的多控制臺實時視頻和雷達顯示,并且軟件可以很容易地在不同操作角色之間重新配置。

現代圖形處理器,如NVIDIA和AMD(采用ATI)提供的圖形處理器,提供復雜的處理和顯示功能,現在已經發展到模糊CPU和GPU之間的區別。此外,軟件現在正在發展,允許程序員編寫將在選擇操作環境的情況下在CPU或GPU上執行的代碼。這允許對數據集進行密集操作,以利用GPU上的多個處理器,CPU處理復雜的順序代碼,輸入/輸出和系統管理。

盡管GPU在計算可以并行化時具有巨大的吞吐量的潛力,但許多問題,甚至是計算密集型問題,都很難以GPU可以利用的方式表達出來。以3 GHz運行的多核CPU并不懶惰,因此讓CPU處理數據通常比弄清楚如何使用GPU然后將數據傳入和傳出以進行處理更有效。將數據移入和移出 GPU 并將傳輸與 CPU 上的處理同步,可能會抵消并行處理可以提供的任何處理增益。在許多情況下,傳輸數據和同步將結果交還給CPU的開銷是令人望而卻步的,而建模和量化這被證明是非常困難的。

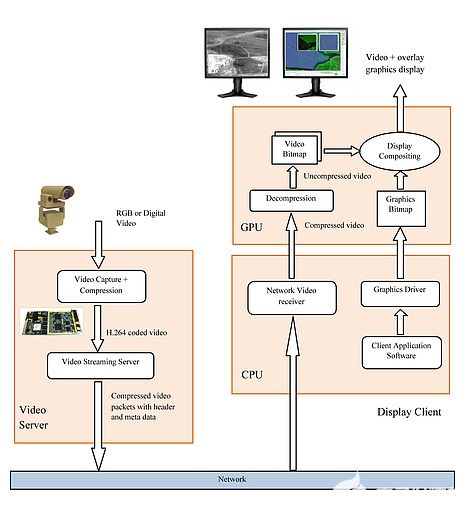

在解壓縮H.264視頻的情況下,GPU提供了一個理想的處理平臺。壓縮的,因此相對較低的數據速率(例如,對于高清視頻信號為20 Mbps)輸入數據從CPU傳輸到GPU。壓縮后,數據可以保留在GPU內存中,準備傳輸到顯示窗口。通過這種方式,可以避免其他昂貴的操作(在內存傳輸和需要同步回CPU方面)。CPU 負責調度將視頻數據從屏幕外內存傳輸到顯示窗口,可以選擇將視頻數據與疊加層相結合,以將符號系統添加到視頻窗口中。此過程允許客戶端顯示應用程序創建顯示為視頻疊加層(十字準線、目標信息、地理特征等)的圖形圖層,并使最終顯示由多個獨立更新的圖層組成 - 所有這些都是實時的。直到最近,這種多層實時視頻系統還需要高度專業化的硬件產品。但是,3D游戲技術現在支持這種CPU加GPU的壓縮和顯示。在行業標準硬件中實現這一點的能力是一項重大發展。數據路徑如圖 1 所示。

圖 1:使用服務器端硬件捕獲和壓縮的攝像機視頻可以使用標準 GPU 加 CPU 架構進行解壓縮和顯示,并由客戶端顯示合成提供可選的注釋。

在視頻和雷達分配系統組合的實際實現中,服務器使用攝像頭和雷達傳感器捕獲數據。此數據由采集服務器壓縮,并使用多播網絡數據包分發到任意數量的控制臺。由于原始攝像頭和雷達數據顯示在網絡上,因此每個控制臺都可以選擇可用數據的任意組合。其他控制臺不會影響網絡帶寬,而網絡帶寬僅是分布式傳感器數量的函數。網絡交換機負責將客戶端連接到服務器。客戶端控制臺可以專用于雷達或視頻的顯示,也可以在單個顯示位置的兩個頭上顯示兩者。在所示的示例中,客戶端顯示器在主頭上顯示三個雷達視頻窗口,在第二個頭上顯示兩個實時視頻窗口。對于相機顯示,H.264 數據在 GPU 內部解壓縮,然后縮放以適合輸出窗口。對于雷達顯示,使用CPU解壓縮雷達視頻,然后掃描轉換并在三個PPI窗口中的每個窗口中以高達1,920 x 1,200的分辨率顯示圖形。這整個客戶端處理發生在 CPU 負載小于 10% 的中端硬件配置上。網絡上的其他客戶端維護自己獨立的雷達和視頻顯示。

專為雷達和視頻設計的軟件可確保在各種顯示位置上使用極具成本效益和可互換的硬件,以實現安全、命令和控制以及消防控制應用。對軟件的強調和專有硬件的消除確保了設備的未來升級可以采用主流計算和圖形組件。這些組件的演進將增強性能、分辨率和數據速率,這些都可以使用相同的軟件架構進行處理。

通過軟件/中間件進行接口

通過行業標準的硬件處理平臺來提供CPU和GPU資源,實現該方案的軟件是應用程序和中間件的組合。中間件/軟件提供將應用層連接到圖形和捕獲硬件的驅動程序的組件,處理網絡分布、服務質量、緩沖、優先級和顯示合成。劍橋像素在其SPx集成雷達處理和顯示軟件系列中開發了一組服務器和API模塊,為雷達和視頻傳感器數據的傳感器到顯示器捕獲,壓縮,分配,處理和顯示提供編程API。中間件允許從各種傳感器類型捕獲和壓縮,使用來自第三方制造商的硬件卡,例如技術源的 Condor VC 100x XMC 卡、標準網絡攝像機和使用 Matrox 提供的圖像采集卡的 RGB 設備。這種與各種第三方傳感器和硬件接口的能力提供了顯著的靈活性和成本效益。可以使用標準的SPx AV服務器應用程序處理視頻的分發,也可以使用集成的雷達處理和顯示軟件庫構建自定義服務器。在客戶端,該軟件提供應用程序和硬件之間的接口軟件,允許利用GPU進行視頻壓縮和顯示處理。在顯示雷達的地方,集成的雷達處理和顯示軟件處理雷達掃描轉換和顯示混合,以支持高分辨率(高達1,920 x 1,200)控制臺顯示。

面向未來的系統架構

3D游戲GPU提供了一個與顯示處理緊密耦合的通用處理器,因此一旦視頻解壓縮,就可以在GPU的范圍內傳輸到顯示窗口。適度的 CPU 和 GPU 組合可以同時處理多雷達和視頻顯示以及應用程序圖形,以提供多功能的多屏幕、多窗口和多層顯示功能。通過高性能、低成本的商業處理和圖形設備替換專有硬件,再加上可以利用這些設備功能的軟件,有望在初始部署和終身維護期間節省大量成本。隨著圖形向通用處理(NVIDIA的路線圖)和處理器集成圖形(英特爾和AMD的路線圖)的轉變,市場將進一步發展。

審核編輯:郭婷

-

以太網

+關注

關注

40文章

5483瀏覽量

173246 -

cpu

+關注

關注

68文章

10947瀏覽量

213895 -

gpu

+關注

關注

28文章

4830瀏覽量

129777

發布評論請先 登錄

相關推薦

labview視頻實時傳輸

IMX8MP gstreamer在流式傳輸時是否有其他方法可以在我想要的時間捕獲?

流式傳輸的實現途徑

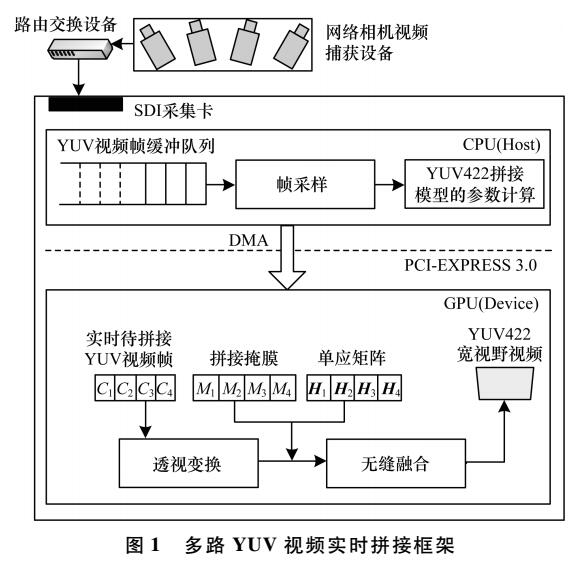

YUV視頻GPU實時拼接

Freshworks的無縫實時流式傳輸事件來構建客戶數據

gpu和cpu有什么區別?

gpu是什么和cpu的區別

Simplelink? CC3220-OV788音頻/視頻流式傳輸參考

使用CPU/GPU流式傳輸實時視頻

使用CPU/GPU流式傳輸實時視頻

評論