摘要

針對(duì)深度學(xué)習(xí)算法在多目標(biāo)跟蹤中的實(shí)時(shí)性問題, 提出一種基于MobileNet的多目標(biāo)跟蹤算法. 借助于MobileNet深度可分離卷積能夠?qū)ι疃染W(wǎng)絡(luò)模型進(jìn)行壓縮的原理, 將YOLOv3主干網(wǎng)絡(luò)替換為MobileNet, 通過將標(biāo)準(zhǔn)卷積分解為深度卷積和逐點(diǎn)卷積, 保留多尺度預(yù)測(cè)部分, 以有效減少參數(shù)量. 對(duì)于檢測(cè)得到的邊框信息, 利用Deep-SORT算法進(jìn)行跟蹤. 實(shí)驗(yàn)結(jié)果表明, 所提出方法在跟蹤效果基本不變的情況下可提升處理速度近50%.

關(guān)鍵詞

深度學(xué)習(xí)多目標(biāo)跟蹤目標(biāo)檢測(cè)YOLOv3deep-SORTMobileNet

0 引言

多目標(biāo)跟蹤是計(jì)算機(jī)視覺領(lǐng)域的研究熱點(diǎn), 可應(yīng)用于交通監(jiān)測(cè)、安防等多個(gè)領(lǐng)域, 具有一定的應(yīng)用價(jià)值和挑戰(zhàn)性[1]. 檢測(cè)方式可以分為檢測(cè)跟蹤和無檢測(cè)跟蹤兩類, 前者需要檢測(cè)目標(biāo)后再進(jìn)行跟蹤; 后者需要在第1幀手動(dòng)初始化目標(biāo), 然后進(jìn)行跟蹤. 在目標(biāo)跟蹤中, 涌現(xiàn)出許多具有良好性能的算法, 如SSD[2]、R-CNN[3-4]以及YOLO系列[5-7], 其中YOLOv3[7]算法在檢測(cè)跟蹤中體現(xiàn)出較強(qiáng)的優(yōu)勢(shì).

由于深度學(xué)習(xí)的發(fā)展, 卷積神經(jīng)網(wǎng)絡(luò)模型逐漸替代了傳統(tǒng)手工設(shè)計(jì)的特征, 提供了一種端到端的處理方法, 精度也大幅提高. 但CNN模型在不斷提高精度的同時(shí), 其網(wǎng)絡(luò)深度和尺寸也在成倍增長(zhǎng), 需要GPU來進(jìn)行加速, 使得基于深度學(xué)習(xí)的跟蹤算法無法直接應(yīng)用于移動(dòng)設(shè)備, 導(dǎo)致難以符合實(shí)時(shí)性要求. 因此降低算法復(fù)雜度、提高實(shí)時(shí)性、簡(jiǎn)化和加速模型便成為亟待解決的問題. 文獻(xiàn)[8-10]使用剪枝方法對(duì)神經(jīng)網(wǎng)絡(luò)進(jìn)行網(wǎng)絡(luò)壓縮. 文獻(xiàn)[11]提出從零開始訓(xùn)練低秩約束卷積神經(jīng)網(wǎng)絡(luò)模型的方法, 不僅速度得到提升, 而且在一些情況下模型性能也有所提高. 目前, 深度網(wǎng)絡(luò)模型壓縮方法分為兩個(gè)方向: 一是對(duì)已經(jīng)訓(xùn)練好的深度網(wǎng)絡(luò)模型進(jìn)行壓縮得到小型化模型; 二是直接設(shè)計(jì)小型化模型進(jìn)行訓(xùn)練, 如SqueezeNet[12]、ShuffleNet[13]、MobileNet[14]等.

在多目標(biāo)跟蹤方面, Zhang等[15]提出一種新型檢測(cè)跟蹤方法, 即將檢測(cè)與軌跡聯(lián)系起來, 形成長(zhǎng)軌跡. Mahmoudi等[16]使用卷積神經(jīng)網(wǎng)絡(luò)代替手工標(biāo)注進(jìn)行特征提取, 以改善算法精度, 并提出一種新的2D在線環(huán)境分組方法, 具有較高的準(zhǔn)確率和實(shí)時(shí)性. Xiang等[17]設(shè)計(jì)了一個(gè)卷積神經(jīng)網(wǎng)絡(luò)提取針對(duì)人的重識(shí)別, 并使用長(zhǎng)期短期記憶網(wǎng)絡(luò)(long short-term memory, LSTM)提取運(yùn)動(dòng)信息來編碼目標(biāo)的狀態(tài); 此外, 還設(shè)計(jì)了基于遞歸神經(jīng)網(wǎng)絡(luò)的貝葉斯過濾模塊, 并將LSTM網(wǎng)絡(luò)的隱藏狀態(tài)作為輸入, 執(zhí)行遞歸預(yù)測(cè)和更新目標(biāo)狀態(tài). 而Deep-SORT[18]多目標(biāo)跟蹤算法則在SORT[19]算法的基礎(chǔ)上, 提取深度表觀特征,使跟蹤效果有了明顯的提升.

本文針對(duì)算法的實(shí)時(shí)性問題, 結(jié)合深度學(xué)習(xí)目標(biāo)檢測(cè)、深度網(wǎng)絡(luò)模型壓縮以及多目標(biāo)跟蹤算法, 提出基于MobileNet的多目標(biāo)跟蹤算法, 在保證精度的前提下, 有效改善深度網(wǎng)絡(luò)模型龐大以及計(jì)算復(fù)雜的問題, 提高了算法的執(zhí)行速度.

1 YOLOv3目標(biāo)檢測(cè)算法

YOLOv3算法的基本思想是: 將輸入圖像分割為S×S 個(gè)單元格, 每個(gè)單元格用于檢測(cè)中心點(diǎn)落在該網(wǎng)格內(nèi)的目標(biāo), 并預(yù)測(cè)B 個(gè)邊界框和置信度. 邊界框用(x,y,w,h,c)5個(gè)參數(shù)表達(dá), 其中(x,y) 為目標(biāo)中心相對(duì)于單元格左上角的相對(duì)坐標(biāo), 而w 和h 則分別是目標(biāo)與整張圖像的寬和高之比. 單元格還預(yù)測(cè)C 個(gè)類別的各類概率值. 因此, 每個(gè)單元格共預(yù)測(cè)B×(5+C) 個(gè)值. YOLOv3借鑒ResNet的理念, 采用YOLOv2的Darknet-19, 并創(chuàng)建一個(gè)新的特征提取網(wǎng)絡(luò)Darknet-53[20]. YOLOv3采用類似FPN的上采樣和特征融合機(jī)制, 使用不同的特征尺度進(jìn)行預(yù)測(cè). 考慮到其對(duì)小目標(biāo)檢測(cè)的良好效果, 本文采用該算法進(jìn)行目標(biāo)檢測(cè).

2 基于MobileNet的多目標(biāo)跟蹤算法

利用MobileNet將標(biāo)準(zhǔn)卷積分解為深度卷積和逐點(diǎn)卷積以減少參數(shù)量的特點(diǎn), 替換YOLOv3目標(biāo)檢測(cè)算法的主干網(wǎng)絡(luò)框架, 并保留多尺度預(yù)測(cè), 形成基于MobileNet的目標(biāo)檢測(cè)算法, 再進(jìn)一步結(jié)合Deep-SORT算法進(jìn)行多目標(biāo)跟蹤.

2.1

MobileNet算法

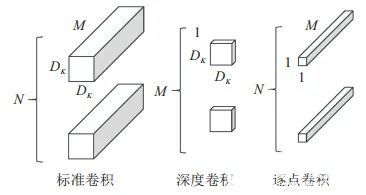

MobileNet是Google為移動(dòng)端和嵌入式設(shè)備提出的高效模型. 使用深度可分離卷積構(gòu)建深度神經(jīng)網(wǎng)絡(luò),并通過兩個(gè)超參數(shù), 從通道數(shù)量和特征圖大小兩個(gè)方面減少計(jì)算量. 分解過程如圖 1所示.

圖 1 深度可分離卷積分解過程

假設(shè)輸入的特征映射F尺寸為(DF,DF,M) , 采用的標(biāo)準(zhǔn)卷積K 為(DK,DK,M,N) , 則輸出的映射G 尺寸為(DF,DF,N) . M 為輸入通道數(shù), N 為輸出通道數(shù), 對(duì)應(yīng)的計(jì)算量為

(1)

將標(biāo)準(zhǔn)卷積分解為深度卷積和逐點(diǎn)卷積, 深度卷積起濾波作用, 尺寸大小為(DK,DK,1,M) , 輸出特征映射尺寸為(DF,DF,M) ; 逐點(diǎn)卷積用于通道轉(zhuǎn)換, 尺寸大小為(1,1,M,N), 輸出映射尺寸為(DF,DF,N) . 兩者對(duì)應(yīng)的計(jì)算量為

(2)

相比于標(biāo)準(zhǔn)卷積, 深度可分離卷積計(jì)算量減少, 即

(3)

此外, MobileNet還引入了寬度乘子α 和分辨率乘子ρ 兩個(gè)超參數(shù), 分別用于改變通道數(shù)和特征圖分辨率, 便于控制模型大小, 降低參數(shù)量.

2.2

基于MobileNet的目標(biāo)檢測(cè)模型

MobileNet網(wǎng)絡(luò)基于深度可分離卷積, 除全連接層外, 所有層后跟有BatchNorm和ReLU, 最后使用softmax進(jìn)行分類. MobileNet將深度卷積和逐點(diǎn)卷積計(jì)為單獨(dú)的層, 共有28層.

針對(duì)實(shí)時(shí)性問題, 本文結(jié)合卷積神經(jīng)網(wǎng)絡(luò)模型壓縮方法, 選用MobileNet與YOLOv3檢測(cè)模型相結(jié)合, 用前者代替后者的網(wǎng)絡(luò)框架, 同時(shí)保留YOLOv3的多尺度預(yù)測(cè), 最終得到輕量級(jí)的檢測(cè)模型.

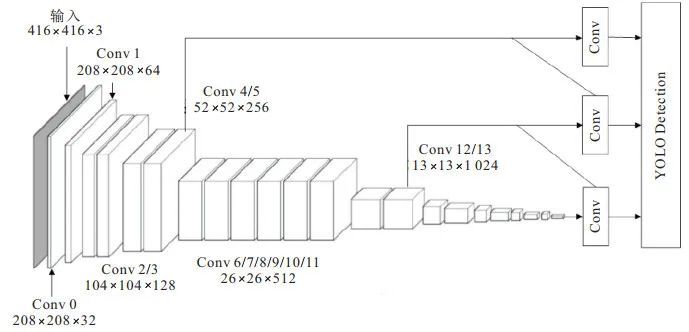

YOLOv3中包括13×13、26×26和52×52三個(gè)尺度, 在MobileNet網(wǎng)絡(luò)中找到對(duì)應(yīng)13×13×1024、26×26×512和52×52×256的部分, 使用YOLOv3多尺度預(yù)測(cè)的方法進(jìn)行融合, 替換后的網(wǎng)絡(luò)結(jié)構(gòu)如圖 2所示.

圖 2 YOLOv3-MobileNet框架

2.3

多目標(biāo)跟蹤

由于Deep-SORT算法加入了深度表觀特征, 并具有較高的準(zhǔn)確度和實(shí)時(shí)性, 本文將基于MobileNet的目標(biāo)檢測(cè)算法與Deep-SORT相結(jié)合進(jìn)行多目標(biāo)跟蹤, 主要分為以下部分:

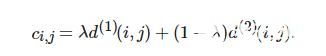

1、目標(biāo)檢測(cè). 首先對(duì)輸入的視頻進(jìn)行目標(biāo)檢測(cè), 得到目標(biāo)的邊框及特征信息, 并根據(jù)置信度和非極大值抑制進(jìn)行邊框過濾.

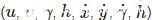

2、軌跡處理和狀態(tài)估計(jì). 運(yùn)動(dòng)狀態(tài)估計(jì)中使用8個(gè)參數(shù)

進(jìn)行運(yùn)動(dòng)狀態(tài)的描述, 其中(u,υ)為邊框的中心坐標(biāo), γ為長(zhǎng)寬比, h為高度, 這4個(gè)參數(shù)來源于目標(biāo)檢測(cè)部分, 其余4個(gè)參數(shù)表示對(duì)應(yīng)圖像坐標(biāo)系中的速度信息.使用卡爾曼濾波器對(duì)運(yùn)動(dòng)狀態(tài)進(jìn)行預(yù)測(cè).

3、對(duì)跟蹤器參數(shù)和特征集進(jìn)行更新, 判斷有無目標(biāo)消失或者有無新目標(biāo)出現(xiàn). 對(duì)每個(gè)目標(biāo), 記錄其上次檢測(cè)結(jié)果和跟蹤結(jié)果匹配后的幀數(shù)ak, 只要檢測(cè)結(jié)果與跟蹤結(jié)果正確關(guān)聯(lián), 就將該參數(shù)置為0. 如果ak超過了設(shè)置的最大閾值A(chǔ)max, 則結(jié)束對(duì)該目標(biāo)的跟蹤.

4、檢測(cè)結(jié)果與跟蹤預(yù)測(cè)結(jié)果匹配. 區(qū)分已確認(rèn)和未確認(rèn)狀態(tài)的跟蹤器, 對(duì)已確認(rèn)狀態(tài)的跟蹤器進(jìn)行匹配指派. 其中指派問題使用了匈牙利算法, 并同時(shí)考慮運(yùn)動(dòng)信息的關(guān)聯(lián)和目標(biāo)外觀信息的關(guān)聯(lián).

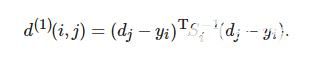

運(yùn)動(dòng)信息關(guān)聯(lián): 使用卡爾曼濾波器預(yù)測(cè)狀態(tài)和新測(cè)量之間的馬氏距離, 以此表達(dá)運(yùn)動(dòng)信息, 有

(4)

式(4)表示第j個(gè)檢測(cè)結(jié)果與第ii條軌跡之間的運(yùn)動(dòng)匹配度. 其中: Si為卡爾曼濾波器當(dāng)前時(shí)刻觀測(cè)空間的協(xié)方差矩陣, yi為當(dāng)前時(shí)刻的預(yù)測(cè)觀測(cè)量, dj為第j個(gè)檢測(cè)的狀態(tài)(u,υ,γ,). 馬氏距離通過測(cè)量遠(yuǎn)離平均軌道位置的標(biāo)準(zhǔn)偏差考慮狀態(tài)估計(jì)的不確定性, 通過逆卡方分布的0.95分位點(diǎn)作為閾值t(1), 指標(biāo)函數(shù)定義如下:

(5)

目標(biāo)外觀信息關(guān)聯(lián): 由于相機(jī)運(yùn)動(dòng)會(huì)使馬氏距離度量方法失效, 引入第2種關(guān)聯(lián)方法, 對(duì)每個(gè)跟蹤目標(biāo)構(gòu)建一個(gè)庫(kù), 存儲(chǔ)每個(gè)跟蹤目標(biāo)成功關(guān)聯(lián)的最近100幀特征向量, 則第i個(gè)跟蹤器與當(dāng)前幀第j個(gè)檢測(cè)結(jié)果之間的表觀匹配度為

(6)

指標(biāo)函數(shù)表示為

(7)

采用上述兩種度量的線性加權(quán)作為最終度量, 有

(8)

只有當(dāng)ci,j位于兩種度量閾值的交集內(nèi)時(shí), 才認(rèn)為實(shí)現(xiàn)了正確的關(guān)聯(lián). 當(dāng)指派完成后, 分類出未匹配的檢測(cè)和跟蹤器.

5) 對(duì)未確認(rèn)狀態(tài)的跟蹤器、未匹配的跟蹤器和未匹配的檢測(cè)進(jìn)行IOU匹配, 再次使用匈牙利算法進(jìn)行指派.

6) 對(duì)于匹配的跟蹤器進(jìn)行參數(shù)更新, 刪除再次未匹配的跟蹤器, 未匹配的檢測(cè)初始化為新目標(biāo).

算法整體流程如圖 3所示.

圖 3 多目標(biāo)跟蹤算法流程

3 實(shí)驗(yàn)結(jié)果

本文算法使用keras實(shí)現(xiàn), 并利用PASCAL VOC 2007和VOC 2012數(shù)據(jù)集進(jìn)行訓(xùn)練. 作為視覺分類檢測(cè)的基準(zhǔn)測(cè)試, PASCAL VOC數(shù)據(jù)集包含20類物體, 如人、動(dòng)物、交通工具、家具等, 每張圖片均有標(biāo)注.本文使用VOC 2007 trainval數(shù)據(jù)集和VOC 2012 trainval數(shù)據(jù)集、共16 551張圖片進(jìn)行訓(xùn)練, 訓(xùn)練環(huán)境為Google Colab云平臺(tái). 所使用的操作系統(tǒng)為Ubuntu18.04.1, GPU為Tesla K80. 其他測(cè)試均在Windows 8.1下進(jìn)行, CPU為Intel(R) Core(TM) i5-5200U, 無GPU.

在目標(biāo)檢測(cè)評(píng)價(jià)中, 常用的評(píng)價(jià)指標(biāo)為mAP(mean average precision), 表示對(duì)目標(biāo)類的AP值取平均, 本文采用mAP、單張圖片檢測(cè)時(shí)間及模型大小等指標(biāo)對(duì)目標(biāo)檢測(cè)模型進(jìn)行評(píng)估. 對(duì)于多目標(biāo)跟蹤算法, 由于很難使用單一評(píng)分評(píng)估多目標(biāo)跟蹤性能, 采用MOT Challenge評(píng)價(jià)標(biāo)準(zhǔn).

3.1

目標(biāo)檢測(cè)算法對(duì)比實(shí)驗(yàn)

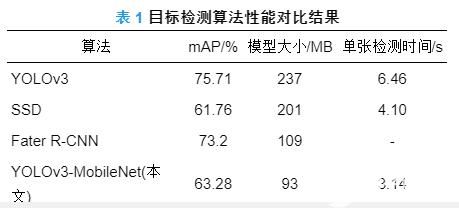

表 1為YOLOv3目標(biāo)檢測(cè)算法、基于MobileNet的目標(biāo)檢測(cè)算法和其他檢測(cè)算法實(shí)驗(yàn)對(duì)比結(jié)果.

表 1 目標(biāo)檢測(cè)算法性能對(duì)比結(jié)果

本文選取比較流行的單階段檢測(cè)算法和兩階段檢測(cè)算法進(jìn)行對(duì)比實(shí)驗(yàn). 由表 1可見, 基于MobileNet的目標(biāo)檢測(cè)算法模型是YOLOv3算法模型的1/3, 并且相比SSD和Fater R-CNN, 模型最小; 單張圖片檢測(cè)時(shí)間相比YOLOv3模型提高了2倍; 在精度方面, 本文檢測(cè)算法相比YOLOv3模型下降約12.4 %, 但相比SSD提高1.5 %. 總體而言, 雖然本文檢測(cè)算法在檢測(cè)精度上有所降低, 但可以滿足檢測(cè)跟蹤的實(shí)際需求, 并且在模型大小和單張檢測(cè)時(shí)間上具有優(yōu)勢(shì). 精度降低的原因是由于YOLOv3的網(wǎng)絡(luò)結(jié)構(gòu)中使用了殘差網(wǎng)絡(luò), 并且網(wǎng)絡(luò)層數(shù)更深, 而MobileNet網(wǎng)絡(luò)結(jié)構(gòu)僅使用深度可分離卷積, 沒有使用殘差結(jié)構(gòu), 在網(wǎng)絡(luò)深度方面也比YOLOv3更淺, 因此造成本文檢測(cè)算法在mAP值上與YOLOv3差距較大. 雖然本文檢測(cè)算法在一定程度上犧牲了精度, 但實(shí)現(xiàn)了模型的小型化和速度上的提升.

3.2

多目標(biāo)跟蹤算法對(duì)比實(shí)驗(yàn)

在MOT基準(zhǔn)數(shù)據(jù)庫(kù)提供的序列集上評(píng)估跟蹤性能, 以MOT Challenge標(biāo)準(zhǔn)對(duì)多目標(biāo)跟蹤算法進(jìn)行評(píng)價(jià), 具體評(píng)價(jià)指標(biāo)如表 2所示, 各指標(biāo)含義如下:

表 2 評(píng)價(jià)指標(biāo)對(duì)比

MOTA(↑): 多目標(biāo)跟蹤準(zhǔn)確度;

MOTP(↑): 多目標(biāo)跟蹤精度;

MT(↑): 目標(biāo)跟蹤軌跡占真實(shí)長(zhǎng)度80 %以上的軌跡數(shù)目;

ML(↓): 目標(biāo)跟蹤丟失軌跡占真實(shí)長(zhǎng)度至多20 %的軌跡數(shù)目;

IDs(↓): 目標(biāo)ID發(fā)生變化的次數(shù);

FP(↓): 誤報(bào)總數(shù);

FN(↓): 未命中目標(biāo)的總數(shù);

FPS(↑): 幀頻率.

對(duì)于帶有(↑)的評(píng)價(jià)指標(biāo), 分?jǐn)?shù)越高表示效果越好; 對(duì)于帶有(↓)的評(píng)價(jià)指標(biāo), 結(jié)果相反.

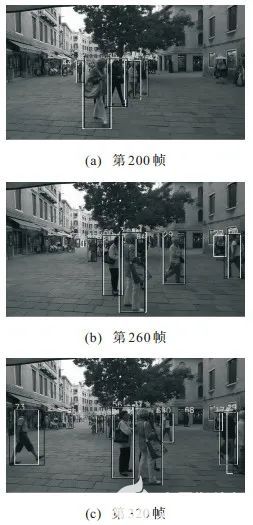

由表 2可見: 本文算法的MOTP值與YOLOv3-Deep-SORT算法相差不大, 但均高于表中其他算法; 被跟蹤的軌跡比例(MT)相比YOLOv3-Deep-SORT算法有所上升, 跟丟軌跡占比(ML)有所下降, 均優(yōu)于TC_ODAL和RMOT算法; ID變換次數(shù)低于表中前4個(gè)算法(即TC_ODAL、RMOT、SORT、MDP), 但相比YOLOv3-Deep-SORT算法有所上升; 幀頻率提高為該算法的3倍, 檢測(cè)跟蹤時(shí)間提高顯著. 本文算法雖然在跟蹤準(zhǔn)確度、ID變換次數(shù)和誤報(bào)總數(shù)上不及YOLOv3-Deep-SORT算法, 但其他跟蹤指標(biāo)均優(yōu)于該算法, 并且本文算法相比于TC_ODAL、RMOT和SORT等算法優(yōu)勢(shì)明顯. 為進(jìn)一步表現(xiàn)本文算法的優(yōu)越性, 以ID標(biāo)號(hào)為3的目標(biāo)為例, 給出如圖 4所示的部分跟蹤結(jié)果, 且跟蹤框上帶有數(shù)字ID標(biāo)識(shí). 由圖 4可見, 該算法在第200幀、260幀、320幀均能連續(xù)跟蹤, 跟蹤效果良好.

圖 4 跟蹤結(jié)果

3.3

無人機(jī)人流監(jiān)控實(shí)驗(yàn)

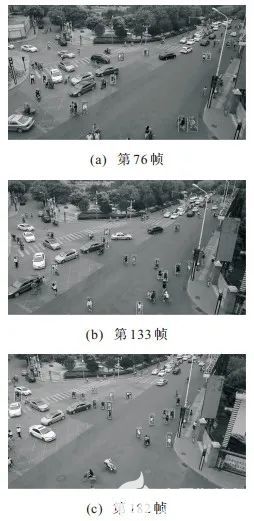

以某城市交通路口人流監(jiān)控為例, 將本文算法應(yīng)用于無人機(jī), 利用其高空獨(dú)特視角, 對(duì)十字路口行人進(jìn)行統(tǒng)計(jì), 實(shí)時(shí)監(jiān)測(cè)人流密度以及人流密度變化情況, 以配合地面警力巡查, 對(duì)各類警情及交通情況進(jìn)行預(yù)警, 輔助警力調(diào)度, 實(shí)現(xiàn)對(duì)城市環(huán)境下的安全監(jiān)控. 此類監(jiān)管系統(tǒng)的關(guān)鍵是要具有良好的實(shí)時(shí)性, 因此降低網(wǎng)絡(luò)參數(shù)量, 提高實(shí)時(shí)性顯得十分重要.

本文以無人機(jī)數(shù)據(jù)集進(jìn)行實(shí)驗(yàn), 選取第76、133和182幀, 如圖 5所示. 由圖 5可見, 本文算法可有效檢測(cè)和跟蹤大部分行人, 且實(shí)時(shí)性與之前檢測(cè)跟蹤實(shí)驗(yàn)結(jié)果具有相同數(shù)量級(jí), 但對(duì)于相互遮擋和全身信息不全的行人檢測(cè)跟蹤效果相對(duì)較差.

圖 5 無人機(jī)數(shù)據(jù)集跟蹤結(jié)果

4 結(jié)論

本文在YOLOv3和Deep-SORT算法的基礎(chǔ)上, 針對(duì)實(shí)時(shí)性問題, 使用輕量級(jí)網(wǎng)絡(luò)MobileNet代替原有網(wǎng)絡(luò)結(jié)構(gòu)對(duì)檢測(cè)模型進(jìn)行壓縮. 實(shí)驗(yàn)結(jié)果表明, 盡管改進(jìn)算法由于更淺的網(wǎng)絡(luò)結(jié)構(gòu)和未使用殘差網(wǎng)絡(luò)等因素導(dǎo)致精度下降, 但實(shí)時(shí)性提高顯著, 實(shí)現(xiàn)了精度和速度間的折衷, 達(dá)到了快速有效跟蹤的目的.

審核編輯:湯梓紅

-

算法

+關(guān)注

關(guān)注

23文章

4697瀏覽量

94689 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5554瀏覽量

122449

發(fā)布評(píng)論請(qǐng)先 登錄

視頻跟蹤目標(biāo)跟蹤算法簡(jiǎn)介(上海凱視力成信息科技有限...

多目標(biāo)優(yōu)化算法有哪些

一種適用于空間觀測(cè)任務(wù)的實(shí)時(shí)多目標(biāo)識(shí)別算法分享

基于聚類融合的多目標(biāo)跟蹤算法

多傳感器多目標(biāo)跟蹤的JPDA算法

改進(jìn)霍夫森林框架的多目標(biāo)跟蹤算法

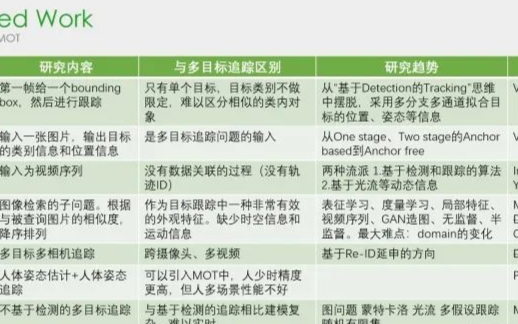

基于深度學(xué)習(xí)的多目標(biāo)跟蹤算法技術(shù)

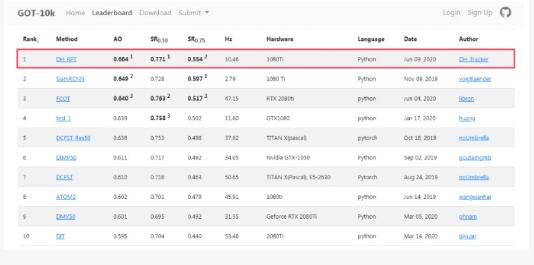

大華股份基于AI深度學(xué)習(xí)的視覺目標(biāo)跟蹤算法獲得排行榜第一

深度學(xué)習(xí):多目標(biāo)跟蹤方向調(diào)研報(bào)告

新型基于深度學(xué)習(xí)的目標(biāo)實(shí)時(shí)跟蹤算法

多目標(biāo)跟蹤過程中的數(shù)據(jù)關(guān)聯(lián)技術(shù)綜述

基于卷積特征的多伯努利視頻多目標(biāo)跟蹤算法

最常見的目標(biāo)跟蹤算法

多目標(biāo)跟蹤算法總結(jié)歸納

評(píng)論