隨著消費電子、生物醫學和物聯網/工業物聯網市場中始終監聽設備的爆炸式增長,似乎每個人都在嘗試使用模擬來節省設計中的功耗。隨著使用“模擬內存計算”來降低處理器功耗的新型機器學習(ML)數字芯片,半導體供應商正在發明新的方法來利用模擬計算的固有功耗和計算效率。那么,有什么障礙呢?事實是,盡管這些芯片利用模擬電路的固有優勢來節省芯片內的功耗以進行神經網絡處理,但它們最終是在數字域中對數字數據運行的數字處理芯片,這意味著它們只能為系統提供有限的節能效果。幸運的是,一種更全面地使用模擬計算的新系統級方法(模擬機器學習 (analogML) 內核)現在可以在系統級別實現更高的電源效率。

雖然模擬內存計算和模擬ML有時都被標記為“模擬計算”,但它們絕不是一回事。設計人員需要了解模擬內存計算和 analogML 內核之間的區別,以便創建更節能的終端設備?

內存模擬計算的芯片級效率

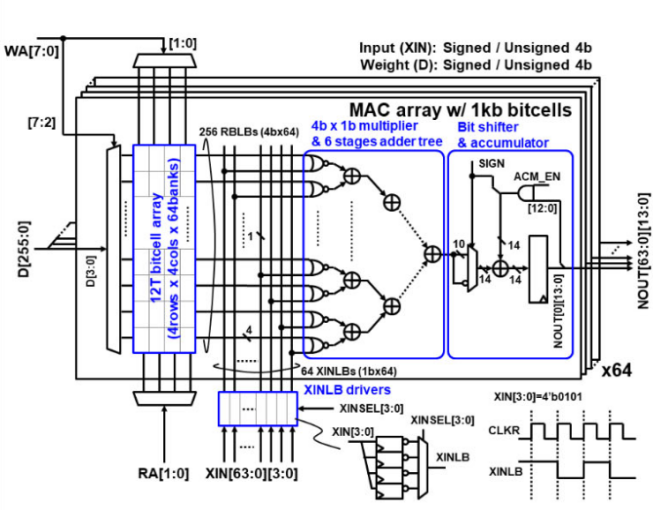

模擬內存計算通常是指在數字機器學習處理器的神經網絡中使用模擬電路,以便以較低的功耗執行乘法累加 (MAC) 功能。但是,利用這種方法的芯片仍然是在標準數字處理范式中運行的時鐘處理器,需要立即將所有模擬傳感器數據數字化,無論是否相關。事實上,使用模擬內存計算的芯片實際上需要在確定數據的重要性之前進行三次單獨的數據轉換。傳感器數據立即轉換為數字以進行初始處理(數字化優先架構),然后在芯片內轉換為模擬以用于MAC功能,最后,它們在芯片內轉換為數字,用于推理,分類和其他功能所需的額外數字處理。因此,大量的數據轉換,但實際的模擬處理并不多。

雖然模擬內存計算可能會降低單個推理芯片的功耗,但它僅以非常有限的方式使用模擬,因此它只能為整個系統提供同樣有限的功耗降低。

通過模擬機器學習實現系統級效率

相比之下,analogML 內核完全在模擬域內運行,無需時鐘,并在數字化任何數據之前使用原始模擬傳感器數據進行推理和分類。analogML 內核集成到始終偵聽的設備中,在花費任何功率進行單次數據轉換之前確定數據的重要性。我們稱之為“先分析”,因為模擬ML內核使數字系統保持關閉,除非檢測到相關數據。

與集成模擬內存計算的 ML 芯片相比,analogML 內核處理模擬傳感器數據的更簡化方法對系統級效率具有重大影響。

例如,在典型的語音優先系統中,analogML 內核在 100% 的時間內處于開啟狀態,在始終監聽模式下僅消耗 10μA 的電流,以確定哪些數據是重要的(分析優先架構),然后再在數字化上花費任何功率。這使系統的其余部分保持睡眠狀態,直到檢測到相關數據。與在數字域中 100% 運行(數字化優先架構)并消耗高達 3000-4000μA 的更傳統的 ML 芯片相比,使用 analogML 的分析優先方法可將電池壽命延長多達 10 倍。這就是可持續使用數天而不是數小時的智能耳塞與一次電池充電可持續數年而不是數月的聲控電視遙控器之間的區別。

AnalogML 核心中有什么?

深入了解 analogML 內核的幕后,可以揭示模擬內存計算與 analogML 內核之間的區別,模擬內存計算僅用于神經網絡,后者由多個軟件控制的模擬處理塊組成,我們可以為各種分析優先應用程序啟用、重新配置和調整。這些模塊可以在需要時獨立供電,可實現一系列功能。

傳感器接口—可以為特定傳感器類型(麥克風、加速度計等)合成接口電路

模擬特征提取 — 從原始模擬傳感器數據中挑選出顯著特征,大大減少進入神經網絡的數據量

模擬神經網絡 — 高效、占用空間小、可編程的模擬推理模塊

模擬數據壓縮—連續收集和壓縮模擬傳感器數據支持低功耗數據緩沖

模擬范式轉變

AnalogML 遠遠超出了使用一點模擬計算來節省整個 ML 芯片計算的一小部分,以節省功耗。它是一個完整的模擬前端解決方案,在數據仍然是模擬數據的情況下,使用接近零的功耗來確定信號鏈中最早點的數據的重要性,以最大限度地減少流經系統的數據量和數字系統(ADC/MCU/DSP)的開啟時間。在某些應用中,例如玻璃破碎檢測,事件可能每十年發生一次(或永遠不會發生),使用 analogML 內核使數字系統在 99+% 的時間內保持關閉,可以將電池壽命延長數年。這開辟了一類新的持久遠程應用程序,如果所有數據(無論是否相關)在處理之前都已數字化,則無法實現這些應用程序。

底線是所有模擬計算都不相等。無論芯片中包含多少模擬處理以降低其功耗,除非該芯片在模擬域中運行,在模擬數據上,它不會做我們知道在系統中節省最多功耗的一件事 - 數字處理更少的數據。

審核編輯:郭婷

-

處理器

+關注

關注

68文章

19759瀏覽量

233012 -

物聯網

+關注

關注

2923文章

45702瀏覽量

385885 -

機器學習

+關注

關注

66文章

8481瀏覽量

133909

發布評論請先 登錄

電機泥泵軸系系統扭振設計計算

使用VirtualLab Fusion中分布式計算的AR波導測試圖像模擬

云 GPU 加速計算:突破傳統算力瓶頸的利刃

Fluidyn-PANACHE交通污染仿真案例演示:導入GIS數據快速建模

評論