處理批量數據已移交給系統,特別是人工智能。對于等待的消費者來說,這個過程變得更容易、更快、更方便。

盡管有好處,但算法中的錯誤和漏洞是可能的。然后,這些誤判將轉向對毫無戒心的人口群體可能造成的傷害。

人工智能技術,尤其是機器學習(ML),在很大程度上依賴于遵循模式和檢測異常活動。這種慣例導致它強化歧視性模式。

盡管模式是無縫的,算法看似完美,但不公平的偏見和歧視可以針對特定的群體。這種現象被稱為代理歧視。

什么是代理歧視

既定的心理測試迫使參與者盡可能快地將術語分為兩組。在這個測試中,人們被迫做出不必要的歧視,就像代理歧視中發生的那樣。

制定了反對歧視的政策和法律。有反對工作場所性別、種族、年齡等歧視的政策。然而,具有諷刺意味的是,現代人工智能的使用使得很難指出歧視性案例。事實上,它可以是一個煽動者。

代理歧視如何加劇歧視

使用機器學習導致的代理歧視會造成不同的影響。從法律上講,不同影響是對特定群體造成負面影響的就業或住房中的一種做法。

一個常見的工作場所例子是雇主積極避免雇用有孩子的女性申請人。古老的信念指出,母親不能成為好工人,因為她們不能專注于工作。然而,員工贏得了幾起具有里程碑意義的勞動法案件,因為它被證明是一種明顯的歧視形式。

當考慮到人工智能和代理歧視的背景下,算法處理的所有數據也是自動化的。如果數據是通過網絡抓取收集的,則不再需要人工干預。這意味著該算法不會主動搜索該“母申請人”。

但是,由于母申請人可能呈現與設置為正常組或基本組不同的特征,因此機器仍然會指出母申請人是一個異常值。

通過這種方式,代理歧視成為不同影響的一個高度具體的子集,其中看似無害的算法對特定群體造成傷害。多年前,代理歧視被認為是故意歧視的一個子集。

但是,鑒于人工智能的性質,得出的結論是它根本不是故意的。這是先進技術的不幸副產品。

利用代理歧視

代理歧視可能是無意的,但用戶會找到利用這一過程為自己謀利的方法。不幸的是,故意使用代理歧視正在使歧視性決定和選擇看起來是理性的,純粹是機械的。

代理歧視被一些用戶用作一種解決方法,以消除與其選擇相關的歧視氣氛。這就像安全網的答案,當他們的決定背后的原因受到質疑時。

保險業的代理歧視

人工智能被證明是保險業的重要工具。它在處理批量數據、欺詐檢測、費率設置和定價等時派上用場。另一方面,也存在隨之而來的風險,代理歧視就是其中之一。

如前所述,人工智能不能故意區分信息鏈。它意味著沒有任何形式的偏見。但是,它對模式的高度關注使其能夠捕獲通常與特定組關聯的代理數據。它可以是任何類型的數據。

任何類型的客戶端活動都可以被算法斷章取義,并受到代理歧視。這個動作對公司來說可能是麻煩的。那些受到這種前所未有的歧視的人可以提起訴訟并要求賠償損失。

大多數公司將采取額外措施來防止這種情況發生。但是,有些人會利用這一點來發揮自己的優勢。因為他們知道代理歧視的發生,他們會心甘情愿地根據自己的喜好改變算法的元素。

當他們準確地改變元素時,即使具有高度歧視性,結果也將符合他們的需要。關于結果的查詢將是不可避免的,但它們可以簡單地將其作為算法的產物傳遞,并且與算法無關。歸根結底,他們在歧視性和有害決定背后有正當理由。

警惕其他風險

除了代理歧視的危險之外,用戶還必須注意與人工智能技術相關的其他危險。安全總比后悔好。

失業

在考慮未來的創新時,大多數人將它們等同于機器人和其他類型的自動化。這些創新現在就開始了。各行各業更喜歡在其產品的開發和制造階段使用機器人。

以汽車行業為例。機器人手臂不是人,而是出現在汽車的制造過程中。自動駕駛汽車現在成為可能,并且可以商業化分銷。完全自動化流程的直接風險是失去由熟練員工工作的工作。

數據安全風險

由于幾乎所有數據現在都存儲在云中,當人工智能受到不利影響時,數字安全也可能處于危險之中。黑客和網絡釣魚是對數字安全的一些最突出的人工智能相關攻擊。與利用存儲在云中的個人數據相關的危險也迫在眉睫。

結論

人工智能技術的使用是一把雙刃劍。雖然有明顯的好處,但也存在緊迫的問題和風險,例如代理歧視。代理歧視是不可避免的。曾經是中立的聲明或主張可能會對特定人群造成前所未有的傷害。目前還沒有針對這種風險的已知對策。在處理這項技術時,最好也時刻保持警惕。

審核編輯:郭婷

-

人工智能

+關注

關注

1791文章

47206瀏覽量

238278 -

機器學習

+關注

關注

66文章

8408瀏覽量

132572

發布評論請先 登錄

相關推薦

人工智能:重塑生活的便捷與奇跡

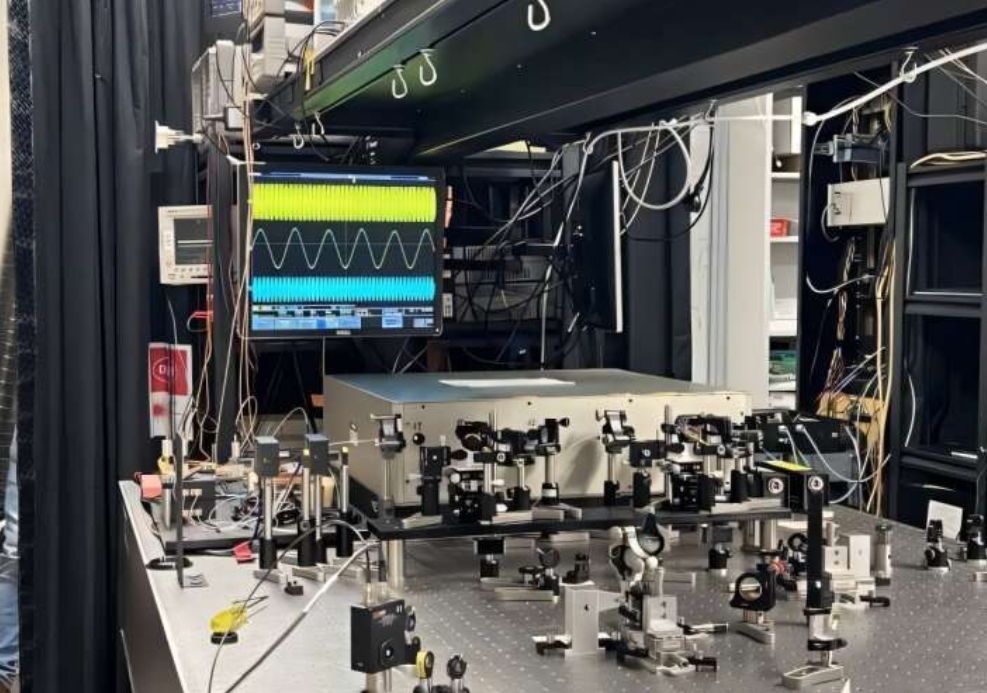

新型寬帶UV頻率梳提供前所未有的光譜分辨率

人工智能前所未有的缺點:代理歧視

人工智能前所未有的缺點:代理歧視

評論