英特爾在自己最擅長(zhǎng)的 CPU 上完成了一次 AI 計(jì)算的革新。

人工智能技術(shù)改變了我們的生活,而說(shuō)到 AI 背后的算力,人們經(jīng)常會(huì)先想到 GPU。從 2019 年英特爾為其第二代至強(qiáng)可擴(kuò)展處理器增添了內(nèi)置的深度學(xué)習(xí)加速技術(shù)后,原本定位通用計(jì)算的 CPU 芯片,也加入了為 AI 加速的行列。

今天,代號(hào)為「Sapphire Rapids」的第四代至強(qiáng)可擴(kuò)展處理器也在中國(guó)迎來(lái)發(fā)布首秀,除了一系列微架構(gòu)的革新和技術(shù)規(guī)格的升級(jí)外,新 CPU 對(duì) AI 運(yùn)算「更上層樓」的支持也格外引人關(guān)注,其背后的技術(shù)助力,也是英特爾在這代產(chǎn)品中增添的全新內(nèi)置 AI 加速器 —— 英特爾高級(jí)矩陣擴(kuò)展(AMX)技術(shù)自然也成為了焦點(diǎn)。

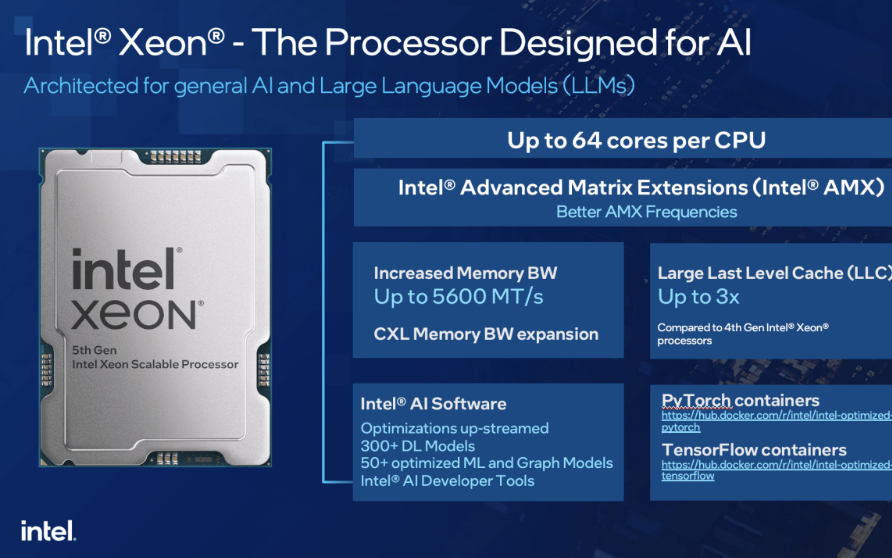

作為焦點(diǎn),當(dāng)然要拿出實(shí)力來(lái)證明自己的價(jià)值 —— 在發(fā)布會(huì)上,英特爾透露的第四代至強(qiáng)可擴(kuò)展處理器的基礎(chǔ)算力平均提升值為 53%,而在 AMX 的助推下,其在 PyTorch 上的 AI 實(shí)時(shí)推理速度,可提升至上一代產(chǎn)品(FP32)的 5.7-10 倍,訓(xùn)練性能提升最高也能提升到上一代產(chǎn)品的 10 倍…… 這意味著,這款新至強(qiáng),把業(yè)界頂級(jí) CPU 的性能門(mén)檻一下子提高了不少。

新一代英特爾 CPU 為 AI 任務(wù)處理找到了新方向。現(xiàn)在,英特爾可以通過(guò)新 CPU 和 GPU 實(shí)現(xiàn)對(duì)各類 AI 任務(wù)的加速。為實(shí)現(xiàn)這些提升,英特爾引入了一系列內(nèi)置加速單元。

多種加速器加持,

提升 AI 訓(xùn)練、推理及端到端性能

AI 的熱度,從 AlphaGo 一鳴驚人后,一直就沒(méi)有減退。最近一段時(shí)間,人們都在談?wù)?ChatGPT 等「大模型」帶來(lái)的革命性體驗(yàn)。由預(yù)訓(xùn)練模型方法推動(dòng)的 AI 技術(shù)正在向跨任務(wù)、跨模態(tài)的方向演進(jìn),已成為當(dāng)下 AI 技術(shù)發(fā)展的重要趨勢(shì)。

然而,大模型雖然帶來(lái)了前所未有的 AI 能力,又對(duì)算力提出了無(wú)窮無(wú)盡的需求。芯片制造商和科技公司一直在尋找提升 AI 應(yīng)用效率的方法。GPU 更多解決的,是訓(xùn)練效率,是探索 AI 算法邊界的能力,而 CPU,似乎更適合在 AI 應(yīng)用的規(guī)模化部署和實(shí)踐上發(fā)揮重要作用。

自從四五年前開(kāi)始在 CPU 中內(nèi)置針對(duì) AI 進(jìn)行加速的專用運(yùn)算單元或指令集后,英特爾就一直相信,如果想要在更為廣泛的行業(yè)中真正推進(jìn) AI 應(yīng)用的普及,那么就應(yīng)該充分利用現(xiàn)階段應(yīng)用和部署最為廣泛的 IT 基礎(chǔ)設(shè)施和架構(gòu),也就是要更加充分地利用 CPU 的資源。畢竟使用 GPU 和其他專用加速器的成本以及知識(shí)和人才門(mén)檻都非常高。相比之下,CPU 內(nèi)置 AI 加速能力,主攻 AI 推理加速,并搭配以更為簡(jiǎn)單易用、能夠部署和優(yōu)化難度的軟件工具,會(huì)是一條更為行之有效的路徑。

它是這么想,也是這么做的 —— 首先,從 2017 年第一代至強(qiáng)可擴(kuò)展芯片開(kāi)始,英特爾就開(kāi)始利用英特爾高級(jí)矢量擴(kuò)展 512 技術(shù)(AVX-512 指令集)的矢量運(yùn)算能力對(duì) AI 進(jìn)行加速上的嘗試,到 2018 年英特爾在第二代至強(qiáng)可擴(kuò)展芯片導(dǎo)入深度學(xué)習(xí)加速(DL Boost)技術(shù),更是讓至強(qiáng)成為了首款集成 AI 加速有力的主流數(shù)據(jù)中心級(jí) CPU,或者說(shuō):CPU 加速 AI 的代名詞。

2020 年通過(guò)擴(kuò)展出 bfloat16 加速功能,面向多路服務(wù)器的第三代至強(qiáng)可擴(kuò)展處理器在推理加速能力之外,又增加了訓(xùn)練加速能力,已被證明可以幫助業(yè)界大量 AI 工作負(fù)載實(shí)現(xiàn)更優(yōu)的性能和功耗比。

就在大家認(rèn)為英特爾在 CPU 加速 AI 的技術(shù)創(chuàng)新和投入會(huì)止步于此的時(shí)候,第四代至強(qiáng)可擴(kuò)展芯片,又帶來(lái)了矩陣化的算力支持 ——AMX。

第四代英特爾至強(qiáng)可擴(kuò)展處理器。

這種全新內(nèi)置 AI 加速器的出現(xiàn),進(jìn)一步驗(yàn)證了「與其增加 CPU 內(nèi)核數(shù)和時(shí)鐘頻率,加入和更新專用計(jì)算單元對(duì)提升 AI 工作負(fù)載性能更有效」這一思路。正如前文所述,第四代至強(qiáng)可擴(kuò)展芯片不僅可借助 AMX 實(shí)現(xiàn)相當(dāng)于上一代芯片(FP32)10 倍的 AI 性能提升,與前兩代產(chǎn)品使用的深度學(xué)習(xí)加速技術(shù)相比,其理論性能(每秒操作量)最高也可以達(dá)到其 8 倍之多。

機(jī)器學(xué)習(xí)包含大量的矩陣計(jì)算,在主打通用計(jì)算的 CPU 上,此類任務(wù)會(huì)被轉(zhuǎn)換為效率較低的向量計(jì)算,而在加入專用的矩陣計(jì)算單元后,至強(qiáng) CPU 的 AI 能力有了巨大的提升。因此,AMX 可以被視為至強(qiáng) CPU 上的「TensorCore」—— 從原理上看,CPU 上的 AI 加速器實(shí)現(xiàn)的目的和 GPU、移動(dòng)端處理器上的類似。由于 AMX 單元對(duì)底層矩陣計(jì)算進(jìn)行加速,理論上它對(duì)于所有基于深度學(xué)習(xí)的 AI 應(yīng)用都能起到效果。

如果說(shuō) AMX 為至強(qiáng) CPU 帶來(lái)的是直觀的推理和訓(xùn)練加速,那么第四代至強(qiáng)可擴(kuò)展芯片內(nèi)置的其他幾種加速器,就是為 AI 端到端應(yīng)用加速帶來(lái)的驚喜。

這是因?yàn)樵谡嬲暾?AI 應(yīng)用流水線中,任務(wù)往往會(huì)從數(shù)據(jù)的處理和準(zhǔn)備開(kāi)始,在這一階段,第四代至強(qiáng)可擴(kuò)展芯片內(nèi)置的數(shù)據(jù)流加速器(DSA),可讓數(shù)據(jù)存儲(chǔ)與傳輸性能提升到上一代產(chǎn)品的 2 倍,而專門(mén)針對(duì)數(shù)據(jù)庫(kù)和數(shù)據(jù)分析加速的英特爾存內(nèi)分析加速器(IAA),也可將相關(guān)應(yīng)用的性能提升到上一代產(chǎn)品的三倍(RocksDB);數(shù)據(jù)保護(hù)與壓縮加速技術(shù)(QAT),則能在內(nèi)核用量減少多達(dá) 95% 的情況下將一級(jí)壓縮吞吐量提升至原來(lái)的兩倍。這些技術(shù)的使用,也有助于 AI 端到端應(yīng)用性能的整體躍升。

此外,隨著 AI 應(yīng)用在更多行業(yè),包括金融、醫(yī)療等數(shù)據(jù)敏感型行業(yè)的落地,人們對(duì)于數(shù)據(jù)安全合規(guī)的要求逐漸提高,聯(lián)邦學(xué)習(xí)等技術(shù)逐漸獲得應(yīng)用。在這一方面,至強(qiáng)可擴(kuò)展處理器集成的專攻數(shù)據(jù)安全強(qiáng)化的加速器 —— 軟件防護(hù)擴(kuò)展(SGX),也是大有用武之地,它的突出優(yōu)勢(shì)就是可以為處理中或運(yùn)行中的敏感數(shù)據(jù)和應(yīng)用代碼提供與其他系統(tǒng)組件和軟件隔離的安全飛地,實(shí)現(xiàn)更小的信任邊界。

這種技術(shù)對(duì)于 AI 而言,最核心的價(jià)值就是可以讓有多方數(shù)據(jù)交互、協(xié)作的 AI 訓(xùn)練過(guò)程變得更加安全,各方數(shù)據(jù)都可以在其擁有者的本地參與訓(xùn)練,用于訓(xùn)練的數(shù)據(jù)和模型會(huì)被安全飛地所保護(hù),最終模型可以在這種保護(hù)下提升精度和效率,但為其演進(jìn)做出了關(guān)鍵貢獻(xiàn)的數(shù)據(jù)則會(huì)一直處于「可用而不可見(jiàn) 」的狀態(tài)下,以確保其中的敏感和隱私信息的安全性。

在這么多內(nèi)置加速器的支持下,可以說(shuō),從數(shù)據(jù)預(yù)處理,到訓(xùn)練,再到推理,最后到整個(gè) AI 應(yīng)用的安全保護(hù)層面,第四代至強(qiáng)可擴(kuò)展處理器都實(shí)現(xiàn)了更全面的功能覆蓋和重點(diǎn)增強(qiáng)。與此同時(shí),英特爾還在進(jìn)一步強(qiáng)化 AI 加速的開(kāi)箱即用優(yōu)勢(shì):通過(guò)與大量第三方進(jìn)行合作,英特爾共同優(yōu)化了 SAP HANA、Microsoft SQL Server、Oracle、VMware Cloud Foundation、Red Hat OpenShift 等主流應(yīng)用,很多主流軟件庫(kù)和開(kāi)源機(jī)器學(xué)習(xí)框架,以及大多數(shù)云服務(wù)也對(duì)這款英特爾架構(gòu)上的新品做好了優(yōu)化,開(kāi)發(fā)者可以直接使用新硬件開(kāi)發(fā)和部署 AI 算法。

從開(kāi)發(fā)者的角度看,使用第四代至強(qiáng)可擴(kuò)展處理器實(shí)現(xiàn)優(yōu)化加速的門(mén)檻也確實(shí)很低:人們只需使用集成在 TensorFlow 和 PyTorch 中的庫(kù),無(wú)需任何額外工作即可激活至強(qiáng)芯片內(nèi)置 AI 加速的能力。此外,只需更改幾行代碼,開(kāi)發(fā)人員就可以無(wú)縫地加速單節(jié)點(diǎn)和多節(jié)點(diǎn)配置中的 Scikit-learn 應(yīng)用。

全能服務(wù)器 CPU

除了有加速器傍身專攻特定應(yīng)用負(fù)載外,第四代至強(qiáng)可擴(kuò)展處理器在基礎(chǔ)性能上也是可圈可點(diǎn)。

例如,它采用了與英特爾第 12、13 代酷睿同款的 Intel 7 制造工藝(改進(jìn)版 10nm 制程)和 Golden Cove CPU 架構(gòu),同時(shí)首次引入 chiplet 小芯片封裝方式,最多可搭載 60 個(gè)核心,改用新的 Socket E LGA4677 封裝接口,集成了 112MB 三級(jí)緩存,功耗最高達(dá)到 350W。

新一代至強(qiáng)還帶來(lái)了對(duì)八通道 DDR5-4800 和 PCIe 5.0 的支持,并包含 CXL 1.1 高速互連總線,可選集成最多 64GB HBM2e 內(nèi)存。

上述這些針對(duì) IO 和存儲(chǔ)的新技術(shù)的引入,使得第四代至強(qiáng)可擴(kuò)展處理器具備了能夠打破帶寬瓶頸的 I/O 能力,讓使用者可以充分利用處理器的代際性能提升滿足 AI 平臺(tái)等業(yè)務(wù)對(duì)于通用算力的苛刻需求。

四代至強(qiáng)可擴(kuò)展處理器平臺(tái)特性。

綜合這些基礎(chǔ)芯片架構(gòu)規(guī)模上的升級(jí)和革新,以及各種加速器的特定加成效果,第四代至強(qiáng)可擴(kuò)展處理器的基礎(chǔ)算力相比上一代產(chǎn)品可提升 53%,而其能效,或者說(shuō)每瓦性能,相比上一代產(chǎn)品也提升了 2.9 倍,這意味著更高的效率,更低的功耗和更優(yōu)的投資回報(bào)率。

英特爾表示,新一代 CPU 還可以催生出前所未有的應(yīng)用,幫助 AI 算法直接利用非結(jié)構(gòu)化數(shù)據(jù)進(jìn)行實(shí)時(shí)分析。在金融、醫(yī)療、零售等行業(yè)中,人們可以利用機(jī)器學(xué)習(xí)作出更加精確的投資決策,降低術(shù)后并發(fā)癥風(fēng)險(xiǎn),更好地理解消費(fèi)者的需求。

構(gòu)建下一代異構(gòu) AI 算力

在不斷尋求創(chuàng)新業(yè)務(wù)的過(guò)程中,人們對(duì)于算力的需求相比以往正變得更加迫切。而且這種算力也必須要兼顧到通用和專用的不同方向。因此英特爾架構(gòu)也正在就此有針對(duì)性的演進(jìn),這在本次第四代至強(qiáng)可擴(kuò)展處理器的發(fā)布會(huì)上就可見(jiàn)一斑 —— 對(duì)科學(xué)計(jì)算和 AI 加速有更苛刻要求的用戶,也等來(lái)了英特爾數(shù)據(jù)中心 GPU 旗艦產(chǎn)品 ——MAX 系列的發(fā)布。

其實(shí)在過(guò)去幾年里,英特爾已經(jīng)陸續(xù)推出了一些異構(gòu)產(chǎn)品,例如 2022 年英特爾旗下的 Habana Labs 正式發(fā)布了用于深度學(xué)習(xí)訓(xùn)練的 Gaudi2,隨之被應(yīng)用在 AWS 上。同年夏天主打視覺(jué)云應(yīng)用的數(shù)據(jù)中心 GPU Flex 系列也在視頻處理、云游戲和視覺(jué) AI 推理應(yīng)用中初露頭腳,但很多「發(fā)燒級(jí)」用戶最期待的還是數(shù)據(jù)中心 GPU Max 系列,今天,這款采用了突破性設(shè)計(jì),采用多芯片集合的方式,混合 5 種工藝,晶體管數(shù)量超過(guò)千億的 「怪獸」,終于來(lái)了!

GPU 產(chǎn)品線的完善,也使得英特爾成為業(yè)界唯一一家能提供橫跨 CPU、GPU、ASIC、FPGA 四大類型芯片計(jì)算解決方案的供應(yīng)商,可為智能數(shù)據(jù)中心提供基于任何場(chǎng)景、需求的產(chǎn)品組合。

強(qiáng)大的硬件之外,英特爾還利用 oneAPI 軟件體系實(shí)現(xiàn)了對(duì)異構(gòu)硬件的統(tǒng)一編程和管理,構(gòu)建了能夠靈活調(diào)配、無(wú)縫協(xié)作和低門(mén)檻的 AI 開(kāi)發(fā)工具。通過(guò) XPU 硬件、oneAPI 軟件及 UCIe 開(kāi)放標(biāo)準(zhǔn)的布局,英特爾已經(jīng)打造出了軟硬一體化的完整生態(tài)。

隨著新一代芯片發(fā)布,我們或許將看到未來(lái) AI 計(jì)算的形態(tài)發(fā)生重要轉(zhuǎn)變。

審核編輯:湯梓紅

-

處理器

+關(guān)注

關(guān)注

68文章

19265瀏覽量

229677 -

英特爾

+關(guān)注

關(guān)注

61文章

9953瀏覽量

171702 -

cpu

+關(guān)注

關(guān)注

68文章

10855瀏覽量

211608 -

gpu

+關(guān)注

關(guān)注

28文章

4729瀏覽量

128901 -

AI

+關(guān)注

關(guān)注

87文章

30763瀏覽量

268909

原文標(biāo)題:新至強(qiáng)訓(xùn)練推理增效十倍,英特爾CPU加速AI更上一層樓

文章出處:【微信號(hào):英特爾中國(guó),微信公眾號(hào):英特爾中國(guó)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

使用英特爾AI PC為YOLO模型訓(xùn)練加速

英特爾發(fā)布全新企業(yè)AI一體化方案

英特爾發(fā)布全新企業(yè)AI一體化解決方案

英特爾至強(qiáng)品牌新戰(zhàn)略發(fā)布

英特爾攜手百度智能云加速AI落地

開(kāi)箱即用,AISBench測(cè)試展示英特爾至強(qiáng)處理器的卓越推理性能

巧了不是,原來(lái)你也不知道啥是去耦電容的“濾波半徑”啊!

騰訊云推出全新大模型定價(jià)策略:免費(fèi)并降低API費(fèi)用

英特爾確認(rèn)Ponte Vecchio GPU將以云服務(wù)形式推出

研華宣布并購(gòu)法國(guó)POS及KIOSK品牌公司Aures,深化布局全球智慧零售

英特爾升級(jí)AI PC加速計(jì)劃

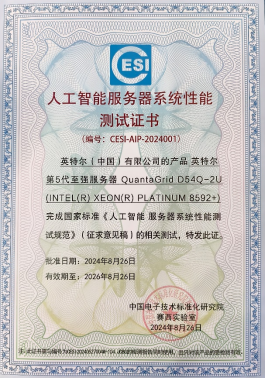

第五代英特爾至強(qiáng)處理器,AI特化的通用服務(wù)器CPU

新至強(qiáng)訓(xùn)練推理增效十倍,英特爾CPU加速AI更上一層樓

新至強(qiáng)訓(xùn)練推理增效十倍,英特爾CPU加速AI更上一層樓

評(píng)論