由于現在的自動駕駛技術還處于發展階段,無法保證自動駕駛車在任何天氣條件下和任何道路環境中都可以安全行駛的。因此,要根據該系統的能力來提前設定好ODD,通過限制行駛環境和行駛方法,將有可能發生的事故防范于未然。然而,對于這類運行環境邊界條件而言,通常會需要考慮如何進行有效的檢測呢?也就是說,提出的ODD對于自動駕駛開發而言必須是可測的。

考慮一些ODD所涉及的天氣如風、雨、雪、雨夾雪、高低溫度會極大的影響整個系統的控制能力。比如車子正常行駛在高速公路上,小雨或小雪能使平均速度降低3%至13%;暴雨會使平均速度降低3%到16%;在大雪中,高速公路的平均速度會下降5%到40%;小雨時自由流速可降低2% ~ 13%;大雨時可降低6% ~ 17%;降雪將使自由流速度降低5%至64%;可以說在降雨期間,整個車輛駕駛速度變化差不多會減少25%。

目前知道的,L2級自動駕駛在雨雪條件下的性能幾乎不能滿足預期,比如車道保持功能在公路雪地打滑時汽車會轉向過度。特斯拉的Autopilot可以在正常的雨雪中導航,路標清晰可見,但在某些棘手的情況下,如暴雨或車道線出現遮蓋時候仍然難以駕駛。顯然,惡劣的天氣條件限制了人類駕駛方向盤,AVs仍然不能完全相信它能獨自工作。

因此,為了讓ADS繼續向前推進到下一個時代,自動駕駛汽車需要更多的時間來適應各種天氣。

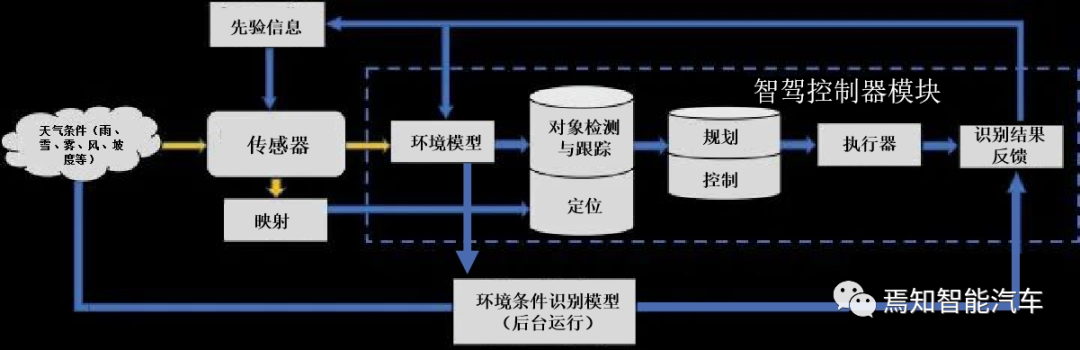

如圖所示是惡劣天氣下自動駕駛系統的信息流圖:

如上圖所示,作為車輛傳感器的信息源,環境狀態直接受到天氣條件的影響。這些變化增加了整個ADS系統用受損數據完成目標檢測、跟蹤和定位任務的難度,因此規劃和控制也將不同于正常情況。天氣也可能影響自車本身,并產生附加影響,如風和路面狀況。自車識別結果反饋整車后形成的車輛控制狀態(如雨刮是否啟動,除霧裝置是否打開等信息)都是可以作為環境信息判斷的先驗信息的,這也會間接影響對環境狀態的判斷,由此可以形成一個檢測循環。

其實,無論從自動駕駛角度還是從手動駕駛角度上講,對于環境的有效檢測都將顯得尤為必要。比如如下的環境條件而言,我們是否可以通過一定的手段進行更加精確的檢測呢?

風力大小:從橫向車控角度分析,考慮風阻對整個車身控制的影響。

光照條件:考慮炫目和夜晚可視效果的影響

雨量大小:基于視覺的雨量傳感測試

路面坑洼:基于多目時覺得路面條件檢測。

橫縱坡道檢測:基于底盤ESP和TCU的坡道數據

涉水路面檢測:基于超聲波數據

那么這類雨雪天氣將如何測量則是我們需要研究的一個課題。常規的方法是通過類似雨量傳感器這樣的裝置進行測量,但是這類裝置在很多車型上也不是標配。如果考慮智駕系統而言,則可能出現無法滿足測量需求的情況。

本系列文章將針對性講解整個智駕系統如何利用自身傳感器對環境信息進行初級有效探測。無論從智駕本身角度出發的識別和控制,還是從傳統駕駛過程對這種探測能力都顯得尤為必要。

基于視覺的降雨量預測

對于自動駕駛系統而言,通常會通過判定降雨/降雪量來判定對整個系統是否可激活的前置條件。通常情況下,目前的檢測手段要么是通過雨刮刮速大小,要么是通過雨量傳感器一類來進行綜合判斷是否觸及ODD邊界。那么,從自車平臺化和可應用場景的角度出發,是否能夠利用自車傳感器開發一種可自適應測量環境條件的軟件模塊呢?答案是肯定的。

本文提出一種基于視覺場景的降雨量預測算法。其主要是通過自車原有的攝像頭采集雨量光線,從而計算雨量大小,轉化成雨刮器可識別的指令信號發送給車身控制器,車身控制器通過雨刮信號指令自動控制雨刮進行低速、高速、間歇性動作。同時,系統可以控制儀表顯示雨刮控制系統的相關零部件故障、以提醒用戶及時維修和更換等。

用軟件算法代替增加新的硬件(定制的雨刮傳感器或其他硬件設備)實現對雨刮的控制功能,不但可以減少成本,軟件也可以通過不斷更新、迭代、升級來達到最優的用戶體驗。此外,如果考慮通過利用智駕域的傳感器探測的算法來實現整個車身的控制(比如探測到雨量過大,則通過算法計算出雨量大小,自動控制車輛雨刮采用一定的速度刮刷玻璃,一方面可以為整個傳感器探測開辟更好的探索通道,另一方面也可以提升用戶駕駛的智能化體驗)。

相應的實現原理如下:

總體來說,需要通過兩階段算法來實現,實現基于視覺的場景降雨量的智能分類,其類別包括:晴天、小雨、中雨、大雨、暴雨五種。其方法是利用智能駕駛汽車上搭載的攝像頭拍攝的視頻數據作為輸入,記錄不同位置、不同時域的降雨數據。將視頻數據輸入“降雨量識別大小的分類算法模塊”中。該算法模塊涉及對環境的目標提取、分割、聚類、識別等子模塊。歸類起來,常用的算法包括基于超像素(Super-Pixel)鄰域對齊的雨水分割算法(得到逐幀雨水圖分割結果)和基于ResNet的雨量分類算法(帶有殘差學習的ResNet)的兩個階段。

基于超像素鄰域對齊的降雨/降雪檢測算法

由于視頻中對雨水的分割是不存在分割前景和背景區域的,如果按照逐像素進行識別處理,對于整個算法而言將顯得比較臃腫。我們對雨水大小的識別需要從以下幾個方面入手:

選定的算法通過測量降雨量視頻中不同時域間像素值的區域強度變化,進而得到每一幀圖像的雨水分割結果,通過迭代優化訓練,不斷提高其識別精度,進而達到預期的識別結果。

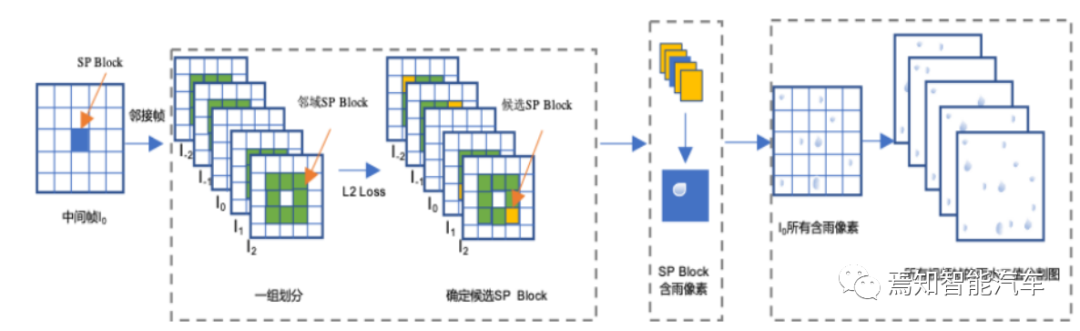

相應的示意圖如下:

1)通過智能汽車采集的一組降雨視頻,截取固定幀數作為視頻輸入算法模塊。

2)幀內超像素塊識別:

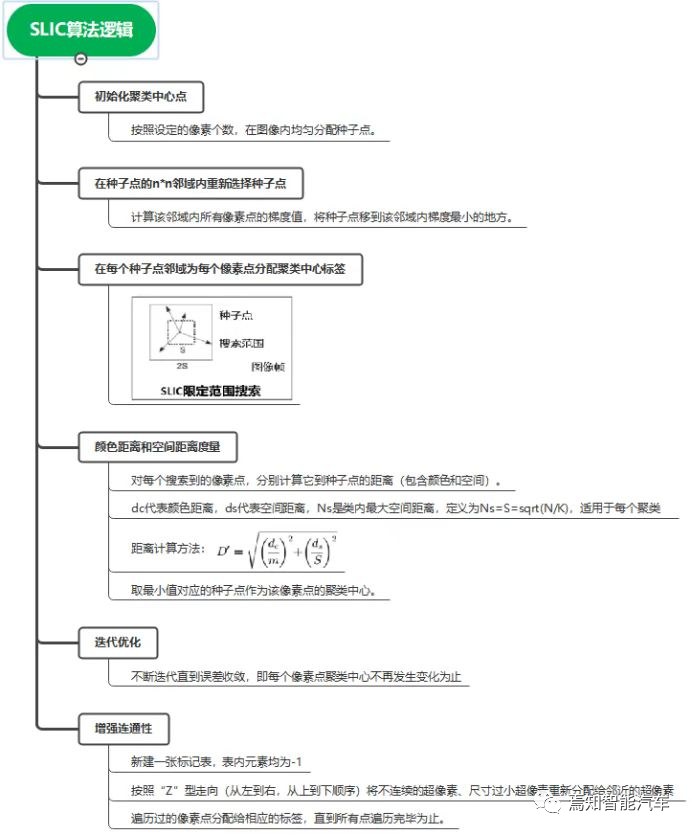

常用的算法包括利用SLIC算法(simple linear iterative cluster)生成每一幀圖像的超像素(superpixel)塊。相比其他的超像素分割方法,SLIC在運行速度、生成超像素的緊湊度、輪廓保持方面都比較理想。具體過程包括:

利用像素之間特征相似性(如相似紋理、顏色亮度等特征)將像素分組,通過簡單的線性迭代聚類,將彩色圖像轉化為CIELAB顏色空間和XY坐標下的5維特征向量,然后對5維特征向量構造距離度量標準,對圖像像素進行局部聚類。最終能生成緊湊、近似均勻的超像素,在運算速度、物體輪廓保持、超像素形狀方面具有較高的性能。最終,用少量的超像素代替大量的像素來表達圖片特征。

3)幀間超像素塊劃分:

選定中間幀為關鍵幀I0,并作為參考位置幀,與其前后各兩幀的超像素塊圖構成一組劃分區域。

4)構造損失函數:

通過逐像素遍歷的方式可以構造Loss損失函數,從而衡量每個I0超像素塊與其前后兩幀對應位置鄰域塊的差異大小。并將其差異最小的鄰域塊作為候選對齊區域,最終確定I0中每個像素塊的4個候選超像素塊區域。

5)雨水識別:

由于雨水部分可以增加像素的強度值,因此可以將含有I0的超像素塊與候選區域的部分進行像素差異比較。若I0超像素塊中的像素與每個候選區域所對應像素差異均大于所設定的雨水像素的閾值時,那么就認為該像素為雨像素。

6)幀內迭代優化:

迭代I0中每一個超像素塊,可以得到關鍵幀I0的雨水二分割圖。

7)幀間迭代優化:

迭代降雨量視頻中的每一幀,得到全部幀的雨水分割結果。

基于深度學習的降雨/降雪量測量算法

如前所述,對雨/雪這類目標分割完成后,需要重新利用一定有效的算法對降雨/降雪的大小進行預分類識別。同時,從時域的角度上將降雨和降雪在未來一定時間內可能產生的情況和趨勢進行有效預測,以便在形勢策略上可以提前做出一定的判斷和控制。

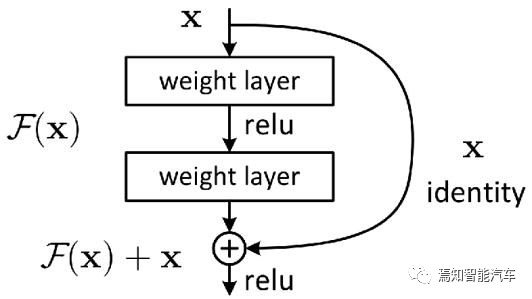

如上述算法所表述的部分,我們可以通過首先聚類超像素鄰域對齊的方式得到雨量場景分割結果,將該結果作為數據輸入到深度學習神經網絡中從而獲得準確的雨量分類結果。常用的卷積神經網絡模型涉及ResNet,因為其引入了深度殘差學習算法,可以有效的解決網絡退化的問題。在包括圖像網絡ImageNet的多個大型分類數據集上可以很好的實現優異的分類精度。

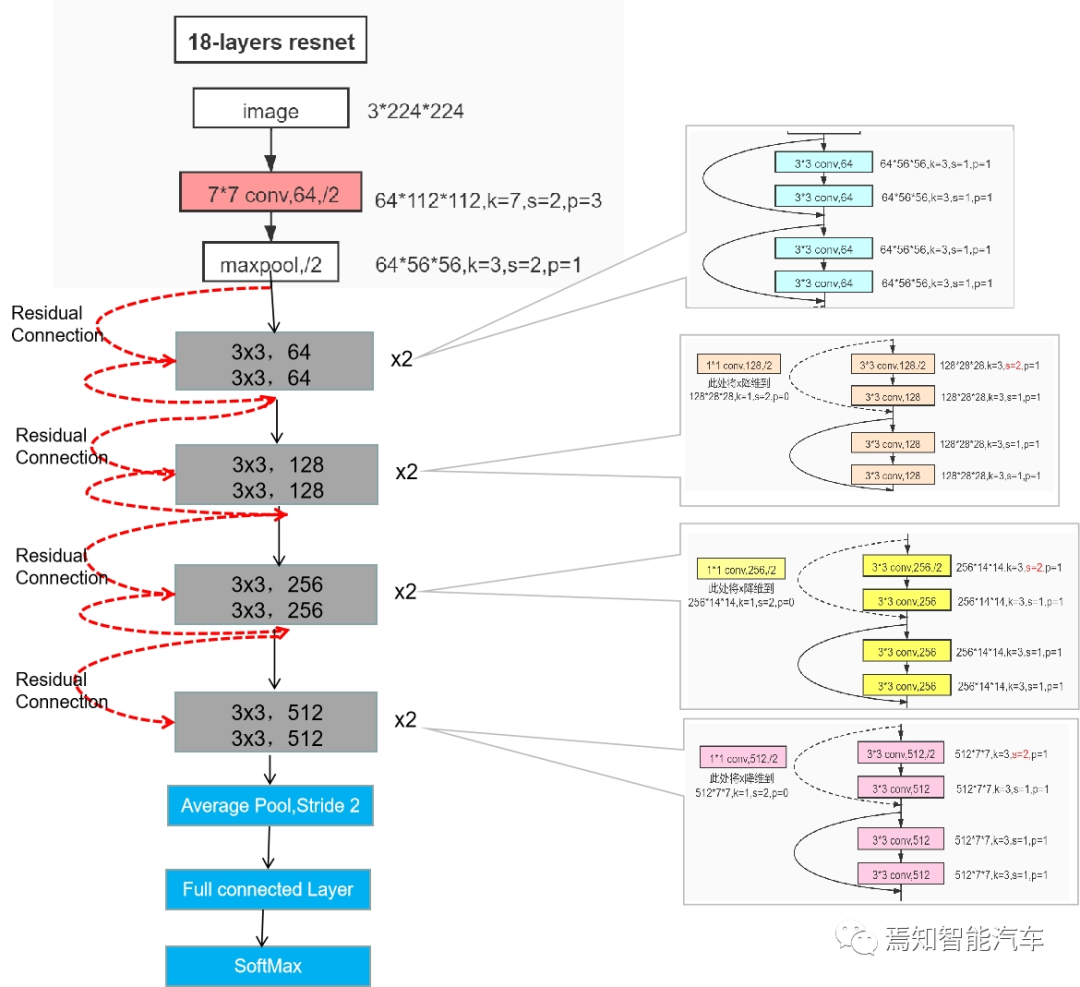

在對降雨/降雪這類場景的測量可以利用ResNet網絡結構通過不同的分層ResNet18、ResNet34、ResNet50、ResNet101以及ResNet152來實現分層訓練。各種網絡的深度指的是“需要通過訓練更新參數”的層數,如卷積層,全連接層等。同時,為了滿足輕量化要求,通常可以選擇ResNet18作為分層標準進行訓練。其中包含17個卷積和一個全連接層進行權重學習,隨后通過兩個池化層處理。

根據超像素臨域對齊的雨量分割算法可以從場景視頻中獲得場景視頻的雨/雪分割結果作為輸入數據。選擇深度學習方法,獲取準確地雨量/雪量分割結果。

基于深度學習的降雨量預測算法

本文這里提到的關于實現雨量檢測和預測的算法包含兩個階段,考慮對于智駕系統控制過程的高速推理和模型輕量化特點,采用超像素的雨/雪分割加上利用經典的神經網絡算法ResNet進行雨量預測。在ResNet提出之前,所有的神經網絡都是通過卷積層和池化層的疊加組成的。卷積層和池化層的層數越多,獲取到的圖片特征信息越全,學習效果也就越好。

CNN參數個數 = 卷積核尺寸×卷積核深度 × 卷積核組數 = 卷積核尺寸 × 輸入特征矩陣深度 × 輸出特征矩陣深度

常規的神經網絡隨著網絡加深,其相應的準確率隨之下降。使用ResNet神經網絡人為地讓神經網絡某些層跳過下一層神經元的連接,隔層相連,弱化每層之間的強聯系,可以更加精準的預測到環境雨量分割和預測。

將本算法打搭載到各種車載設備上,通過對深度網絡進行身份映射(identity mapping,IM)和殘差映射(residual mapping,RM)優化網絡,隨著不斷地迭代,其殘差映射將逐漸趨于0,最終只剩下身份映射。由此,可以更加實時且精準的預測環境降雨/降雪量。

考慮本算法的ResNet的整個算法邏輯如下:

1)視頻采集:

通過智駕車輛前視、側視攝像頭采集場景視頻作為原始視頻輸入。該視頻幀需要在攝像頭前端進行包含ISP相關的圖像處理;

2)視頻幀抽取:

考慮到算法處理能力對整個處理器可能產生較大的負擔,因此,同需要對視頻幀按照每隔一定時間抽取固定幀數的視頻,采用“超像素鄰域對齊雨量分割算法”進行雨量分割,并得到相應的雨水分割結果;

3)感興趣區域選擇:

對于環境降雨量這類過程處理,因為感興趣的部分是雨水,且分布沒有特定的規律。因此,可以固定的選取每一幀的中間區域作為該視頻幀中感興趣區域(ROI,Region of Interest);

4)視頻張量輸入ResNet模型

對于ResNet網絡就是要構造觀測值與估計值之間的差,也可以用殘差映射函數,也就是F(x),其中F(x) = H(x)-x。這里H(x)就是觀測值,x就是估計值(也就是上一層ResNet輸出的特征映射)。  ?

?

residual結構使用了一種shortcut的連接方式,也可理解為捷徑。讓特征矩陣隔層相加,注意F(X)和X形狀要相同,所謂相加是特征矩陣相同位置上的數字進行相加。

將其按照通道進行拼接,合并為固定通道的張量,并輸入到ResNet模型,預測不同降雨量的概率值;

?

?

5)根據概率值在分類區間的位置,確定最終的降雨量預測結果

實驗證明,ResNet殘差網絡更容易優化,并且加深的網絡層數有助于提高正確率。所以在加深網絡深度的同時,需要使用殘差學習的結構來減輕深層網絡訓練的難度。過程中,需要重新構建優化的網絡以便學習到包含已經推理過的殘差函數,而不是學習未經過推理過的函數。

總結

本文從一些環境設置條件出發考慮如何通過最大化的利用自車配置的軟硬件單元模塊進行有效的ODD設置和檢測,詳細講述如何利用攝像頭傳感器對環境降雨/降雪量進行有效檢測的算法邏輯。

同時,本文就自動駕駛系統設置的ODD邊界中的其中一個要素檢測考慮通過智駕系統自身搭載的傳感器進行實時檢測從而獲取一定的控制輸入源。對于諸如雨量、雪量的檢測結果不僅可以完全用于自動駕駛系統自身的邊界條件控制,也可以作為在車輛未開啟自動駕駛時自動檢測雨量、雪量等環境條件,自適應的控制車輛進行雨刮開啟、增加刮速,如果有類似自動除霜等功能,也可以控制自動開啟自動除霜、除霧等功能。

審核編輯:劉清

-

ODD

+關注

關注

0文章

8瀏覽量

7347 -

自動駕駛

+關注

關注

784文章

13787瀏覽量

166405 -

ADS系統

+關注

關注

0文章

4瀏覽量

6531 -

OTC

+關注

關注

0文章

14瀏覽量

5008

原文標題:那些被自動駕駛所關注的ODD邊界怎么測?

文章出處:【微信號:智能汽車電子與軟件,微信公眾號:智能汽車電子與軟件】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

智能駕駛與自動駕駛的關系

自動駕駛技術的典型應用 自動駕駛技術涉及到哪些技術

車廠如何安全有效做自動駕駛路測?

FPGA在自動駕駛領域有哪些優勢?

FPGA在自動駕駛領域有哪些應用?

如何進行IP檢測

未來已來,多傳感器融合感知是自動駕駛破局的關鍵

自動駕駛發展問題及解決方案淺析

華為自動駕駛技術怎么樣?

如何搞定自動駕駛3D目標檢測!

自動駕駛的ODD邊界如何進行有效的檢測呢?

自動駕駛的ODD邊界如何進行有效的檢測呢?

評論