寫在前面

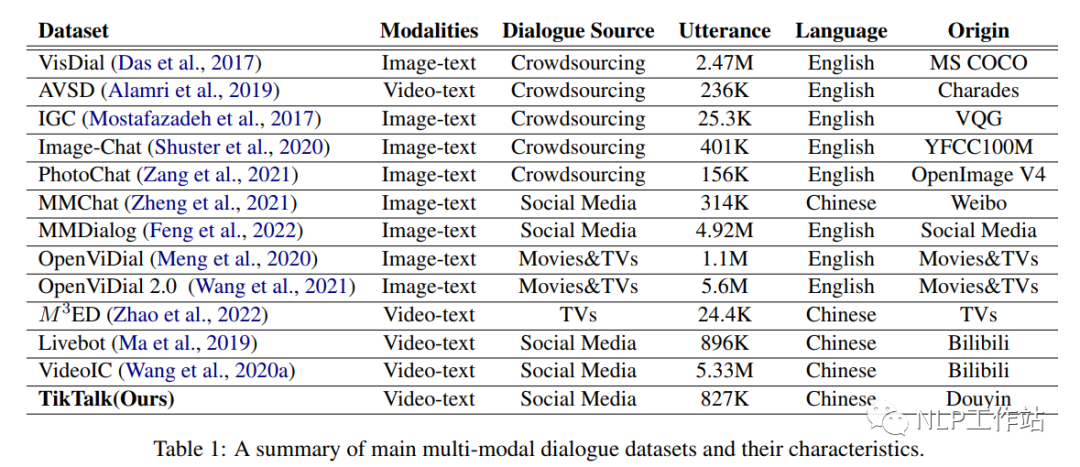

早起刷arxiv,刷到一篇中文多模態對話數據集,分享給大家,全名為《TikTalk: A Multi-Modal Dialogue Dataset for Real-World Chitchat》,即一個真實閑聊多模態數據集,共包括38703個視頻和相應367670個對話。

paper: https://arxiv.org/pdf/2301.05880.pdf

github: https://github.com/RUC-AIMind/TikTalk

介紹

隨著大量預訓練語言模型在文本對話任務中的出色表現,以及多模態的發展,在對話中引入多模態信息已經引起了大量學者的關注。目前已經提出了各種各樣的多模態對話數據集,主要來自電影、電視劇、社交媒體平臺等,但這些數據與真實世界的日常聊天對話之間還是存在一些差距。

- 對話形式過于同質化。 視頻中的現場評論缺乏明確背景,更偏向于評論,并充斥著重復的數據用來活躍氣氛。而從影視劇中提取出來的對話內容或解說員根據指定圖片提出的對話內容,都不是現實對話場景中自然生成的聊天,而是為了推動情節發展設計的一些人物臺詞或高度依賴形象。

- 缺乏對話的時間順序。 現實世界的多模態對話場景可能包含具有時間順序的不同上下文,而目前大多數數據集中的靜態圖片所能提供的信息有限,限制了對話參與者在主題方面的多樣性。并且不同的語言語境中存在著獨特的表達方式和流行文化,很難進行翻譯或遷移到其他語言。

因此,該論文提出了具有獨特特色的中文多模態對話數據集-TikTalk。TikTalk是基于視頻的真實世界人類聊天語料庫,是開放域的,并由用戶自發生成非故意創建的數據集。其中,與圖像、音頻和外部知識相關的回復占比分別為42%、10%和34%,如圖1(a)所示,聊天源于視頻內容,圖1(b)中的“其他表演”和舞蹈分析需要一些外部知識,圖1(c)中的對話建立在音頻內容之上。

因此,該論文提出了具有獨特特色的中文多模態對話數據集-TikTalk。TikTalk是基于視頻的真實世界人類聊天語料庫,是開放域的,并由用戶自發生成非故意創建的數據集。其中,與圖像、音頻和外部知識相關的回復占比分別為42%、10%和34%,如圖1(a)所示,聊天源于視頻內容,圖1(b)中的“其他表演”和舞蹈分析需要一些外部知識,圖1(c)中的對話建立在音頻內容之上。 最后采用排名、相關性和多樣性三種度量指標對現有生成模型進行分析,發現模型與人類表現仍有很大差距,在TikTalk數據集上有相當大的改進空間。

最后采用排名、相關性和多樣性三種度量指標對現有生成模型進行分析,發現模型與人類表現仍有很大差距,在TikTalk數據集上有相當大的改進空間。

TikTalk Dataset

TikTalk數據集從抖音上采集,其抖音擁有超過25個大類的視頻,如教育、美食、游戲、旅游、娛樂等。每個視頻都有作者提供的標題和用戶的評論。用戶可以在視頻和一級評論下進行進一步的討論,這接近于現實世界面對面的多模態聊天場景。

Data Construction

該論文收集了2021年在抖音上發布的視頻,以及標題、評論和回復。為了保護隱私,沒有抓取任何用戶信息。由于視頻基數大,視頻質量良莠不齊,大部分視頻只有一級評論,無法構成對話語料庫。由于視頻高贊、評論高贊表示用戶評分高,因此在爬取數據時通過點贊數過濾低質量的視頻和評論。

數據清理時,用正則表達式過濾掉句子中無用的內容,例如:“@某人”、重復的詞語、以及一些不道德的言論等;此外,評論中帶有的表情符號,通常可以表明用戶的情緒,因此,從對話中提取它們,并作為附加信息。

Data Statistics

該論文共爬取153340個視頻,最終獲取38703個視頻和367670個對話來構建TikTalk數據集。將訓練集、驗證集和測試集按照35703、1000和2000進行劃分,詳細統計數據見表2。 可以看出,視頻平均長度為34.03s,提供了豐富的視頻和音頻信息;每段對話的平均輪數為2.25,由于對話的文本上下文較短,回復更有可能來自視頻或外部知識。

可以看出,視頻平均長度為34.03s,提供了豐富的視頻和音頻信息;每段對話的平均輪數為2.25,由于對話的文本上下文較短,回復更有可能來自視頻或外部知識。

Data Analysis

TikTalk數據集有如下幾個特征:

- 高度自發和自由 ,對話是由用戶觀看視頻后發起,沒有任何的預先的意圖及指導,類似于現實世界中的日常閑聊。

- 多種模式 ,對話上下文包括相關的圖像、音頻和文本,提供了更多樣化的信息來源,同時也對聊天場景進行了更多的限制,提高了回答的可信度標準。

- 開放領域的 ,由于社交平臺是開放域的,討論話題也十分豐富。

觀察數據發現,對話回復中經常包含與上下文信息相關的詞語,例如:圖1(a)中的“it”為視頻中的“海鷗”,圖1(c)中討論了音頻描述的故事,圖1(b)中的回復中為上下文觀點,并分析了視頻外的其他節目,與個人經驗及常識相關。因此,該論文分析了數據及中數據與各種信息相關的響應占比,包括視頻中的視覺內容和音頻內容、文本內容及隱形的外部知識。采用眾包的方式進行數據標注,并選擇另外其他三個具有代表性的對話數據集(每個數據集隨機選取300個樣本)進行對比。

從回復中提取名詞和代詞,要求標注人員判斷這些詞語或完整的回復是否是指:(1)視頻上下文;(2)音頻上下文;(3)文本上下文;(4)隱藏外部知識;(5)其他。并且,回復可以涉及多種模式的信息。

四種數據的比較如圖2(a)所示。TikTalk數據除去文本上下文和外部知識后,信息源占比最高,表示視頻中的圖像和音頻可以提供更多的信息。來自外部知識的回復比例最高(約33%,說明),說明多模態上下文更豐富時,會引入更多與當前對話相關的新信息。 進一步探究IGC和TikTalk之間的差異,研究當對話輪數數增加時,IGC和TikTalk對不同上下文的依賴性,如圖2(b)和(c)所示。IGC數據集中圖像與對話的比例顯著下降,而TikTalk數據集中沒有這種趨勢。可能是因為IGC的每個對話中只使用一個圖像,隨著時間的推移,可用的信息越來越少。

進一步探究IGC和TikTalk之間的差異,研究當對話輪數數增加時,IGC和TikTalk對不同上下文的依賴性,如圖2(b)和(c)所示。IGC數據集中圖像與對話的比例顯著下降,而TikTalk數據集中沒有這種趨勢。可能是因為IGC的每個對話中只使用一個圖像,隨著時間的推移,可用的信息越來越少。

Experiments

采用三個自動指標(相關性、排序、多樣性),從多個角度評估模型在TikTalk上的性能,

- 相關性 :針對模型生成的回復,與5個金標準計算BLEU-2、BLEU-4 、Meteor、Rouge-L和CIDEr。

- 排序 :每段對話構建一個100個樣本的候選集,其中包括5個金標準和95個隨機選擇的錯誤回復。在推理階段,模型根據生成每個回復的對數似然分數降序對候選集進行排序。計算Recall@K和Mean Rank。

- 多樣性 :計算回復的Dist-1和Dist-2指標。

從不同的任務和設置中評估一些最先進的對話模型,包括:Livebot、DialoGPT、Maria、Maria-Audio、Maria-C3KG等。為了適應TikTalk的特點,在現有的基于圖像的對話模型中引入音頻和外部知識作為輸入,并分別對模型的性能進行評估。

實驗結果如表3所示,可以看出TikTalk與以前的任務和數據集有很大不同,需要更強大的多模態對話模型。 從測試集和上述基線模型生成結果中選擇了一些數據示例,對比結果如圖3所示。由于視頻場景和用戶個性的多樣性,TikTalk數據集需要復雜的理解和推理能力。雖然部分基線偶爾可以產生一些合理的響應,但它們遠遠不能滿足現實世界多模式對話的期望。

從測試集和上述基線模型生成結果中選擇了一些數據示例,對比結果如圖3所示。由于視頻場景和用戶個性的多樣性,TikTalk數據集需要復雜的理解和推理能力。雖然部分基線偶爾可以產生一些合理的響應,但它們遠遠不能滿足現實世界多模式對話的期望。

-

數據集

+關注

關注

4文章

1221瀏覽量

25209 -

自然語言

+關注

關注

1文章

291瀏覽量

13571

發布評論請先 登錄

關于多模態機器學習綜述論文

DocumentAI的模型、任務和基準數據集

多模態GPT:國內發布一款可以在線使用的多模態聊天機器人!

VisCPM:邁向多語言多模態大模型時代

全球首個面向網聯智能車的通信與多模態感知數據集發布

更強更通用:智源「悟道3.0」Emu多模態大模型開源,在多模態序列中「補全一切」

評論