***14 ***代碼:一個完整的神經(jīng)網(wǎng)絡(luò)

我們終于可以實(shí)現(xiàn)一個完整的神經(jīng)網(wǎng)絡(luò)了:

import numpy as np

defsigmoid(x):# Sigmoid activation function: f(x) = 1 / (1 + e^(-x)) return 1 / (1 + np.exp(-x))

defderiv_sigmoid(x): # Derivative of sigmoid: f'(x) = f(x) * (1 - f(x)) fx = sigmoid(x) return fx * (1 - fx)

defmse_loss(y_true, y_pred): # y_true和y_pred是相同長度的numpy數(shù)組。 return ((y_true - y_pred) ** 2).mean()

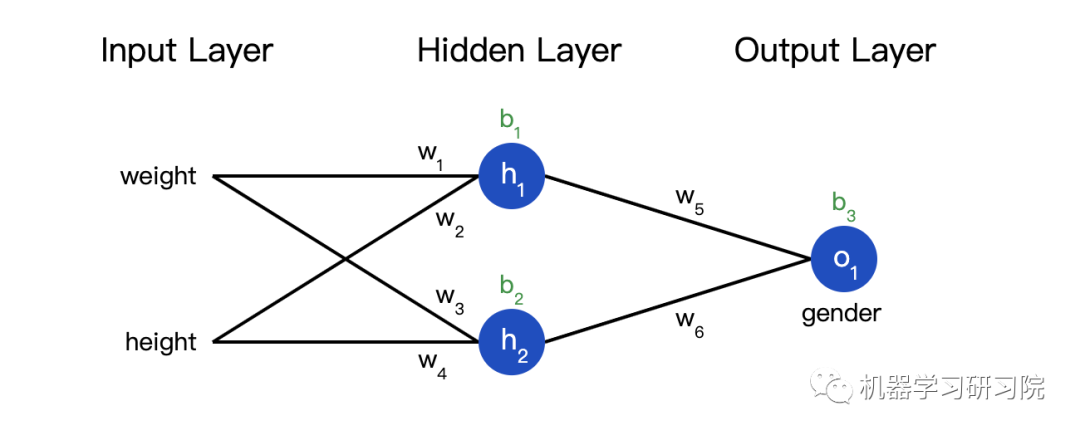

classOurNeuralNetwork: ''' A neural network with: - 2 inputs - a hidden layer with 2 neurons (h1, h2) - an output layer with 1 neuron (o1)

*** 免責(zé)聲明 ***: 下面的代碼是為了簡單和演示,而不是最佳的。 真正的神經(jīng)網(wǎng)絡(luò)代碼與此完全不同。不要使用此代碼。 相反,讀/運(yùn)行它來理解這個特定的網(wǎng)絡(luò)是如何工作的。 ''' def__init__(self): # 權(quán)重,Weights self.w1 = np.random.normal() self.w2 = np.random.normal() self.w3 = np.random.normal() self.w4 = np.random.normal() self.w5 = np.random.normal() self.w6 = np.random.normal()

# 截距項(xiàng),Biases self.b1 = np.random.normal() self.b2 = np.random.normal() self.b3 = np.random.normal()

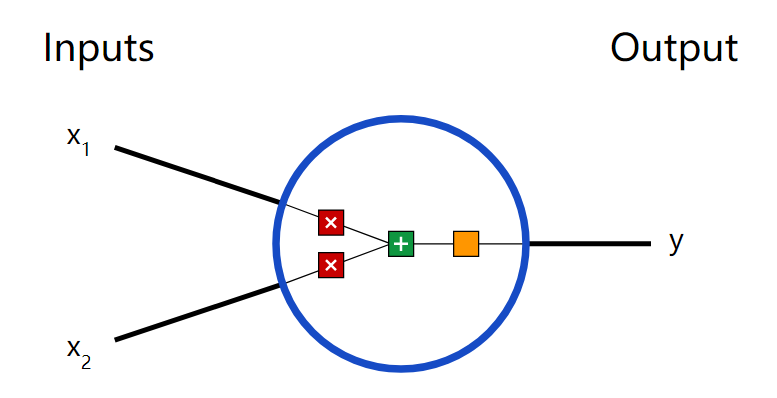

deffeedforward(self, x): # X是一個有2個元素的數(shù)字?jǐn)?shù)組。 h1 = sigmoid(self.w1 * x[0] + self.w2 * x[1] + self.b1) h2 = sigmoid(self.w3 * x[0] + self.w4 * x[1] + self.b2) o1 = sigmoid(self.w5 * h1 + self.w6 * h2 + self.b3) return o1

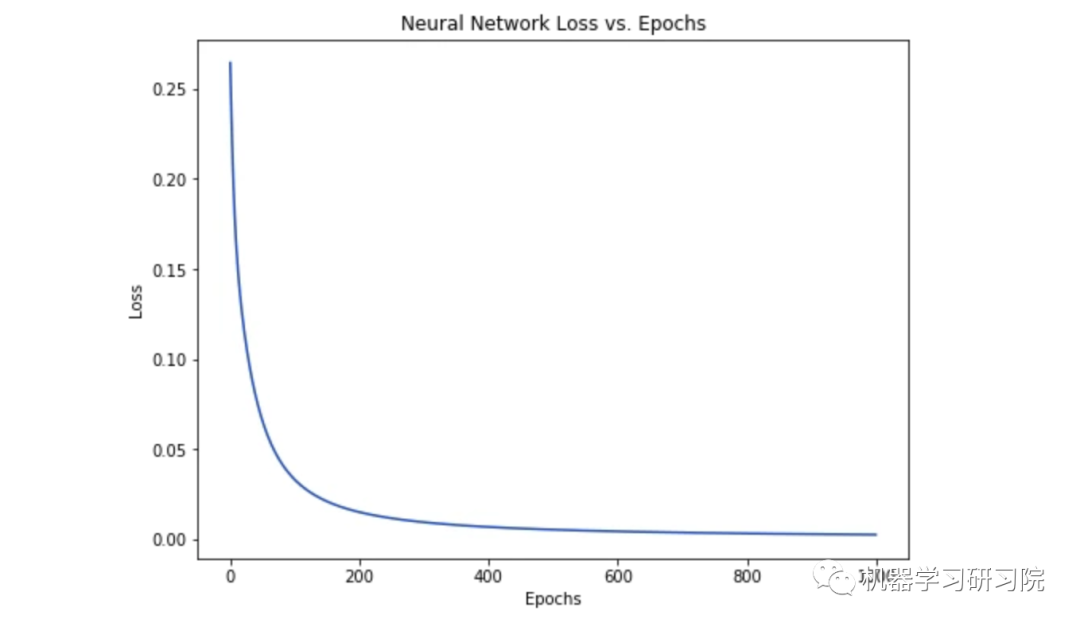

deftrain(self, data, all_y_trues): ''' - data is a (n x 2) numpy array, n = # of samples in the dataset. - all_y_trues is a numpy array with n elements. Elements in all_y_trues correspond to those in data. ''' learn_rate = 0.1 epochs = 1000 # 遍歷整個數(shù)據(jù)集的次數(shù)

for epoch in range(epochs): for x, y_true in zip(data, all_y_trues): # --- 做一個前饋(稍后我們將需要這些值) sum_h1 = self.w1 * x[0] + self.w2 * x[1] + self.b1 h1 = sigmoid(sum_h1)

sum_h2 = self.w3 * x[0] + self.w4 * x[1] + self.b2 h2 = sigmoid(sum_h2)

sum_o1 = self.w5 * h1 + self.w6 * h2 + self.b3 o1 = sigmoid(sum_o1) y_pred = o1

# --- 計(jì)算偏導(dǎo)數(shù)。 # --- Naming: d_L_d_w1 represents "partial L / partial w1" d_L_d_ypred = -2 * (y_true - y_pred)

# Neuron o1 d_ypred_d_w5 = h1 * deriv_sigmoid(sum_o1) d_ypred_d_w6 = h2 * deriv_sigmoid(sum_o1) d_ypred_d_b3 = deriv_sigmoid(sum_o1)

d_ypred_d_h1 = self.w5 * deriv_sigmoid(sum_o1) d_ypred_d_h2 = self.w6 * deriv_sigmoid(sum_o1)

# Neuron h1 d_h1_d_w1 = x[0] * deriv_sigmoid(sum_h1) d_h1_d_w2 = x[1] * deriv_sigmoid(sum_h1) d_h1_d_b1 = deriv_sigmoid(sum_h1)

# Neuron h2 d_h2_d_w3 = x[0] * deriv_sigmoid(sum_h2) d_h2_d_w4 = x[1] * deriv_sigmoid(sum_h2) d_h2_d_b2 = deriv_sigmoid(sum_h2)

# --- 更新權(quán)重和偏差 # Neuron h1 self.w1 -= learn_rate * d_L_d_ypred * d_ypred_d_h1 * d_h1_d_w1 self.w2 -= learn_rate * d_L_d_ypred * d_ypred_d_h1 * d_h1_d_w2 self.b1 -= learn_rate * d_L_d_ypred * d_ypred_d_h1 * d_h1_d_b1

# Neuron h2 self.w3 -= learn_rate * d_L_d_ypred * d_ypred_d_h2 * d_h2_d_w3 self.w4 -= learn_rate * d_L_d_ypred * d_ypred_d_h2 * d_h2_d_w4 self.b2 -= learn_rate * d_L_d_ypred * d_ypred_d_h2 * d_h2_d_b2

# Neuron o1 self.w5 -= learn_rate * d_L_d_ypred * d_ypred_d_w5 self.w6 -= learn_rate * d_L_d_ypred * d_ypred_d_w6 self.b3 -= learn_rate * d_L_d_ypred * d_ypred_d_b3

# --- 在每次epoch結(jié)束時計(jì)算總損失 if epoch % 10 == 0: y_preds = np.apply_along_axis(self.feedforward, 1, data) loss = mse_loss(all_y_trues, y_preds) print("Epoch %d loss: %.3f" % (epoch, loss))

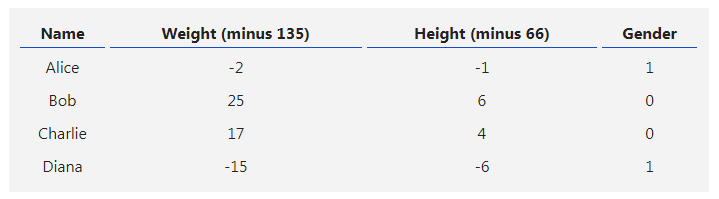

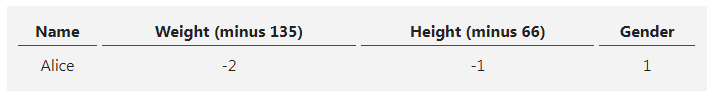

# 定義數(shù)據(jù)集data = np.array([ [-2, -1], # Alice [25, 6], # Bob [17, 4], # Charlie [-15, -6], # Diana])all_y_trues = np.array([ 1, # Alice 0, # Bob 0, # Charlie 1, # Diana])

# 訓(xùn)練我們的神經(jīng)網(wǎng)絡(luò)!network = OurNeuralNetwork()network.train(data, all_y_trues)

現(xiàn)在我們可以用這個網(wǎng)絡(luò)來預(yù)測性別了:

# 做一些預(yù)測emily = np.array([-7, -3]) # 128 磅, 63 英寸frank = np.array([20, 2]) # 155 磅, 68 英寸print("Emily: %.3f" % network.feedforward(emily)) # 0.951 - Fprint("Frank: %.3f" % network.feedforward(frank)) # 0.039 - M*15 ***** 接下來?

搞定了一個簡單的神經(jīng)網(wǎng)絡(luò),快速回顧一下:

- 介紹了神經(jīng)網(wǎng)絡(luò)的基本結(jié)構(gòu)——神經(jīng)元;

- 在神經(jīng)元中使用S型激活函數(shù);

- 神經(jīng)網(wǎng)絡(luò)就是連接在一起的神經(jīng)元;

- 構(gòu)建了一個數(shù)據(jù)集,輸入(或特征)是體重和身高,輸出(或標(biāo)簽)是性別;

- 學(xué)習(xí)了損失函數(shù)和均方差損失;

- 訓(xùn)練網(wǎng)絡(luò)就是最小化其損失;

- 用反向傳播方法計(jì)算偏導(dǎo);

- 用隨機(jī)梯度下降法訓(xùn)練網(wǎng)絡(luò);

接下來你還可以:

- 用機(jī)器學(xué)習(xí)庫實(shí)現(xiàn)更大更好的神經(jīng)網(wǎng)絡(luò),例如TensorFlow、Keras和PyTorch;

- 其他類型的激活函數(shù);

- 其他類型的優(yōu)化器;

- 學(xué)習(xí)卷積神經(jīng)網(wǎng)絡(luò),這給計(jì)算機(jī)視覺領(lǐng)域帶來了革命;

- 學(xué)習(xí)遞歸神經(jīng)網(wǎng)絡(luò),常用于自然語言處理;

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請聯(lián)系本站處理。

舉報(bào)投訴

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4771瀏覽量

100715 -

神經(jīng)元

+關(guān)注

關(guān)注

1文章

363瀏覽量

18449 -

python

+關(guān)注

關(guān)注

56文章

4792瀏覽量

84628

發(fā)布評論請先 登錄

相關(guān)推薦

人工神經(jīng)網(wǎng)絡(luò)原理及下載

這個網(wǎng)絡(luò)輸入和相應(yīng)的輸出來“訓(xùn)練”這個網(wǎng)絡(luò),網(wǎng)絡(luò)根據(jù)輸入和輸出不斷地調(diào)節(jié)自己的各節(jié)點(diǎn)之間的權(quán)值來滿足輸入和輸出。這樣,當(dāng)訓(xùn)練結(jié)束后,我們給定一

發(fā)表于 06-19 14:40

labview BP神經(jīng)網(wǎng)絡(luò)的實(shí)現(xiàn)

請問:我在用labview做BP神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)故障診斷,在NI官網(wǎng)找到了機(jī)器學(xué)習(xí)工具包(MLT),但是里面沒有關(guān)于這部分VI的幫助文檔,對于”BP神經(jīng)網(wǎng)絡(luò)分類“這個范例有很多不懂的地方,比如

發(fā)表于 02-22 16:08

【PYNQ-Z2試用體驗(yàn)】神經(jīng)網(wǎng)絡(luò)基礎(chǔ)知識

神經(jīng)網(wǎng)絡(luò)的計(jì)算。對于多層多節(jié)點(diǎn)的神經(jīng)網(wǎng)絡(luò),我們可以使用矩陣乘法來表示。在上面的神經(jīng)網(wǎng)絡(luò)中,我們將權(quán)重作為一

發(fā)表于 03-03 22:10

卷積神經(jīng)網(wǎng)絡(luò)如何使用

卷積神經(jīng)網(wǎng)絡(luò)(CNN)究竟是什么,鑒于神經(jīng)網(wǎng)絡(luò)在工程上經(jīng)歷了曲折的歷史,您為什么還會在意它呢? 對于這些非常中肯的問題,我們似乎可以給出相對簡明的答案。

發(fā)表于 07-17 07:21

【案例分享】ART神經(jīng)網(wǎng)絡(luò)與SOM神經(jīng)網(wǎng)絡(luò)

今天學(xué)習(xí)了兩個神經(jīng)網(wǎng)絡(luò),分別是自適應(yīng)諧振(ART)神經(jīng)網(wǎng)絡(luò)與自組織映射(SOM)神經(jīng)網(wǎng)絡(luò)。整體感覺不是很難,只不過一些最基礎(chǔ)的概念容易

發(fā)表于 07-21 04:30

人工神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)方法有哪些?

人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network,ANN)是一種類似生物神經(jīng)網(wǎng)絡(luò)的信息處理結(jié)構(gòu),它的提出是為了解決一些非線性,非平穩(wěn),復(fù)雜的實(shí)際問題。那有哪些辦法能

發(fā)表于 08-01 08:06

如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?

原文鏈接:http://tecdat.cn/?p=5725 神經(jīng)網(wǎng)絡(luò)是一種基于現(xiàn)有數(shù)據(jù)創(chuàng)建預(yù)測的計(jì)算系統(tǒng)。如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?神經(jīng)網(wǎng)絡(luò)包括:輸入層:根據(jù)現(xiàn)有數(shù)據(jù)獲取輸入的層隱藏層:使用反

發(fā)表于 07-12 08:02

matlab實(shí)現(xiàn)神經(jīng)網(wǎng)絡(luò) 精選資料分享

習(xí)神經(jīng)神經(jīng)網(wǎng)絡(luò),對于神經(jīng)網(wǎng)絡(luò)的實(shí)現(xiàn)是如何一直沒有具體實(shí)現(xiàn)一

發(fā)表于 08-18 07:25

基于BP神經(jīng)網(wǎng)絡(luò)的PID控制

最近在學(xué)習(xí)電機(jī)的智能控制,上周學(xué)習(xí)了基于單神經(jīng)元的PID控制,這周研究基于BP神經(jīng)網(wǎng)絡(luò)的PID控制。神經(jīng)網(wǎng)絡(luò)具有任意非線性表達(dá)能力,可以通過對系統(tǒng)性能的學(xué)習(xí)來

發(fā)表于 09-07 07:43

卷積神經(jīng)網(wǎng)絡(luò)一維卷積的處理過程

inference在設(shè)備端上做。嵌入式設(shè)備的特點(diǎn)是算力不強(qiáng)、memory小。可以通過對神經(jīng)網(wǎng)絡(luò)做量化來降load和省memory,但有時可能memory還吃緊,就需要對神經(jīng)網(wǎng)絡(luò)在memory使用上做進(jìn)

發(fā)表于 12-23 06:16

用Python從頭實(shí)現(xiàn)一個神經(jīng)網(wǎng)絡(luò)來理解神經(jīng)網(wǎng)絡(luò)的原理1

有個事情可能會讓初學(xué)者驚訝:神經(jīng)網(wǎng)絡(luò)模型并不復(fù)雜!『神經(jīng)網(wǎng)絡(luò)』這個詞讓人覺得很高大上,但實(shí)際上神經(jīng)網(wǎng)絡(luò)算法要比人們想象的簡單。

這篇文章完全是為新手準(zhǔn)備的。我們會通過

用Python從頭實(shí)現(xiàn)一個神經(jīng)網(wǎng)絡(luò)來理解神經(jīng)網(wǎng)絡(luò)的原理2

有個事情可能會讓初學(xué)者驚訝:神經(jīng)網(wǎng)絡(luò)模型并不復(fù)雜!『神經(jīng)網(wǎng)絡(luò)』這個詞讓人覺得很高大上,但實(shí)際上神經(jīng)網(wǎng)絡(luò)算法要比人們想象的簡單。

這篇文章完全是為新手準(zhǔn)備的。我們會通過

用Python從頭實(shí)現(xiàn)一個神經(jīng)網(wǎng)絡(luò)來理解神經(jīng)網(wǎng)絡(luò)的原理3

有個事情可能會讓初學(xué)者驚訝:神經(jīng)網(wǎng)絡(luò)模型并不復(fù)雜!『神經(jīng)網(wǎng)絡(luò)』這個詞讓人覺得很高大上,但實(shí)際上神經(jīng)網(wǎng)絡(luò)算法要比人們想象的簡單。

這篇文章完全是為新手準(zhǔn)備的。我們會通過

BP神經(jīng)網(wǎng)絡(luò)和人工神經(jīng)網(wǎng)絡(luò)的區(qū)別

BP神經(jīng)網(wǎng)絡(luò)和人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Networks,簡稱ANNs)之間的關(guān)系與區(qū)別,是神經(jīng)網(wǎng)絡(luò)領(lǐng)域中一個基礎(chǔ)且

用Python從頭實(shí)現(xiàn)一個神經(jīng)網(wǎng)絡(luò)來理解神經(jīng)網(wǎng)絡(luò)的原理4

用Python從頭實(shí)現(xiàn)一個神經(jīng)網(wǎng)絡(luò)來理解神經(jīng)網(wǎng)絡(luò)的原理4

評論