大型語言模型能識別、總結、翻譯、預測和生成文本及其他內容。

AI 應用在大型語言模型的幫助下,可用于解決總結文章、編寫故事和參與長對話等多種繁重工作。

大型語言模型(LLM)是一種深度學習算法,可以通過大規模數據集訓練來學習識別、總結、翻譯、預測和生成文本及其他內容。

大型語言模型是 Transformer 模型最成功的應用之一。它們不僅將人類的語言教給 AI,還可以幫助 AI 理解蛋白質、編寫軟件代碼等等。

除了加速翻譯軟件、聊天機器人、AI 助手等自然語言處理應用之外,大型語言模型還在醫療、軟件開發等許多其他領域被使用。

大型語言模型的用途有哪些?

語言不僅僅是人類間的交流。

計算機的語言是代碼、生物學的語言是蛋白質和分子序列……大型語言模型可用于此類語言或跨越多類型交流方式的場景。

這些模型擴大了 AI 在各行各業中的影響,并有望推動新一輪的研究、創造和生產浪潮。因為它們可以幫助生成全球棘手問題的復雜解決方案。這些模型擴大了 AI 在各行各業中的影響,并有望推動新一輪的研究、創造和生產浪潮。因為它們可以幫助生成全球棘手問題的復雜解決方案。

例如,使用大型語言模型的 AI 系統可以學習分子和蛋白質結構數據庫,然后運用這些知識提出可行的化合物方案,幫助科學家開發出突破性的疫苗或療法。

大型語言模型還能幫助重構搜索引擎、指導聊天機器人以及歌曲、詩歌、故事和營銷材料的編寫工具等等。

大型語言模型如何運作?

大型語言模型從海量數據中學習。顧名思義,大型語言模型的核心就是訓練它的數據集的大小。但對“大型”的定義正在隨著 AI 的發展而不斷擴大。

目前,用于訓練大型語言模型的數據集通常大到包含互聯網長時間跨度內的幾乎所有內容。

當一個模型獲得了一個數據集但沒有收到關于該如何處理它的明確指示時,這些海量文本就會通過無監督學習被輸入到 AI 算法中。大型語言模型通過這種方法來學習單詞、單詞之間的關系以及其背后的概念。例如它可以學會根據上下文來區分“bark”這個詞的不同含義。

就像掌握了一門語言的人可以猜測一個句子或段落接下來可能出現的內容,甚至可以自己想出新的詞匯或概念一樣,大型語言模型可以使用其掌握的知識來預測和生成內容。

大型語言模型也可以為特定用例進行定制,包括通過微調或提示調整(prompt-tuning)等技術。Prompt-tuning 向模型提供小塊數據,來集中訓練其勝任特定應用。

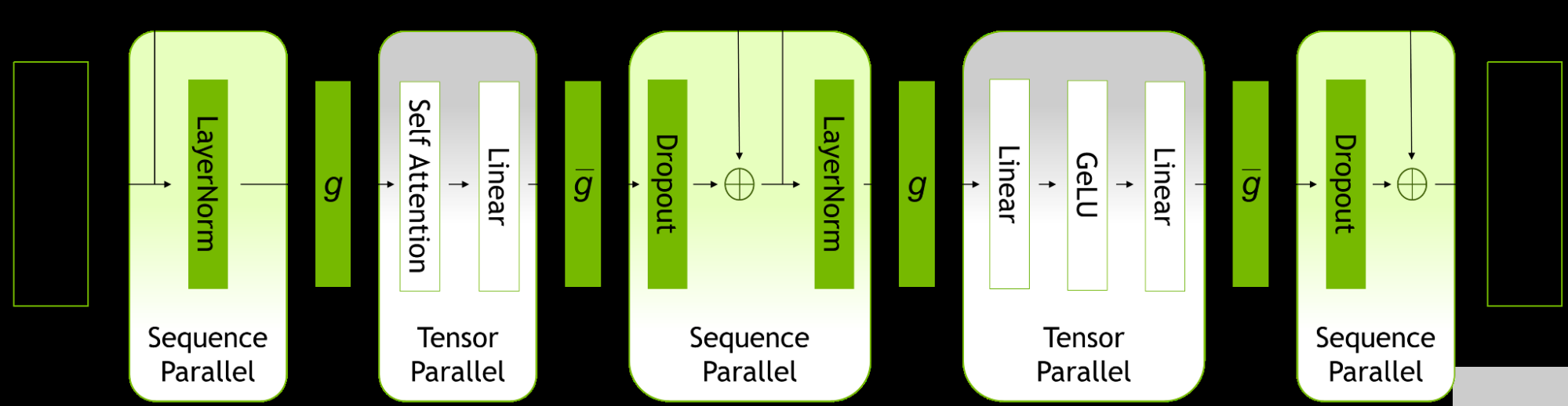

憑借并行處理序列的計算效率,Transformer 模型架構正在成為規模最大、性能最強的大型語言模型背后的構建塊。

大型語言模型的主要用途

大型語言模型正在為搜索引擎、自然語言處理、醫療、機器人、代碼生成等領域開辟新的可能性。

當下熱門的 ChatGPT 人工智能聊天機器人就是大型語言模型的應用之一,它可以用于無數自然語言處理任務。

大型語言模型的應用范圍近乎無限,包括:

零售商和其他服務商可以使用大型語言模型通過動態聊天機器人、AI 助手等方式提供更好的客戶體驗。

搜索引擎可以使用大型語言模型提供更加直接且貼近人類的答案。

生命科學研究者可以訓練大型語言模型理解蛋白質、分子、DNA 和 RNA。

開發者可以使用大型語言模型編寫軟件和教機器人完成體力活。

營銷人員可以訓練大型語言模型,將客戶的要求與反饋歸類或根據產品描述將產品分類。

金融顧問可以使用大型語言模型總結財報會議并創建重要會議的記錄。信用卡公司可以使用大型語言模型進行異常檢測和欺詐分析以保護消費者。

法務團隊可以使用大型語言模型輔助進行法律釋義和文件起草。

為了在生產中高效運行這些大型模型,需要具備大量資源、技術專長等。因此,企業開始轉向 NVIDIA Triton Inference Server。這款軟件可以幫助實現模型部署的標準化并為生產提供快速、可擴展的 AI。

在哪里可以獲得大型語言模型

2020 年 6 月,OpenAI 發布了 GPT-3 服務。該服務由一個具有 1750 億參數的模型驅動,可以根據簡短的書面提示生成文本和代碼。

2021 年,NVIDIA 和 Microsoft 開發了 Megatron-Turing Natural Language Generation 530B。作為世界最大的閱讀理解和自然語言推理模型之一,它能夠輕松完成總結歸納和內容生成等任務。

HuggingFace 在去年發布了 BLOOM。這個開放式大型語言模型能夠生成 46 種自然語言和十幾種編程語言文本。

另一個大型語言模型 Codex 能幫助軟件工程師和其他開發者將文本轉換成代碼。

NVIDIA 提供了一些工具來簡化大型語言模型的構建和部署:

NVIDIA NeMo LLM服務,可提供一條快速路徑,以便自定義和使用在多個框架上訓練的大型語言模型。開發者可以在私有云和公有云上使用 NeMo LLM 部署企業 AI 應用。

NVIDIA AI 平臺內置的NVIDIA NeMo Megatron是一個能夠簡單、高效、經濟地訓練和部署大型語言模型的框架。NeMo Megatron 專為開發企業級應用而設計,它所提供的端到端工作流程可用于自動化分布式數據處理、訓練 GPT-3 和 T5 等大規模自定義模型以及將這些模型部署到大規模推理中。

NVIDIA BioNeMo是一個用于蛋白質組學、小分子、DNA 和 RNA 大型語言模型的特定領域代管服務和框架。是一款基于 NVIDIA NeMo Megatron 構建的 AI 賦能藥物研發云服務和框架,用于在超級計算規模下訓練和部署大型生物分子 Transformer AI 模型。

大型語言模型所面臨的挑戰

擴展和維護大型語言模型是一件困難且昂貴的事。

要建立一個基礎大型語言模型通常需要花費數百萬美元進行數月時間的訓練。

而且由于大型語言模型訓練的巨大數據需求,開發者和企業會發現想要獲得足夠多的數據集十分困難。

大型語言模型的規模使得想要部署它們需要具備一定的技術專長,包括對深度學習、Transformer 模型以及分布式軟件和硬件的深入了解。

許多技術領導者正在努力推進開發工作,努力建立能夠擴大大型語言模型接入范圍的資源來幫助個人和各規模企業都能從中受益。

審核編輯:劉清

-

語言模型

+關注

關注

0文章

558瀏覽量

10661 -

GPT

+關注

關注

0文章

368瀏覽量

15922 -

ChatGPT

+關注

關注

29文章

1586瀏覽量

8785

原文標題:麗臺科普 | 大型語言模型有哪些用途?

文章出處:【微信號:Leadtek,微信公眾號:麗臺科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

探索高效的大型語言模型!大型語言模型的高效學習方法

無法在OVMS上運行來自Meta的大型語言模型 (LLM),為什么?

KT利用NVIDIA AI平臺訓練大型語言模型

一套開源的大型語言模型(LLM)—— StableLM

大型語言模型能否捕捉到它們所處理和生成的文本中的語義信息

淺析AI大型語言模型研究的發展歷程

大型語言模型的應用

英偉達開源Nemotron-4 340B系列模型,助力大型語言模型訓練

如何利用大型語言模型驅動的搜索為公司創造價值

評論