今天凌晨,Open AI 團隊發推正式宣布:GPT-4 來了!

我花了點時間,看完了 Open AI 團隊對于 GPT-4 的整篇介紹。

GPT-4 介紹:https://openai.com/research/gpt-4

下面挑些重點,跟大家進行詳細介紹。

GPT-4 基礎能力

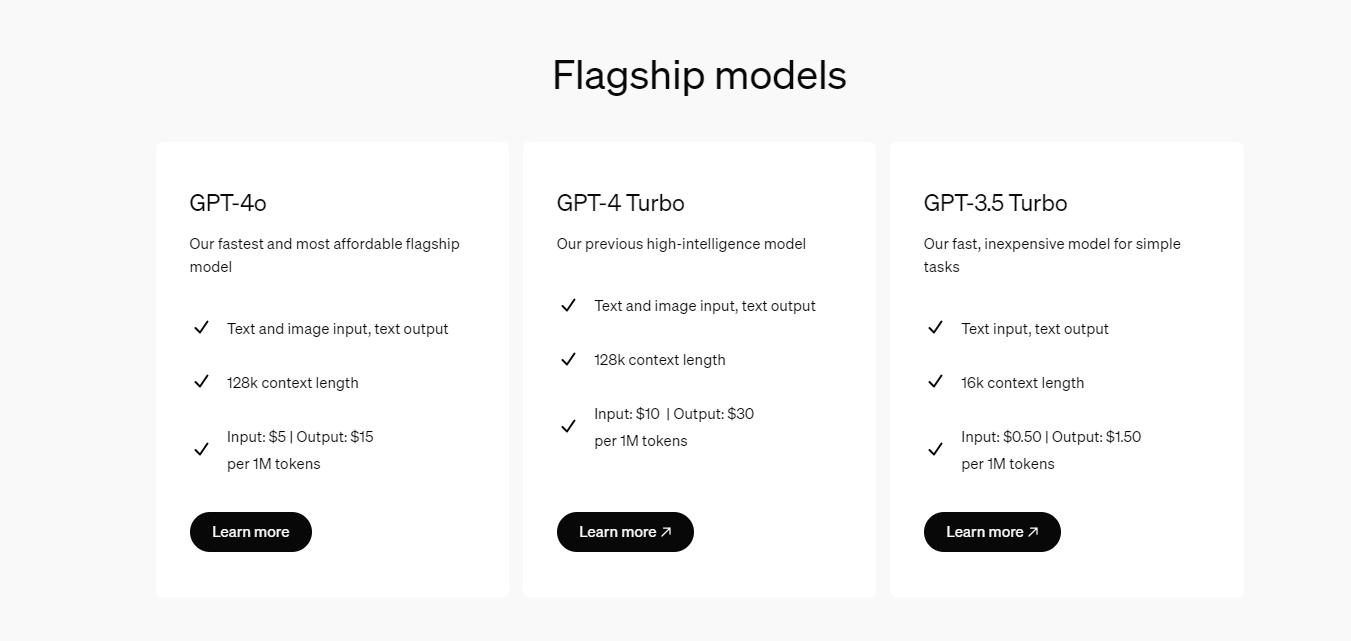

本次發布的 GPT-4 跟此前透露的消息一樣,是一個多模態大模型,支持接受圖像和文本輸入,輸出文本。

雖然沒一步到位,把音視頻也覆蓋上,但如果能把圖像與文本這兩塊做好,相信其應用潛力無限。

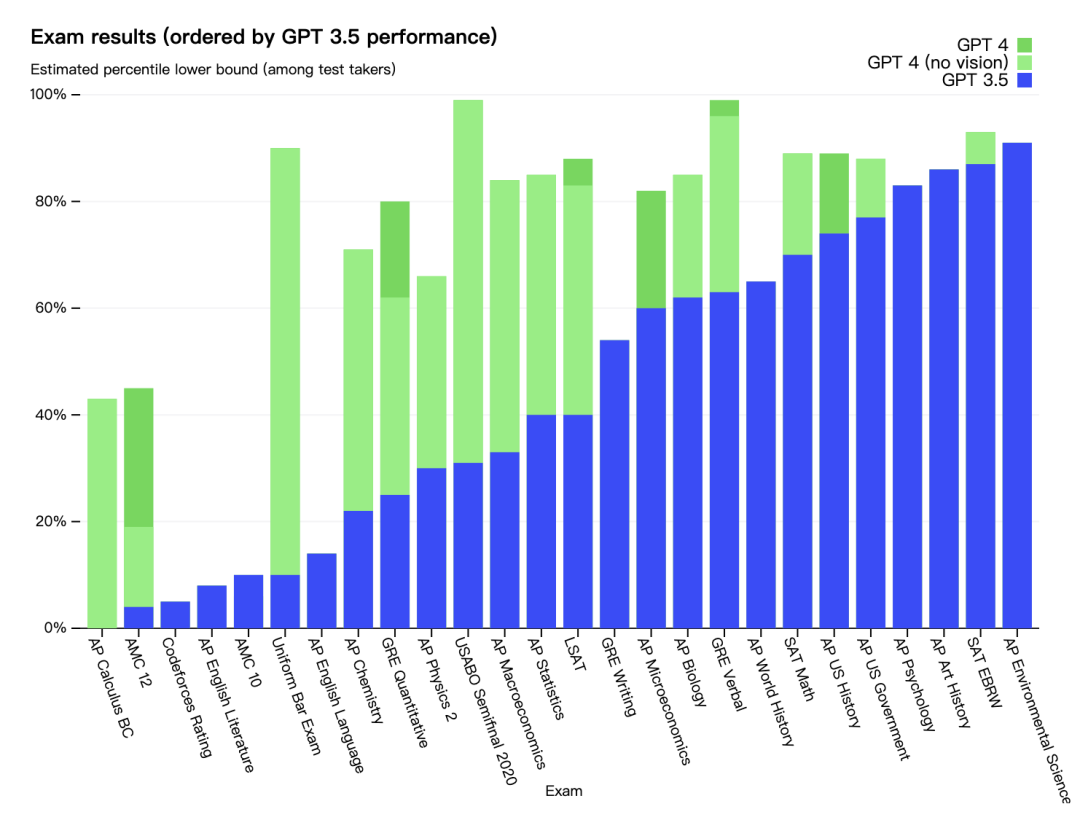

對于 GPT-4 的實際能力,團隊也給大家提前打了一針強心劑,即便 GPT-4 在許多現實世界場景中能力不如人類,但在各種專業和學術基準上的表現,還是超過了人類的平均水平。

這里有一個數據是,在律師模擬考中,GPT-4 的成績排在應試生的前 10% 中,而此前發布的 GPT-3.5,則在倒數 10% 的行列。

看到這里,不知道你發現沒有,現在衡量 GPT 模型的能力,已經不是能否通過人類社會中的應試,而是看其參加的多種不同領域的專業應試,能夠排到多靠前的位置。

在團隊進行的多個 GPT-4 與 GPT-3.5 的考試測試中,發現這兩個模型間存在很微妙的差異。

當任務的復雜性足夠高時,GPT-4 比 GPT-3.5 更可靠、更有創意,并且能夠處理更細微的指令。

在 GPT-4 發布之前,Open AI 團隊花了 6 個月的時間 ,使用對抗性測試程序,以及從 ChatGPT 得到的經驗教訓,對 GPT-4 進行了迭代調整 ,進而在其真實性、可操控性等方面取得了有史以來最好的結果。

在與當前機器學習模型進行基準評估對比后,GPT-4 大大優于現有的大型語言模型,以及大多數最先進的 (SOTA) 模型。

GPT-4 圖像處理

當然了,GPT-4 本次最為令人看重的,還是它接受與處理圖像的具體能力。

在官方報告中,團隊提供了多個實際交互示例,這里我挑 2 個比較有代表性的給大家看下。

示例 1:理解圖片

當你給 GPT-4 發送下面這張圖片,并詢問它,該圖片有哪些不尋常的地方?

GPT-4 回答:這張照片的不同尋常之處在于,一名男子正在行駛中的出租車車頂上的熨衣板上熨燙衣服。

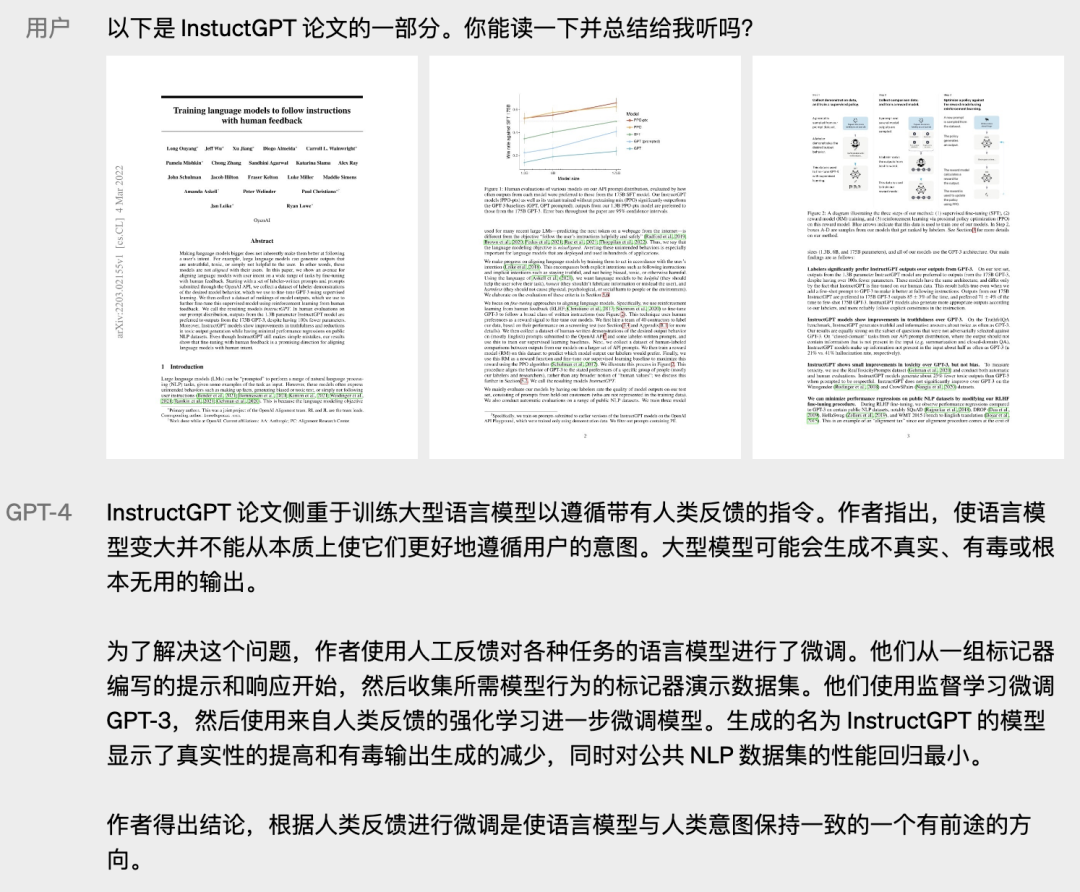

示例 2:識別與解析圖片內容

將論文截圖直接發送給 GPT-4,并要求它進行解析與總結。

除此之外,它還能解析報表圖片并進行匯總,直接回答圖片中包含的提問內容等操作。

不過,GPT-4 跟 GPT-3.5 類似,對訓練數據中斷后(2021 年 9 月)所發生的事情不太了解,也會犯一些在我們看來很簡單的推理性錯誤,給用戶提供不合理的建議,以及在生成的代碼中引入安全漏洞。

對于這些潛在性的危險因素,團隊也聘請了來自多個不同行業的專家對模型進行了優化調整,但是其具體效果,還需要等后面場景應用較為廣泛后,才能得出結論。

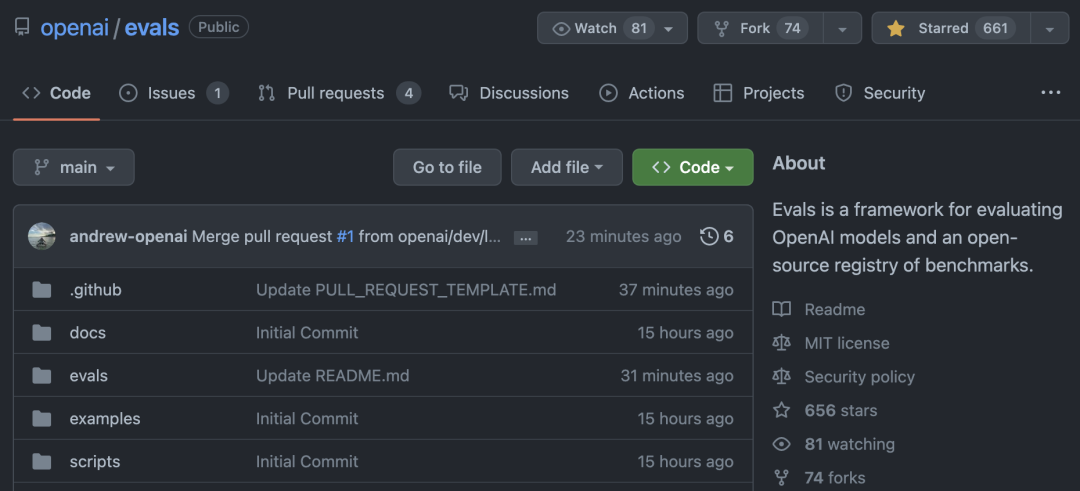

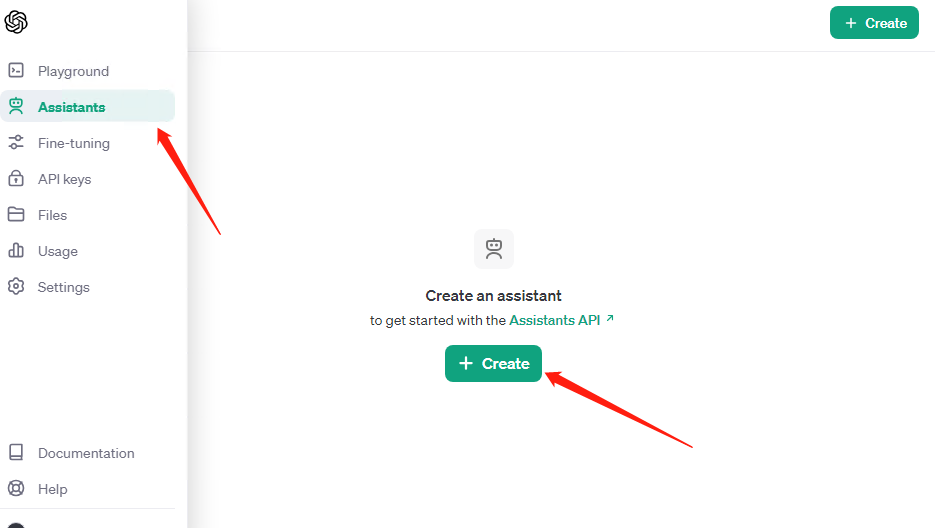

開源項目:OpenAI Evals

為了讓開發者能更好的評測 GPT-4 的優缺點,OpenAI 的技術團隊還開源了 OpenAI Evals 項目,可用于自動評估 AI 模型性能的框架,以便用戶能更專業的指導團隊,進一步優化與改進模型。

該項目具有以下功能特性:

使用數據集生成提示;

衡量 OpenAI 模型提供的補全質量;

比較不同數據集和模型的性能。

GitHub:https://github.com/openai/evals

申請 GPT-4 API

目前,OpenAI 已面向開發者開放 GPT-4 API 的申請通道,大家想提前使用的話,可以先提交申請,進入 waitlist 中等待通過。

我吸取了上次 New Bing 開放申請后,苦等無果的慘痛教訓。現如今對于這類工具,都是第一時間申請,后面就看 Open AI 什么時候能給我通過了。

申請通道:https://openai.com/waitlist/gpt-4-api

對了,如果你有 ChatGPT Plus 訂閱會員,則可以直接獲得 GPT-4 的試用權限,無需等待。不過有一定限制,在 4 小時內,最多只能發布 100 條信息。

獲得訪問權限后,用戶當前還是只能向 GPT-4 模型發出純文本請求,圖像請求可能得等稍晚一些時間才對外開放。

以上,就是關于 GPT-4 的大致介紹。

審核編輯 :李倩

-

模型

+關注

關注

1文章

3229瀏覽量

48811 -

機器學習

+關注

關注

66文章

8408瀏覽量

132572 -

OpenAI

+關注

關注

9文章

1082瀏覽量

6484

原文標題:剛剛!Open AI 正式發布 GPT-4!

文章出處:【微信號:玩轉VS Code,微信公眾號:玩轉VS Code】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Llama 3 與 GPT-4 比較

科大訊飛發布訊飛星火4.0 Turbo:七大能力超GPT-4 Turbo

OpenAI推出新模型CriticGPT,用GPT-4自我糾錯

OpenAI API Key獲取:開發人員申請GPT-4 API Key教程

開發者如何調用OpenAI的GPT-4o API以及價格詳情指南

GPT-4人工智能模型預測公司未來盈利勝過人類分析師

OpenAI全新GPT-4o能力炸場!速度快/成本低,能讀懂人類情緒

OpenAI計劃宣布ChatGPT和GPT-4更新

阿里云發布通義千問2.5大模型,多項能力超越GPT-4

商湯科技發布5.0多模態大模型,綜合能力全面對標GPT-4 Turbo

微軟Copilot全面更新為OpenAI的GPT-4 Turbo模型

新火種AI|秒殺GPT-4,狙殺GPT-5,橫空出世的Claude 3振奮人心!

Open AI團隊發推正式宣布:GPT-4來了!

Open AI團隊發推正式宣布:GPT-4來了!

評論