在GTC 2023 | NVIDIA開發者大會上,加州伯克利數學與計算機科學的教授向我們介紹了關于深度學習系統Colossal-AI的相關內容。

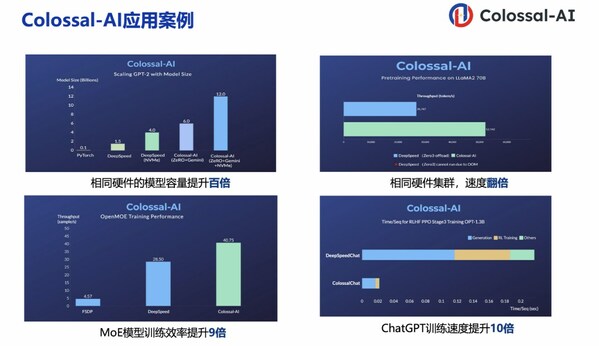

深度學習系統Colossal-AI使用戶能夠以大幅降低成本的方式最大限度地提高AI訓練和推理的效率。它集成了高效的多維并行、異構內存管理、自適應任務調度等先進技術。

Colossal-AI將更好地了解大型模型訓練和推理背后的并行性和內存優化技術,學習深度學習系統的實際應用(包括自然語言處理、計算機視覺、生物信息學等),并能夠為未來的大型 AI 模型時代做出貢獻。

Colossal-AI系統試圖解決什么問題呢?

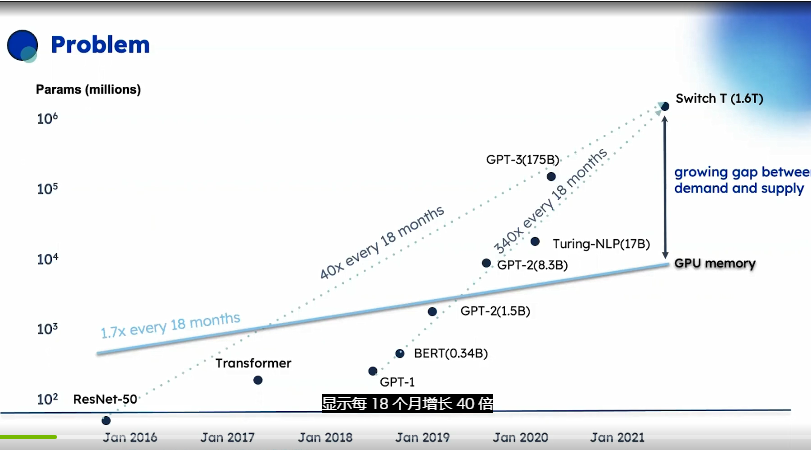

主流AI模型大小增長的圖表,它顯示了AI模型在短短幾年內增長的速度,每18個月增長40倍,這超過了摩爾定律在其具盛時期的最佳表現。

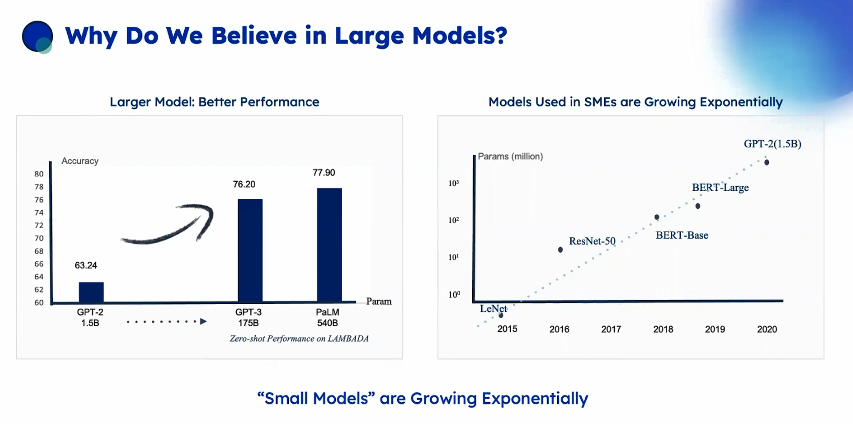

小型和中型企業( SMEs )在盡可能地在采用它們,Colossal-Al系統在2026年時可以幫你節省的成本的估計訓練175B參數GPT-3模型,利用所有這些硬件特性和變化,估計訓練成本從300降至73000美元,約為41倍。

強調大規模并行是必不可少的,使用單個A 100 GPU訓練具有540B參數的Pal M語言模型的時間和成本,需要300年并且花費920萬美元。

隨著新數據的不斷出現,他們需要反復的新訓練以避免像2019年的GPT-2一樣無法識別COVID-19等概念。

訓練完成之后,僅使用模型進行推理也是項挑戰,因為模型的大小需要并行技術,單個服務器的內存可能無法容納大模型。除了設備成本之外,還有人力成本支付需要解決所有這些問題的專家團隊,這就限制了一些公司特別是無法承受這些團隊的中小企業使用這些大型模型。

因此Colossal-AI的作用出現了:

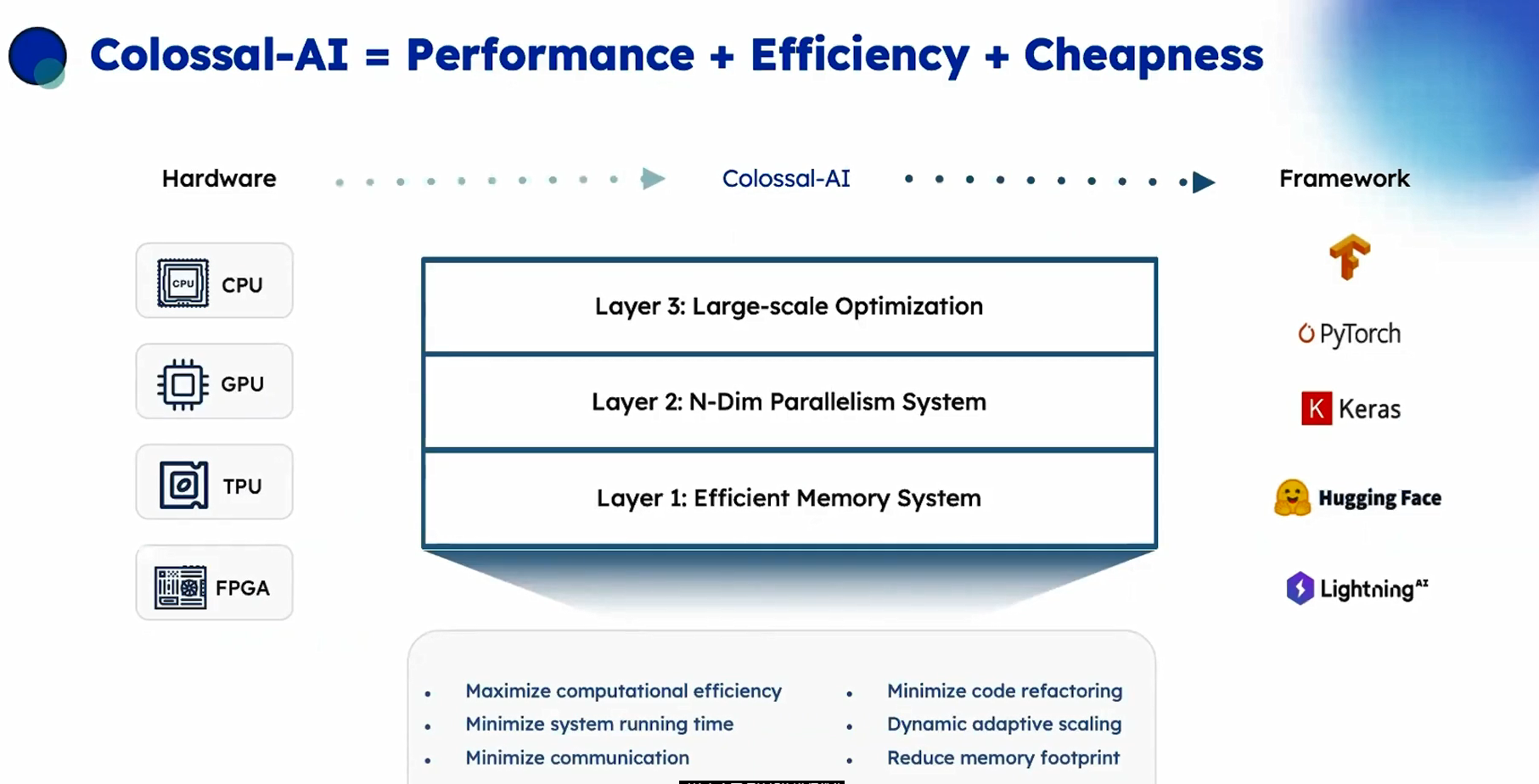

對特定底層硬件架構進行優化,左側(硬件層)可以是CPU、 GPU、TPU或FPGAl,右側是你的用于AI模型編寫的框架,如TensorFlow、 Py Torch或其他框架。Colossal-AI可以高效地將大模型部署到目標架構,實現底部顯示的所有目標,最小化運行時間,最小化通信(移動數據)在當前架構是最昂貴的操作,最小化用戶需要改動代碼的數量,即重構。使模型能夠動態地適應機器的規模變化,并減少內存占用,一邊能運行大模型。

Colossal-AI提供了三個層次:

高效的內存系統,可最大程度利用可用內存。

多維并行,即如何最好地將復雜的模型映射到可用的硬件上,以最大程度地使并行處理并最小化通信。

大規模優化,也就是如何自動調整影響準確度收斂的眾多超參數,因為這些值通常取決子如何進行并行處理。

因此Colossal-AI的目標是將復雜且相互作用的決策從用戶角度隱藏起來,并自動完成所有操作。

編輯:黃飛

-

英偉達

+關注

關注

22文章

3770瀏覽量

90991 -

深度學習

+關注

關注

73文章

5500瀏覽量

121113 -

gtc

+關注

關注

0文章

73瀏覽量

4425

發布評論請先 登錄

相關推薦

AI干貨補給站 | 深度學習與機器視覺的融合探索

NVIDIA推出全新深度學習框架fVDB

深度學習中的時間序列分類方法

基于AI深度學習的缺陷檢測系統

人工智能、機器學習和深度學習是什么

泰禾智能攜AI智選深度學習系列新品亮相臨沂花生展

深度解析深度學習下的語義SLAM

與NVIDIA深度參與GTC,向量數據庫大廠Zilliz與全球頂尖開發者共迎AI變革時刻

FPGA在深度學習應用中或將取代GPU

英偉達GTC大會將開幕 黃仁勛將帶你《見證AI的變革時刻》

潞晨科技Colossal-AI與浪潮信息AIStation完成兼容性互認證

潞晨科技Colossal-AI + 浪潮信息AIStation,大模型開發效率提升10倍

GTC 2023看點:深度學習系統Colossal-AI試圖解決什么問題

GTC 2023看點:深度學習系統Colossal-AI試圖解決什么問題

評論