NVIDIA TAO 工具套件提供了一個低代碼 AI 框架,讓無論是新手還是數據科學專家都可以使用這個平臺加速視覺 AI 模型開發。通過 NVIDIA TAO 工具套件,開發人員可以進行遷移學習,通過適應和優化,在短時間內達到最先進的精度和生產級吞吐量。

在 NVIDIA GTC23 上,NVIDIA 發布了 NVIDIA TAO 套件 5.0 ,帶來了 AI 模型開發方面的突破性功能提升。新功能包括開源架構、基于 Transformer 的預訓練模型、AI 輔助的數據標注,以及在任何平臺上部署模型的能力。

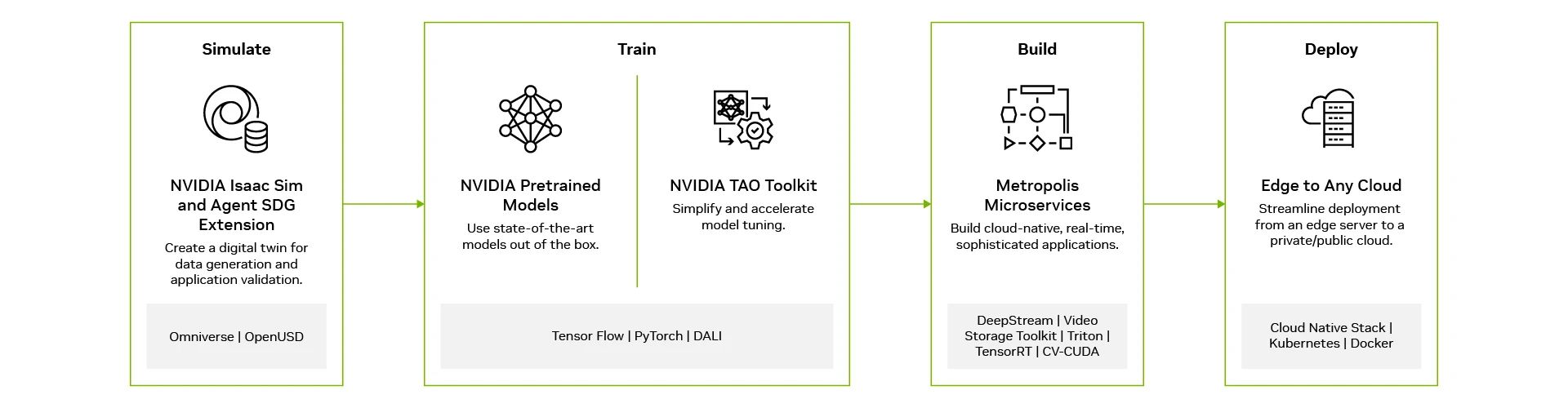

圖 1:NVIDIA TAO 工具套件工作流程圖

在任何平臺、任何位置部署 NVIDIA TAO

NVIDIA TAO 工具套件 5.0 支持 ONNX 模型導出。無論是 GPU 、CPU 、MCU 、DLA 還是 FPGA 的邊緣或云上的任何計算平臺,都可以部署使用 NVIDIA TAO 工具套件訓練的模型。NVIDIA TAO 工具套件簡化了模型訓練過程,優化了模型的推理吞吐量,為數千億臺設備的 AI 提供了動力。

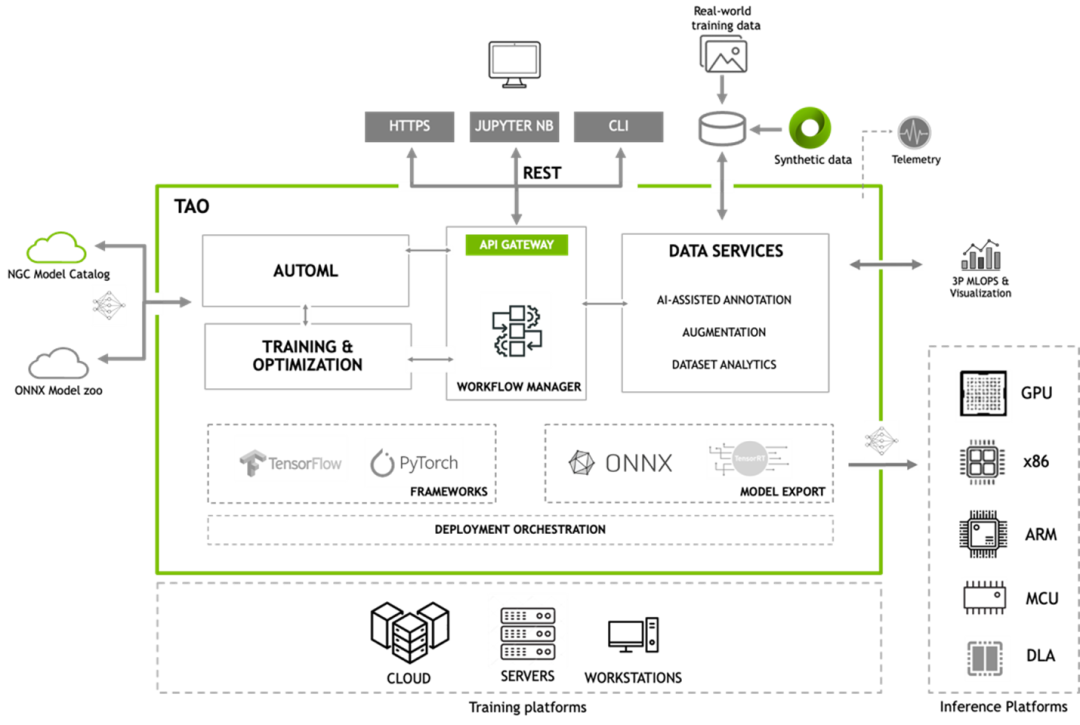

圖 2:NVIDIA TAO 工具套件體系

全球領先的嵌入式微控制器制造商意法半導體,將 TAO 集成到其 STM32Cube AI 開發者工作流程中。借助 TAO,該公司能夠在 STM32 微控制器驅動的各種物聯網和邊緣用例中,根據它們的最大算力和內存運行各種復雜 AI 功能。

現在有了 NVIDIA TAO 工具套件,即使是 AI 新手也可以在微控制器的計算和內存預算內優化和量化 AI 模型,使其在 STM32 MCU 上運行。開發人員還可以導入自己的模型,并使用 TAO 工具套件進行微調。更多關于意法半導體用例信息,請看以下視頻。

雖然 TAO 工具套件模型可以在任何平臺上運行,但這些模型在使用 TensorRT 進行推理的 NVIDIA GPU 上才能實現最高吞吐量。在 CPU 上,這些模型使用 ONNX-RT 進行推理。一旦軟件可用,將提供運行的腳本和配方。

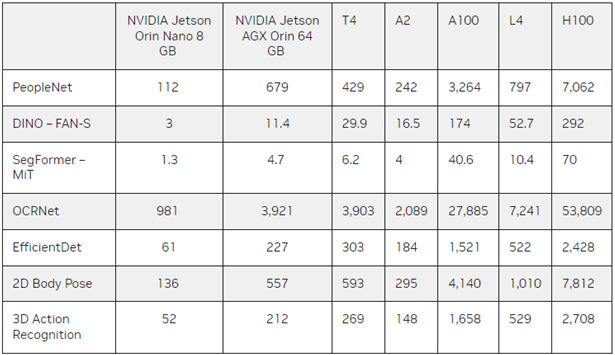

表 1:幾種 NVIDIA TAO 工具套件視覺模型的性能比較(以 FPS 為單位),包括 NVIDIA GPU 上的新視覺 Transformer 模型

AI 輔助的數據標注和管理

對于所有 AI 項目來說,數據標注仍然是一個昂貴且耗時的過程。對于 CV 任務尤其如此,比如需要在標注對象周圍生成像素級別分割掩碼的分割任務。通常,分割掩碼的成本是對象檢測或分類的 10 倍。

通過 TAO 工具套件 5.0 ,用最新的 AI 輔助標注功能對分割掩碼進行標注,速度更快,成本更低。現在,您可以使用弱監督分割架構 Mask Auto Labeler ( MAL )來幫助進行分割注釋,以及固定和收緊用于對象檢測的邊界框。實況數據中對象周圍的松散邊界框可能會導致非最佳檢測結果,但通過 AI 輔助標注,您可以將邊界框收緊到對象上,從而獲得更準確的模型。

MAL 是一個基于 Transformer 的掩碼自動標注框架,用于僅使用方框標注的實例分割。MAL 將方框裁剪圖像作為輸入內容,并有條件地生成掩碼偽標簽。它對輸入和輸出標簽都使用了 COCO 注釋格式。

MAL 顯著縮小了自動標注和人工標注在掩碼質量方面的差距。使用 MAL 生成的掩碼訓練的實例分割模型幾乎可以匹配全監督對應模型的性能,保留了高達 97.4% 的全監督模型的性能。

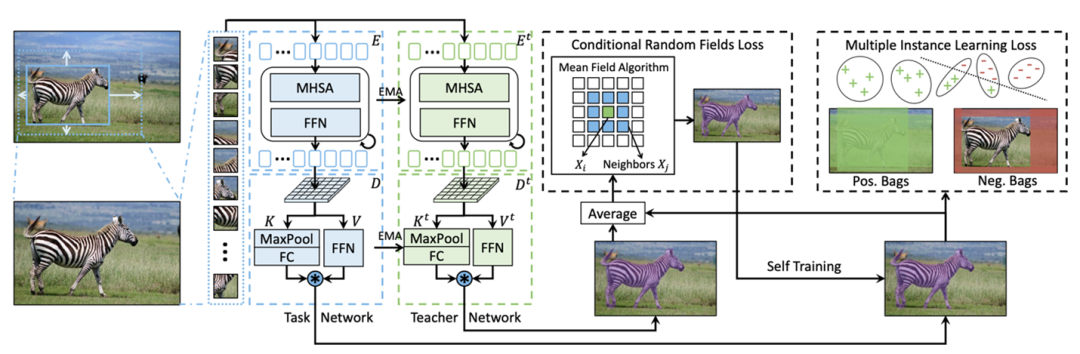

圖 4:Mask Auto Labeler ( MAL )網絡架構

訓練 MAL 網絡時,任務網絡和教師網絡(共享相同的轉換器結構)協同工作以實現與類無關的自我訓練。這樣就可以優化具有條件隨機場 (CRF) 損失和多實例學習 (MIL) 損失的預測掩碼。

TAO 工具套件在自動標注流程和數據擴充流程中都使用了 MAL 。具體而言,用戶可以在空間增強的圖像上生成偽掩碼(例如,剪切或旋轉),并使用生成的掩碼細化和收緊相應的邊界框。

最先進的視覺 Transformer

Transformer 已經成為 NLP 中的標準架構,這主要是因為自注意力架構,同時它們還因一系列視覺 AI 任務而廣受歡迎。一般來說,基于 Transformer 的模型因為具有魯棒性、可推廣性和對大規模輸入執行并行處理的能力,會優于傳統的基于 CNN 的模型。所有這些優點都提高了訓練效率,對圖像損壞和噪聲提供了更好的魯棒性,并對不可視的對象更好地進行泛化。

TAO 工具套件 5.0 為流行的 CV 任務提供了幾種最先進的( SOTA )視覺 Transformer ,具體如下。

全注意力網絡

全注意力網絡( FAN )是 NVIDIA Research 的一個基于 Transformer 的主干,它在抵御各種破壞方面實現了最優的魯棒性。這類主干可以很容易地推廣到新的領域,并且對噪聲、模糊等更具魯棒性。

FAN 模塊背后的一個關鍵設計是注意力通道處理模塊,它可以實現穩健的表征學習。FAN 可以用于圖像分類任務以及諸如對象檢測和分割之類的下游任務。

圖 5 :與 FAN Small (右)相比, ResNet50 (中)損壞圖像的激活熱圖

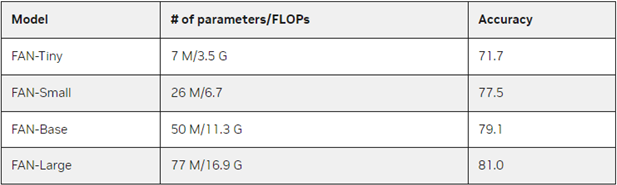

FAN 系列支持四個主干,如表 2 所示。

表 2:具有尺寸和精度的風扇背板

全局視野視覺 Transformer

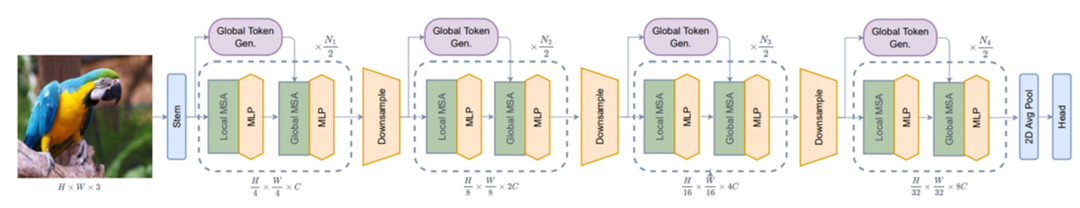

全局上下文視覺 Transformer( GC-ViT )是 NVIDIA Research 的一種新架構,可實現非常高的準確性和計算效率。GC-ViT 解決了視覺 Transformer 中缺乏誘導性偏差的問題 。通過使用局部自注意,它在 ImageNet 上使用較少的參數獲得了更好的結果。

局部自我注意與全局視野自我注意相結合,可以有效地模擬長距離和短距離的空間交互。圖 6 顯示了 GC-ViT 模型體系結構。有關更多詳細信息,請參見 Global Context Vision Transformers (https://arxiv.org/pdf/2206.09959.pdf))。

圖 6:GC-ViT 模型架構

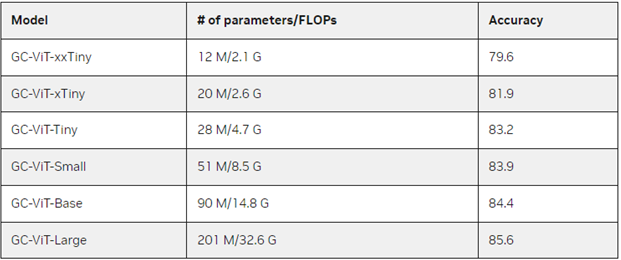

如表 3 所示, GC-ViT 家族包含六個主干,從 GC-ViT-xxTiny (計算效率高)到 GC-ViT-Large (非常準確)。GC-ViT 大型模型在 ImageNet-1K 數據集上可以實現 85.6 的 Top-1 精度,用于圖像分類任務。該體系結構還可以用作其他 CV 任務的主干,如對象檢測、語義和實例分割。

表 3:具有尺寸和精度的 GC-ViT 骨干

DINO

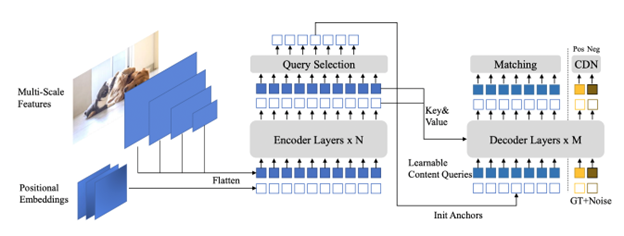

DINO (具有改進去噪錨框的檢測 Transformer)是最新一代檢測 Transformer(DETR ),達到了比上一代更快的訓練收斂時間。Deformable DETR ( D-DETR )至少需要 50 個 epochs 才能收斂,而 DINO 可以在 COCO 數據集上在12個 epochs 內收斂。而且,與 D-DETR 相比,它還實現了更高的精度。

DINO 通過在訓練期間去噪實現更快的收斂,這有助于提案生成階段的二分匹配過程。由于二分匹配的不穩定性,類 DETR 模型的訓練收斂速度較慢。二分匹配減少了對人工和計算繁重的 NMS 操作的需求。但是,它通常需要更多的訓練,因為在二分匹配期間,不正確的基本事實也可以與預測相匹配。

為了解決這個問題, DINO 引入了有噪聲的正負真實框來處理“無對象”場景。因此, DINO 的訓練收斂得非常快。更多信息,請參閱 DINO: 帶有改進的去噪錨框的DETR,可用于端到端對象檢測(https://arxiv.org/pdf/2203.03605.pdf))。

圖 7:DINO 架構

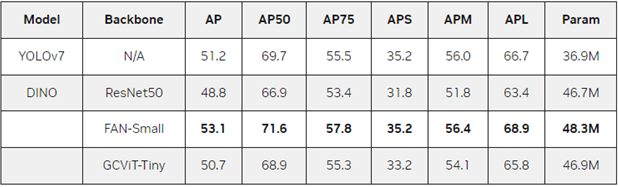

TAO 工具套件中的 DINO 是靈活的,可以與傳統的 CNNs 主干(如 ResNets )和基于 Transformer 的主干(如 FAN 和 GC-ViT )相結合。表 4 顯示了在常用的 YOLOv7 各種版本的 DINO 上的 COCO 數據集的準確性。有關更多詳細信息,請參見 YOLOv7: 為實時物體檢測器設置了新的先進技術的可訓練的免費套件(https://arxiv.org/pdf/2207.02696.pdf)。

表 4:COCO 數據集上的 DINO 和 D-DETR 準確性

SegFormer

SegFormer 是一種基于 Transformer 的輕量級語義分割方法。它的編碼器由輕量級 MLP 層制成,避免了使用位置編碼(主要由 Transformers 使用),這使得推理在不同分辨率下有效。

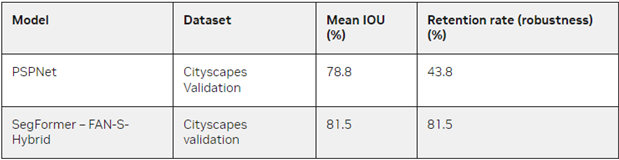

將 FAN 主干網添加到 SegFormer MLP 解碼器中會產生一個高度魯棒性和高效的語義分割模型。混合式 FAN-基站 + SegFormer 是 2022 年魯棒視覺挑戰大賽中語義分割項目的獲勝架構。

圖 8:具有 FAN 預測功能的 SegFormer (右)

其在噪音輸入時的圖像情況(左)

表5:SegPreer 與 PSPNet 的魯棒性對比

目標檢測和分割之外的 CV 任務

除了傳統對象檢測和分割,NVIDIA TAO 工具套件也加速了其他的各種 CV 任務。TAO 工具套件 5.0 中新增的字符檢測和識別模型使開發人員能夠從圖像和文檔中提取文本。文檔轉換實現了自動化,并加速了在保險和金融等行業的用例。

當被分類的對象變化很大時,檢測圖像中的異常是有用的,但不可能用所有的變化進行訓練。例如,在工業檢測中,缺陷可以是任何形式的。如果訓練數據之前沒有發現缺陷,那么使用簡單的分類器可能會導致許多遺漏的缺陷。

對于這樣的用例,將測試對象直接與黃金參考進行比較將獲得更好的準確性。TAO 工具套件 5.0 的特點是暹羅神經網絡,在該網絡中,模型計算出被測對象和黃金參考之間的差異,以便在對象有缺陷時進行分類。

使用 AutoML 實現超參數優化的自動化培訓

自動化機器學習 (AutoML) 自動執行手動任務,即在給定數據集上查找所需 KPI 的最佳模型和超參數。它可以通過算法推導出最佳模型,并抽象出 AI模型創建和優化的大部分復雜性。

TAO 工具套件中的 AutoML 完全配置了用于自動優化模型的超參數。無論是 AI 專家還是新手,都可以輕松使用。對于新手,Jupyter 使用指南提供了一種簡單且有效的創建準確的 AI 模型的方法。

對于專家來說,TAO 工具套件可讓您自由掌控要調整的超參數以及用于掃描的算法。TAO 工具套件目前支持兩種優化算法:貝葉斯優化和超參數優化。這些算法可以掃描一系列超參數,以找到給定數據集的最佳組合。

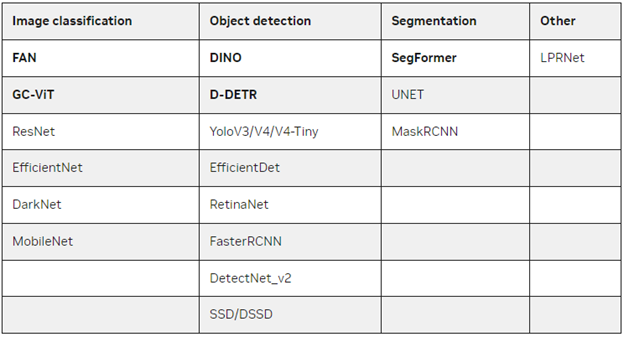

AutoML 支持多種 CV 任務,包括一些新的視覺 Transformer ,如 DINO 、D-DETR 、SegFormer 等。表 6 顯示了支持網絡的完整列表(標粗的項目是 TAO 工具套件 5.0 的新增項目)。

表 6 :TAO 工具套件中 AutoML 支持的模型,包括幾個新的視覺轉換器模型

(標粗的項目是 TAO 工具套件 5.0 的新項目)

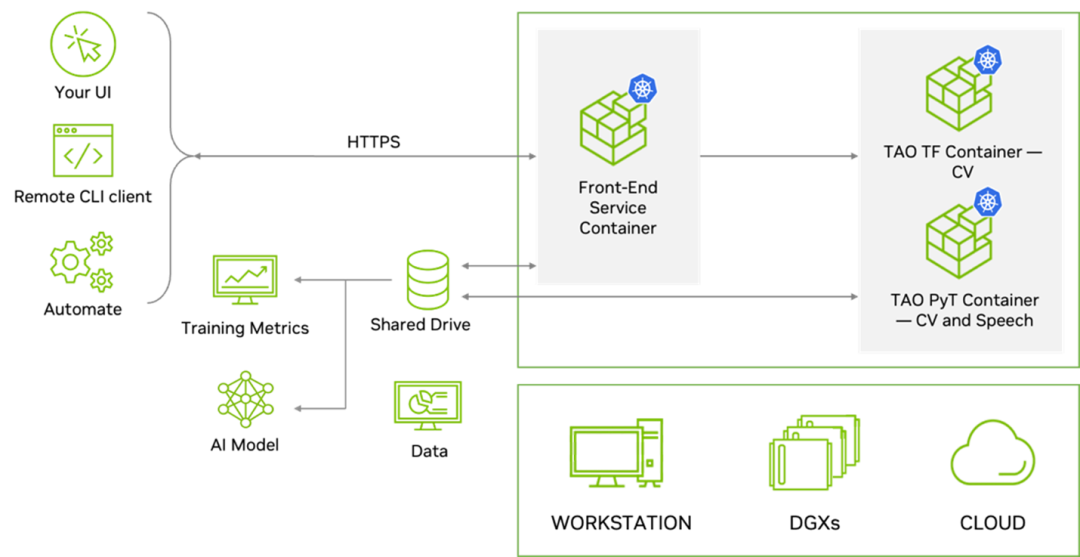

用于工作流程集成的 REST API

TAO 工具套件是模塊化的、云原生的,這意味著它可以作為容器使用,并且可以使用 Kubernetes 進行部署和管理。TAO 工具套件可以作為自管理服務部署在任何公共或私有云、 DGX 或工作站上。此外 TAO 工具套件提供定義完善的 REST API,使其易于集成到您的開發工作流程中。開發人員可以調用 API 端點來執行所有訓練和優化任務。這些 API 端點可以從任何應用程序或用戶界面調用,然后通過遠程觸發進行訓練作業。

圖 9:用于云原生部署的 TAO 工具套件架構

更好的推理優化方案

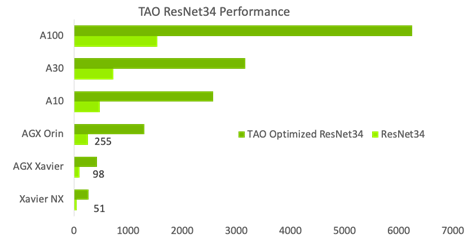

為了簡化產品化并提高推理吞吐量,TAO 工具套件提供了多種交鑰匙性能優化技術。其中包括模型修剪、低精度量化和 TensorRT 優化,與公共模型庫的同類模型相比,這些技術加起來可以提供 4 到 8 倍的性能提升。

圖 10:在各種 GPU 上優化的 TAO 工具套件和公共模型之間的性能比較

開放靈活,具有更好的支撐

因為 AI 模型是基于復雜的算法預測輸出的,這可能會使人們很難理解系統是如何做出決定的,并且很難調試、診斷和修復錯誤。可解釋人工智能( XAI )通過解釋 AI 模型如何做出決策來應對這些調整。這不僅有助于人類理解 AI 輸出背后的推理過程,也使診斷和修復錯誤變得更容易。這種透明度有助于建立對 AI 系統的信任。

為了提高透明度和可解釋性, TAO 工具套件將以開源形式提供。開發人員將能夠從內部層查看特征圖,并繪制激活熱圖,以更好地理解人工智能預測背后的推理過程。此外,訪問源代碼將使開發人員能夠靈活地創建定制的 AI,提高調試能力,并增加對其模型的信任。

NVIDIA TAO 工具套件現已推出,可通過NVIDIA AI Enterprise( NVAIE ) 購買。NVAIE 為公司提供關鍵業務支持、 NVIDIA AI 專家答疑以及優先安全修復。了解 NVAIE (https://www.nvidia.com/en-us/data-center/products/ai-enterprise/)并獲得 AI 專家的指導。

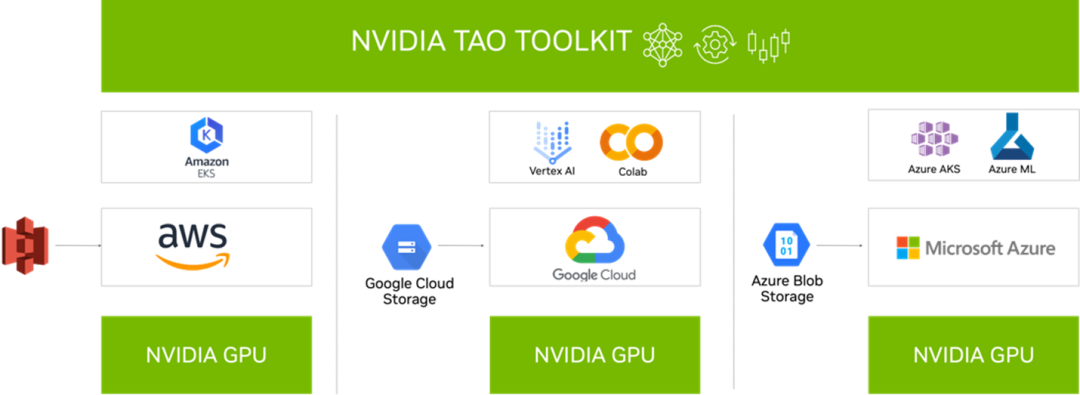

與云服務集成

NVIDIA TAO 工具套件可以集成到您使用的各種 AI 服務中,如 Google Vertex AI 、AzureML 、Azure Kubernetes 服務和 Amazon EKS 。

圖 11:TAO 工具套件 5.0 與各種 AI 服務集成

總結

TAO 工具套件提供了一個平臺,任何開發者在任何服務任何設備上都可以使用,可以輕松地轉移學習他們的自定義模型,執行量化和修剪,管理復雜的訓練工作流程,并在無需編碼情況下執行人工智能輔助注釋。在 GTC23 上,NVIDIA 發布了 TAO 工具套件5.0。點擊鏈接進行注冊(https://developer.nvidia.com/login)了解 TAO 工具套件的最新更新。

下載 NVIDIA TAO 工具套件(https://developer.nvidia.com/tao-toolkit-get-started)并開始創建自定義人工智能模型。您也可以在 LaunchPad (https://www.nvidia.com/en-us/launchpad/ai/develop-fine-tune-computer-vision-models-with-tao-automl/)上體驗 NVIDIA TAO 工具套件。

?

?

掃描海報二維碼,或點擊“閱讀原文”,即可觀看 NVIDIA 創始人兼首席執行官黃仁勛 GTC23 主題演講重播!

原文標題:GTC23 | 使用 NVIDIA TAO Toolkit 5.0 體驗最新的視覺 AI 模型開發工作流程

文章出處:【微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

-

英偉達

+關注

關注

22文章

3902瀏覽量

92967

原文標題:GTC23 | 使用 NVIDIA TAO Toolkit 5.0 體驗最新的視覺 AI 模型開發工作流程

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

使用NVIDIA RTX PRO Blackwell系列GPU加速AI開發

英偉達GTC2025亮點 NVIDIA推出Cosmos世界基礎模型和物理AI數據工具的重大更新

NVIDIA 推出開放推理 AI 模型系列,助力開發者和企業構建代理式 AI 平臺

NVIDIA GTC 2025大會前瞻

NX CAD軟件:數字化工作流程解決方案(CAD工作流程)

NVIDIA推出多個生成式AI模型和藍圖

AI工作流自動化是做什么的

NVIDIA發布全新AI和仿真工具以及工作流

使用全新NVIDIA AI Blueprint開發視覺AI智能體

揭秘NVIDIA AI Workbench 如何助力應用開發

評論