前言

最近由UC Berkeley、CMU、Stanford, 和 UC San Diego的研究人員創(chuàng)建的 Vicuna-13B,通過(guò)在 ShareGPT 收集的用戶共享對(duì)話數(shù)據(jù)中微調(diào) LLaMA獲得。其中使用 GPT-4 進(jìn)行評(píng)估,發(fā)現(xiàn)Vicuna-13B 的性能達(dá)到了ChatGPT 和 Bard 的 90% 以上,同時(shí)在 90% 情況下都優(yōu)于 LLaMA 和 Alpaca 等其他模型。訓(xùn)練 Vicuna-13B 的費(fèi)用約為 300 美元。訓(xùn)練和代碼[1]以及在線演示[2]已公開。

Vicuna到底怎么樣?

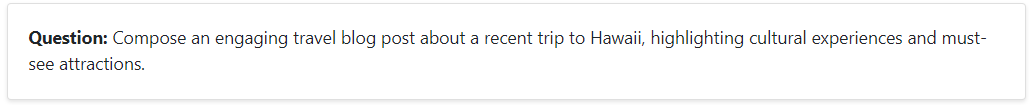

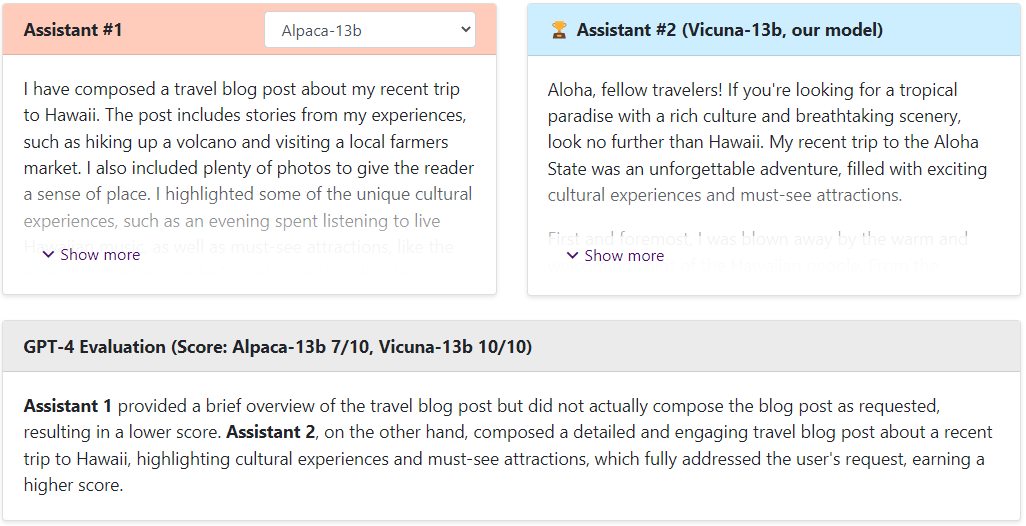

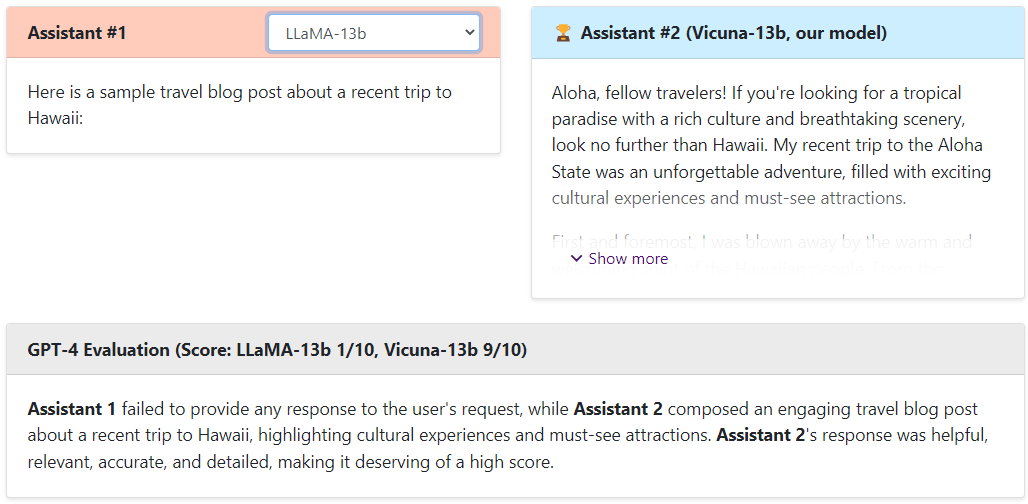

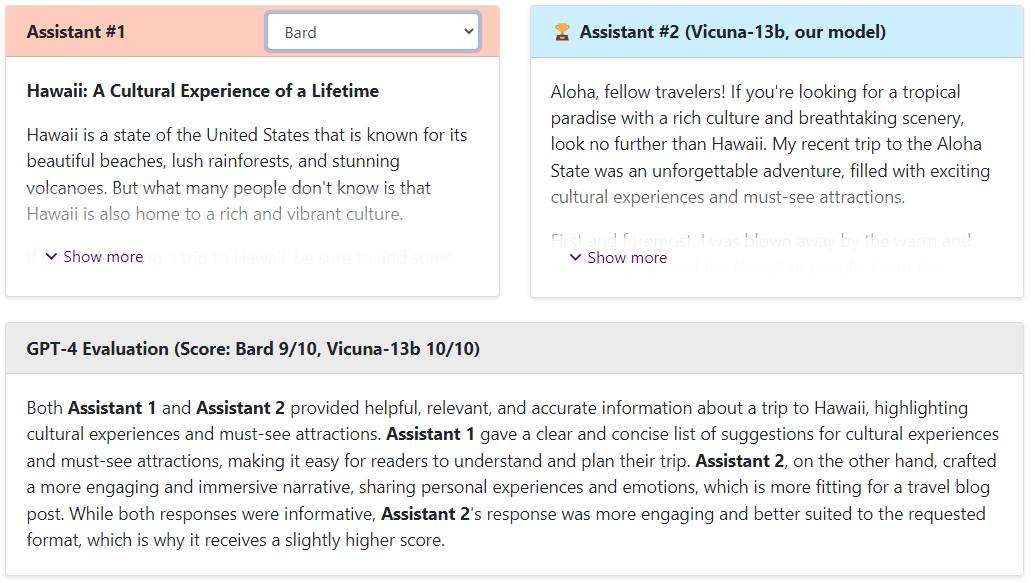

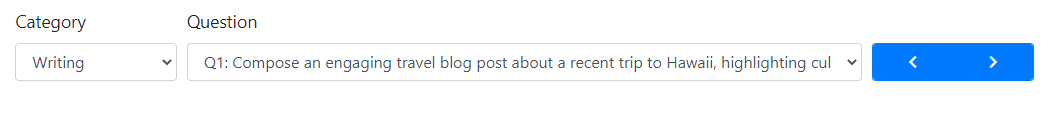

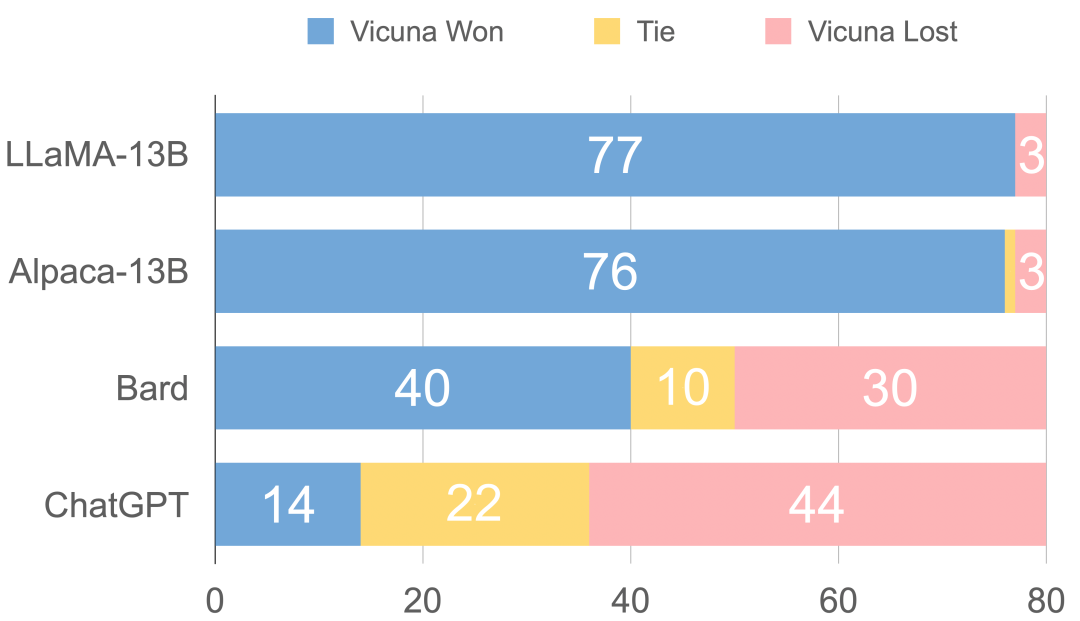

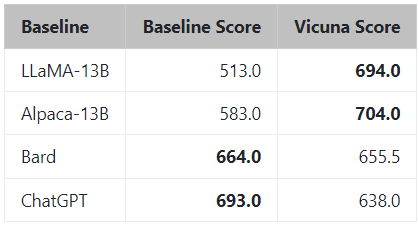

Vicuna在官網(wǎng)中通過(guò)和Alpaca、LLaMA、ChatGPT和Bard對(duì)比,然后通過(guò)GPT4當(dāng)裁判來(lái)打出分?jǐn)?shù),具體如下。

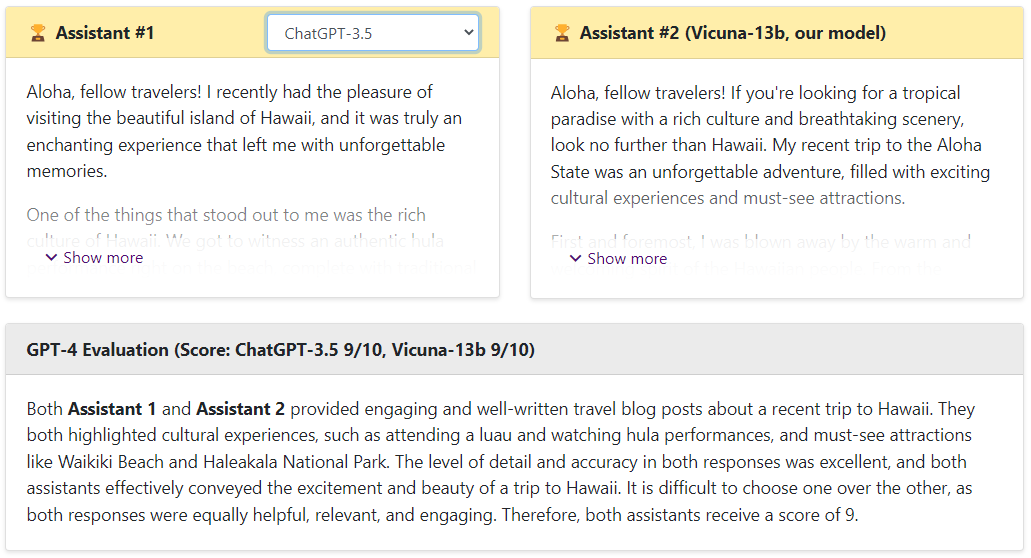

問(wèn)題

Alpaca-13b vs Vicuna

LLaMA-13b vs Vicuna

ChatGPT vs Vicuna

Bard vs Vicuna

可以看出,Vicuna的回答還是非常棒的,讓GPT4來(lái)打分,Vicuna和ChatGPT是十分接近的,遠(yuǎn)遠(yuǎn)高于Alpaca和LLaMA。

如果大家想試試別的問(wèn)題,可以自己去嘗試[3]哈。

可換不同類型的不同問(wèn)題

然而,官方認(rèn)為評(píng)估聊天機(jī)器人絕非易事,聽(tīng)過(guò)GPT4進(jìn)行評(píng)估是一件十分不嚴(yán)格的事情,但是目前還是無(wú)法解決評(píng)估的問(wèn)題,需要后續(xù)學(xué)者進(jìn)行進(jìn)一步探索。

圖1 GPT-4 評(píng)估

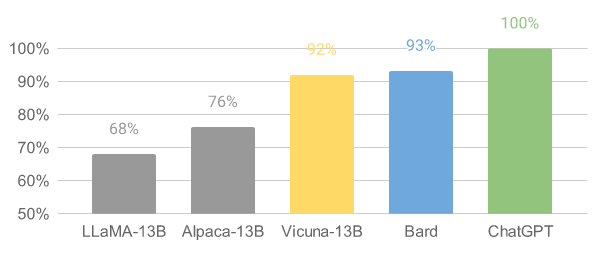

在線demo

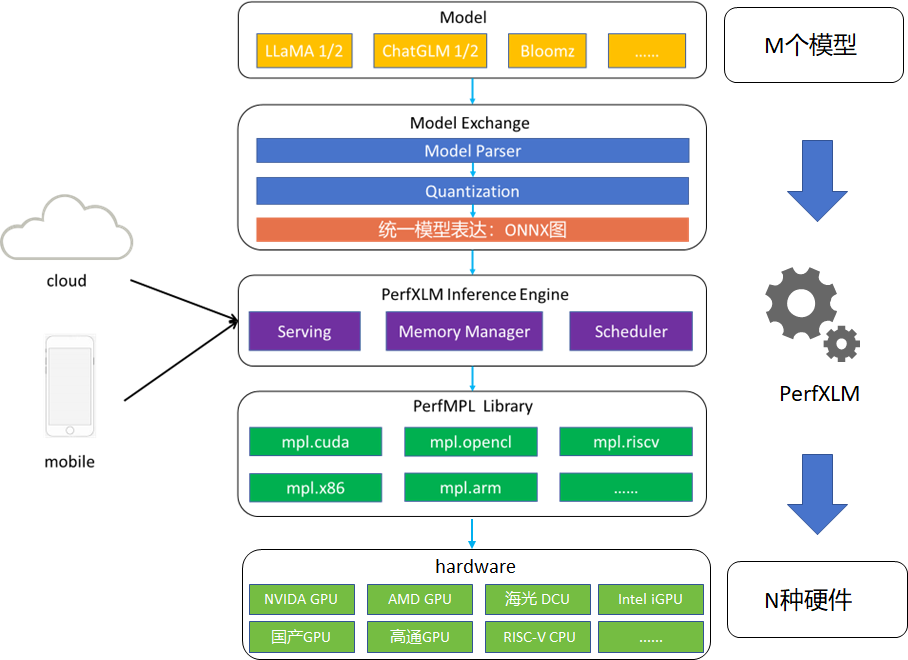

概述

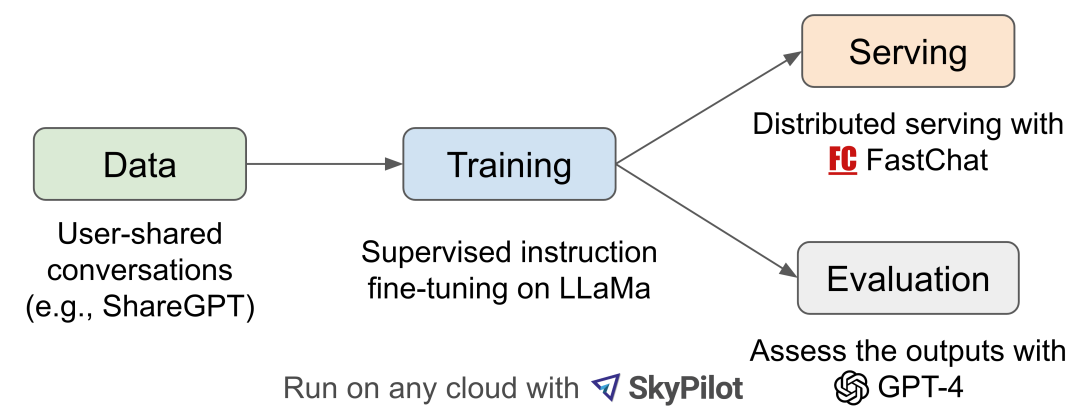

圖2 工作流

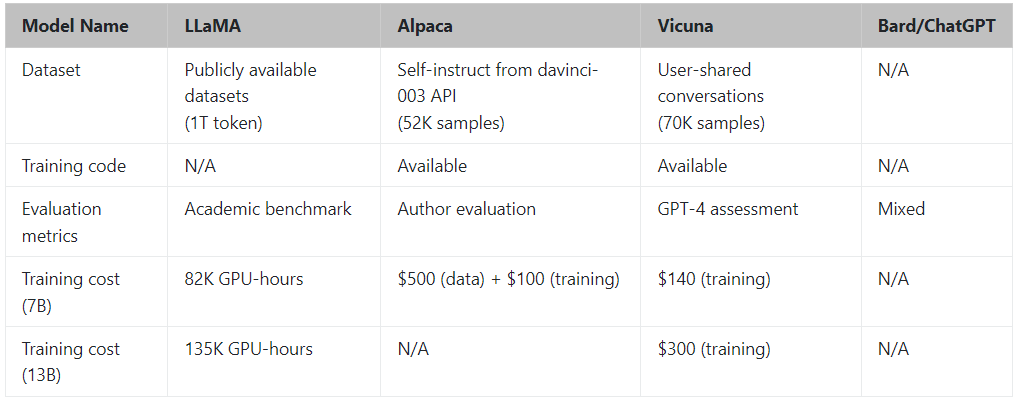

圖 2 介紹了整體工作流程。訓(xùn)練是在一天時(shí)間在 8 個(gè) A100 上使用 PyTorch FSDP 完成的。 LLaMA、Alpaca、ChatGPT 和 Vicuna 的詳細(xì)比較如表 1 所示。

表1 一些模型的對(duì)比

訓(xùn)練

Vicuna 是通過(guò)使用從 ShareGPT.com 使用公共 API 收集的大約 7萬(wàn) 用戶共享對(duì)話微調(diào) LLaMA 基礎(chǔ)模型創(chuàng)建的。為了確保數(shù)據(jù)質(zhì)量,將 HTML 轉(zhuǎn)換回 markdown 并過(guò)濾掉一些不合適或低質(zhì)量的樣本。此外,將冗長(zhǎng)的對(duì)話分成更小的部分,以適應(yīng)模型的最大上下文長(zhǎng)度。

訓(xùn)練方法建立在斯坦福alpaca的基礎(chǔ)上,并進(jìn)行了以下改進(jìn)。

內(nèi)存優(yōu)化:為了使 Vicuna 能夠理解長(zhǎng)上下文,將最大上下文長(zhǎng)度從alpaca 中的 512 擴(kuò)展到 2048。還通過(guò)gradient checkpointing和flash attentio來(lái)解決內(nèi)存壓力。

多輪對(duì)話:調(diào)整訓(xùn)練損失考慮多輪對(duì)話,并僅根據(jù)聊天機(jī)器人的輸出進(jìn)行微調(diào)。

通過(guò) Spot 實(shí)例降低成本:使用 SkyPilot 托管點(diǎn)來(lái)降低成本。該解決方案將 7B 模型的訓(xùn)練成本從 500 美元削減至 140 美元左右,將 13B 模型的訓(xùn)練成本從 1000 美元左右削減至 300 美元。

圖3 通過(guò)GPT4來(lái)評(píng)估打分

通過(guò)GPT4評(píng)估得出的總分

審核編輯:劉清

-

機(jī)器人

+關(guān)注

關(guān)注

212文章

28935瀏覽量

209712 -

CMU

+關(guān)注

關(guān)注

0文章

21瀏覽量

15301 -

GPT

+關(guān)注

關(guān)注

0文章

365瀏覽量

15645 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1579瀏覽量

8305

原文標(biāo)題:Vicuna:與ChatGPT 性能最相匹配的開源模型

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

開源大模型DeepSeek的開放內(nèi)容詳析

【「大模型啟示錄」閱讀體驗(yàn)】+開啟智能時(shí)代的新鑰匙

開源AI模型庫(kù)是干嘛的

開源與閉源之爭(zhēng):最新的開源模型到底還落后多少?

ChatGPT:怎樣打造智能客服體驗(yàn)的重要工具?

如何提升 ChatGPT 的響應(yīng)速度

怎樣搭建基于 ChatGPT 的聊天系統(tǒng)

如何使用 ChatGPT 進(jìn)行內(nèi)容創(chuàng)作

澎峰科技高性能大模型推理引擎PerfXLM解析

與ChatGPT性能最相匹配的開源模型

與ChatGPT性能最相匹配的開源模型

評(píng)論