最近一段時間,文本生成的人工智能在互聯網上掀起了一陣風暴:ChatGPT 因為可以對人們能想到的幾乎任何問題提供非常詳細、近乎逼真的回答而受到追捧。大模型應用的出現讓人們對于 AI 技術突破充滿了信心,不過很少有人知道在其背后,一個分布式機器學習框架正為這場生成式 AI 革命提供動力。

分布式計算框架 Ray 來自 A16z 支持的初創公司 Anyscale,它是使 OpenAI 能夠強化其訓練 ChatGPT 等模型的關鍵。在 OpenAI 最近的所有大型語言模型背后都有 Ray 的身影 —— 它可能也會是 OpenAI 備受期待的 GPT-4 背后的框架。隨著大模型技術的不斷落地,業內人士認為通過生成接近人類的內容,一個價值數十億美元的產業正在形成。

在這一領域,Ray 是影響力最大的框架。在它出現之前,OpenAI 使用自定義工具集合來開發大模型。但 OpenAI 總裁 Greg Brockman 在今年早些時候的 Ray 峰會上就表示,隨著面臨的挑戰增多,該公司已轉而使用 Ray。

軟件公司 Weights & Biases 的 CEO Lukas Biewald 認為,Ray 已是 AI 世界中炙手可熱的后起之秀。「因為新工具出現,你可以在筆記本電腦和大型分布式服務器上運行相同代碼。這是巨大的改變,隨著模型變得更大,它的重要性也會隨之增加,」Biewald 表示。

十億美元的賭注

隨著技術的成熟,Ray 引來了資本市場的關注。Anyscale 的股權成為了一種稀缺的商品,據 Business Insider 報道,有知情人士稱,其最近一輪融資是 C 輪融資的延伸,估值超過 10 億美元,幾天內就結束了。

一些投資者將 Anyscale 描述為 Horowitz 充滿希望的「下一個 Databricks」—— 這個描述看來不無道理,因為這家初創公司的創始人之一 Ion Stoica 是市值 310 億美元的數據巨頭 Databricks 的聯合創始人。

「人工智能的發展速度令人難以置信,人們一直在嘗試新方法,」Anyscale 首席執行官 Robert Nishihara 表示。「ChatGPT 結合了此前大語言模型上的大量工作。在此基礎上,你需要擁有能夠實現靈活性、快速創新,并擴展不同算法和方法的基礎設施。」

由于像 ChatGPT 這樣熱門的新工具背后是越來越大的模型,科技公司不得不重新考慮從頭開始開發 AI 的方式。Ray 應運而生,使訓練這些龐大的模型變得更加容易,并且可以包含數千億個數據點,讓每個響應都具有準栩栩如生的感覺。

Ray 如何成為機器學習的首選工具

Ray 是一個基于內存共享的分布式計算框架,適用于細粒度的并行計算和異構計算,其提供了一個底層基礎架構,用于管理分配機器學習模型訓練工作的復雜任務。

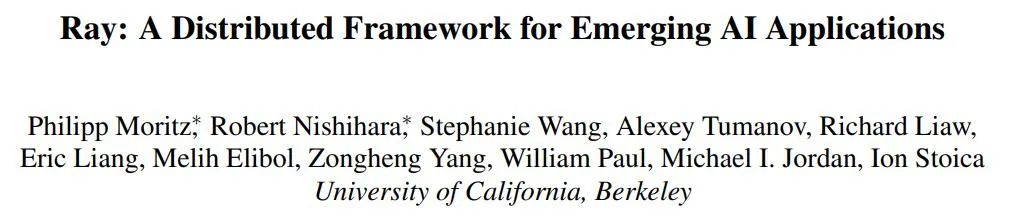

在 2017 年,UC Berkeley 的研究人員首次提交了 Ray 的論文《 Ray: A Distributed Framework for Emerging AI Applications 》:

論文鏈接:https://arxiv.org/abs/1712.05889

GitHub:https://github.com/ray-project/ray

在該工作中,研究人員預測了下一代 AI 應用程序的形態:與環境存在連續的交互,并從交互動作中進行學習。這些應用必然越來越多地在動態環境中來完成任務,根據環境的變化作出反應,并執行一系列的動作來達到長期目標。這些特性對于運行環境性能和靈活性等方面提出了全新且苛刻的系統要求,因此研究者提出了基于分布式的 Ray 框架。

Ray 實現了統一接口,可以表達任務并行和基于參與者的計算,由單個動態執行引擎支持。為了滿足性能要求,Ray 采用分布式調度程序和分布式容錯存儲來管理系統的控制狀態。它是首個將訓練、仿真和服務統一起來的分布式計算框架,基于動態任務執行引擎統一了角色并行(actor)和任務并行(task)的計算,并保障了框架的高可擴展性和高容錯性。

Ray 的架構。

基于該工作,2019 年 12 月,UC Berkeley 的 Robert Nishihara、Philipp Moritz 和 Ion Stoica 以及伯克利教授 Michael I. Jordan 創立了 Anyscale,迄今為止該公司已融資 2.6 億美元。

機器學習從業者通常可以在自己的筆記本電腦上運行使用有限數據集的小型模型,例如預測用戶購買產品的簡單模型。然而,像 ChatGPT 這樣的超大型模型,筆記本電腦是行不通的,這些模型需要大量服務器來訓練。

使用大量設備訓練一個模型要面對一個重要挑戰 —— 在不同硬件上協調訓練。而 Ray 恰好解決了這個難題,它為從業者提供了一種將不同硬件作為一個單元來管理的機制,用于確定什么數據去哪里,處理故障等等,硬件種類橫跨谷歌云、AWS 和其他處理相同問題的產品組合。此外,Ray 還將其他語言中的一個關鍵編程概念「actor」擴展到 Python,眾所周知 Python 是機器學習程序的首選語言。

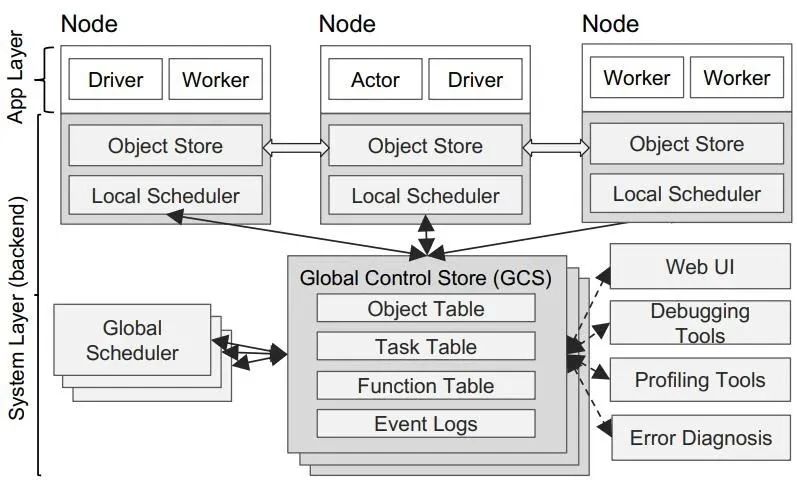

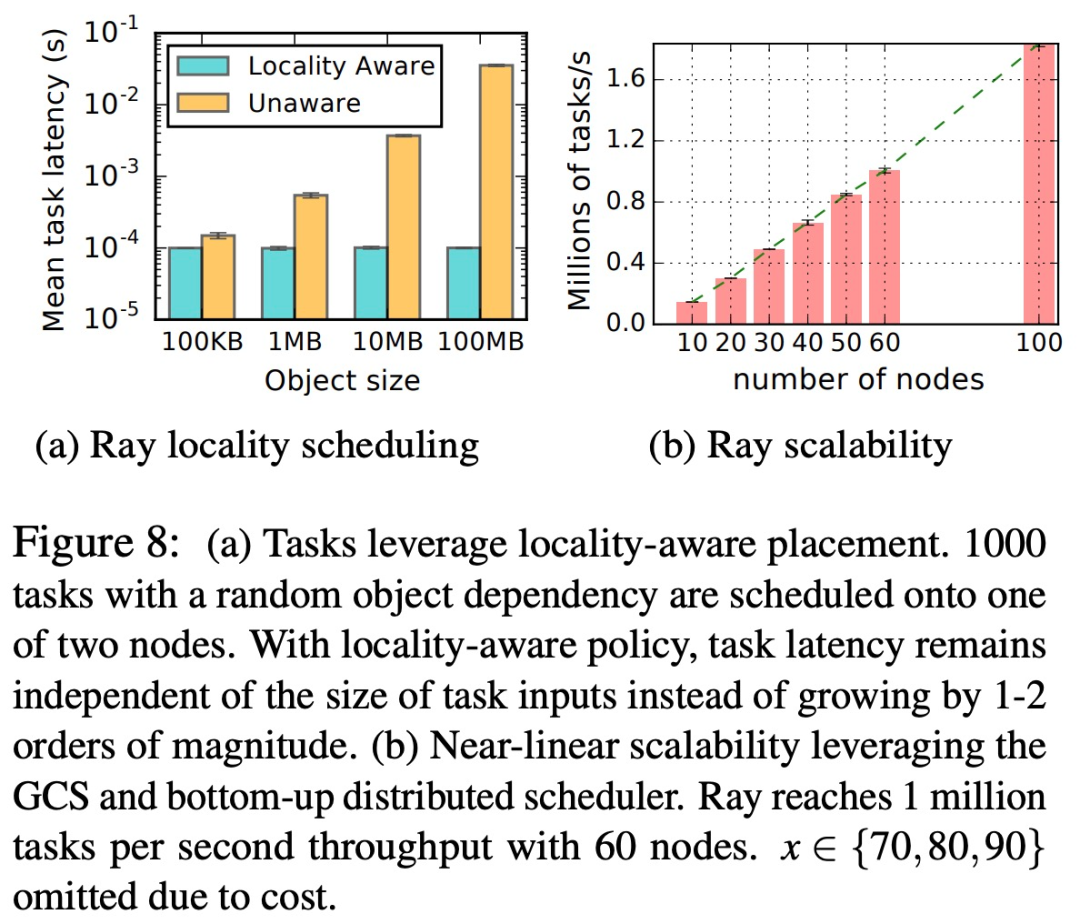

作為一個分布式計算框架,Ray 有兩個關鍵優勢,分別是位置感知(Locality-aware)和任務分配(task placement)。如下圖所示,Ray 能夠橫向擴展系統,以支持高吞吐量的細粒度任務,同時保持容錯和低延遲任務調度。

Ray 為 OpenAI 訓練大模型消除了巨大的復雜性,為該公司騰出更多時間和精力專注于模型的關鍵能力。

新一代 AI 需要新的開發工具,Ray 只是一系列迅速興起的下一代機器學習工具中的一個,這些工具正在迅速顛覆 AI 的開發方式。例如,Google 的 JAX 框架也獲得了巨大關注,JAX 有望成為谷歌核心機器學習工具的支柱,已經在 DeepMind 和 Google Brain 被廣泛采用。

類似地,由 FirstMark Capital 和 Bessemer Venture Partners 支持的初創公司 Coiled 開發了一個名為 Dask 的并行計算框架。

近來大型語言模型正在釋放更多潛力,這些新型機器學習工具將為業內科技巨頭和初創公司構建更強大的語言模型。

審核編輯 :李倩

-

人工智能

+關注

關注

1791文章

47185瀏覽量

238267 -

機器學習

+關注

關注

66文章

8407瀏覽量

132567 -

OpenAI

+關注

關注

9文章

1079瀏覽量

6483

原文標題:ChatGPT背后的開源AI框架Ray,現在值10億美元

文章出處:【微信號:TheBigData1024,微信公眾號:人工智能與大數據技術】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

ChatGPT背后的開源AI框架Ray,現在值10億美元

ChatGPT背后的開源AI框架Ray,現在值10億美元

評論