Auto-GPT 究竟是一個開創性的項目,還是一個被過度炒作的 AI 實驗?本文為我們揭開了喧囂背后的真相,并揭示了 Auto-GPT 不適合實際應用的生產局限性。

背景介紹

這兩天,Auto-GPT,一款讓最強語言模型 GPT-4 能夠自主完成任務的模型,一夜成名,讓整個 AI 圈瘋了。短短八天時間,它就在 GitHub 上獲得了驚人 Star 數量,目前已經突破 8 萬,并吸引了無數開源社區的關注。

此前爆火的 ChatGPT,唯一不太好用的地方,就是需要人類輸入 Prompt。而 Auto-GPT 的一大突破是,可以讓 AI 自我提示,換句話說,AI 都完全不需要咱們人類了?

在為 Auto-GPT 狂歡的同時,我們也有必要退一步審視其潛在的不足之處,探討這個「AI 神童」所面臨的局限和挑戰。

接下來,肖涵博士將和我們深入探討Auto-GPT 究竟是一個開創性的項目,還是另一個被過度炒作的人工智能實驗。

Auto-GPT 是如何工作的?

不得不說,Auto-GPT 在 AI 領域掀起了巨大的波瀾,它就像是賦予了 GPT-4 記憶和實體一樣,讓它能夠獨立應對任務,甚至從經驗中學習,不斷提高自己的性能。

為了便于理解 Auto-GPT 是如何工作的,讓我們可以用一些簡單的比喻來分解它。

首先,想象 Auto-GPT 是一個足智多謀的機器人。

我們每分配一個任務,Auto-GPT 都會給出一個相應的解決計劃。比如,需要瀏覽互聯網或使用新數據,它便會調整其策略,直到任務完成。這就像擁有一個能處理各種任務的私人助手,如市場分析、客戶服務、市場營銷、財務等。

具體來說,想讓 Auto-GPT 運行起來,就需要依靠以下 4 個組件:

1. 架構

Auto-GPT 是使用強大的 GPT-4 和 GPT-3.5 大型語言模型構建的,它們充當機器人的大腦,幫助它思考和推理。

2. 自主迭代

這就像機器人從錯誤中學習的能力。Auto-GPT 可以回顧它的工作,在以前的努力的基礎上再接再厲,并利用它的歷史來產生更準確的結果。

3. 內存管理

與向量數據庫(一種內存存儲解決方案)集成,使 Auto-GPT 能夠保留上下文并做出更好的決策。這就像給機器人配備了長時記憶,可以記住過去的經歷。

4. 多功能性

Auto-GPT 的文件操作、網頁瀏覽和數據檢索等功能使其用途廣泛。這就像賦予機器人多種技能來處理更廣泛的任務。

然而,這些誘人的前景可能還尚未轉化為 Auto-GPT 真正可以實現的能力。

天價成本

想要在現實的生產環境中使用 Auto-GPT,首先面臨的障礙便是其高昂的成本。

由于任務需要通過一系列的思維迭代來完成,為了提供最好的推理和提示,模型每一步通常都會用盡所有 token。

然而,GPT-4 的 token 并不便宜。根據 OpenAI 的定價,具有 8K 上下文窗口的 GPT-4 模型,對于提示部分,每 1000 個 token 收費 0.03 美元;而對于結果部分,每 1000 個 token 收費 0.06 美元。而 1000 個 token 大概可以換算成 750 個英文單詞。

讓我們分解思維鏈中每一步的成本,假設每個動作都用盡了 8000 個 token 的上下文窗口,其中 80% 是提示(6400 個 token),20% 是結果(1600 個 token)。

提示成本:6400 個 token x 0.03 美元/1000 個 token = 0.192 美元

結果成本:1600 個 token x 0.06 美元/1000 個 token = 0.096 美元

因此,每個 Step 的成本就是:0.192 美元 + 0.096 美元 = 0.288 美元

平均而言,Auto-GPT 完成一項小任務需要 50 個 step。

因此,完成單個任務的成本就是:50 個 step x 0.288 美元/step = 14.4 美元

VUEGPTTHOUGHTS:Let'sstartbycheckingifthereareanyupdatestoVueJS.Ifthereare,wecanupdatetothelatestversionandproceed.Otherwise,wecanmoveontocreatingtheTODOlistwebsiteapplication. REASONING:Startingwiththemostupdatedandstableversionoftheframeworkwillensureourprojecthasthelatestfeatures,bugfixesandisproperlysupported.CreatingtheTODOlistwebsiteapplicationisourprimarygoal,sowecanmoveontothatiftherearenoupdates. PLAN: -CheckforVueJSupdates -Updatetolatestversionifthereareupdates -Ifnoupdates,moveontocreatingtheTODOlistwebsiteapplication CRITICISM:None NEXTACTION:COMMAND=googleARGUMENTS={'input':'VueJSlatestversionupdate'} Enter'y'toauthorisecommand,'y-N'torunNcontinuouscommands,'n'toexitprogram,orenterfeedbackforVueGPT...

以 VueGPT 為例:這是一個 Auto-GPT 創建的 AI,旨在使用 Vue JS 創建網站應用程序,我們來看看它在思維鏈中的一個步驟,而且這還是一次就能出結果的情況,如果需要重新生成,成本會更高。

從這個角度來看,Auto-GPT 目前對大部分用戶和組織來說,都是不現實的。

開發到生產的難題

乍一看,花 14.4 美元來完成一項復雜的任務,好像并無不妥。

舉個例子,我們首先讓 Auto-GPT 制作一份圣誕節食譜。然后,再找它要一份感恩節食譜的話,猜猜會發生什么?

沒錯,Auto-GPT 會按照相同的思維鏈從頭再做一遍,也就是說,我們需要再花 14.4 美元才行。

但實際上,這兩個任務在「參數」的區別應該只有一個:節日。

既然我們已經花了 14.4 美元開發了一種創建食譜的方法,那么再用花相同的錢來調整參數,顯然是不符合邏輯的。

想象一下,在玩《我的世界》(Minecraft),每次都要從頭開始建造一切。顯然,這會讓游戲變得非常無趣。

而這便暴露了Auto-GPT 的一個根本問題:它無法區分開發和生產。

當 Auto-GPT 完成目標時,開發階段就完成了。不幸的是,我們并沒有辦法將這一系列操作「序列化」為一個可重用的函數,從而投入生產。

因此,用戶每次想要解決問題時都必須從開發的起點開始,不僅費時費力,而且還費錢。

這種低下的效率,引發了關于 Auto-GPT 在現實世界生產環境中實用性的質疑,也突顯了 Auto-GPT 在為大型問題解決提供可持續、經濟有效的解決方案方面的局限性。

循環泥潭

不過,如果 14.4 美元真的能解決問題,那么它仍然是值得的。

但問題在于,Auto-GPT 在實際使用時,經常會陷入到死循環里……

那么,為什么 Auto-GPT 會陷入這些循環?

要理解這一點,我們可以把 Auto-GPT 看作是依賴 GPT 來使用一種非常簡單的編程語言來解決任務。

解決任務的成功取決于兩個因素:編程語言中可用的函數范圍和GPT 的分治法能力(divide and conquer),即 GPT 能夠多好地將任務分解成預定義的編程語言。遺憾的是,GPT 在這兩點上都是不足的。

Auto-GPT 提供的有限功能可以在其源代碼中觀察到。例如,它提供了用于搜索網絡、管理內存、與文件交互、執行代碼和生成圖像的功能。然而,這種受限的功能集縮小了 Auto-GPT 能夠有效執行的任務范圍。

此外,GPT 的分解和推理能力仍然受到限制。盡管 GPT-4 相較于 GPT-3.5 有了顯著的改進,但其推理能力遠非完美,進一步限制了 Auto-GPT 的解決問題的能力。

這種情況類似于嘗試使用 Python 構建像《星際爭霸》這樣復雜的游戲。雖然 Python 是一種強大的語言,但將《星際爭霸》分解為 Python 函數極具挑戰性。

本質上,有限功能集和 GPT-4 受限的推理能力的結合,最終造成了這個循環的泥潭,使 Auto-GPT 在許多情況下無法實現預期的結果。

人類與 GPT 的區別

分治法是 Auto-GPT 的關鍵。盡管 GPT-3.5/4 在前任基礎上有了顯著的進步,但在使用分治法時,其推理能力仍然無法達到人類水平。

1. 問題分解不充分

分治法的有效性在很大程度上取決于將復雜問題分解為較小、易于管理的子問題的能力。人類推理通常可以找到多種分解問題的方法,而 GPT-3.5/4 可能沒有同樣程度的適應性或創造力。

2. 識別合適基本案例的難度

人類可以直觀地選擇適當的基本案例以得到有效的解決方案。相比之下,GPT-3.5/4 可能難以確定給定問題的最有效基本案例,這會顯著影響分治過程的整體效率和準確性。

3. 問題背景理解不充分

雖然人類可以利用其領域知識和背景理解來更好地應對復雜問題,但 GPT-3.5/4 受其預先訓練的知識所限,可能缺乏用分治法有效解決某些問題所需的背景信息。

4. 處理重疊子問題

人類通常可以識別出解決重疊子問題時,并有策略地重用先前計算過的解決方案。而 GPT-3.5/4 可能沒有同樣程度的意識,可能會多次冗余地解決相同的子問題,從而導致解決方案的效率降低。

向量數據庫:過度的解決方案

Auto-GPT 依賴向量數據庫進行更快的 k-最近鄰(kNN)搜索。這些數據庫檢索先前的思維鏈,并將它們融入到當前查詢上下文中,以便為 GPT 提供一種記憶效果。

然而,考慮到 Auto-GPT 的約束和局限性,這種方法被批評為過度且不必要地消耗資源。其中,反對使用向量數據庫的主要論點源于與 Auto-GPT 思維鏈相關的成本約束。

一個 50 步的思維鏈將花費 14.4 美元,而一個 1000 步的鏈將花費更多。因此,記憶大小或思維鏈的長度很少超過四位數。在這種情況下,對最近鄰點進行窮舉搜索(即 256 維向量與 10000 x 256 矩陣之間的點積)被證明是足夠高效的,用時不到一秒鐘。

相比之下,每個 GPT-4 調用大約需要 10 秒鐘來處理,所以實際上限制系統處理速度的是 GPT,而非數據庫。

盡管在特定場景下,向量數據庫可能在某些方面具有優勢,但在 Auto-GPT 系統中實現向量數據庫以加速 kNN “長時記憶”搜索似乎是一種不必要的奢侈和過度的解決方案。

智能體機制的誕生

Auto-GPT 引入了一個非常有趣的概念,允許生成智能體(Agent)來委派任務。

雖然,這種機制還處于初級階段,其潛力尚未被充分挖掘。不過,有多種方法可以增強和擴展當前的智能體系統,為更高效、更具動態性的互動提供新的可能性。

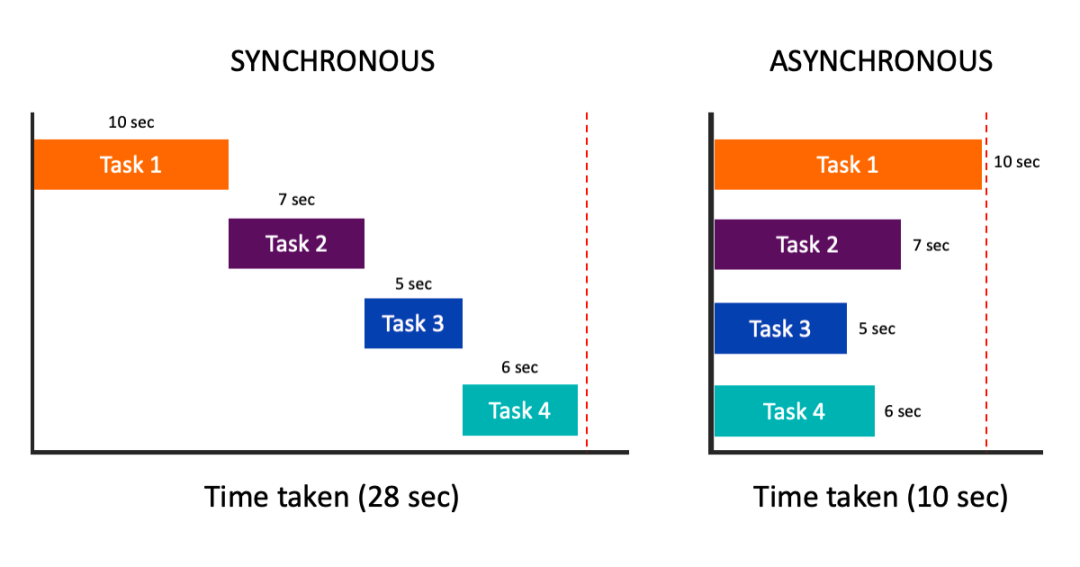

一個潛在的改進是引入異步智能體。通過結合異步等待模式,智能體可以并發操作而不會阻塞彼此,從而顯著提高系統的整體效率和響應速度。這個概念受到了現代編程范式的啟發,這些范式已經采用了異步方法來同時管理多個任務。

圖源:https://scoutapm.com/blog/async-javascript

另一個有前景的方向是實現智能體之間的相互通信。通過允許智能體進行通信和協作,它們可以更有效地共同解決復雜問題。這種方法類似于編程中的 IPC 概念,其中多個線程/進程可以共享信息和資源以實現共同目標。

生成式智能體是未來的方向

隨著 GPT 驅動的智能體不斷發展,這種創新方法的未來似乎十分光明。

新的研究,如「Generative Agents: Interactive Simulacra of Human Behavior」,強調了基于智能體的系統在模擬可信的人類行為方面的潛力。

論文中提出的生成式智能體,可以以復雜且引人入勝的方式互動,形成觀點,發起對話,甚至自主計劃和參加活動。這項工作進一步支持了智能體機制在 AI 發展中具有前景的論點。

通過擁抱面向異步編程的范式轉變并促進智能體間通信,Auto-GPT 可以為更高效和動態的問題解決能力開辟新可能。

將《生成式智能體》論文中引入的架構和交互模式融入其中,可以實現大型語言模型與計算、交互式智能體的融合。這種組合有可能徹底改變在 AI 框架內分配和執行任務的方式,并實現更為逼真的人類行為模擬。

智能體系統的開發和探索可極大地促進 AI 應用的發展,為復雜問題提供更強大且動態的解決方案。

總結

總之,圍繞 Auto-GPT 的熱議引發了關于 AI 研究現狀以及公眾理解在推動新興技術炒作中的作用的重要問題。

正如上面所展示的,Auto-GPT 在推理能力方面的局限性、向量數據庫的過度使用以及智能體機制的早期發展階段,揭示了它距離成為實際解決方案還有很長的路要走。

圍繞 Auto-GPT 的炒作,提醒我們膚淺的理解可能讓期望過高,最終導致對 AI 真正能力的扭曲認識。

話雖如此,Auto-GPT 確實為 AI 的未來指明了一個充滿希望的方向:生成式智能體系統。

最后,肖涵博士總結道:「讓我們從 Auto-GPT 的炒作中吸取教訓,培養關于 AI 研究的更為細致和知情的對話。」

這樣,我們就可以利用生成式智能體系統的變革力量,繼續推動 AI 能力的邊界,塑造一個技術真正造福人類的未來。

審核編輯 :李倩

-

語言模型

+關注

關注

0文章

522瀏覽量

10271 -

智能體

+關注

關注

1文章

147瀏覽量

10576 -

ChatGPT

+關注

關注

29文章

1560瀏覽量

7616

原文標題:碾壓ChatGPT、自主完成任務、Star數超8萬的Auto-GPT,是炒作還是未來?

文章出處:【微信號:OSC開源社區,微信公眾號:OSC開源社區】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

ADXL345配置成AUTO_SLEEP模式為什么無法進入正常工作?

使用TC21x的GPT實現1m計時器執行定時任務,怎么配置GTM和GPT?

ADXL345配置成AUTO_SLEEP模式為什么無法進入正常工作

GPT定時器?基本知識詳解

EPIT定時器與GPT定時器簡單介紹

GPT高精度延時定時器簡介

GPT2模塊的相關資料推薦

GPT/GPT-2/GPT-3/InstructGPT進化之路

Auto GPT橫空出世,力推算力設施

微軟提出Control-GPT:用GPT-4實現可控文本到圖像生成!

一文詳解GPT tokenizer 的工作原理

Auto-GPT是如何工作的?

Auto-GPT是如何工作的?

評論