據外媒報道,上周四,Google、微軟、OpenAI 幾家公司的 CEO 受邀去白宮,共論關于人工智能發展的一些重要問題。然而,讓人有些想不通的是,深耕 AI 多年的 Meta 公司(前身為 Facebook)卻沒有在受邀之列。

沒多久,更讓 Meta CEO 扎克伯格扎心的是,一位官員對此解釋稱,本次會議“側重的是目前在 AI 領域,尤其是面向消費者的產品方面,處于領先地位的公司。”

顯然對于這樣的解釋,并不能讓人信服,畢竟這一次受邀名單中還有一家由 OpenAI 的前成員創立的美國人工智能初創和公益公司 Anthropic。

似乎是為了出一口“氣”,也為證明自家的實力,相比 OpenAI、Google 推出閉源的 GPT-4、Bard 模型,Meta 在開源大模型的路上一騎絕塵,繼兩個月前開源 LLaMA大模型之后,再次于5 月 9 日開源了一個新的 AI 模型——ImageBind(https://github.com/facebookresearch/ImageBind),短短一天時間,收獲了 1.6k 個 Star。

這個模型與眾不同之處便是可以將多個數據流連接在一起,包括文本、圖像/視頻和音頻、視覺、IMU、熱數據和深度(Depth)數據。這也是業界第一個能夠整合六種類型數據的模型。

ImageBind 用圖像對齊六模態,旨在實現感官大一統

簡單來看,相比 Midjourney、Stable Diffusion 和 DALL-E 2 這樣將文字與圖像配對的圖像生成器,ImageBind 更像是廣撒網,可以連接文本、圖像/視頻、音頻、3D 測量(深度)、溫度數據(熱)和運動數據(來自 IMU),而且它無需先針對每一種可能性進行訓練,直接預測數據之間的聯系,類似于人類感知或者想象環境的方式。

對此,Meta 在其官方博客中也說道,“ImageBind 可以勝過之前為一種特定模式單獨訓練的技術模型。但最重要的是,它能使機器更好地一起分析許多不同形式的信息,從而有助于推進人工智能。”

打個比喻,人類可以聽或者閱讀一些關于描述某個動物的文本,然后在現實生活中看到就能認識。

你站在繁忙的城市街道等有刺激性環境中,你的大腦會(很大程度上應該是無意識地)吸收景象、聲音和其他感官體驗,以此推斷有關來往的汽車、行人、高樓、天氣等信息。

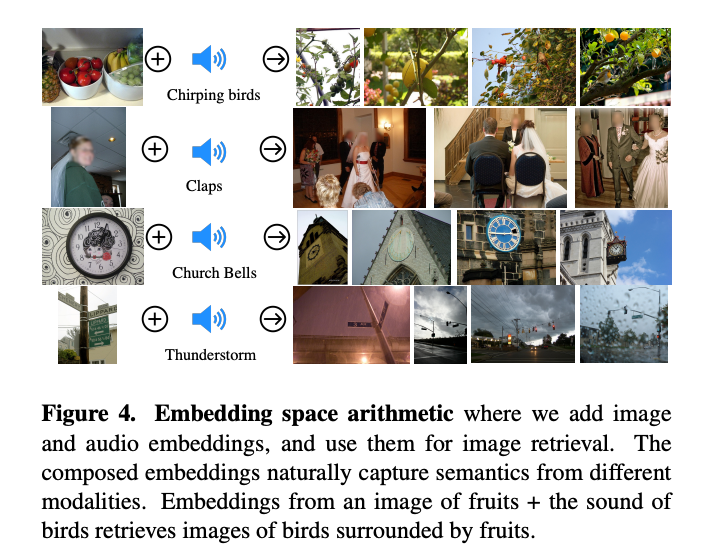

在很多場景中,一個單一的聯合嵌入空間包含許多不同種類的數據,如聲音、圖像、視頻等等。

如今,基于 ImageBind 這樣的模型可以讓機器學習更接近人類學習。

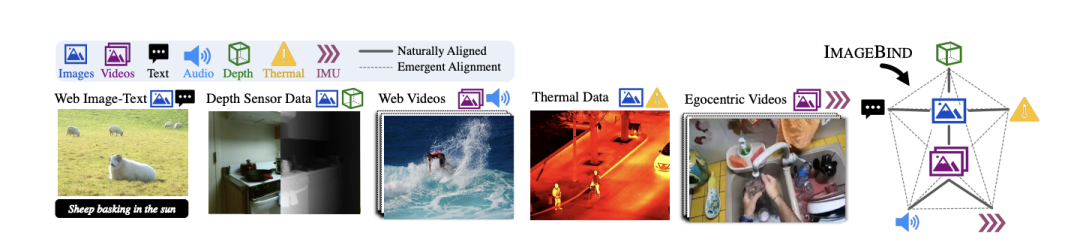

在官方博客中,Meta 分享 ImageBind 是通過圖像的綁定屬性,只要將每個模態的嵌入與圖像嵌入對齊,即圖像與各種模式共存,可以作為連接這些模式的橋梁,例如利用網絡數據將文本與圖像連接起來,或者利用從帶有 IMU 傳感器的可穿戴相機中捕獲的視頻數據將運動與視頻連接起來。

ImageBind 整體概覽

從大規模網絡數據中學到的視覺表征可以作為目標來學習不同模態的特征。這使得 ImageBind 能夠對齊與圖像共同出現的任何模式,自然地將這些模式相互對齊。與圖像有強烈關聯的模態,如熱學和深度,更容易對齊。非視覺的模態,如音頻和 IMU,具有較弱的關聯性。

ImageBind 顯示,圖像配對數據足以將這六種模式綁定在一起。該模型可以更全面地解釋內容,使不同的模式可以相互 "對話",并在不觀察它們的情況下找到聯系。

例如,ImageBind 可以在沒有看到它們在一起的情況下將音頻和文本聯系起來。這使得其他模型能夠 "理解 "新的模式,而不需要任何資源密集型的訓練。

不過,該模型目前只是一個研究項目,沒有直接的消費者和實際應用,但是它展現了生成式 AI 在未來能夠生成沉浸式、多感官內容的方式,也表明了 Meta 正在以與 OpenAI、Google 等競爭對手不同的方式,趟出一條屬于開源大模型的路。

ImageBind 強大的背后

與此同時,作為一種多模態的模型,ImageBind 還加入了 Meta近期開源的一系列 AI 工具,包括DINOv2計算機視覺模型,這是一種不需要微調訓練高性能計算機視覺模型的新方法;以及 Segment Anything(SAM),這是一種通用分割模型,可以根據任何用戶的提示,對任何圖像中的任何物體進行分割。

ImageBind 是對這些模型的補充,因為它專注于多模態表示學習。它試圖為多種模式學習提供一個統一的特征空間,包括但不限于圖像和視頻。在未來, ImageBind 可以利用 DINOv2 的強大視覺特征來進一步提高其能力。

ImageBind 的性能

針對 ImageBind 性能,Meta 研究科學家還發布了一篇《IMAGEBIND: One Embedding Space To Bind Them All》(https://dl.fbaipublicfiles.com/imagebind/imagebind_final.pdf)論文,分享了技術細則。

通過分析表明,ImageBind 模型的性能實際上可以通過使用很少的訓練實例來提高。這個模型有新的出現的能力,或者說是擴展行為--也就是說,在較小的模型中不存在的能力,但在較大的版本中出現。這可能包括識別哪種音頻適合某張圖片或從照片中預測場景的深度。

而 ImageBind 的縮放行為隨著圖像編碼器的強度而提高。

換句話說,ImageBind 對準各種模式的能力隨著視覺模型的強度和大小而增加。這表明,較大的視覺模型有利于非視覺任務,如音頻分類,而且訓練這種模型的好處超出了計算機視覺任務。

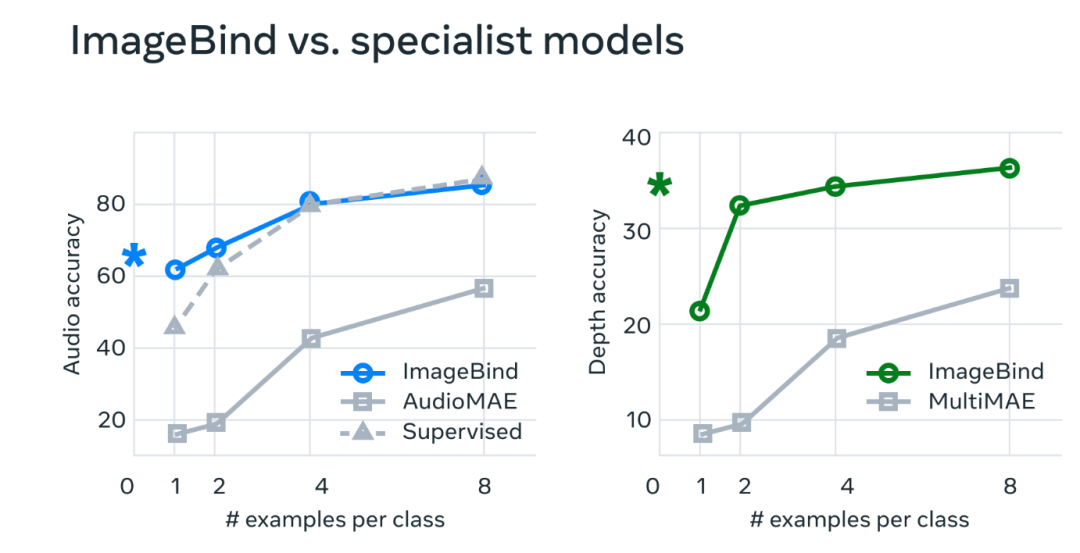

在實驗中,研究人員使用了 ImageBind 的音頻和深度編碼器,并將其與之前在 zero-shot 檢索以及音頻和深度分類任務中的工作進行了比較。

結果顯示,ImageBind 可以用于少量樣本的音頻和深度分類任務,并且優于之前定制的方法。

最終,Meta 認為ImageBind 這項技術最終會超越目前的六種“感官”,其在博客上說道,“雖然我們在當前的研究中探索了六種模式,但我們相信引入連接盡可能多的感官的新模式——如觸覺、語音、嗅覺和大腦 fMRI 信號——將使更豐富的以人為中心的人工智能模型成為可能。”

ImageBind 可以用來干什么?

如果說 ChatGPT 可以充當搜索引擎、問答社區,Midjourney 可以被用來當畫畫工具,那么用 ImageBind 可以做什么?

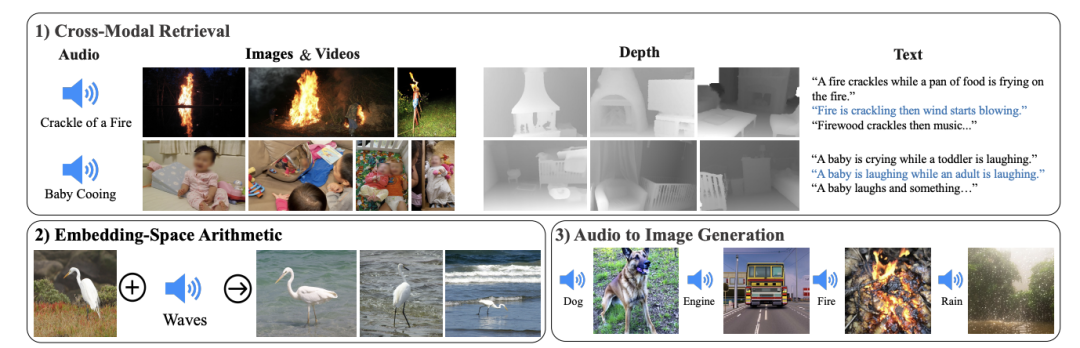

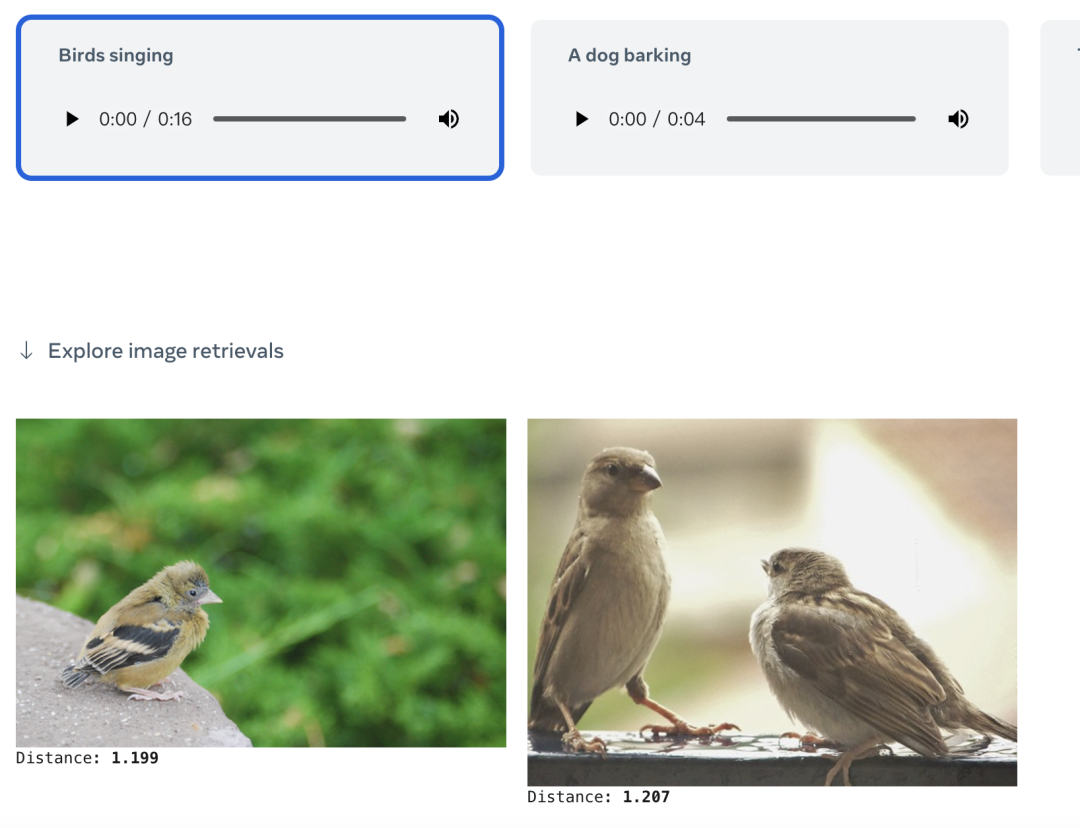

根據官方發布的 Demo 顯示,它可以直接用圖片生成音頻:

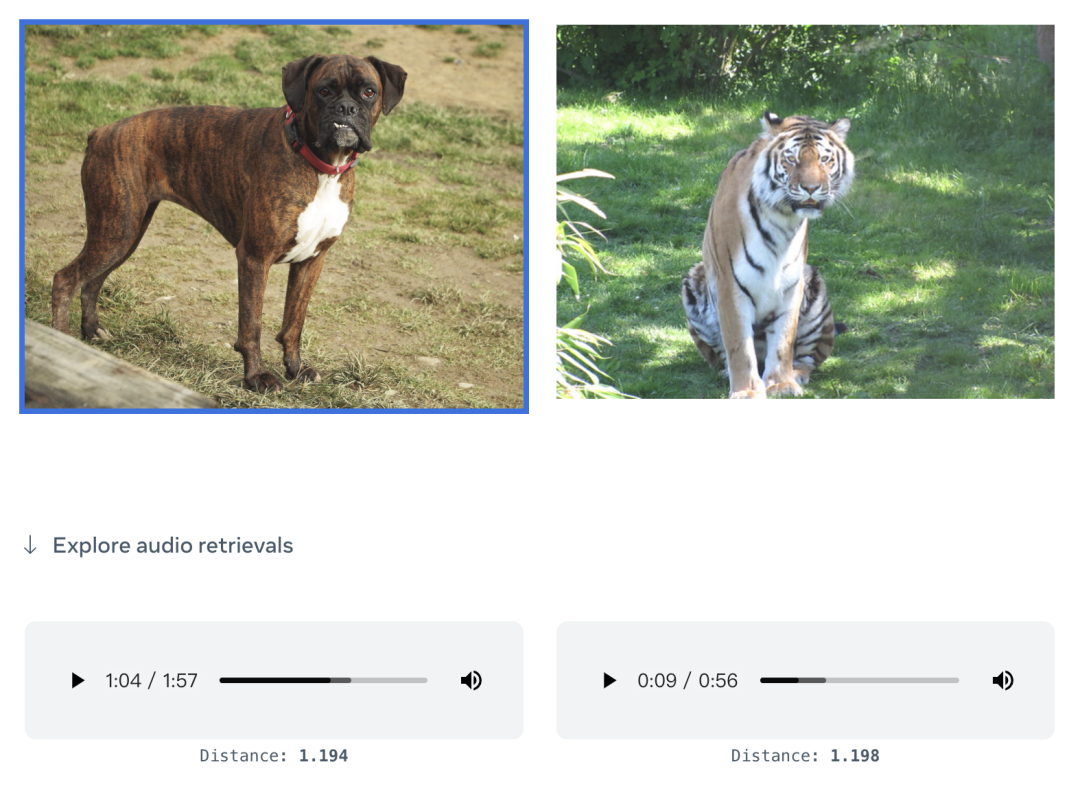

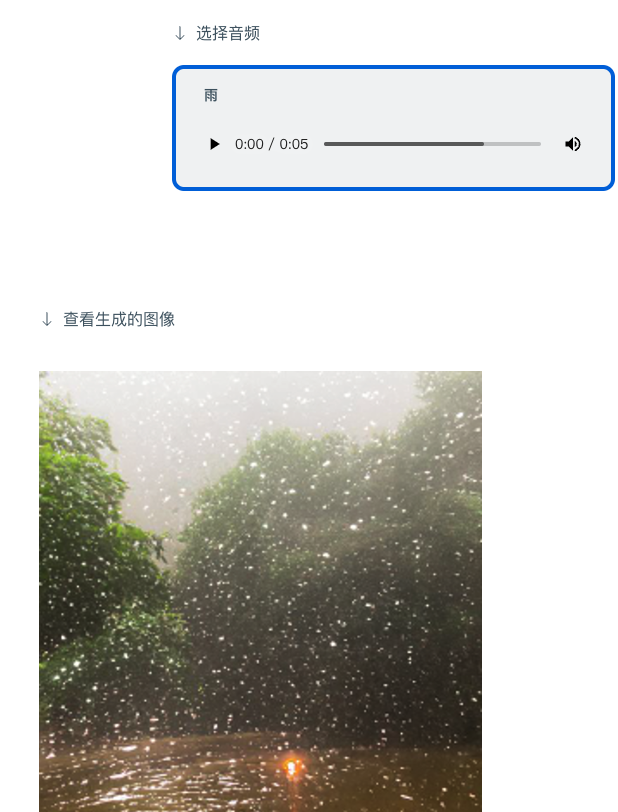

也可以音頻生成圖片:

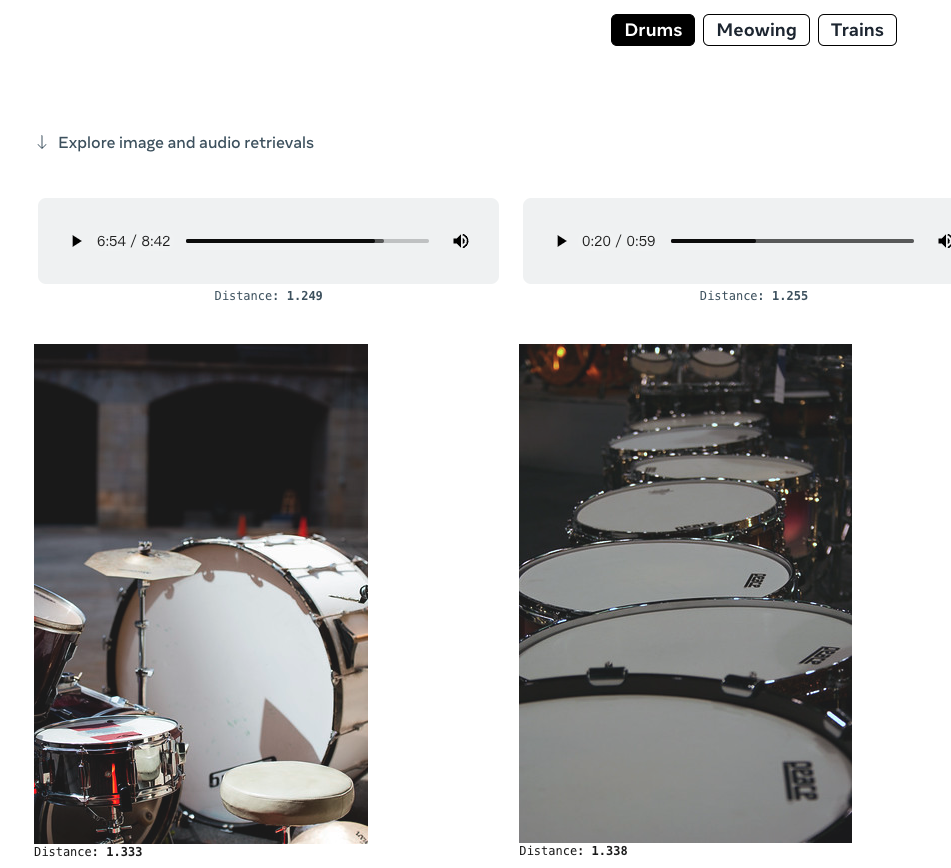

亦或者直接給一個文本,就可以檢索相關的圖片或者音頻內容:

當然,基于 ImageBind 也可以給出一個音頻+一張圖,如“狗叫聲”+海景圖:

可以直接得到一張“狗在看海”的圖:

也可以給出音頻,生成相應的圖像:

正如上文所述, ImageBind 給出了未來生成式 AI 系統可以以多模態呈現的方式,同時,結合 Meta 內部的虛擬現實、混合現實和元宇宙等技術和場景結合。

可以想象一下未來的頭顯設備,它不僅可以生成音頻和視頻輸入,也可以生成物理舞臺上的環境和運動,即可以動態構建 3D 場景(包括聲音、運動等)。

亦或者,虛擬游戲開發人員也許最終可以使用它來減少設計過程中的大量跑腿工作。

同樣,內容創作者可以僅基于文本、圖像或音頻輸入制作具有逼真的音頻和動作的沉浸式視頻。

也很容易想象,用 ImageBind 這樣的工具會在無障礙空間打開新的大門,譬如,生成實時多媒體描述來幫助有視力或聽力障礙的人更好地感知他們的直接環境。

“在典型的人工智能系統中,每個模態都有特定的嵌入(即可以表示數據及其在機器學習中的關系的數字向量),”Meta 說。“ImageBind 表明可以跨多種模態創建聯合嵌入空間,而無需使用每種不同模態組合對數據進行訓練。這很重要,因為研究人員無法創建包含例如來自繁忙城市街道的音頻數據和熱數據,或深度數據和海邊文本描述的樣本的數據集。”

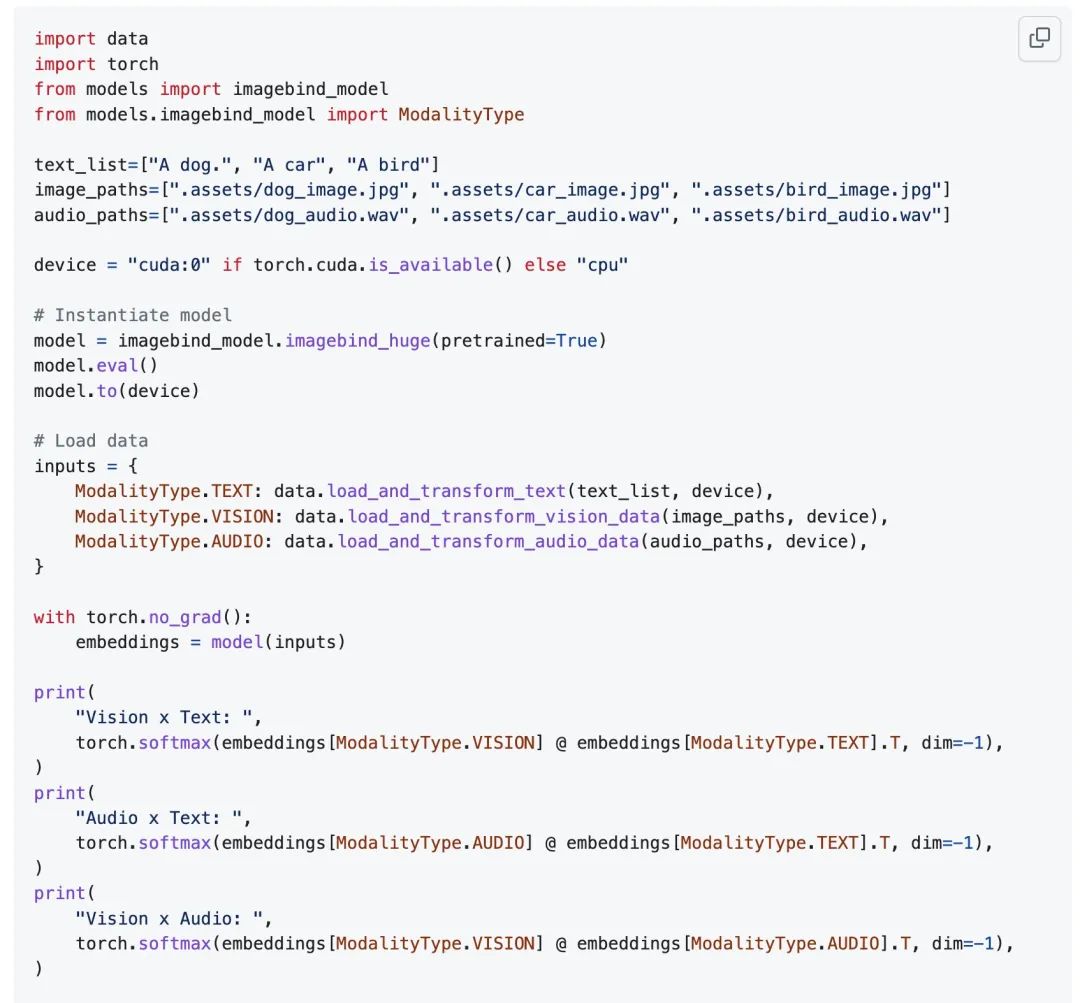

當前,外界可以通過大約 30 行 Python 代碼就能使用這個多模式嵌入 API:

開源大模型是好事還是壞事?

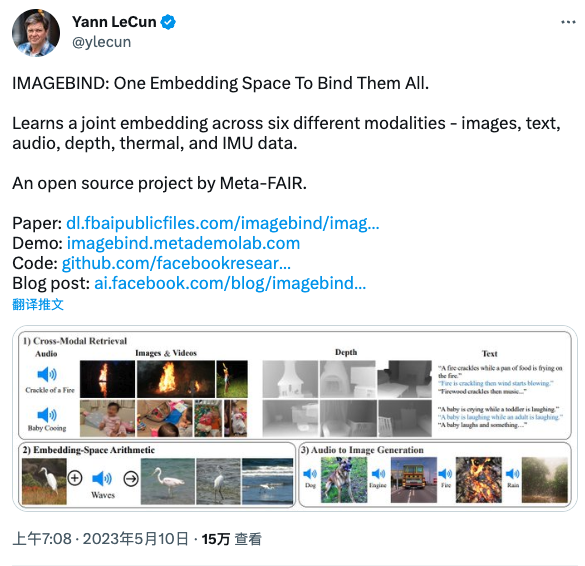

ImageBind 一經官宣,也吸引了很多 AI 專家的關注。如卷積網絡之父 Yann LeCun 也在第一時間分享了關于 ImageBind 的資料:

NVIDIA AI 科學家 Jim Fan 在 Twitter 上表示:

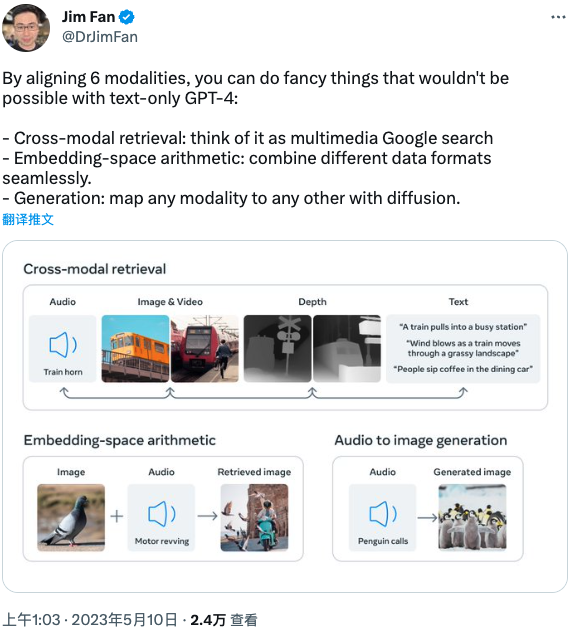

自從 LLaMA 以來,Meta 就在開源領域大放異彩。

ImageBind:Meta 最新的多模態嵌入,不僅涵蓋了常規數據類型(文本、圖像、音頻),還包括深度、熱量(紅外)和 IMU 信號!

OpenAI Embedding 是 AI 驅動搜索和長期記憶的基礎。ImageBind 是 Meta 的 Embedding API,用于豐富的多媒體搜索、虛擬現實甚至機器人技術。元宇宙將建立在向量的基礎上。

通過對齊 6 種模態,你可以實現一些僅靠文本的 GPT-4 無法實現的花式功能:

跨模態檢索:將其視為多媒體谷歌搜索

嵌入空間算術:無縫地組合不同的數據格式。

生成:通過擴散將任何模態映射到其他任何模態。

當然,這種通用的多模態嵌入在性能上優于領域特定的特征。

ImageBind:將它們全部綁定到一個嵌入空間。

也有網友評價道,「這項創新為增強搜索、沉浸式 VR 體驗和高級機器人技術鋪平了道路。對于 AI 愛好者和專業人士來說,激動人心的時刻即將到來!」。

不過,對于 Meta 采取開源的做法,也有人提出了質疑。

據 The Verge 報道,那些反對開源的人,如 OpenAI,表示這種做法對創作者有害,因為競爭對手可以復制他們的作品,并且可能具有潛在的危險,允許惡意行為者利用最先進的人工智能模型。

與之形成對比的是,支持開源的人則認為,像 Meta 開源 ImageBind 的做法有利于生態的快速建立與發展,也能集結全球的力量,幫助 AI 模型快速迭代和捕捉 Bug。

早些時候,Meta開源的LLaMA 模型只能用于研究用途,但是期間LLaMA 模型在 4chan 上被泄露,有匿名用戶通過 BT 種子公開了 LLaMA-65B—— 有650 億個參數的 LLaMA,容量為 220GB。

隨著 LLaMA “被公開”,一大批基于這款大模型的衍生品,號稱是 ChatGPT 開源替代品的工具在短時間內快速涌現,如跟著LLaMA(美洲駝)名字走的“駝類”家族包含了:斯坦福大學發布的Alpaca(羊駝,https://github.com/tatsu-lab/stanford_alpaca),伯克利、卡內基梅隆大學等高校研究人員開源的Vicuna(駱馬),還有基于 LLaMA 7B 的多語言指令跟隨語言模型 Guanaco(原駝,https://guanaco-model.github.io/)等等。

面對這股新興的力量,近日,在一位谷歌內部的研究人員泄露的一份文件中顯示,在大模型時代,「Google 沒有護城河,OpenAI 也沒有」。其主要原因就是第三股——開源大模型的力量與生態正在崛起。

所以,OpenAI 和 Google 兩家在 AI 大模型上你追我趕的競爭中,誰能笑到最后,也未必就不會是 Meta,我們也將拭目以待。對此,你是否看好開源大模型的發展?

審核編輯 :李倩

-

開源

+關注

關注

3文章

3391瀏覽量

42623 -

模型

+關注

關注

1文章

3286瀏覽量

49009 -

Meta

+關注

關注

0文章

277瀏覽量

11414

原文標題:Meta 開源 ImageBind 新模型,超越 GPT-4,對齊文本、音頻等 6 種模態!

文章出處:【微信號:AI科技大本營,微信公眾號:AI科技大本營】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Meta發布多模態LLAMA 3.2人工智能模型

OpenAI推出新模型CriticGPT,用GPT-4自我糾錯

國內直聯使用ChatGPT 4.0 API Key使用和多模態GPT4o API調用開發教程!

Meta開源ImageBind新模型,超越GPT-4,對齊文本、音頻等6種模態!

Meta開源ImageBind新模型,超越GPT-4,對齊文本、音頻等6種模態!

評論