在高階智能駕駛不斷上車的今天,行泊一體已經成為了汽車行業的量產共識,如何在實現極致性能體驗的同時,進一步降低硬件成本,并且大幅提升開發部署的效率,是行泊一體加速落地的關鍵。

傳統的行泊一體方案,行泊功能一般來自兩套系統,芯片、傳感器各為陣營,不僅性能受限,也帶來了多余的硬件成本。面向當下和未來,行泊一體顯然需要更加「現代化」的深度融合:傳感器深度復用,芯片資源完全共享,并通過強大的軟件算法實現功能的整合升級。而這,也對底層的技術架構提出了更高要求。

這套架構既要能夠支持行車、泊車的各種傳感器,基于單顆SOC為主的域控制器打造功能完整的行泊一體應用,還要提供豐富多樣的算法選擇,滿足不同算力和算子情況下的各種行車、泊車任務要求,最好還能實現充分的技術共用和模塊復用,讓所有方案的開發、部署和升級變得高效便捷。

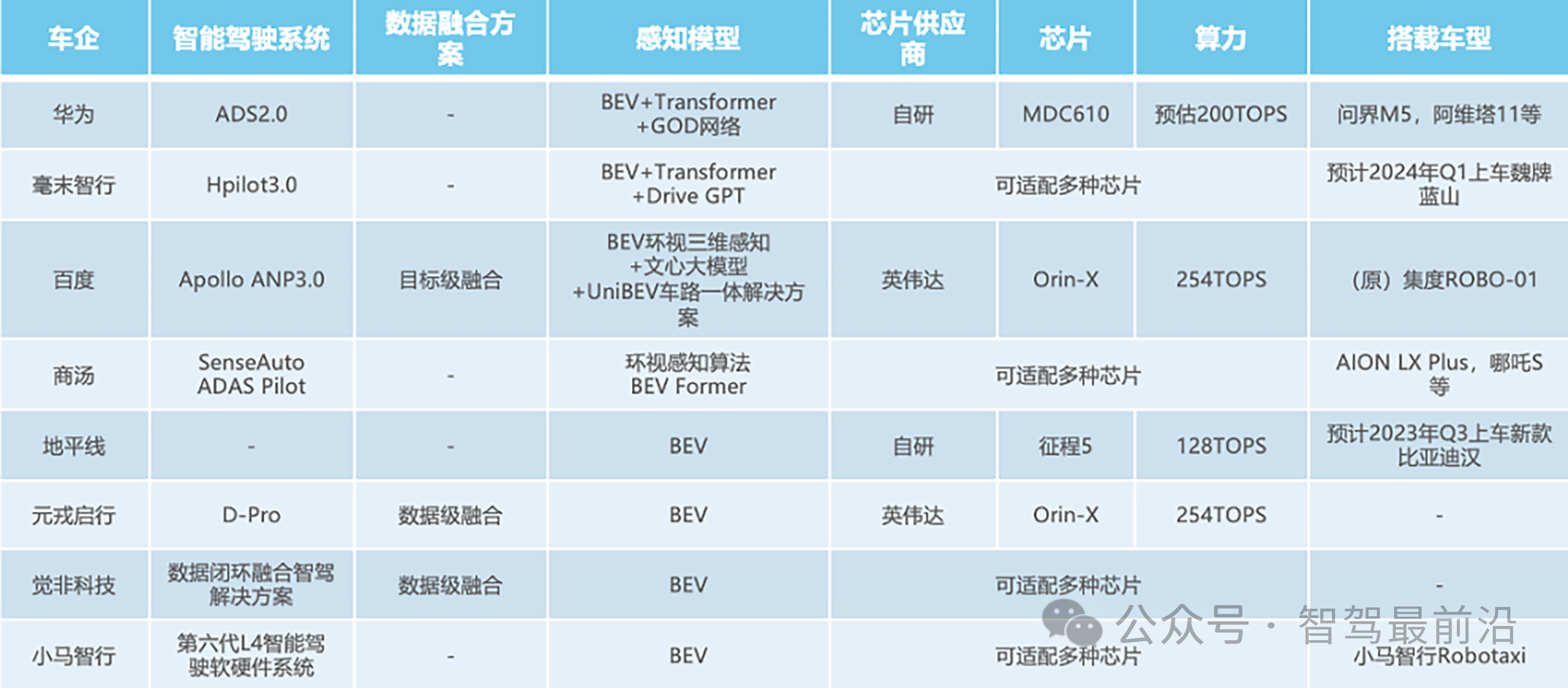

為此,Nullmax打造了這樣一套強大的平臺化BEV-AI整體技術架構,為「現代化」的全場景行泊一體應用提供至關重要的技術支撐,推動高階智駕加速走向普及。

自動駕駛「新基建」

在智能駕駛時代,汽車最明顯的標志是硬件的變化,更高算力的芯片、更多數量的傳感器,通常意味著更大的智能化潛力。這些硬件如同自動駕駛功能的基礎設施,而用來驅動這些硬件高效協同并提供豐富功能的BEV-AI技術架構,就是自動駕駛的「新基建」工程。

對于自動駕駛來說,感知是整個系統的最上游,當傳感器的類型和數量顯著增加時,如何融合所有傳感器持續輸入的多模態、不同視角數據,并實時輸出下游所需的一系列任務結果,是自動駕駛的核心問題。并且在應用中,感知環節常常會消耗掉車上的大部份算力,所以感知其實也是技術架構的核心所在。

在感知環節,系統需要融合不同視角相機的視覺數據,以及毫米波雷達、激光雷達等傳感器的數據,在模型設計和工程實現上都具有很大挑戰。常規的后融合處理方式,每個傳感器對應一個神經網絡,無法充分挖掘多傳感器融合的優勢,而且計算量大、耗時長。此外,如果多個任務簡單地共享一個主干網絡,則容易出現各個任務難以同時獲得優異性能的情況。

所以在2020年,Nullmax構建了基于BEV的感知基礎架構,為自動駕駛提供融合更準、速度更快的感知模型。它可以有效融合空間和時序信息,對360度的多傳感器數據進行高效融合,也能自動搜尋最優的網絡設計,支持多傳感器、多任務的協同工作。

并且在2022年,Nullmax應用BEV-Transformer完成了這套架構的改造升級,形成了平臺化的BEV-AI自動駕駛整體技術架構。它在技術底層考慮行車、泊車的特點,將任務范圍從感知延伸到下游的規劃,提供全場景、端到端、可成長的完整應用。

在深入使用Transformer基礎上,Nullmax BEV-AI技術架構還整合了大量BEV-CNN的成果,能在面向不同算力、算子的多核異構SOC時能夠提供最優的算法選擇。它可同時輸出3D和2D的感知結果,既能為紅綠燈檢測等適合2D感知的任務提供2D輸出,也可以為動態障礙物檢測等任務輸出3D結果,然后用進行2D校驗,在系統層面形成魯棒的設計。

基于這套先進的BEV-AI整體技術架構,Nullmax可以快速完成各項功能和任務的開發,并形成一套性能拔尖、易于部署、持續升級的一體化量產方案。

面面俱到的完整BEV架構

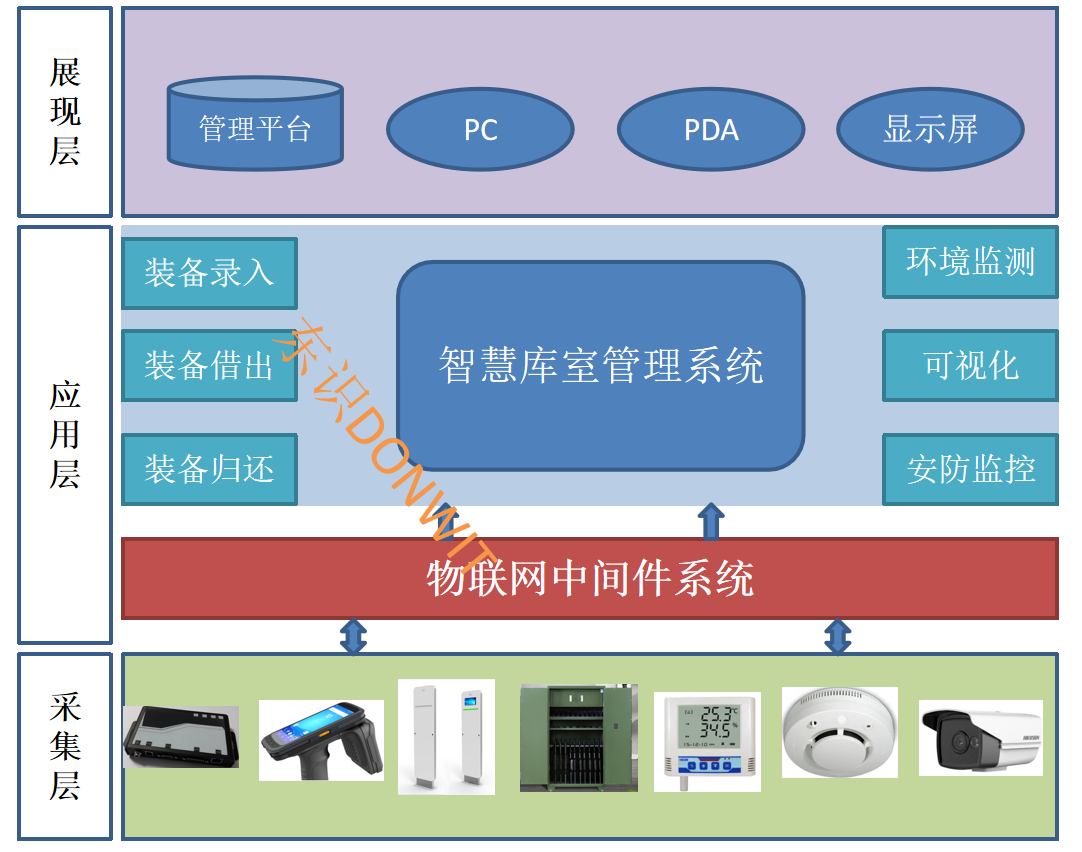

為了滿足自動駕駛全鏈的開發迭代需求,Nullmax的BEV-AI架構涵蓋了六個方面的主要內容:BEV 3D車道線檢測,BEV 3D目標檢測,BEV局部地圖,BEV規劃,云端自動化4D真值標注,車端感知、預測、規劃的量產部署。 復雜路口的BEV 3D目標檢測 BEV 3D目標檢測為自動駕駛提供360°的動態障礙物檢測能力,并融合時序信息對各類目標進行準確預測。BEV 3D車道線檢測為車輛輸出實時的車道情況,BEV局部地圖在車端實時構建媲美高精地圖的高精度局部地圖,二者能夠在任意常規道路條件下,輸出自動駕駛所需的靜態場景深刻理解。然后以此為基礎,BEV規劃可以用端到端方式輸出行車的軌跡和速度,實現復雜場景下的自動駕駛應用,而不依賴高精地圖。 路口場景的BEV規劃

云端的自動化4D真值標注,用來完成3D空間信息+時間信息的3D bunding-box真值標注,以及車道線、Local Map等方面的標注,支持BEV-AI的高效開發和迭代。最終,Nullmax BEV-AI整體架構根據實際需求,形成能在車端實時運行、易于部署的感知、預測、規劃一系列量產應用。

為了讓這套BEV-AI技術架構具備平臺化特點,滿足實際應用中的不同量產需求,Nullmax還攻克了三個方面的難點。一是融合多個攝像頭數據的同時,不進行單個攝像頭的獨自處理和多個攝像頭結果的復雜后處理,以節省算力、提升融合效果;二是在算法層面實現圖像空間到BEV空間的信息轉換;三是支持任意攝像頭,且不過度依賴相機的外參,從而適配所有傳感配置。

簡單來說,Nullmax的BEV-AI,采取多相機聯合工作方式,輸入任意數量相機的圖像,直接統一輸出BEV視角下的三維信息,因而無需為每個相機進行單獨的處理。同時,Nullmax利用cross-attention機制實現2D圖像到3D空間的關聯,為BEV-AI架構打造了一系列基于Transformer的BEV檢測、分割方法,并通過multi-camera cross attention等方式,實現了不過度依賴相機參數的2D和3D關聯。

歸功于這些深入的工作,Nullmax的BEV-AI技術架構為行泊一體等量產應用帶來了巨大的平臺化優勢和產品優勢。

大幅提升的BEV量產優勢

在實際應用中,芯片平臺、傳感器配置、功能定義、技術指標的細微差異,都可能會為自動駕駛的開發工作帶來巨大變動,尤其是復雜的行泊一體量產應用。因此通過平臺化的技術架構提升量產效率,意義重大。

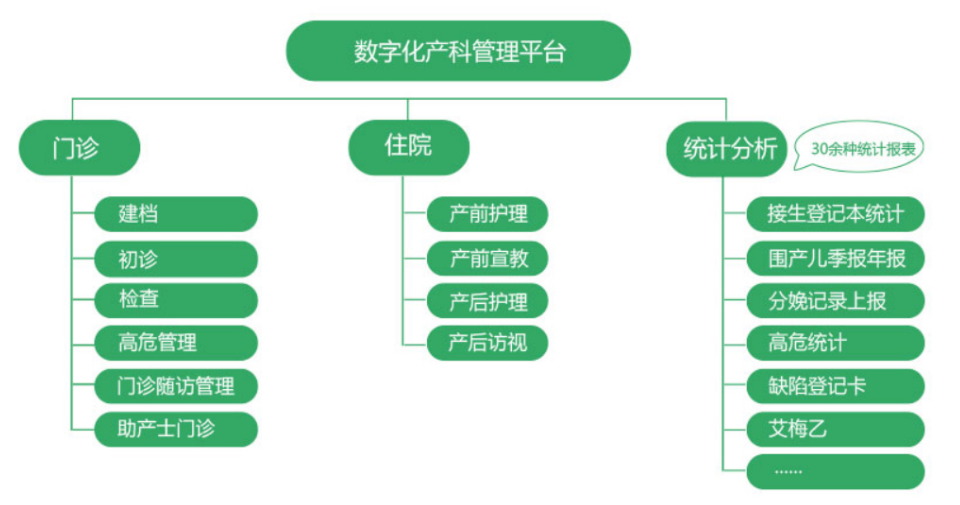

Nullmax BEV-AI架構能夠支持所有的芯片平臺,提供高中低不同算力平臺下的行泊一體量產應用。尤其是在備受歡迎的德州儀器TDA4、英偉達Orin芯片上,基于BEV-AI技術架構的行泊一體方案,有的已經完成交付,有的正在交付。

在最低8T算力的情況下,BEV-AI就可以實現包括高速NOA在內的基礎行泊一體,如果算力達到16T,那么行泊車體驗還會進一步升級。當算力達到100T以上,那么BEV-AI架構可以提供城市道路的領航輔助功能,實現全場景的行泊一體。

同時,Nullmax BEV-AI架構還能夠支持所有的自動駕駛產品。無論是完整的行泊一體,還是單獨的行車、泊車功能,又或者是上游的行泊車感知,BEV-AI架構能夠按需裁剪,適配任務需求,并且可以支持任意的傳感器配置。

夜間基于8T算力和4顆側視相機的BEV周視感知

通常來說,不同的車輛在傳感器的類型、數量和參數上會存在普遍差異,比如相機的焦距、像素、FOV、安裝位置、朝向等情況就各不相同。Nullmax的BEV-AI架構可以適配這些傳感器層面的差異,無需大幅修改算法,即可提供應用。

除此之外,Nullmax BEV-AI架構還具有平臺產品化的特點,讓架構平臺的技術優勢形成了面向部署優化、超遠距離感知的產品優點。這讓基于BEV-AI架構的量產方案,在部署時能能取得更好的應用體驗,并在資源占用、感知幀率、系統延時等關鍵指標上表現更佳,尤其是面對中低算力芯片平臺的時候。

而且更遠距離的感知,也能為自動駕駛提供更高的安全性。相比于業內BEV方案通常數十米遠的感知距離,Nullmax BEV-AI架構可以輕松實現更遠距離的有效感知,滿足量產功能的所有性能指標。

正是憑借BEV-AI架構在平臺化和產品化方面帶來的這些優勢,Nullmax不僅快速完成了各種量產應用的高質量開發和交付,并且方案整體達到了行業領先的技術水準。

結語

在汽車向著高階智駕發展的過程中,先進的技術架構將為自動駕駛的落地帶來全方位的優勢,不論是量產方案的本身還是技術應用的過程,都不例外。Nullmax BEV-AI架構將繼續作為行泊一體「現代化」路上的「新基建」,加速全場景自動駕駛應用的落地。

-

傳感器

+關注

關注

2550文章

51035瀏覽量

753084 -

硬件

+關注

關注

11文章

3312瀏覽量

66201 -

AI

+關注

關注

87文章

30728瀏覽量

268892 -

LLM

+關注

關注

0文章

286瀏覽量

327

原文標題:Nullmax BEV-AI架構,加速行泊一體「現代化」 | Nullmax進化學

文章出處:【微信號:Nullmax,微信公眾號:Nullmax紐勱】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

Vector推出一套基于Visual Studio Code的免費插件

自動駕駛中一直說的BEV+Transformer到底是個啥?

黑芝麻智能與Nullmax達成重要合作里程碑

如何設計出一套用于移動式綜合監測站管理的軟件系統

RTX AI PC和工作站提供強大AI性能

saas模式的一套智慧工地云平臺源碼,支持多端展示:PC端、大屏端、手機端、平板端

Nullmax打造一套強大的平臺化BEV-AI整體技術架構

Nullmax打造一套強大的平臺化BEV-AI整體技術架構

評論