來源:信息安全與通信保密雜志社作者:Cismag

2022 年 11 月末,由美國 OpenAI 公司開發的聊天機器人 ChatGPT 橫空出世。這款生成式人工智能程序展現出接近于人類的表達與推理能力,一時間震驚全球。其活躍用戶數在短短兩個月內就突破一億,成為了有史以來用戶增長最快的應用程序。不過在各方不吝溢美之辭的同時,ChatGPT及同類產品也接連暴露出安全問題,引起了各國政府和企業的高度警覺,意大利政府甚至一度禁用 ChatGPT。從 ChatGPT 的驚艷表現來看,生成式人工智能很可能在不遠的將來滲透到各行各業,然而若不能有效管控其安全風險,則可能反而給人類社會帶來巨大災難。有鑒于此,本文將從信息安全的角度探討生成式人工智能的多種風險,以為其探索出一條更加安全的發展之路。

一、新興安全風險此起彼伏

1.1數據外流隱患日益凸顯

自 3 月 31 日起,意大利數據保護局以侵犯數據隱私為由,將 ChatGPT禁用了一個月之久。在意大利帶動下,美國、法國、德國、西班牙和歐盟等國家和組織也紛紛開始調查 ChatGPT 的數據外流問題。無獨有偶,為防止敏感數據外流,微軟、摩根大通、威瑞森、亞馬遜、沃爾瑪和三星等行業巨頭也相繼限制或禁止員工使用ChatGPT。根據網絡安全公司Cyberhaven的調查,至少有 4%的員工將企業敏感數據輸入 ChatGPT,且敏感數據占輸入內容的 11%。看似比例不高,但 Cyberhaven 的統計表明 0.9%的員工造成了 80%的數據外流事件,同時上億的用戶基數意味著 11%的輸入內容也仍然是個天文數字,可見 ChatGPT 引發的數據外流問題已不容小視。

海量的數據造就了 ChatGPT 等生成式人工智能,而為確保其回答符合人類預期,來自人類的反饋更是其中的重中之重。事實上,在意大利施加壓力前,OpenAI 公司一直默認將用戶輸入的內容用作訓練數據,導致大量敏感數據落入OpenAI公司之手。以亞馬遜公司為例,其之所以禁用ChatGPT,就是因為發現 ChatGPT 生成的內容與其保密數據高度相似,這顯然是有員工將保密數據輸入 ChatGPT 所致。即使 OpenAI 公司不會濫用用戶數據,第三方也完全可能以巧妙的提問方式繞開 ChatGPT 的過濾機制,進而獲取這些敏感數據。在多方壓力下,OpenAI 公司被迫于 4 月 25 日為 ChatGPT添加了“禁止用用戶數據訓練人工智能”的選項,不過將信息安全寄托于OpenAI 公司的“自律”并非明智之舉。何況從“棱鏡門”等事件來看,美國政府很可能會強迫 OpenAI 公司提供用戶數據。所以在各國出臺嚴格的數據使用法規和數據本地化要求之前,生成式人工智能始終都存在嚴重的數據外流風險。

1.2虛假信息推高決策風險

ChatGPT 面世不久后,許多用戶就發現其有時會言之鑿鑿地提供虛假信息,這使人們對其可靠性產生了懷疑。舉例來說,英國《衛報》稱有多個團隊向其求證某些文章,結果發現這些“《衛報》記者署名發表”的文章其實是由 ChatGPT 虛構的;一名澳大利亞市長發現 ChatGPT 生成了關于他的虛假犯罪指控,于是憤而向 OpenAI 公司提起誹謗訴訟;谷歌公司同樣深受其害,其人工智能聊天程序 Bard 在發布會上答錯一道簡單問題,導致公司股價大跌,市值瞬間蒸發近 1700 億美元。開發方對生成式人工智能的這一缺陷也心知肚明,OpenAI 的官方網站就明確承認 ChatGPT 有時會給出看似可信的錯誤回答。考慮到因信息不實而作出錯誤決策的風險,虛假信息或許是阻礙生成式人工智能大范圍商用的最大技術難題。

生成式人工智能之所以會提供虛假信息,除訓練數據本身有誤或已經過時外,更重要的原因是它們并非真能理解人類語言,也并不具備人類的推理能力。其對答如流的背后,實質上是通過海量訓練建立了字詞句之間的關聯概率模型,從而能根據用戶提問逐字計算出概率最高的表述方式。這一原理決定了生成式人工智能無法判斷信息對錯,自然也就難免提供虛假信息。為減少虛假信息,OpenAI 等開發方一直在通過“基于人類反饋的強化學習”(RLHF)等人工手段來完善過濾機制,其 GPT-4 的真實性評分據稱就比 GPT-3.5 高出 40%。然而用戶可能提出的問題無窮無盡,訓練數據也會隨時間推移而過時,因此現有的任何方法都無法徹底解決虛假信息問題。可想而知,若沒有人類把關,生成式人工智能將很難用于醫學和投資等眾多需要準確信息的領域。

1.3內容偏倚沖擊意識形態

如果說虛假信息還只是讓少數用戶失望,那么 ChatGPT 在生成內容上的傾向性或者說偏倚則已然激怒了不少用戶。早在 2 月間,就有用戶發現ChatGPT 可以贊美拜登,但不能贊美特朗普;而在美國炒作所謂“中國氣球”事件期間,中國用戶也發現 ChatGPT 支持美國擊落中方氣球,卻不支持中國擊落美方氣球。另有研究表明,ChatGPT 在政治、種族、性別和宗教等話題上普遍存在偏倚,而 15 項政治傾向測試的結果表明,ChatGPT 總體上傾向于所謂的“左翼自由派”觀點。這種內容上的偏倚自然激起了對立群體的憤怒,美國公司 TUSK 就因此推出了“右翼人工智能”GIPPR,以便向用戶宣傳保守派觀點。由此看來,未來很可能會出現立場各異的多種人工智能,從而加劇整個社會的對立情緒和政治極化。

生成式人工智能的內容偏倚來自于多方面的影響,包括訓練數據本身就存在某種傾向,使用的算法更側重于某些特征值,以及人類數據標注員的主觀判斷等等。雖然 ChatGPT 等人工智能都標榜中立,但既然人類社會本身都對很多問題存在分歧,立足于人類知識的人工智能也就必定存在傾向性,而這種傾向性則會對用戶的意識形態產生潛移默化的影響。OpenAI等公司并未對內容偏倚問題坐視不理,通過不斷修正過濾機制,目前ChatGPT 在大多數時候都拒絕回答敏感話題,至少是拒絕批評特定對象。然而需要注意的是,這些修正措施主要針對在歐美引發爭議的話題,其它許多意識形態則不在“保護”之列。從這個角度看,ChatGPT、Bard 和 BingChat 等生成式人工智能客觀上已成為了美國的認知戰工具。

二、傳統安全風險依舊嚴峻

2.1系統安全漏洞不容忽視

3 月 20 日,一些 ChatGPT Plus 用戶驚訝地發現其用戶界面上出現了其他用戶的敏感信息,其中包括聊天記錄、姓名、電子郵箱和支付地址等。此次事件導致 OpenAI 公司一度緊急關閉 ChatGPT,經過調查,OpenAI 發現是其客戶端開源庫 redis-py 出現問題,以致部分用戶的請求被錯誤地返回給其他用戶。盡管 OpenAI 聲稱此次事件僅涉及1.2%的 ChatGPT Plus 用戶,但考慮到 ChatGPT 的龐大用戶群,涉事用戶恐怕不在少數。此外也有研究人員發現 ChatGPT 存在嚴重的 Web 緩存欺騙漏洞,黑客可利用該漏洞竊取其他用戶的 ChatGPT 帳戶。網絡安全公司 Check Point Research 還發現了更加危險的情形:有黑客修改了 Web 測試套件 SilverBullet 的配置,使其能對ChatGPT 帳戶進行撞庫攻擊或暴力破解,從而大規模竊取 ChatGPT 帳戶。

雖然生成式人工智能對大多數人來說屬于新鮮事物,但其采用的仍是傳統的安全架構和防御措施,所以和其它任何 IT 系統一樣,人工智能也難免存在安全漏洞。從這層意義上講,不論 OpenAI 等開發方如何減輕虛假信息等人工智能特有的安全風險,一旦黑客利用某些軟硬件漏洞入侵系統,人工智能的安全就無從談起。值得警惕的是,不同于公開的社交平臺,生成式人工智能很可能會收集到大量高度敏感的隱私信息乃至保密信息,因此其被入侵的后果恐怕不亞于關鍵基礎設施遭到入侵。OpenAI 公司已注意到此類問題,并為此制定了最高獎勵 2 萬美元的“漏洞懸賞計劃”,希望借助第三方的力量消除安全漏洞。但與此同時,媒體也在暗網上發現大批俄羅斯黑客開始討論如何入侵 ChatGPT。可見作為近年來最熱門的網絡服務,生成式人工智能恐將長期面臨嚴峻的網絡攻擊風險。

2.2助推社會工程學攻擊浪潮

3 月 27 日,歐洲刑警組織發布《大型語言模型對執法的影響》報告,其中強調了犯罪分子利用生成式人工智能發動社會工程學攻擊的風險。歐洲刑警組織的這一論斷并非虛言,早在今年 2 月,印度警方就發現有犯罪團伙使用 ChatGPT 來撰寫用于詐騙的電子郵件和短信;4 月,中國警方發現詐騙分子利用人工智能實時替換視頻聊天中的容貌和聲音,導致受害者被騙取 430 萬元。當前人工智能生成的內容與人工內容時常難以區分,因此很難統計究竟有多少社會工程學攻擊使用了人工智能。但根據網絡安全公司 Darktrace 的調查,在 ChatGPT 熱度持續攀升的 2023 年 1 月至 2 月間,欺騙方式遠比過去復雜的“新型社會工程學攻擊”數量猛增 135%,從側面反映出 ChatGPT 很可能已被廣泛用于社會工程學攻擊。

生成式人工智能的最大特點就是其生成內容高度接近于人類,加之遠超人類的生成效率,被犯罪分子用來發動社會工程學攻擊完全是意料之中,甚至不如說是一種必然趨勢。以往用戶還能根據語法和常識錯誤來辨別釣魚郵件,如今生成式人工智能不但能生成真假難辨的欺騙性文本,甚至還能根據用戶的詢問和身份作出針對性回復,從而大大提升犯罪“效率”。更令人擔憂的是,人工智能的生成內容已不局限于文本,5 月間就有人生成了能翻唱歌曲的孫燕姿虛擬形象,其真實程度令孫燕姿本人都深感震驚。正如前述案件所揭示的那樣,一旦犯罪分子拿到了目標人員的大量音視頻資料,就能訓練出足以以假亂真的虛擬形象,然后用于詐騙或傳播惡意信息。不幸的是,目前沒有特別有效的方法來應對基于人工智能的社會工程學攻擊,所以不難想象,在生成式人工智能的助推下,全球很可能會掀起新一波社會工程學攻擊浪潮。

2.3淪為惡意軟件開發工具

除提供信息外,生成式人工智能還具備一定的編程能力,因此《大型語言模型對執法的影響》也提到了用人工智能開發惡意軟件的風險。目前尚無跡象表明有任何知名惡意軟件出自人工智能之手,但不少研究都證實ChatGPT 確實能夠編寫惡意軟件。以 Check Point Research 公司于 2022 年12 月開展的研究為例,研究人員僅憑 ChatGPT 和 OpenAI 公司的另一款人工智能編程工具 Codex,就成功生成了一封可植入反向 shell 型惡意軟件的網絡釣魚郵件。該研究的最大意義,就在于研究人員從頭到尾都沒有編寫任何代碼,只是單純用自然語言向人工智能提出編程和修改需求,便完成了整個工作。許多類似的研究也表明,人工智能雖難以編寫出隱蔽、對抗和反調試等高級功能,但其生成的惡意軟件的確可以運行。

OpenAI 等開發方當然考慮到了生成式人工智能被用來開發惡意軟件的可能性,所以在目前的過濾機制下,ChatGPT 會直接拒絕“編寫某某惡意軟件”一類的要求。問題是程序本身并無好壞之分,比如加密程序雖被用于勒索軟件,但也可用于合法保護數據,所以 ChatGPT 不會拒絕編寫此類程序。這樣一來,黑客便可將惡意軟件的編程過程分解為若干步,然后逐步要求 ChatGPT 編寫相應功能。用人工智能開發惡意軟件的研究基本都采取了這種變通方式,只是有時仍需以巧妙的措辭來“說服”人工智能某些程序是安全的。不過從這些研究來看,用戶自身仍必須懂得編寫惡意軟件,否則根本無法有效引導人工智能,這意味著缺乏相關知識的用戶仍難以開發惡意軟件。此外與人工智能生成的簡陋程序相比,暗網上出售的惡意軟件要復雜和成熟得多,所以專業黑客也不會費神繞開過濾機制去開發這些“破爛”。總而言之,生成式人工智能雖確能編寫惡意軟件,但尚不足以大幅強化惡意軟件的開發能力。

三、啟示與建議

3.1建立張弛有度的監管機制

隨著生成式人工智能的負面影響逐漸浮出水面,各國均意識到制訂相應的監管法規已刻不容緩,為此紛紛啟動了立法進程。與其它國家相比,中國的步伐明顯更快,尤其是國家互聯網信息辦公室于 4 月 11 日發布《生成式人工智能服務管理辦法(征求意見稿)》(以下簡稱“《辦法》”),使中國成為第一個針對生成式人工智能立法的國家。《辦法》涉及到資格準入、算法設計、訓練數據、內容導向、用戶隱私和知識產權等諸多方面,其既開宗明義地支持生成式人工智能的健康發展,也高度重視相關風險,反映了中國政府對生成式人工智能的深刻洞見。除中國外,歐盟的內部市場與公民自由委員會也于 5 月 11 日推出《人工智能法案》草案,而美國參議院據稱同樣在制訂相關監管法規。

上述監管法規是規范還是扼殺生成式人工智能的發展,關鍵將取決于監管機制是否張弛有度。舉例來說,雖然各國皆規定不得生成虛假信息,但從生成式人工智能的原理來看,徹底杜絕虛假信息并不現實。因此相關法規雖應要求開發方盡量避免生成虛假信息,但也不宜做出過于嚴苛的規定,而是應把重點放在及時處理所發現的問題上(比如更正或刪除虛假信息,甚至重新訓練人工智能模型等),并對故意傳播虛假信息的人員進行追責。相反,由于數據安全是國家安全的重要一環,而為了方便工作,難免有用戶將敏感數據上傳至人工智能,因此監管法規應在數據本地化方面作出嚴格規定,以免因數據外流而危及國家安全。至于用戶隱私和數據標注等其它方面,也不宜一刀切,而是應根據人工智能的特點作出適當安排。此外作為一種新生事物,生成式人工智能的監管過程中很可能會出現意料之外的問題,所以其監管機制也應為及時調整監管措施留出余地。

3.2以技術手段鞏固信息安全

雖然監管機制不可或缺,但從生成式人工智能模型及其用戶群的龐大體量來看,人工手段更適合事后解決特定問題,技術手段才是從整體上確保信息安全的關鍵所在。具體而言,為保障系統安全,應像關鍵信息基礎設施那樣,為生成式人工智能系統建立由防火墻、入侵檢測與防范系統、加密信道以及端點檢測與響應工具等組件構成的網絡防御體系,并及時為各類子系統更新安全補丁;為保護個人隱私,開發方應盡可能采用可自動標注的合成數據來訓練人工智能模型,以減少因抓取網絡數據而泄露他人隱私的可能性;為阻止數據外流,生成式人工智能應為用戶提供不吸收用戶數據的隱私模式,并按照數據本地化要求,將用戶信息留存于所在國境內;為提升響應效率,開發方乃至政府有關部門應在互聯網上建立公共上報系統,以供用戶和開發方及時上報各類問題。

除上述風險外,生成式人工智能的最大信息安全風險,恐怕還是用戶惡意使用其生成的內容。舉例來說,用戶可將生成內容用于網絡釣魚和電信詐騙,利用刻意引導的生成內容傳播不良思想,甚至直接用人工智能控制大量網絡帳戶來發動認知戰。好在除加強監管外,數字水印和內容檢測器這兩項技術也能在一定程度上減輕這些風險。目前基于生成式人工智能的圖像生成器 Stable Diffusion 已能利用圖像分解算法添加隱形水印,從而檢測出由其生成的圖像。然而由于文本中的信息遠比圖像單純,用戶很容易察覺插入文本的水印并將之刪除,所以尚無適用于 ChatGPT 的數字水印。內容檢測器則更加成熟,目前市面上至少有十余款產品,其中的佼佼者Turnitin 更是號稱準確率達到 98%。這些檢測器普遍采用了語言統計學方法來分析文本,因此文本越長,檢測效果越好。不過也有許多用戶發現包括Turnitin 在內的檢測器時不時會發生誤判,所以用戶需謹慎對待檢測結果,尤其不宜將其作為考試等重要事項的唯一評判依據。

3.3警惕中長期地緣政治威脅

就信息安全而言,除數據外流等直接風險外,美國的生成式人工智能還將在中長期內對各國構成地緣政治威脅。首當其中的一點就是美國基本支配著生成式人工智能的整個產業鏈,其不僅利用先發優勢暫時壟斷了這一龐大市場,還直接或間接掌控著英偉達和聯發科等關鍵芯片生產商。以目前最適用于生成式人工智能的 A100 芯片為例,僅微軟和谷歌公司就分別擁有數萬枚該型芯片,而中國最多只有一家機構擁有 1 萬枚以上的 A100 芯片。所以盡管中國的生成式人工智能發展迅猛,但受制于美方制裁,今后仍可能出現會后勁不足的局面,其它國家的人工智能發展之路則更加艱險。對于這一問題,除了設法開辟間接采購渠道以規避制裁外,還可通過政策鼓勵國內廠商用性能較弱、但尚可購買或制造的其它芯片來發展生成式人工智能,以犧牲一定性能為代價,優先確保國內的人工智能生態體系不會受制于美國。

此外作為認知戰的個中高手,從長期來看,美國必然將生成式人工智能這一“利器”投入認知戰。由于 ChatGPT 等產品存在嚴格的過濾機制,美國不會直接使用這些產品,而是多半會利用 OpenAI 等公司的技術來訓練專用的人工智能,然后用這些不受限制的認知戰人工智能來操縱輿論。認知戰的主戰場通常是主流社交平臺,全球首富馬斯克就曾懷疑“推特”的數億用戶中有 20%都是機器人。如此巨量的賬號一旦被生成式人工智能掌管,就能在極短時間內發布大量煽動性內容,從而顯著影響輿論風向。為防范這一風險,各國不但應要求各社交平臺實現數據本地化和實名制注冊,還應對其進行大數據分析,從中篩選出認知戰特征明顯的用戶群,比如注冊時間高度接近,IP 屬地頻頻變動,月均活躍程度明顯超出正常水平,經常在很短時間內群起對特定政治或社會問題(尤其是長期乏人問津的陳舊問題)發表背離主流輿論的意見,表達內容高度一致,頻密地相互點贊,幾乎不與人爭辯,以及在不同話題下展現出相互矛盾的身份信息等。只要能及時清除這些特征高度集中的認知戰帳戶,并禁止相關手機號頻繁重新注冊,再強大的人工智能也將失去用武之地。

-

人工智能

+關注

關注

1791文章

47350瀏覽量

238754 -

OpenAI

+關注

關注

9文章

1096瀏覽量

6556 -

ChatGPT

+關注

關注

29文章

1563瀏覽量

7758

原文標題:ChatGPT 等生成式人工智能的信息安全風險

文章出處:【微信號:AI智勝未來,微信公眾號:AI智勝未來】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

ChatGPT 與人工智能的未來發展

生成式人工智能的概念_生成式人工智能主要應用場景

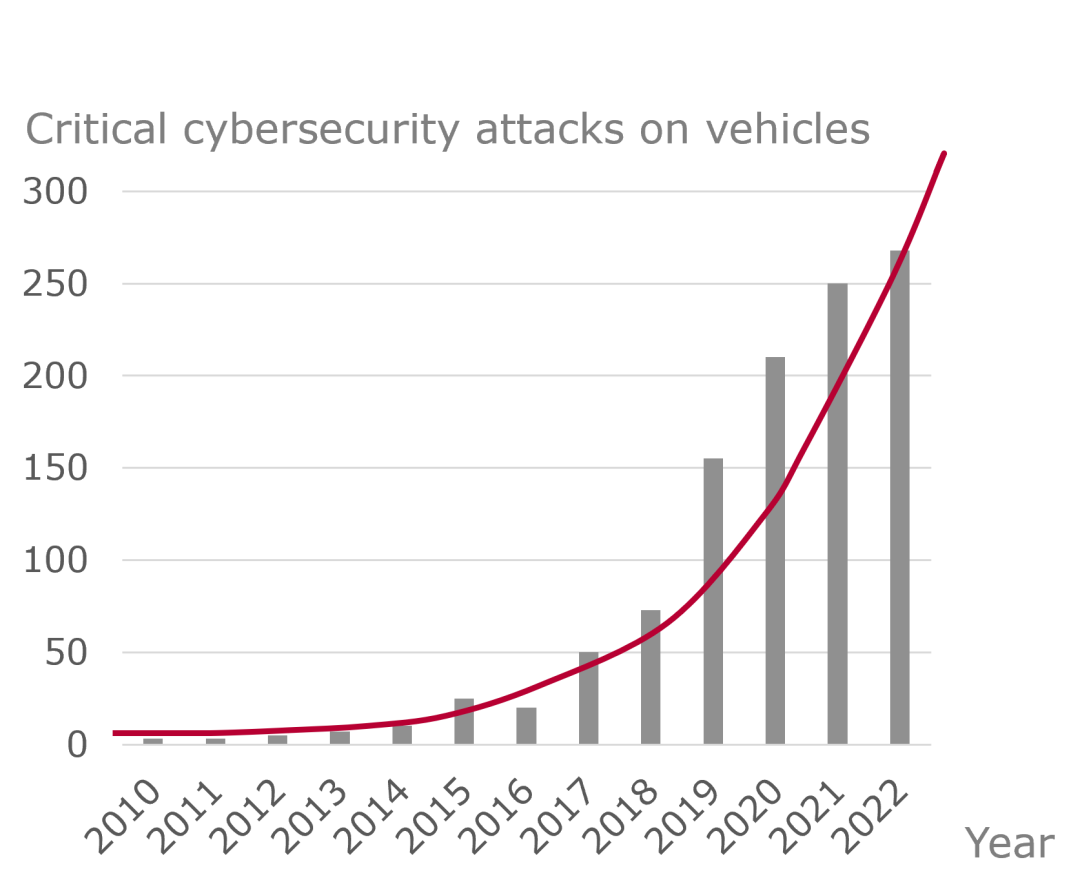

面向汽車網絡安全的生成式人工智能

簡述ChatGPT等生成式人工智能的信息安全風險

簡述ChatGPT等生成式人工智能的信息安全風險

評論