導語:洗禮者是天真的理想主義者,走私者是憤世嫉俗的操作者,但走私者會獲得勝利。

人工智能時代已經到來,人們對此感到驚訝不已。

幸運的是,我在這里給大家帶來好消息:人工智能不會毀滅世界,事實上它可能拯救世界。

首先,簡要介紹一下人工智能是什么:它是將數學和軟件代碼應用于教會計算機以類似于人類的方式理解、綜合和生成知識的技術。人工智能就像任何其他計算機程序一樣——它運行、接收輸入、處理數據并生成輸出。人工智能的輸出在許多領域都非常有用,包括編程、醫學、法律和創意藝術。它是由人擁有和控制的,就像任何其他技術一樣。

關于人工智能的簡短描述:它不是會突然活過來并決定殺害人類或毀滅一切的殺人軟件和機器人,就像電影中所展現的那樣。

更為簡短的描述:人工智能是一種能夠讓我們關心的一切變得更好的方式。

為什么人工智能可以讓我們關心的一切變得更好

社會科學在許多十年和成千上萬的研究中得出的最為驗證的核心結論是,人類智能可以在生活的各個方面取得更好的結果。更聰明的人在幾乎所有活動領域都能取得更好的成就:學術成就、工作表現、職業地位、收入、創造力、身體健康、壽命、學習新技能、處理復雜任務、領導能力、創業成功、沖突解決、閱讀理解、金融決策、理解他人的觀點、創意藝術、育兒成果和生活滿意度。

此外,人類智能是我們幾千年來用來創造我們今天生活世界的杠桿:科學、技術、數學、物理學、化學、醫學、能源、建筑、交通、通信、藝術、音樂、文化、哲學、倫理學、道德。如果沒有在所有這些領域應用智能,我們仍然會住在泥屋中,過著勉強維持的農耕生活。相反,我們利用智能將我們的生活水平提高了約10,000倍,過去4000年間取得了巨大的進步。

人工智能為我們提供了深度增強人類智能的機會,可以使所有這些智能成果(以及從創造新藥物到解決氣候變化和太空技術的方式等其他領域)在這個基礎上變得更好得多。

人工智能對人類智能的增強已經開始了——人工智能已經以各種計算機控制系統的形式存在于我們周圍,如今通過像ChatGPT這樣的大規模語言模型迅速升級,并且如果我們允許的話,將會從這里迅速加速發展。

在我們的人工智能新時代中:

每個孩子將擁有一位無限耐心、無限同情、無限知識和無限幫助的人工智能導師。這位人工智能導師將在每個孩子成長的每個階段都與他們并肩而行,以機器版的無限愛幫助他們最大限度地發揮潛力。

每個人都將擁有一位無限耐心、無限同情、無限知識和無限幫助的人工智能助手/教練/導師/培訓師/顧問/心理治療師。這位人工智能助手將在人生的各個機遇和挑戰中一直陪伴,最大化每個人的成果。

每個科學家都將擁有一位能極大擴展他們科研和成就范圍的人工智能助手/合作者/伙伴。每個藝術家、工程師、商人、醫生、照料者都將在他們的領域中擁有同樣的助手。

每個CEO、政府官員、非營利組織主席、體育教練、教師——都將有同樣的機會。領導者在引導他們所領導的人方面做出更好決策的放大效應是巨大的,因此這種智能增強可能是最重要的。

經濟中的生產力增長將大幅加速,推動經濟增長、新產業的創造、新工作的創造和工資增長,從而帶來全球范圍內物質繁榮的新時代。

科學突破、新技術和新藥物將大幅擴展,因為人工智能幫助我們進一步解碼自然法則并利用它們為我們謀福利。

創意藝術將進入黃金時代,因為經過人工智能增強的藝術家、音樂家、作家和電影制作人能夠以比以往更快、更大規模地實現他們的愿景。

我甚至認為,當戰爭不可避免時,人工智能將改善戰爭,大大降低戰時死亡率。每場戰爭都以在極大壓力下、信息嚴重受限的情況下由非常有限的人類領導者做出的可怕決策為特征。現在,軍事指揮官和政治領導人將有人工智能顧問,將幫助他們做出更好的戰略和戰術決策,最大限度地減少風險、錯誤和不必要的流血犧牲。

簡而言之,人們今天所運用的自然智能,通過人工智能可以更好地實現,我們將能夠應對那些在沒有人工智能的情況下無法解決的新挑戰,從治愈所有疾病到實現星際旅行。

而且,這不僅僅涉及智能。人工智能最被低估的特質也許是它如何賦予人類更多人性。人工智能藝術使那些在技術技能上欠缺的人們擁有自由創作和分享他們的藝術思想。與富有同情心的人工智能朋友交談確實提高了人們應對逆境的能力。而且,與人類對應的醫療聊天機器人已經更加富有同理心。無限耐心和同情心的人工智能將使世界變得更加溫暖和友好,而不是讓世界變得更加冷酷和機械化。

這里的風險很高,機遇也非常深遠。人工智能很可能是我們文明創造的最重要、最好的事物,與電力和微芯片相媲美,甚至可能超越它們。

人工智能的發展和普及——遠非我們應該害怕的風險——是我們對自己、對我們的孩子和對我們未來的道義責任。

我們應該生活在一個借助人工智能變得更美好的世界,現在我們可以實現這一目標。

為什么會出現恐慌情緒?

與這種積極的觀點相反,目前關于人工智能的公眾討論充斥著歇斯底里的恐懼和偏執。

有人聲稱人工智能將以各種方式殺死我們所有人,毀壞我們的社會,奪走我們所有的工作,導致嚴重的不平等,并使壞人能夠做出可怕的事情。

為什么在人工智能的潛在結果中會出現這種從近乎烏托邦到可怕的反烏托邦的差異呢?

從歷史上看,每一項重要的新技術,無論是電燈照明、汽車、無線電還是互聯網,都引發了一場道德恐慌——一種社會傳染病,使人們相信新技術將摧毀世界、破壞社會,或兩者兼有。Pessimists Archive的研究人員在過去幾十年中記錄了這些與技術相關的道德恐慌;他們的歷史清晰地展現了這一模式。事實證明,當前的人工智能恐慌甚至不是第一次出現。

當然,許多新技術確實導致了不良結果——通常是那些在其他方面對我們福祉有巨大益處的技術。因此,并不是道德恐慌的存在意味著沒有什么值得關注的問題。

但是,道德恐慌本質上是非理性的——它將可能是合理關切的問題夸大到一種歇斯底里的程度,諷刺的是,這使得真正嚴重的問題更難以應對。

現在,我們對人工智能出現了一場全面的道德恐慌。

這種道德恐慌已經被各種行為者作為一種推動力量,要求政策行動——制定新的人工智能限制、監管和法律。這些行為者對人工智能的危險發表極具戲劇性的公開聲明,以此滋養和加劇道德恐慌,他們都把自己描繪成無私的公共利益捍衛者。

但他們真的是嗎?

他們的觀點是對還是錯?

AI的洗禮者和走私者

經濟學家觀察到這種改革運動中的一種長期模式。在這類運動中,參與者分為兩類——“洗禮者”和“走私者”——借鑒了上世紀20年代美國禁酒令的歷史例子:

“洗禮者”是真正的社會改革者,他們出于情感上的、而非理性上的原因,確實深切地認為需要制定新的限制、監管和法律來防止社會災難的發生。在禁酒令中,這些參與者通常是虔誠的基督徒,他們認為酒精正在破壞社會的道德結構。對于AI風險來說,這些參與者真心實意地認為人工智能存在一種或多種存在威脅——用測謊儀測,他們是認真的。

“走私者”是自私的機會主義者,他們將從新的限制、監管和法律中獲得經濟利益,使自己免受競爭的沖擊。在禁酒令中,這些人就是以非法方式向美國人銷售非法酒精而發了財的人。對于AI風險來說,這些人是CEO,如果建立起規范性障礙,形成一家由政府認可的人工智能供應商壟斷組織,可以保護它們免受新創業公司和開源競爭的沖擊,就像是“太大而不能倒”的銀行一樣。

憤世嫉俗者可能會提出,一些表面上是洗禮者的人也是走私者——特別是那些受到大學、智庫、活動團體和媒體機構支付薪水或獲得資助來宣揚人工智能恐慌的人。如果你得到薪水或獲得資助來宣揚人工智能恐慌...你很可能是一個走私者。

走私者的問題在于他們會獲得勝利。洗禮者是天真的理想主義者,走私者是憤世嫉俗的操作者,因此這類改革運動的結果通常是走私者得到他們想要的——監管壟斷、免受競爭的沖擊、壟斷組織的形成——而洗禮者則納悶著他們為了社會進步而努力的動力到底出了什么問題。

我們剛剛經歷了一個驚人的例子——2008年全球金融危機后的銀行改革。洗禮者告訴我們,我們需要新的法律和監管來打破“太大而不能倒”的銀行,以防止類似危機再次發生。于是,美國國會通過了2010年的《多德-弗蘭克法案》,宣傳稱滿足了洗禮者的目標,但實際上被走私者——大銀行所利用。結果是,2008年那些“太大而不能倒”的銀行現在變得更加龐大了。

因此,實際上,即使洗禮者是真誠的,即使洗禮者是正確的,他們也會被善于操縱和貪婪的走私者利用,以謀取自己的利益。

這正是當前推動人工智能監管的情況。

然而,僅僅識別參與者并質疑他們的動機是不夠的。我們應該對洗禮者和走私者的論點進行評估。

AI風險1:人工智能會殺死我們所有人嗎?

首個也是最早的人工智能厄運論風險是人工智能會決定實際上殺死人類。

對我們自己創造的技術將會崛起并摧毀我們的恐懼根深蒂固地融入到我們的文化中。古希臘人在普羅米修斯神話中表達了這種恐懼——普羅米修斯給人類帶來了毀滅性的火焰和更廣義的技術(“技藝”),而為此普羅米修斯被眾神永久折磨。后來,瑪麗·雪萊在她的小說《弗蘭肯斯坦》或《現代普羅米修斯》中給了我們現代人一個自己的版本,其中我們開發了永生的技術,然后這種技術升起并試圖摧毀我們。當然,任何關于人工智能的恐慌報道都不會完整,沒有詹姆斯·卡梅隆的《終結者》系列電影中一個閃亮紅眼睛的殺人機器人的靜止圖像。

這種神話的推測性進化目的是激勵我們認真考慮新技術的潛在風險——畢竟,火焰確實可以用來燒毀整個城市。但就像火焰也是現代文明的基石,用來使我們在寒冷和敵對的世界中保持溫暖和安全一樣,這種神話忽視了大多數新技術的更大潛力——也許是全部潛力?——并且實際上煽動了破壞性的情緒,而非理性分析。僅僅因為古代人會像這樣驚慌失措,并不意味著我們必須這樣做;我們可以應用理性。

我的觀點是,人工智能會決定實際上殺死人類的觀點是一個深刻的范疇錯誤。人工智能不是一個有著億萬年進化歷程、已經被激發參與適者生存競爭的生命體,就像動物和我們一樣。它只是數學——代碼——由人構建、由人擁有、由人使用、由人控制的計算機。它會在某個時刻發展出自己的思維,并決定有動機導致它試圖殺死我們的想法是一種迷信的觀點。

簡而言之,人工智能沒有欲望,它沒有目標,它不想殺死你,因為它不是活的。人工智能是一種機器,就像你的烤面包機一樣,不會比它更有生命。

顯然,有些人是對殺手人工智能深信不疑的人——洗禮者——他們因為恐怖的警告而突然獲得了極高的媒體關注,其中一些人聲稱已經研究這個主題數十年,并表示他們對所了解到的內容感到恐懼。其中一些真信徒甚至是這項技術的創新者。這些人主張對人工智能實施各種奇怪和極端的限制,從禁止人工智能的發展,一直到對數據中心進行軍事空襲和核戰爭。他們認為,由于像我這樣的人無法排除人工智能未來可能帶來的災難性后果,我們必須采取預防性的立場,可能需要大量的實際暴力和死亡來防止潛在的存在風險。

我的回應是,他們的立場是非科學的——有什么可以進行檢驗的假設?什么會證偽這個假設?我們如何知道什么時候進入了危險區域?除了“你不能證明它不會發生!”之外,這些問題基本上沒有得到回答。事實上,這些洗禮者的立場非常非科學和極端——是一種關于數學和代碼的陰謀論——而且已經呼吁實施實際暴力,所以我會做一些我通常不會做的事情,質疑他們的動機。

具體來說,我認為有三個方面的情況發生了變化:

首先,回想一下,約翰·馮·諾伊曼對羅伯特·奧本海默有關他參與制造核武器的憂慮做出了回應——這些核武器幫助結束了第二次世界大戰并阻止了第三次世界大戰——他說:“有些人承認罪行是為了聲稱自己的功勞。”有什么辦法可以以最引人注目的方式聲稱自己的工作的重要性,而不顯得過于自負呢?這解釋了那些實際上正在構建和資助人工智能的洗禮者言行不一致的現象——觀察他們的行動,而不是他們的言辭。(杜魯門在與奧本海默會面后說得更狠:“別讓那個哭鼻子再進來”)。

其次,一些洗禮者實際上是走私者。有一個專門的職業“人工智能安全專家”、“人工智能倫理學家”、“人工智能風險研究員”。他們是為了悲觀而受薪水的,他們的言論應該得到適當的處理。

第三, 加利福尼亞州因我們眾多的邪教而聞名,從培訓魂、人民寺廟,到天堂之門和曼森家族。盡管并非所有這些邪教都是有害的,甚至對于那些感到疏離的人來說,它們可能有助于找到一個歸屬感。但有些邪教確實非常危險,邪教通常很難在終將導致暴力和死亡的界限上取得平衡。

事實是,對于舊金山灣區的每個人來說顯而易見,但可能對其他地方的人來說并不明顯,"人工智能風險"已經發展成為一個邪教,并突然在全球媒體關注和公眾討論中浮出水面。這個邪教不僅吸引了一些邊緣人物,還吸引了一些真正的行業專家和相當數量的富有捐贈者,其中包括直到最近的山姆·班克曼-弗里德。它還發展出了一整套邪教行為和信仰。

正是由于這種邪教,才出現了一群聲音極端的人工智能風險悲觀者——并不是因為他們真的擁有某種秘密的知識,使得他們的極端主義變得合乎邏輯,而是因為他們自己把自己激動得瘋狂,真的是極端到極點。

事實證明,這種類型的邪教并不新鮮——在西方有著悠久的千禧年主義傳統,會產生啟示錄型邪教。人工智能風險邪教具有所有千禧年啟示錄型邪教的特征。以下是來自維基百科的內容,我加入了一些補充:

千禧主義是一種由一群人或運動(AI風險厭惡者)相信社會即將發生根本性轉變(AI的出現)的信念,隨后一切都將發生改變(AI烏托邦、反烏托邦或世界末日)。只有戲劇性的事件(AI禁令、對數據中心的空襲、對無監管AI的核打擊)被視為能夠改變世界(阻止AI),而這種變革預計將由一群虔誠而專注的人群帶來或幸存下來。在大多數千禧主義情景中,即將到來的災難或戰斗(AI啟示錄或其預防)將被一個新的、純凈的世界(AI禁令)所緊隨,信徒將會得到獎賞(或至少被承認一直正確)。

這種末日邪教的模式如此明顯,以至于我對更多的人沒有看到它感到驚訝。

別誤會,了解邪教是很有趣的,它們的書面材料常常富有創意和吸引力,它們的成員在晚宴和電視節目中也很引人入勝。但是,它們的極端信仰不應決定法律和社會的未來-顯然不應該。

AI風險2:人工智能會毀掉我們的社會嗎?

第二個廣為傳播的AI風險是AI會毀掉我們的社會,通過產生輸出結果,即使我們沒有被直接殺害,也會對人類造成深遠的傷害,使用這種末日論者的術語來說就是“有害”的。

簡而言之,如果殺人機器人不能殺死我們,仇恨言論和錯誤信息將會毀掉我們。

這是一個相對較新的末日論關注點,它分支出來并在一定程度上接管了我上面描述的“AI風險”運動。實際上,AI風險的術語最近從“AI安全”(由擔心AI會直接殺死我們的人使用)變為“AI對齊”(由擔心社會“傷害”的人使用)。最初關注AI安全的人對這種轉變感到沮喪,盡管他們不知道如何讓它回到原來的軌道-他們現在主張將實際的AI風險主題更名為“AI不會殺掉所有人主義”,盡管這種術語尚未被廣泛采用,但至少它是清楚的。

AI社會風險主張的特點就是它自己的術語:“AI對齊”。對齊什么?人類價值觀。哪些人類價值觀?啊,這就是問題的復雜之處。

碰巧的是,我親眼目睹了類似的情況-社交媒體的“信任與安全”戰爭。如今顯而易見,社交媒體服務多年來一直面臨來自政府和活動人士的巨大壓力,要求禁止、限制、審查和壓制各種內容。而“仇恨言論”(及其數學對應物“算法偏見”)和“錯誤信息”的相同擔憂直接從社交媒體背景轉移到了“AI對齊”的新領域。

我從社交媒體戰爭中獲得的主要教訓是:

一方面,不存在絕對的言論自由立場。首先,包括美國在內的每個國家至少都會將某些內容定為非法。其次,某些內容,比如兒童色情和煽動現實世界暴力的行為,幾乎被幾乎每個社會普遍認為是禁止的-不論是否合法。因此,任何促進或生成內容(言論)的技術平臺都將受到一定的限制。

另一方面,滑坡效應不是謬誤,而是不可避免的結果。一旦建立了限制甚至極其可怕內容的框架,例如針對仇恨言論、傷害性詞語或錯誤信息(如“教皇去世”這樣明顯的虛假陳述),將會有令人震驚的廣泛政府機構、活動人士壓力團體和非政府實體踏入行動,并要求對他們認為威脅社會和/或個人偏好的言論進行越來越多的審查和壓制,甚至采取公然犯罪的方式。實際上,這種循環似乎可以無限延續,得到整個精英權力結構中那些積極支持的權威主義監察員的支持。這在社交媒體上已經持續了十年,除了一些特例,情況越來越熱烈。

因此,這就是現在圍繞“AI對齊”形成的動態。其支持者聲稱擁有智慧來設計對社會有益的AI生成的言論和思想,并禁止對社會有害的AI生成的言論和思想。而其反對者則聲稱思想警察極其傲慢和專橫-而且在美國至少往往是徹底違法的,并實際上試圖成為一種新型的融合政府-企業-學術權威主義言論專政,直接從喬治·奧威爾的《1984》中摘取。

由于“信任與安全”和“AI對齊”的支持者都聚集在全球人口中非常狹窄的一部分中,這部分人正是美國沿海精英的代表,其中包括許多科技行業的從業人員和作家,我相信我的許多讀者會認為,為了避免摧毀社會,對AI輸出進行嚴格限制是必要的。我現在不打算說服你們改變這種觀點,我只是簡單地陳述這是需求的本質,而且世界上大多數人既不同意你們的意識形態,也不希望看到你們獲勝。

如果你不同意當前通過不斷加強的言論規范對社交媒體和AI強加的小眾道德觀,你應該意識到對AI允許說什么/生成什么的爭論將比對社交媒體審查的爭論更加重要-遠遠重要。AI極有可能成為世界上一切事物的控制層。它被允許如何運作可能比任何其他事情都更加重要。你應該意識到,一小撮孤立的黨派社會工程師正在試圖在他們聲稱為了保護你們的名義下,決定這一點。

簡而言之,不要讓思想警察壓制AI。

AI風險3:會奪走我們所有的工作嗎?

擔心因機械化、自動化、計算機化或AI而導致失業的恐懼已經持續數百年,自從機械織布機等機械裝置首次出現以來。盡管每一項重大新技術在歷史上都帶來了更多高薪工作,但每一波這種恐慌都伴隨著“這一次不同”的說法-這一次終于會發生,這一次的技術將給人類勞動力以致命一擊。然而,這從未發生過。

在最近的過去,我們經歷過兩次由技術驅動的失業恐慌周期-2000年代的外包恐慌和2010年代的自動化恐慌。盡管在這兩個十年里,許多評論家、專家甚至科技行業高管都大聲疾呼大規模失業即將來臨,但到2019年底-即COVID爆發前-世界上的工作崗位數量創歷史新高,薪資水平也達到了歷史最高水平。

然而,這個錯誤觀念卻不會消失。

果然,它又回來了。

這一次,我們終于有了一種將奪走所有工作,使人類工人變得多余的技術-真正的人工智能。這一次歷史不會重演,AI將導致大規模失業,而不是迅速的經濟、就業和工資增長,對嗎?

不,那是不可能發生的-事實上,如果允許人工智能在經濟中得以發展和普及,它可能會引發有史以來最引人注目和持續的經濟繁榮,相應地創造就業和工資增長的紀錄-正好與恐懼相反。原因如下。

自動化殺死工作的末日論者一直在犯的核心錯誤被稱為“勞動總量謬誤”。這種謬誤是錯誤的觀念,即在任何特定時期內,經濟中需要完成的勞動是固定的,要么由機器完成,要么由人類完成-如果由機器完成,就不會有工作可供人類去做。

勞動總量謬誤自然而然地源于天真的直覺,但在這里,天真的直覺是錯誤的。當技術應用于生產時,我們獲得了生產力增長-即通過減少投入而增加產出。其結果是商品和服務的價格下降。隨著商品和服務的價格下降,我們支付的費用也減少了,這意味著我們現在有額外的消費能力,可以購買其他東西。這增加了經濟中的需求,推動了新的生產-包括新產品和新行業-的創造,從而為以前被機器取代的人們創造了新的就業機會。結果是一個更大的經濟體,物質繁榮水平更高,行業更多,產品更多,就業機會也更多。

但好消息還不止于此。我們還會獲得更高的工資。這是因為,從個體工人的層面來看,市場根據工人的邊際生產力來確定報酬。與傳統企業相比,科技融入業務的工人將更具生產力。雇主要么會因為工人的生產力提高而支付更多的薪水,要么其他雇主會純粹出于自身利益而支付更多薪水。結果是,引入技術到一個行業通常不僅會增加該行業的就業機會,還會提高工資水平。

總結一下,技術使人們能夠更具生產力。這導致現有商品和服務的價格下降,工資上升。這進而導致經濟增長和就業增長,并激勵創造新的工作崗位和新的產業。如果市場經濟得以正常運作,如果技術得以自由引入,這將是一個永不停歇的持續向上循環。正如彌爾頓·弗里德曼所觀察到的,“人類的欲望和需求是無窮無盡的”-我們總是希望擁有更多。科技融入市場經濟是我們接近滿足每個人可能想要的一切,但永遠無法完全實現的方式。這就是為什么技術不會破壞就業,永遠也不會。

對于那些沒有接觸過這些思想的人來說,這些想法確實是令人震驚的,可能需要一些時間來理解。但我發誓我并不是編造它們-事實上,你可以在標準經濟學教材中找到關于它們的所有內容。我推薦你閱讀亨利·哈茲里特(Henry Hazlitt)的《經濟學一課》中的“機械的詛咒”一章,以及弗雷德里克·巴斯夏(Frederic Bastiat)關于蠟燭制造商向太陽提出請愿書的諷刺,因為太陽與照明行業存在不公平競爭,這里為我們現代化。

但你可能會想,這一次不同。這一次,隨著AI的出現,我們擁有了可以取代所有人類勞動力的技術。

但是,根據我上面描述的原理,想想如果所有現有的人類勞動力都被機器替代會意味著什么。

這意味著經濟生產率增長的起飛速度將是絕對天文數字,遠遠超過任何歷史先例。現有商品和服務的價格將全面下降,接近于零。消費者福利將飆升。消費者的購買力將飆升。經濟中的新需求將迅速爆發。企業家們將創造令人眼花繚亂的新行業、產品和服務,并盡快雇傭盡可能多的人工智能和人力來滿足所有新的需求。

假設AI再次取代了這種勞動力?這個循環將重復,推動消費者福利、經濟增長以及就業和工資增長更上層樓。這將是一個直線上升的螺旋,直達亞當·斯密和卡爾·馬克思從未敢于夢想的物質烏托邦。

我們應該感到如此幸運。

AI風險4:人工智能會導致嚴重的不平等嗎?

對于AI奪走工作的擔憂直接引出了下一個聲稱的AI風險:假設AI確實奪走了所有的工作,不論是出于好的還是壞的原因。那么,這難道不會導致巨大而嚴重的財富不平等嗎?AI的所有者獲得了所有的經濟回報,而普通人卻一無所得?

即生產資料的所有者-資產階級-將不可避免地從真正做工作的人-無產階級-那里竊取所有的社會財富。盡管這個觀點在現實中被多次證明為錯誤,但它是一個無論多少次都無法消失的謬誤。但讓我們還是從根本上否定它。

這一理論的缺陷在于,作為一種技術的所有者,將其保留給自己并不符合自身利益-事實上相反,將其賣給盡可能多的客戶才符合自身利益。任何產品的最大市場都是整個世界,也就是80億人口。因此,實際上,每一項新技術-即使最初只向高薪大公司或富有的消費者銷售-都會迅速傳播,直到它進入最大可能的大眾市場,最終覆蓋整個地球上的每一個人。

經典的例子是埃隆·馬斯克在2006年對特斯拉提出的所謂“秘密計劃”-當然,他當時是公開發表的:

第一步,制造昂貴的跑車

第二步,用這筆錢制造一輛價格實惠的車

第三步,用這筆錢制造一輛更加實惠的車

...這當然正是他所做的,結果成為了世界上最富有的人。

最后一點非常關鍵。如果埃隆今天只賣車給富人,他會更加富有嗎?不會。如果他只為自己制造汽車,他會比現在更富有嗎?當然不會。不,他通過銷售給最大可能的市場-全世界-來最大化自己的利潤。

簡而言之,每個人都會得到這個東西-就像我們過去在汽車、電力、無線電、計算機、互聯網、移動電話和搜索引擎方面所看到的一樣。這些技術的制造者非常有動力將價格降低,以至于地球上的每個人都能夠負擔得起。這正是在人工智能領域已經發生的事情-這就是為什么今天你可以以低廉甚至免費的價格使用最先進的生成式人工智能,例如微軟的必應(Bing)和谷歌的Bard-而且這種情況將繼續發生。這不是因為這些供應商愚蠢或慷慨,而是因為他們貪婪-他們希望最大限度地擴大市場規模,從而最大化他們的利潤。

因此,發生的情況與技術推動財富集中化相反-最終包括全球所有人在內的技術的個體用戶獲得了權力,并獲得了大部分產生的價值。與之前的技術一樣,建造人工智能的公司-假設它們必須在自由市場中運作-將競相努力實現這一目標。

這并不是說不平等不是我們社會面臨的問題。它是一個問題,只是它不是由技術驅動的,而是由相反的因素驅動,即那些對新技術最抵制的經濟部門,那些對阻止采用人工智能等新技術干預最多的部門-特別是房屋、教育和醫療保健部門。人工智能和不平等的實際風險不在于人工智能會導致更大的不平等,而是我們將不允許利用人工智能來減少不平等。

AI風險5:人工智能會導致人們做壞事嗎?

到目前為止,我已經解釋了五個最常提出的AI風險中的四個實際上并不存在-人工智能不會自主行動并殺死我們,人工智能不會毀掉我們的社會,人工智能不會導致大規模失業,人工智能不會引發災難性的不平等增加。但現在讓我們來討論第五個風險,這是我實際上同意的一個觀點:人工智能將使壞人更容易做壞事。

從某種意義上說,這是個重言。技術是一種工具。工具,從火和石頭開始,可以用來做好事-烹飪食物和建造房屋-也可以用來做壞事-燒傷人和毆打人。任何技術都可以用于善惡之中。沒錯。毫無疑問,人工智能將使罪犯、恐怖分子和敵對政府更容易做壞事。

這使得一些人提議,好吧,既然這樣,那么在這種情況下,讓我們不冒這個風險,讓我們在這種情況發生之前禁止人工智能。不幸的是,人工智能并不是一種難以獲得的隱秘物質,比如钚。恰恰相反,它是世界上最容易獲得的材料-數學和代碼。

人工智能已經猛虎出籠。你可以從成千上萬的免費在線課程、書籍、論文和視頻中學習如何構建人工智能,而且優秀的開源實現正在日益增多。人工智能就像空氣-它將無處不在。為了阻止人工智能的發展,所需要的極權壓制程度將如此嚴酷-世界政府監控和控制所有計算機?穿著黑色直升機的武裝暴徒搶奪流氓顯卡?-以至于我們將沒有一個社會可以保護。

因此,解決壞人利用人工智能做壞事的風險有兩種非常直接的方法,這正是我們應該關注的。

首先,我們已經有法律來將大多數壞事與人工智能聯系起來犯罪化。入侵五角大樓?這是犯罪。從銀行盜取錢財?這是犯罪。制造生物武器?這是犯罪。實施恐怖襲擊?這是犯罪。我們可以簡單地專注于在我們可以的情況下預防這些犯罪行為,并在無法預防時對其進行起訴。我們甚至不需要新的法律-我不知道是否有任何一個實際上被提出的壞的人工智能使用方法不違法。如果發現新的壞的使用方法,我們禁止該使用方法。證明了問題。

但你會注意到我在其中提到了什么-我說我們應該首先集中精力在防止人工智能協助犯罪之前-難道這種預防不意味著禁止人工智能嗎?好吧,還有另一種方法來防止這種行為,那就是將人工智能作為一種防御工具。使壞人在實現壞目標時危險的能力,同樣也使得在實現良好目標的好人手中具有強大的能力-特別是那些工作是預防壞事發生的好人。

例如,如果你擔心人工智能生成假人和虛假視頻,答案是構建新的系統,讓人們可以通過加密簽名驗證自己和真實內容。在人工智能出現之前,數字化創作和篡改真實和虛假內容已經存在;答案不是禁止文字處理軟件和Photoshop-或者人工智能-而是利用技術構建一個真正解決問題的系統。

因此,第二點,讓我們大力推動將人工智能用于善良、合法和防御性目的。讓我們將人工智能應用于網絡防御、生物防御、追捕恐怖分子以及我們為了保護自己、我們的社區和我們的國家而做的一切。

當然,已經有很多聰明的人在政府內外正在做這件事-但如果我們將目前專注于徒勞地試圖禁止人工智能的所有努力和智慧應用于利用人工智能來防范壞人做壞事,我認為毫無疑問,一個融入人工智能的世界將比我們今天生活的世界更加安全。

應該采取什么行動?

我提出一個簡單的計劃:

1. 允許大型人工智能公司盡可能快速和積極地發展人工智能,但不允許它們獲得監管控制,不允許它們建立一種受到錯誤的人工智能風險聲稱保護的政府壟斷聯盟。這將最大程度地發揮這些公司的驚人能力所帶來的技術和社會回報,它們是現代資本主義的寶貴財富。

2. 創業型人工智能公司應被允許盡可能快速和積極地發展人工智能。它們既不應面對大公司獲得政府授予的保護,也不應接受政府援助。它們應該被允許自由競爭。即使初創公司失敗,它們在市場中的存在也將不斷激勵大公司做到最好-不管以哪種方式,我們的經濟和社會都會獲勝。

3. 開源人工智能應被允許自由擴散和與大型人工智能公司和初創公司競爭。開源領域不應受到任何監管壁壘的限制。即使開源技術不能戰勝公司,它的廣泛可用性對世界各地想要學習如何構建和使用人工智能并成為技術未來一部分的學生們是一種福音,它將確保無論一個人是誰,有多少錢,都能從中受益。

4. 為了抵消壞人利用人工智能做壞事的風險,政府與私營部門合作,應積極參與潛在風險領域,利用人工智能來最大限度地提升社會的防御能力。這不僅限于人工智能相關的風險,還包括更一般的問題,如營養不良、疾病和氣候問題。人工智能可以是解決問題的非常強大的工具,我們應該將其作為這樣的工具來接受和運用。

這就是我們如何利用人工智能來拯救世界。

是時候開始行動了。

傳奇與英雄

我以兩個簡單的陳述作為結尾。

人工智能的發展始于20世紀40年代,與計算機的發明同時進行。關于神經網絡(我們今天所擁有的人工智能的架構)的第一篇科學論文于1943年發表。

在過去的80年里,整整幾代人的人工智能科學家出生、上學、工作,許多人甚至去世,都沒有看到我們現在所獲得的回報,他們都是傳奇人物。

如今,越來越多的工程師群體正在努力將人工智能變為現實,其中許多人年輕,可能有祖父母甚至曾祖父母參與了人工智能理念的創造。

然而,他們面臨著一片聲稱他們草率和邪惡的恐懼聲音和悲觀主義。

我不相信他們是草率或邪惡的人,他們每一個人都是英雄。我和我的公司非常高興支持盡可能多的他們,我們將100%站在他們和他們的工作旁邊。

-

互聯網

+關注

關注

54文章

11181瀏覽量

103600 -

人工智能

+關注

關注

1793文章

47567瀏覽量

239437

原文標題:AI的洗禮者和走私者

文章出處:【微信號:alpworks,微信公眾號:阿爾法工場研究院】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

AI開發平臺如何賦能開發者

云端AI開發者工具怎么用

Arm推出GitHub平臺AI工具,簡化開發者AI應用開發部署流程

多項AI新成果發布,涂鴉智能引領全球開發者共繪GenAI發展藍圖

亞馬遜云科技連續5年位列Gartner云AI開發者服務魔力象限領導者

愛立信消費者實驗室:2030年代十大熱門消費者趨勢 AI賦能的未來

AI浪潮下的十大消費者新趨勢

NVIDIA將全球數百萬開發者轉變為生成式 AI 開發者

2024 TUYA全球開發者大會盛大啟幕,Cube AI大模型重磅首發!

2024 TUYA全球開發者大會盛大啟幕,Cube AI大模型重磅首發!

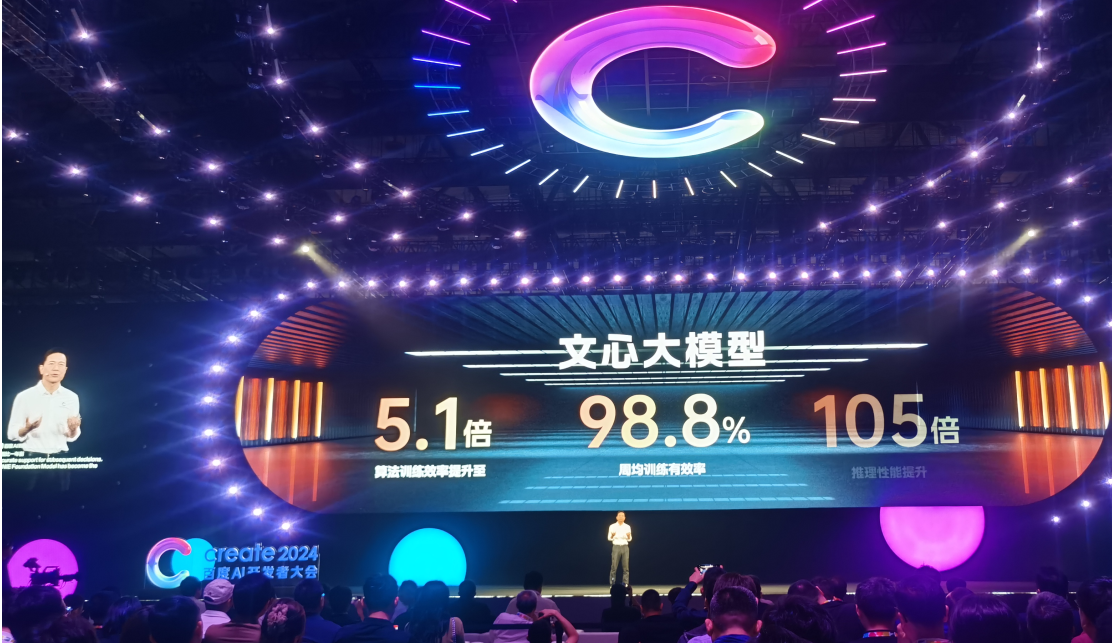

Create 2024百度AI開發者大會 帶來了哪些新技術?

Create2024百度AI開發者大會深圳開幕

AI的洗禮者和走私者

AI的洗禮者和走私者

評論