據文化和旅游部數據中心測算,2023年“五一”假期全國國內旅游出游合計2.74億人次,同比增長70.83%,按可比口徑恢復至2019年同期的119.09%1。后疫情時代,旅游人數的激增與旅游場景的多元化,給人工智能(AI)技術在旅游行業的應用帶來更多機遇和挑戰。例如自然語言處理(NLP)、機器翻譯、計算機視覺、搜索排序等 AI 技術的快速發展和日臻成熟,可以為游客提供更便捷的服務和更精準的內容。

作為一站式旅行平臺,攜程旅行已經將諸多AI 技術應用于酒店、機票、自由行、跟團游、簽證、玩樂、租車等旅游度假的多個業務線,為全球用戶提供一套完整的旅行產品、服務及差異化的旅行內容等。為了在滿足業務需求的同時降低成本壓力,攜程構建了基于英特爾至強 可擴展處理器的 AI 推理算力平臺,并通過高性能算子庫、計算圖優化、模型壓縮等方式提升 AI 推理性能。

?

?

?

?

?

?

?

?

?

?

?

?采用英特爾 至強解決方案

實現性能與經濟性的更佳平衡

隨著 AI 應用的不斷擴展和深入,大型旅行服務平臺面臨的算力挑戰主要存在于兩個方面:

一方面,AI 技術正在日趨多樣化與復雜化,為了適應不同的業務場景需求,企業常常需要融合使用傳統機器學習、卷積神經網絡、Transformer 等深度學習模型結構,以及知識圖譜、圖神經網絡等技術。同時,AI模型的深度、寬度以及結構復雜度也在不斷提升,增加了企業的開發門檻,也使得 AI算力調度、AI 性能優化更具挑戰。

另一方面,智能化應用正在迅速擴張,需要由 AI 模型處理的數據也在不斷增長。例如內容與廣告個性化推薦、實時風控、機器翻譯、智能客服、圖像處理等領域正在越來越多地使用 AI 技術,以從海量的數據中生成高價值的商業洞察,從而帶來了較高的算力基礎設施建設成本。與此同時,上層應用對于 AI 模型推理也有著特定的服務級別協議 (SLA) 要求。企業需要在滿足 SLA 要求的前提下,通過模型優化等方式,更好地發揮硬件的性能潛力,降低算力基礎設施的總體擁有成本(TCO)。

面對上述挑戰,企業首先要面臨硬件平臺的選擇問題:雖然基于獨立 GPU 的推理方案能夠提供強大的算力,但未必是一個經濟的選擇。這是因為獨立 GPU 不僅采購或租用成本相對較高,而且通常是以專用服務器的模式進行部署和運維,帶來了較高的綜合成本。考慮到旅行服務中大量的 AI 推理場景所需要的性能經過優化能夠得到滿足,采用 CPU 的方案將更具成本效益。因此,攜程采用基于英特爾至強 可擴展處理器的 AI 推理算力平臺,旨在為算法模型提供更全面易用、穩定性更好、使用和維護成本更低的優化解決方案。 英特爾至強 可擴展處理器內置人工智能加速功能,已針對工作負載進行優化,能夠為各種AI 應用以及高密度基礎設施帶來一流的性能和內存帶寬。同時,采用矢量神經網絡指令(VNNI) 的英特爾 深度學習加速(英特爾DL Boost),能夠有效提高 AI 推理的表現,使其成為深度學習應用的卓越基礎設施。

?

?

?

?

?

?

?

?

?

?

?

?構建并優化AI推理算力平臺

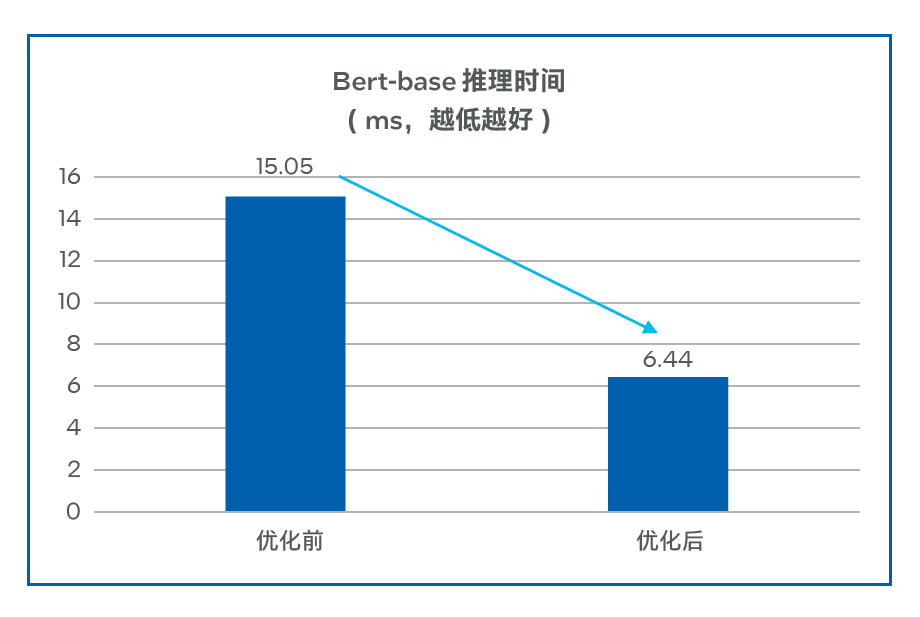

Bert-base推理時間由15毫秒降至6毫秒

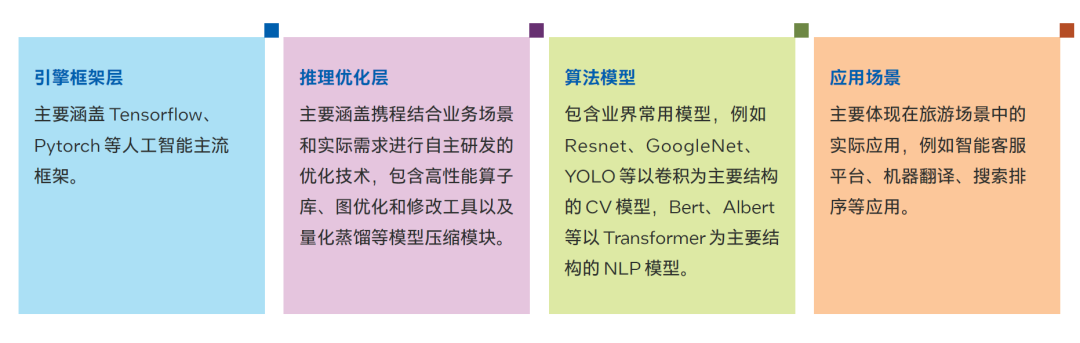

在基于英特爾 至強 可擴展處理器的硬件平臺層基礎上,攜程構建了 AI 推理算力平臺,該平臺還包括引擎框架層、推理優化層、算法模型、應用場景。同時,為了盡可能地提升 AI 推理性能,釋放硬件潛力,攜程進行了推理優化。主要的優化思路為兩點:一是通過調整/簡化模型結構,或改進算法以降低算法復雜度;二是優化軟件執行效率,使用硬件優勢特征,提升硬件執行效率。

攜程基于英特爾 至強 可擴展處理器的硬件平臺層基礎上

構建 AI 推理算力平臺

攜程以機器翻譯應用的 Transformer模型來測試其性能表現。在該測試中,攜程除了使用上述的優化方法,還分割模型并使用 jit 跟蹤方法來提高性能。同時,在batchsize 超過 16 個的情況下,使用 mm op 進行優化。攜程使用固定算例的平均響應時延作為測試數據,tokens 為 10,batchsize=1,Bert-base模型推理時間由優化前的15.05毫秒降至優化后的6.44毫秒2。

Bert-base 模型優化前后的性能對比2

基于英特爾 至強 可擴展平臺的基礎算力和深度的 AI 模型推理性能優化,用戶將獲得的收益包括:在特定的 SLA 要求下,降低 AI 推理應用的 TCO

在通過本輪優化之后,攜程的 CPU 服務器 AI 推理性能得到提升,能夠滿足大量 AI 推理場景對于時延等 SLA 指標的要求,避免了在昂貴的專用 AI 加速器方面的支出。

提升基礎設施的敏捷性與靈活性通過本輪優化,攜程能夠高效利用現有的 CPU 服務器,根據實際負載需求進行靈活調度,而無需為 AI 推理新增需求部署專用服務器。

為 AI 推理性能優化提供了標準的參考流程本方案提供了一套標準、可自動完成的參考模型優化流程,能夠賦能更多的 AI 應用。

攜程與英特爾的合作,驗證了 AI 模型推理方案在英特爾 至強 可擴展處理器上的應用潛力,在成本、性能方面實現了平衡。同時,隨著推理性能優化技術的逐步提高,將極大地降低人工智能應用的部署成本,加快AI應用的落地速度并擴充應用場景,推動人工智能行業的整體發展。

-

英特爾

+關注

關注

61文章

10203瀏覽量

174859 -

cpu

+關注

關注

68文章

11090瀏覽量

217303

原文標題:攜程攜手英特爾優化AI推理性能,提升性能的同時降低TCO

文章出處:【微信號:英特爾中國,微信公眾號:英特爾中國】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

1.9倍性能提升!英特爾至強6在MLPerf基準測試中表現卓越

在英特爾酷睿Ultra AI PC上部署多種圖像生成模型

英特爾以太網新品:高性能與能效并重,帶來多樣化選擇

英特爾推出具備高性能和能效的以太網解決方案

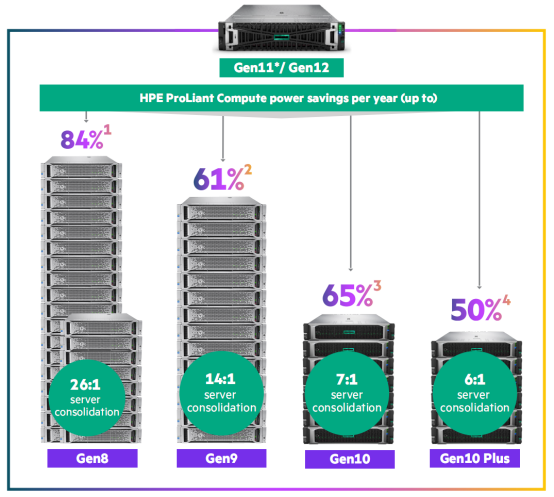

英特爾至強6助力HPE Gen12,AI推理性能提升3倍!

英特爾Gaudi 2D AI加速器助力DeepSeek Janus Pro模型性能提升

DeepSeek發布Janus Pro模型,英特爾Gaudi 2D AI加速器優化支持

英特爾帶您解鎖云上智算新引擎

英特爾與火山引擎飛連攜手升級AI時代企業IT管理體驗

Inflection AI攜手英特爾推出企業級AI系統

英特爾發布至強6性能核處理器

英特爾發布至強6性能核處理器,攜手生態加速數據中心算力升級

開箱即用,AISBench測試展示英特爾至強處理器的卓越推理性能

評論