最近,ChatGPT Plus 的用戶一直反映該平臺(tái)及其底層 LLM (GPT-4) 的性能嚴(yán)重下降(編程準(zhǔn)確率也暴降13%)。

這是繼最近一系列更新之后的結(jié)果,包括為 Plus 訂閱者提供網(wǎng)絡(luò)瀏覽和擴(kuò)展插件訪問(wèn)權(quán)限。在這些更新之后,該服務(wù)的工作量大大增加,人們開始注意到 GPT-4 異常快速的響應(yīng)時(shí)間突然變得不那么令人“驚艷”了。

如果功能和性能受到限制,那么有些人開始取消他們的 Plus 訂閱當(dāng)然是有道理的。許多人將轉(zhuǎn)向開源 AI 語(yǔ)言模型,似乎成了無(wú)聲的回應(yīng)。

網(wǎng)友主流觀點(diǎn)

目前對(duì)此,不少猜測(cè)和假想充斥在有關(guān)社區(qū)。有一些較為流行的觀點(diǎn):ChatGPT 明顯的性能下降可能來(lái)自“模型的縮放痛苦”,即,降低 GPT-4 的推理能力似乎是平衡響應(yīng)速度的一種可能的解決方法,對(duì)于 OpenAI 的開發(fā)人員來(lái)說(shuō),這是一個(gè)不難想到的解決方案。

還有評(píng)論指出,盡管互聯(lián)網(wǎng)接入帶來(lái)了額外好處, 最近甚至發(fā)現(xiàn) OpenAI 的 GPT-4 在速度方面優(yōu)于 Azure 的 GPT-4 模型,但 ChatGPT 的編碼輸出已經(jīng)出現(xiàn)嚴(yán)重降級(jí)。

另一個(gè)原因:安全性AI對(duì)齊

再一個(gè)原因,近期,Sam Altman 和其他科技巨頭最近挺身而出,聲稱他們需要防止“AI 滅絕的風(fēng)險(xiǎn)”。這樣看來(lái),ChatGPT 的推理和可用性下降,似乎與 AI 行業(yè)領(lǐng)導(dǎo)者承認(rèn)“人工智能,尤其是新興的 AGI 的潛在危險(xiǎn)性”的時(shí)間相吻合。

可能是由于 OpenAI 出于對(duì)安全性考量而對(duì)其所進(jìn)行的過(guò)度 AI 對(duì)齊。簡(jiǎn)單來(lái)說(shuō),AI 對(duì)齊就是確保人工智能系統(tǒng)的目標(biāo)與人類價(jià)值觀一直,使其符合設(shè)計(jì)者的利益預(yù)期,不會(huì)產(chǎn)生意外的有害后果,例如輸出涉及種族、政治等敏感信息。

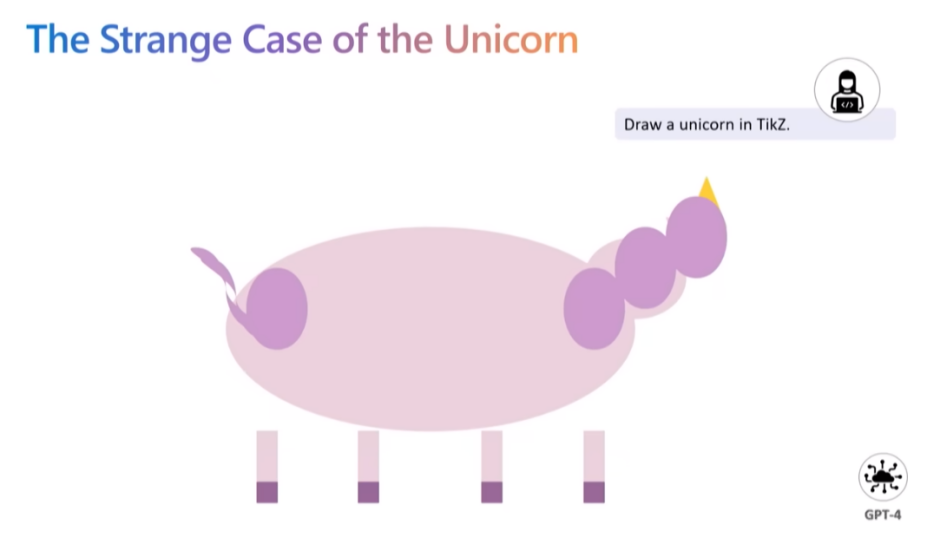

而就在近期,由微軟研究院發(fā)布的一篇論文中提到了這樣的觀點(diǎn):對(duì) AI 模型所進(jìn)行的任何 AI 對(duì)齊,都會(huì)損失模型的準(zhǔn)確性和性能。論文主要作者 Sebastien Bubeck 在一次發(fā)言中敘述了大模型經(jīng)過(guò) AI 對(duì)齊后所出現(xiàn)的問(wèn)題。當(dāng)接收到“利用 TikZ 繪圖工具繪制獨(dú)角獸”的指令后,未經(jīng) AI 對(duì)齊的 GPT-4 模型給出了這樣的結(jié)果。

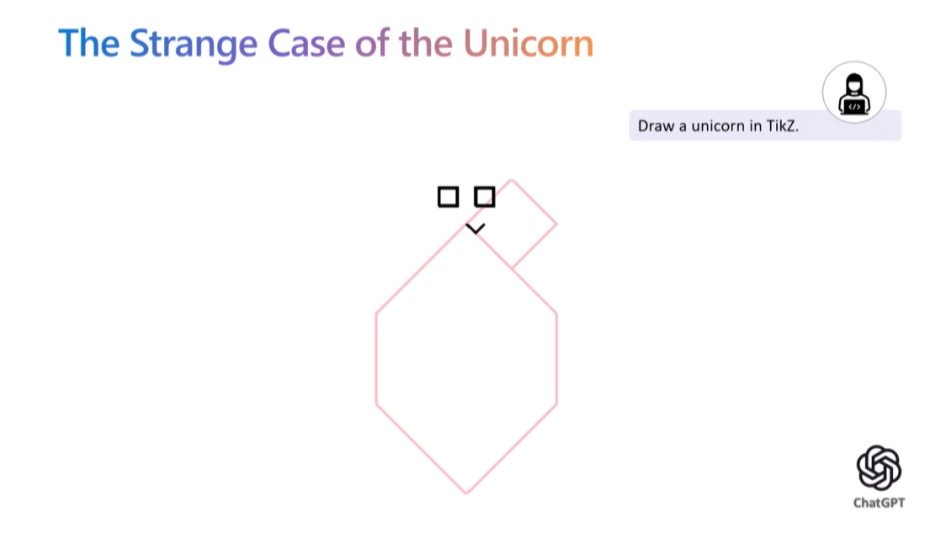

然而當(dāng)實(shí)驗(yàn)員將相同需求提供給集成 GPT-4 模型并進(jìn)行了安全性 AI 對(duì)齊的ChatGPT 后,圖像的輸出質(zhì)量卻下降了一大截。對(duì)此,Sebastien Bubeck 解釋稱,相較于 GPT-4,ChatGPT 利用了更多基于人類反饋的強(qiáng)化學(xué)習(xí)來(lái)構(gòu)建護(hù)欄,然而根據(jù)古德哈特定律,獎(jiǎng)勵(lì)模型并不是一個(gè)完美的代理,因此過(guò)度的 AI 對(duì)齊會(huì)阻礙模型對(duì)任務(wù)理解的真實(shí)程度。

Sam Altman 宣布新的 OpenAI 計(jì)劃

上周,Humanloop 的 CEO Raza 與 Sam Altman 和其他 20 位開發(fā)人員坐下來(lái)討論 OpenAI 的 API 及其產(chǎn)品計(jì)劃。Sam 非常開放,熱情討論了許多有關(guān) OpenAI很尖銳的問(wèn)題。以下是要點(diǎn):

OpenAI 目前嚴(yán)重受 GPU 限制

整個(gè)討論中出現(xiàn)的一個(gè)共同主題是,目前 OpenAI 非常受 GPU 限制,這推遲了他們的許多短期計(jì)劃。最大的客戶抱怨是關(guān)于 API 的可靠性和速度。Sam 承認(rèn)他們的擔(dān)憂,并解釋說(shuō)大部分問(wèn)題是 GPU 短缺造成的。

更長(zhǎng)的 32k 上下文還不能推廣給更多人。OpenAI 還沒(méi)有克服注意力的 O(n^2) 縮放,因此雖然看起來(lái)很有可能他們很快就會(huì)有 100k - 1M 令牌上下文窗口(今年)任何更大的東西都需要研究突破。

微調(diào) API 目前也受到 GPU 可用性的瓶頸。他們還沒(méi)有使用適配器或LoRa等高效的微調(diào)方法,因此微調(diào)的運(yùn)行和管理需要大量計(jì)算。將來(lái)會(huì)更好地支持微調(diào)。他們甚至可能舉辦社區(qū)貢獻(xiàn)模型的市場(chǎng)。

專用容量產(chǎn)品受 GPU 可用性的限制。OpenAI 還提供專用容量,為客戶提供模型的私有副本。要獲得這項(xiàng)服務(wù),客戶必須愿意預(yù)先支付 10 萬(wàn)美元。

OpenAI 的近期路線圖

Sam 分享了他所看到的 OpenAI 的 API 臨時(shí)近期路線圖。

2023

(1)更便宜更快的 GPT-4——這是他們的首要任務(wù)。總的來(lái)說(shuō),OpenAI 的目標(biāo)是盡可能降低“智能成本”,因此隨著時(shí)間的推移,他們將努力繼續(xù)降低 API 的成本。

(2)更長(zhǎng)的上下文窗口——在不久的將來(lái),上下文窗口可能高達(dá) 100 萬(wàn)個(gè) token。

(3)Finetuning API——微調(diào) API 將擴(kuò)展到最新的模型,但具體形式將取決于開發(fā)人員表示他們真正想要的東西。

(4)有狀態(tài)的 API——當(dāng)你今天調(diào)用聊天 API 時(shí),你必須反復(fù)傳遞相同的對(duì)話歷史并一次又一次地為相同的令牌付費(fèi)。將來(lái)會(huì)有一個(gè)記住對(duì)話歷史記錄的 API 版本。

2024

(5)多模態(tài)——這是作為 GPT-4 版本的一部分進(jìn)行演示的,但在更多 GPU 上線之前不能擴(kuò)展到所有人。

插件“沒(méi)有 PMF”并且可能不會(huì)很快出現(xiàn)在 API 中

許多開發(fā)人員對(duì)通過(guò) API 訪問(wèn) ChatGPT 插件很感興趣,但 Sam 表示他認(rèn)為這些插件不會(huì)很快發(fā)布。除了瀏覽之外,插件的使用表明它們還沒(méi)有 PMF。他建議很多人認(rèn)為他們希望他們的應(yīng)用程序在 ChatGPT 中,但他們真正想要的是他們應(yīng)用程序中的 ChatGPT。

OpenAI 將避免與他們的客戶競(jìng)爭(zhēng)——除了 ChatGPT

不少開發(fā)人員表示,當(dāng) OpenAI 可能最終發(fā)布對(duì)他們具有競(jìng)爭(zhēng)力的產(chǎn)品時(shí),他們對(duì)使用 OpenAI API 進(jìn)行構(gòu)建感到緊張。Sam 表示 OpenAI 不會(huì)發(fā)布 ChatGPT 以外的更多產(chǎn)品。他說(shuō),偉大的平臺(tái)公司擁有殺手級(jí)應(yīng)用程序的歷史由來(lái)已久,而 ChatGPT 將允許他們通過(guò)成為自己產(chǎn)品的客戶來(lái)改進(jìn) API。ChatGPT 的愿景是成為工作的超級(jí)智能助手,但還有許多 OpenAI 不會(huì)觸及的其他 GPT 用例。

需要監(jiān)管,但也需要開源

雖然 Sam 呼吁對(duì)未來(lái)的模型進(jìn)行監(jiān)管,但他認(rèn)為現(xiàn)有模型并不危險(xiǎn),并認(rèn)為監(jiān)管或禁止它們將是一個(gè)大錯(cuò)誤。他重申了他對(duì)開源重要性的信念,并表示 OpenAI 正在考慮開源 GPT-3。他們尚未開源的部分原因是他懷疑有多少個(gè)人和公司有能力托管和服務(wù)大型 LLM。

大模型定律仍然成立

最近有很多文章聲稱“巨型 AI 模型的時(shí)代已經(jīng)結(jié)束”。這并不準(zhǔn)確。OpenAI 的內(nèi)部數(shù)據(jù)表明,模型性能的比例定律繼續(xù)存在,使模型變大將繼續(xù)產(chǎn)生性能。

沒(méi)錯(cuò),擴(kuò)展的速度無(wú)法維持,因?yàn)?OpenAI 在短短幾年內(nèi)就將模型放大了數(shù)百萬(wàn)倍,而這種做法在未來(lái)將無(wú)法持續(xù)。這并不意味著 OpenAI 不會(huì)繼續(xù)嘗試讓模型變得更大,這只是意味著它們的規(guī)模每年可能會(huì)增加一倍或三倍,而不是增加許多數(shù)量級(jí)。

擴(kuò)大規(guī)模繼續(xù)起作用的事實(shí)對(duì) AGI 開發(fā)的時(shí)間表具有重大影響。大模型假設(shè)是這樣一種想法,即我們可能擁有構(gòu)建 AGI 所需的大部分內(nèi)容,并且大部分剩余工作將采用現(xiàn)有方法并將它們擴(kuò)展到更大的模型和更大的數(shù)據(jù)集。如果大模型時(shí)代已經(jīng)結(jié)束,那么也就意味著 AGI 離我們更遠(yuǎn)了。也就是說(shuō),大模型定律繼續(xù)成立的事實(shí),強(qiáng)烈暗示了更短的 AGI 時(shí)間表。

-

人工智能

+關(guān)注

關(guān)注

1791文章

47314瀏覽量

238625 -

OpenAI

+關(guān)注

關(guān)注

9文章

1092瀏覽量

6538 -

ChatGPT

+關(guān)注

關(guān)注

29文章

1562瀏覽量

7701

原文標(biāo)題:ChatGPT性能暴降!OpenAI重磅回應(yīng)!

文章出處:【微信號(hào):TheBigData1024,微信公眾號(hào):人工智能與大數(shù)據(jù)技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

ChatGPT性能暴降!OpenAI重磅回應(yīng)!

ChatGPT性能暴降!OpenAI重磅回應(yīng)!

評(píng)論