2023 年注定是屬于大模型和向量數據庫的巔峰時刻。國內大模型的發展也迎來前所未有之機遇,“百模”激戰正酣。在剛閉幕的世界人工智能大會上,國內外科技公司全線加入,三十余款大模型集中亮相,“國家隊”塵埃落定,并正式啟動大模型測試國家標準制訂,掀起新一輪大模型熱浪。而作為“大模型記憶體”、AIGC 應用開發新范式的重要組成部分,向量數據庫的演進也逐漸達到了前所未有的新高度。

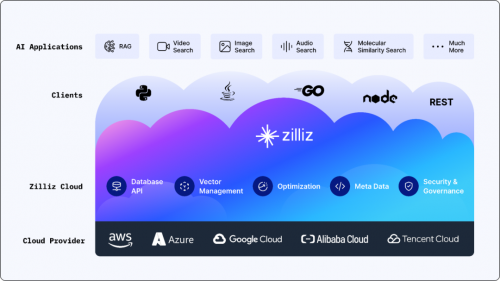

Milvus自2019年正式開源以來,已經成長為全球最大、最活躍的向量數據庫開源項目與開發者社區。作為Milvus背后的開發者與運營者,Zilliz 一直走在向量數據庫的最前沿,始終秉承為開發者提供易用性強、性價比高的向量數據庫服務的理念。經過五年的持續打磨,終于在國內推出了基于 Milvus的全托管向量數據庫云服務產品——Zilliz Cloud。

經過不斷地開發與升級,Zilliz Cloud 儼然成為向量數據庫賽道的領先者。隨著 Zilliz Cloud 在國內全面開啟向量數據庫云服務,也為向量數據庫的高速發展開啟了全新的紀元。對于此次在國內的服務落地,Zilliz 秉承的使命和目標尤為清晰和明確:

●提供全球最專業的全托管向量數據庫云服務。

●打破向量數據庫服務集中在北美,國內無可用向量數據庫服務的尷尬局面。

●滿足向量數據庫服務多云的需求,避免業務被單一云環境限制。

●為跨境業務中所需要的統一向量數據庫服務和架構提供可行性。

●Milvus 開源解決方案、SaaS、PaaS 統一接口標準,無縫線下/云上遷移,并大幅度降低混合部署的綜合成本。

●提供比開源 Milvus 具有更高性價比、更穩定服務支持的產品和解決方案。

成熟穩定,全球率先支持十億級別向量規模的服務

Milvus 自開源以來,一直都是企業用戶自建向量數據平臺的首選,全套技術解決方案已被上萬家企業所采用,其中百度、新浪、理想汽車、華泰證券、沃爾瑪、LINE、BIGO 等頭部企業在實踐中經過反復驗證,均已順利投產。

向量數據庫是 AIGC 大模型的重要補充,是提供準確可靠、高度可擴展的長短期“記憶”的關鍵載體。近一年,向量數據庫項目如雨后春筍般涌現。然而,大部分向量數據庫支持的向量數據規模僅停留在千萬量級,并不具備支撐生產環境的能力。

相較之下,Milvus 在過去 5 年的客戶應用場景覆蓋各行各業,早在 2021 年就實現穩定支持十億級向量規模的線上服務。如今,Zilliz Cloud 的向量數據庫服務可輕松支持十億級以上規模向量數據,可用性高達 99.9%。

此外,在產品與技術背后,Zilliz 亦擁有全球最資深的向量數據庫專家團隊,可以為每一位企業用戶配備 4 名技術支持,“沒有人比我們更懂向量數據庫”是團隊對開源社區與商業化用戶的承諾。

高性能+高性價比,性能優異遠超同類產品

當前主流的向量數據索引算法是內存算法或內存/SSD 混合,算法內核以矩陣計算為主(類似 HPC),大規模向量檢索與分析是計算/內存雙重密集的任務。這意味著向量數據庫作為基礎設施,對于性能與成本更加敏感。

從性能方面來看,Zilliz Cloud 在 QPS 和降低查詢延遲方面遠超其他同類產品。我們將 Zilliz Cloud 、Milvus、Pinecone、ElasticCloud 4 個常見的向量數據庫(ElasticCloud 嚴格來說不屬于向量數據庫,但附帶向量能力,在傳統文本檢索領域受眾最廣,可以視為目前傳統數據庫支持向量檢索的代表)在同等資源及 6 組向量查詢任務的同等條件下進行了對比(測試框架已開源,詳見 VectorDBBench,Leaderboard)。

對比結果如下:

在查詢吞吐方面,Zilliz Cloud 在全部6組查詢任務中全面力壓向量數據庫 Pinecone,整體性能平均超越2倍以上。與此同時,Zilliz Cloud 相比 Milvus,也有將近一倍的提升,表現令人眼前一亮。ElasticCloud 作為傳統文本檢索服務的代表,向量查詢能力主要為補充能力,這 6 組查詢任務的 QPS 均在 50 以下。

查詢延遲方面,Zilliz Cloud 整體在 10 ms 以下,Milvus 整體在 20 ms 以下,Pinecone 在 20-40 ms 之間,ElasticCloud 差距較為明顯。

性價比方面,主要考察 Queries per dollar (高并發情況下,單位成本所能支持的查詢請求數量)。相較Pinecone、Elastic,Zilliz Cloud 的優勢十分明顯。指標相比第二位的 Pinecone 最多可以高出 1 個數量級(Q1, Q2),在剩下的四組任務中普遍可以高 3 倍左右。(由于 Milvus 為開源方案,難以和商業化服務在相同標準下比較,我們在這組測試中將其移除。)

黑科技加持,軟硬件性能飆升,全新內核火力全開

Zilliz Cloud 采用商業化引擎,綜合性能超過Milvus 開源引擎的 1 倍以上。引擎針對典型場景進行深度優化,性能可提升 3-5 倍。

硬件層面,Zilliz 與英偉達、英特爾等一線硬件廠商有著長期穩定的合作,向量算法內核針對 X86、ARM、GPU 進行了定制化優化。

軟件層面,Zilliz Cloud 推出了 Autoindex 智能索引。智能索引根據用戶的向量維度、數據規模、數據分布、查詢特性進行持續的自動化調優,免去用戶索引類型選型以及參數調優的痛苦。據 Zilliz 內部測試,autoindex 智能索引已經達到向量數據庫專家手工調優效果的 84%,大幅超越用戶的平均水平。在下一階段,autoindex 智能索引的功能還會得到大幅度增強,支持用戶指定 recall 進行優化,保證索引運行在指定查詢準確度的最優點。

當然,針對最近大火的 AIGC 應用,Zilliz Cloud 也推出了專門的特性支持:

●動態 schema ,可以根據 AIGC 迭代需要,靈活擴展向量特征或標簽字段。

●Partition Key ,支持 AIGC 應用多用戶知識庫的利器,相較單獨建表方案,綜合成本可下降 2 -3 個數量級。

●支持 JSON 類型,可以將 JSON 與 embedding 這兩種超強能力相結合,實現基于 JSON 與 embedding 向量的混合數據表示以及復雜的業務邏輯。

打破 “CAP” 不可能三角,給用戶靈活選擇

向量數據庫技術發展到現在并不完美,通常情況下,業務需要在成本(Cost)、查詢效果與準確度(Accuracy)、查詢性能(Performance)之間做權衡,即向量數據庫的 CAP 問題。目前來看,CAP 是一個不可能三角,Zilliz 的解法是在典型的位置給出局部最優解,并給用戶以靈活的選擇。

事實上,用戶的普遍場景可以歸納為性能需求型、容量需求型與成本敏感型。為此,Zilliz Cloud 在向量數據庫實例中也相應提供了三類支持:性能型、容量型和經濟型。不同的實例類型由不同的算法與硬件資源組合而成,適用于不同的業務場景。

●性能型實例適用于需要低延遲和高吞吐量的向量相似性檢索場景,該類型的實例能夠保證毫秒級的響應。

性能型實例的適用場景包括但不限于:生成式 AI、推薦系統、搜索引擎、聊天機器人、內容審核、LLM 增強的知識庫、金融風控。

●容量型實例可以支持的數據量是性能型的 5 倍,但查詢延遲略有增加,因此適用于需要大量存儲空間的場景,尤其是需要處理千萬級以上向量數據的場景。

容量型實例的適用場景包括但不限于:搜索大規模的非結構化數據(如:文本、圖像、音頻、視頻、藥物化學結構等)、侵權檢測、生物身份驗證。

●經濟型實例可支持的數據規模與容量型一致,但價格優惠 7 折左右,性能略有下降,適用于追求高性價比或預算敏感的場景。

經濟型實例的適用場景包括但不限于:數據標記或數據聚類、數據去重、數據異常檢測、平衡訓練集類型分布。

支持大模型與非結構化數據處理全生態覆蓋

沒有任何一套系統可以滿足使用者業務上的所有需求,向量數據庫也是如此。在以向量數據庫為支撐的業務中,往往需要處理多道流程,包括:

●業務數據的語義結構化,如從文本數據中梳理標題 embedding、內容段落的embedding、一二級主題、閱讀時間;

●面向端到端效果的模型選型,如尋找能帶來最佳效果的 embedding 模型選型;

●模型與向量數據庫的集成,如向量數據庫查詢驅動的原始數據召回以及后續 LLM 對召回內容的總結或重構等。

為了進一步降低應用構建成本,提供標準化組件,Zilliz Cloud 為開發者提供了雙重支持:

●大模型生態對接。2023 年 3 月,Zilliz 作為 OpenAI 首批向量數據庫合作伙伴,完成了 Milvus 與 Zilliz Cloud 的插件化集成,被納入官方推薦的向量數據庫插件名單。不止如此,Zilliz 還與 LangChain、Cohere、LlamaIndex、Auto-GPT、BabyAGI 等熱門項目進行了深度集成。此外,與國產大模型如文心一言、通義千問、智譜 AI、MiniMax、360 智腦等對接工作正在進行中,近期將會有更多成果發布。

●面向非結構化數據處理流水線。Zilliz Cloud 提供了開源的 Towhee 工具框架。開發者可以在熟悉的 Python 環境,以類似 Spark 的算子語法編寫自己的流水線,輕松處理文本、圖片、音頻、視頻、化合物結構等非結構化數據的 ETL 過程。Towhee 同時提供自動化編排工具,一鍵在 Python 環境驗證過的流水線組織成基于 Triton、TensorRT、ONNX 以及一系列硬件加速算法的服務鏡像,面向如文本近似搜索、智能問答、知識庫等典型場景。當然,Towhee 也提供深度優化的標準流水線。

目前,Zilliz Cloud 提供 SaaS 和 PaaS 服務,其中 SaaS 已覆蓋 AWS、GCP、阿里云,PaaS 覆蓋 AWS、GCP、Azure、阿里云、百度智能云、騰訊云和金山云。國內官網已同步上線,更多詳情和案例可以訪問 Https://zilliz.com.cn(海外官網和云服務入口: Https://zilliz.com)。

為了加速打磨業界最佳實踐,我們即將啟動「尋找 AIGC 時代的 CVP 實踐之星」 專題活動,Zilliz 將聯合國內頭部大模型廠商一同甄選應用場景, 由雙方提供向量數據庫與大模型頂級技術專家為用戶賦能,一同打磨應用,提升落地效果,賦能業務本身。如果你的應用也適合 CVP 框架,且正為應用落地和實際效果發愁,可直接申請參與活動,獲得最專業的幫助和指導。(注:CVP 即 C 代表以 ChatGPT 為代表的 LLMs,V 代表 Vector DB,P 代表 Prompt Engineering,聯系方式參見 business@zilliz.com)

2023 年伴隨著 AGI 和 LLMs 的爆發已經過半,加速探索大模型落地之路已經迫在眉睫。行業的高度共識推動著 AI 奇點的來臨,大模型將重構企業級應用,重塑人工智能產業的發展方向。Zilliz 表示,未來將持續聚焦向量數據庫行業發展的最前沿,以各行各業的智能化演進為目標,為大模型時代的企業和開發者提供最具競爭力的“大模型記憶體”。

審核編輯 黃宇

-

數據庫

+關注

關注

7文章

3816瀏覽量

64448 -

大模型

+關注

關注

2文章

2476瀏覽量

2793

發布評論請先 登錄

相關推薦

體驗領禮啦!體驗自建數據庫遷移到阿里云數據庫RDS,領取桌面置物架!

有云服務器還需要租用數據庫嗎?

租用云數據庫違法嗎?租用流程和注意事項集錦

阿里云與中興通訊達成開源數據庫合作

阿里云與中興通訊達成開源數據庫合作,助推國產數據庫發展

搭載英偉達GPU,全球領先的向量數據庫公司Zilliz發布Milvus2.4向量數據庫

開源鑄劍,五載匠心!Zilliz Cloud云服務盛裝登場,引領向量數據庫云時代!

開源鑄劍,五載匠心!Zilliz Cloud云服務盛裝登場,引領向量數據庫云時代!

評論