本文介紹一下我組在ICCV2023的論文“S3IM: Stochastic Structural SIMilarity and Its Unreasonable Effectiveness for Neural Fields”。

S3IM這個工作背后的想法實際上很簡潔,從這個idea在腦海里形成到最后提交到ICCV2023不過2個月時間。

S3IM: Stochastic Structural SIMilarity and Its Unreasonable Effectiveness for Neural Fields

論文:arxiv.org/abs/2308.07032

代碼:github.com/Madaoer/S3IM-Neural-Fields

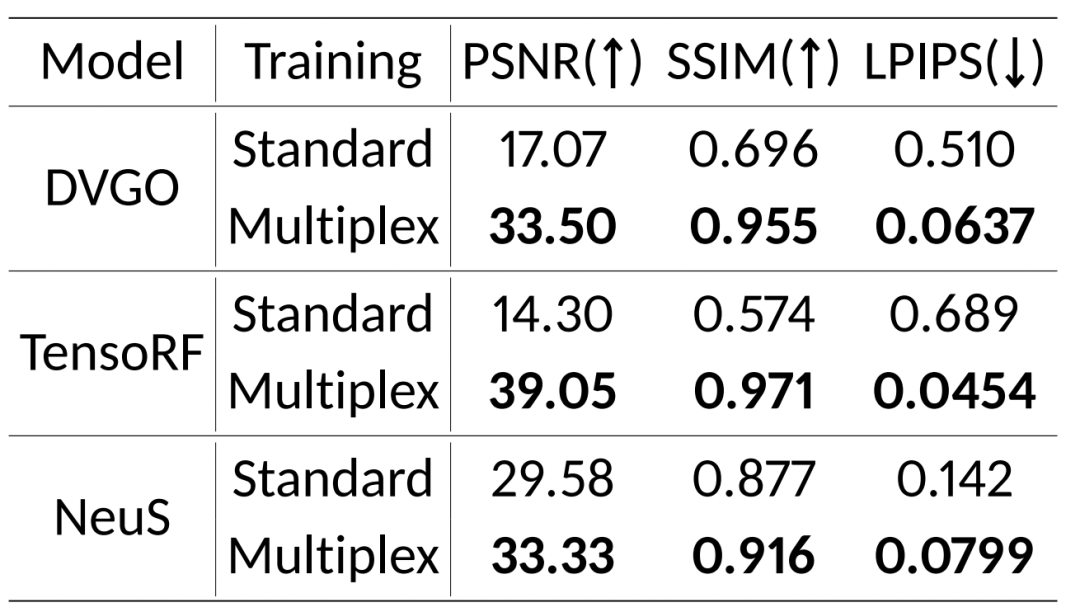

用一句話來總結這個工作就是——我們提出了一種即插即用的loss S3IM(隨機結構相似性),可以近乎零成本地顯著提升現存NeRF類方法的性能指標。在幾個場景里,我們甚至可以把TensoRF和DVGO這些經典模型的Test MSE Loss下降99%,同時把NeuS的幾何重建指標(比如Chamfer L1 Distance)改善超過60%。

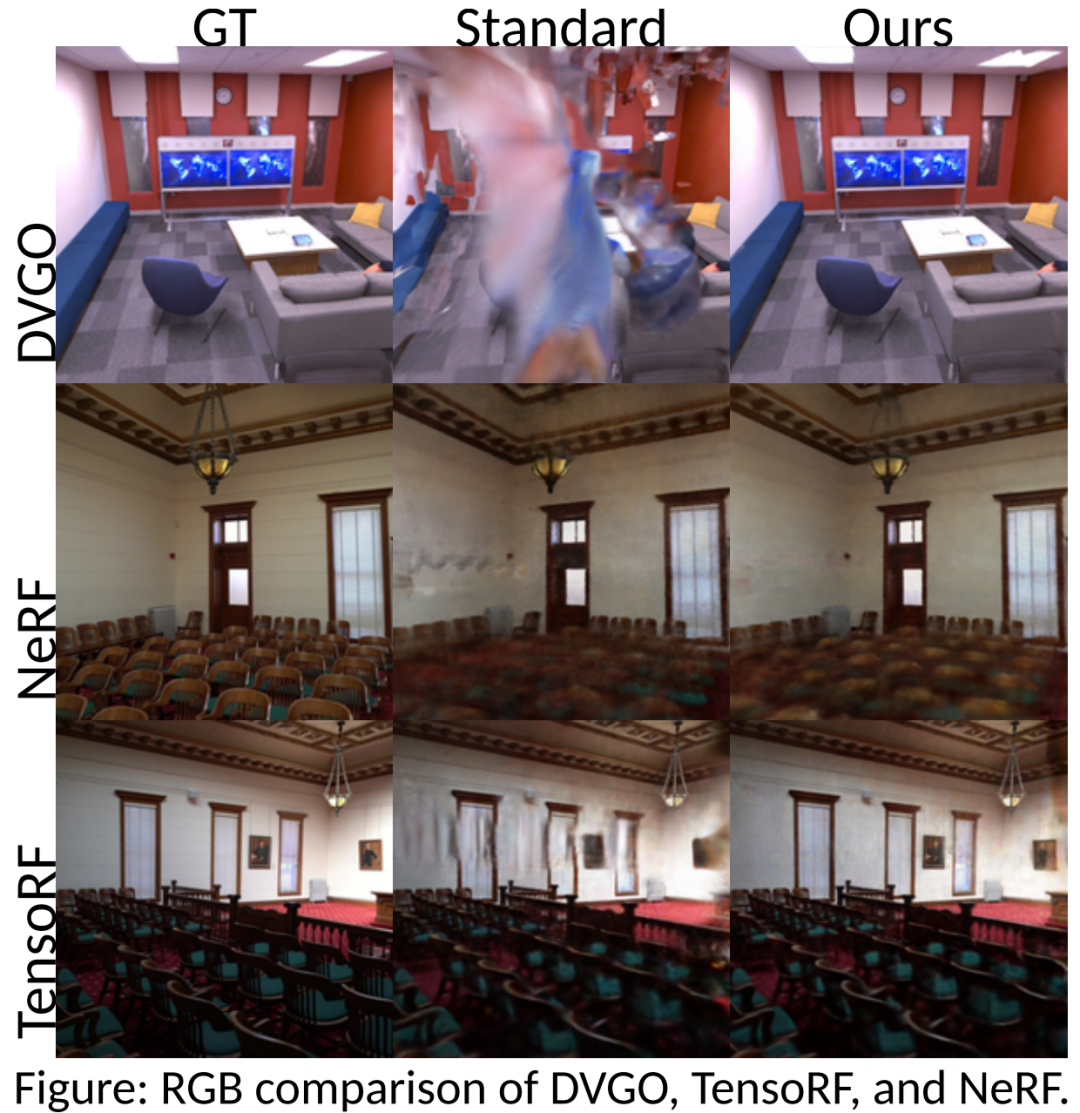

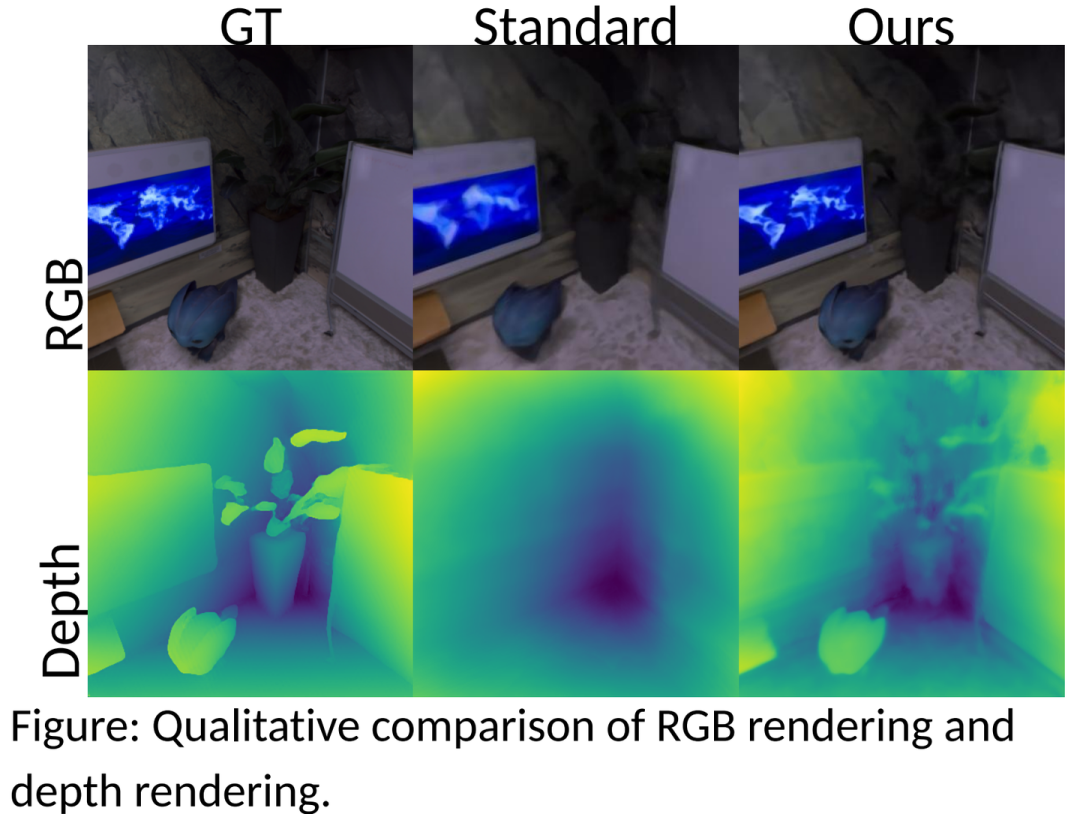

這里我們先看幾組RGB和幾何重建的可視化結果。

不僅如此,還可以提高對圖像噪音的魯棒性。如下圖所示,S3IM的渲染結果明顯去掉了圖像里灰蒙蒙的噪音。

毫無疑問,S3IM極大地增強了現有的NeRF類方法。

S3IM的精髓在于以兩個像素集合之間的相似性作為訓練損失;像素集合一般包含數千個像素,這些像素一起貢獻了互相關聯的、全局的結構信息。

而NeRF傳統的MSE是一種以兩個獨立像素之間的point-wise error作為訓練損失;所以MSE只包含了像素點孤立的信息、完全沒有遠距離或者全局的信息。

上面這兩段話就是S3IM的motivation。

為什么有結構信息更好?

這是一個很好的問題。

但我們先回答另一個相關的問題,為什么NeRF的性能指標要有3個——PSNR、SSIM和LPIPS?

PSNR就是像素之間point-wise的度量。很早大家就發現,PSNR好不代表真的就好。

SSIM(結構相似性)作為一種和人類視覺感知相關性更高的度量在2004年圖像評估領域應運而生。

LPIPS則是一種通過預訓練神經網絡提取特征計算特征距離的指標(一般叫做感知指標)。

SSIM和LPIPS其實都具備衡量兩個像素集合之間相似性的能力,而且與人類視覺感知相關性都比PSNR高。

熟悉NeRF的讀者都知道,傳統NeRF訓練時是用MSE Loss。而PSNR和MSE其實就是一個簡單的對數關系。

MSE和PSNR這類point-wise指標都是不夠好的。一方面是和人類視覺感知相關性低,另一方面則是無法捕捉多個像素(像素集合)的整體信息。

那么SSIM和LPIPS可不可以直接作為NeRF的loss訓練呢?

其實也可以,但仍然不夠好。

因為SSIM和LPIPS都是基于卷積核的相似性度量,它們只能捕捉相近像素的局部信息,不能捕捉更遠的像素包含的結構信息。

我們的ICCV工作就是把SSIM(Structural SIMilarity)這個經典圖像質量評估指標升級,變為S3IM(Stochastic Structural SIMilarity)。

這個升級方式也很簡單。SSIM只能在圖像local patch用卷積核對吧。

那我們把NeRF訓練時每個minibatch的像素隨機拼接成一個patch(叫做stochastic patch),然后再用SSIM處理這些stochastic patch就行了。

有時候,真理就是這么樸實無華啊...

知名3D幾何重建開源框架SDFStudio也已經把S3IM方法合并進去了。

最后再放一個量化的實驗結果。表里Multiplex即是我們的S3IM方法。

S3IM這個工作是我們Machine Learning for Fields系列工作的一環。我們在從機器學習的角度考慮場的問題。

無論是神經輻射場還是其他什么場,廣義來說都是某個coordinate-wise的物理量。NeRF只是把輻射場的物理先驗知識(空間中包含發光氣體)嵌入了sampling的部分而已。這對3D場景表示不是完美的,但確實非常有用,也掀起了熱潮。

-

圖像

+關注

關注

2文章

1094瀏覽量

41080 -

Magic

+關注

關注

0文章

53瀏覽量

10715 -

可視化

+關注

關注

1文章

1250瀏覽量

21685

原文標題:ICCV 2023 | 即插即用!百度提出S3IM:用于NeRF提點的Magic Loss

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

評論