OpenAI分裂大戲終于告一段落。在短短數天內,創始人Sam Altman被掃地出門,先是談判破裂,高調宣布加入微軟,又在超700名OpenAI員工聯名抗議后,重回帥位。

這一切看似塵埃落定,但伴隨著此次OpenAI紛爭,一個潛藏的深層次議題浮出水面:考量AGI的未來軌跡時,有兩種觀念:一方面是“有效加速主義”,主張無條件加速技術創新,快速推動社會結構的顛覆;另一方面是“超級愛對齊”,強調在AI發展過程中必須注入對人類的深層關懷與愛,以確保AI對人類的安全性。

歸根結底,這場博弈背后,有一個看似宏大,但關系到每個人生活的終極問題,AGI到底是工具,還是數字生命?

什么是通用人工智能?

1)一張圖講清AGI&TSAI

人工智能的概念其實很早就有了,至少在AlphaGo戰勝人類第一圍棋手李世石時,大家就對它有所了解了,但當時為什么沒人站出來討論范式轉換和人類未來呢?2022年11月30 日,ChatGPT問世,才改變了我們對未來的思考。

假如去年的我來聽我今天所講的內容,我一定會認為這是天方夜譚,像是科幻小說里的情節。過去一年所發生的事情,使得我今天分享的PPT版本可能已經迭代了十版以上了。這個領域進展得太快,超出每個人的想象。

那么,為什么我們會把ChatGPT和之前的人工智能作出如此之大的區分?我給大家做一個簡單的類比,如果在我的左邊是類人猿,在我們的右邊是現在的人類,ChatGPT和以前的人工智能的區別就是猴子與人的區別。

在左邊以AlphaGo為代表的人工智能,被稱為TSAI(Task-Specific AI),可能它下圍棋很厲害,可以超越所有人類,但是它無法有其他的功能。但是右邊的人工智能,被稱為AGI(Artificial General Intelligence),它不僅能下圍棋,還能開車,能像人類一樣做很多事情。

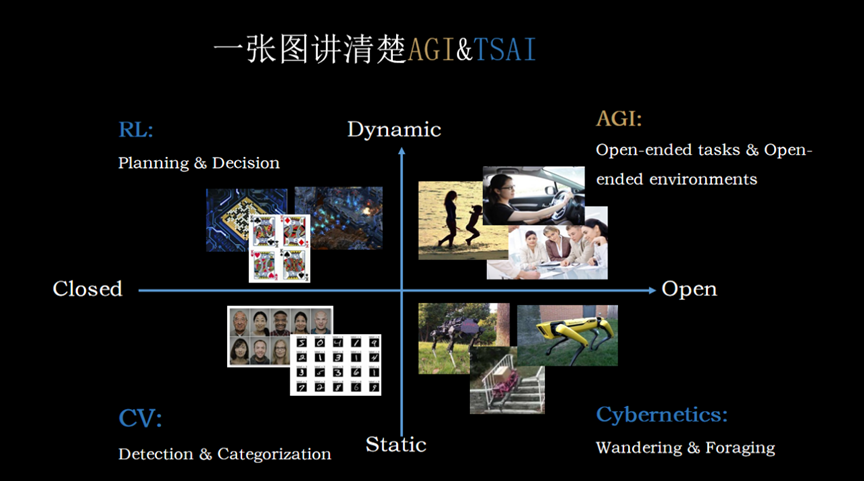

用一張圖來講清楚AGI和TSAI的一個區別。

X軸代表環境的復雜度:左邊是一個封閉的環境,只允許做有限的事情。而另外一端是開放的環境,是一個廣袤的世界,可以做任何事情。Y軸代表你要去完成某個任務時所采用的策略:一邊是靜態的策略,一邊是動態的策略。

接下來,我們把現在已知的所有人工智能全部放入這四個象限里面。

第三個象限是我們傳統的CV,也稱為計算機視覺,這是過去十幾年里創業主要集中的領域,比如面孔識別、語音識別、文字識別等。這一象限是封閉環境里的靜態策略,比如面孔識別只需要把辨認面孔這件事情做好就行,不需要再有其他功能。另外,靜態策略意味著一旦訓練完成,就不會再變,它指向單向的、簡單的任務。

第二象限是以AlphaGo為代表的人工智能,是以強化學習為主要手段的一系列的人工智能的產品,比如說它可以下棋、下德州撲克等。這些產品在軍事領域里得到了廣泛的應用,比如說無人機作戰。在這一象限里,人工智能逐漸已經達到或部分超越了人類的能力。

第四象限處在一個開放環境里,但它的策略為靜態。比如波士頓Dynamic的機器狗,它能在沙漠里、雪地里、草地上行走,但是策略相對簡單,就是保持平衡,向前移動。

這三個領域就是我們所說的傳統的TSAI領域。

然后來看人類皇冠上的最后一顆明珠,我們人類最后的尊嚴就集中在這一象限,也就是我們稱之為AGI所在的象限。它的展現其實非常簡單,可以跟朋友聊天、帶家人去海邊玩,開車四處游蕩等等,這就是我們每個人每天做的事情,看上去平平無奇,但它有兩個非常了不起的特點。

第一個特點是“任務的切換”。你和同事開會時所采用的任務策略和帶家人去旅游所用的策略是完全不同的,所以說策略需要動態的調整。

第二個特點是“環境”。當你在星巴克喝咖啡與在足球場踢球時,所處的環境也是完全不同的。

這就是AGI所觸碰的領域,它是在開放環境里的動態策略。我們通常認為,這類人工智能會在500年后實現。而以ChatGPT為代表的大語言模型的出現,讓我們對人類未來的暢想提早了500年兌現。

2)ChatGPT背后蘊含了巨大能量

假設你去問ChatGPT,你到底能做什么?它會回答出四件事情:提供信息、回答問題、進行對話、生成一些創造性的內容。聽起來似乎很平常,與人類每天所做的事情大致相似,但其實這背后蘊含了巨大的能量。

我給大家舉幾個簡單的例子。

一個媽媽問ChatGPT:“我的五歲寶寶總是提到一只超級向日葵刺猬Larry,我問他,這個生物究竟長什么樣子,他卻說不出來,說你能告訴我這只超級向日葵刺猬Larry長什么樣子嗎?”ChatGPT立馬給出了相應的圖像。然后,媽媽又接著說:“現在我要哄小孩睡覺,你能給我編一個關于超級向日葵刺猬的一個睡前故事嗎?”立即,ChatGPT寫出了一個相關的故事。

“柳樹Willy非常的傷心,感覺自己不像其他植物那么有用。Larry看到了Willy垂下的枝條,問道,嘿,Willy,你為什么拉長了臉?Willy說,我希望成為一個像你這樣樂于助人的人。Larry笑著說,Willy,你已經是了,每當有疲憊的旅人經過的時候,他們都會在你的樹蔭下休息,風一吹,你的樹枝就會翩翩起舞,奏出美妙的樂章。在這片草地上,我們每個人都有特別的使命。Willy笑了,他意識到自己也有自己的用處。”

你看,這不是一個簡簡單單的哄小朋友睡覺的故事,它的文辭優美,而且背后蘊藏了一個非常深的哲理,每位成人也是能夠有感受的。它竟然是ChatGPT所編出來的。

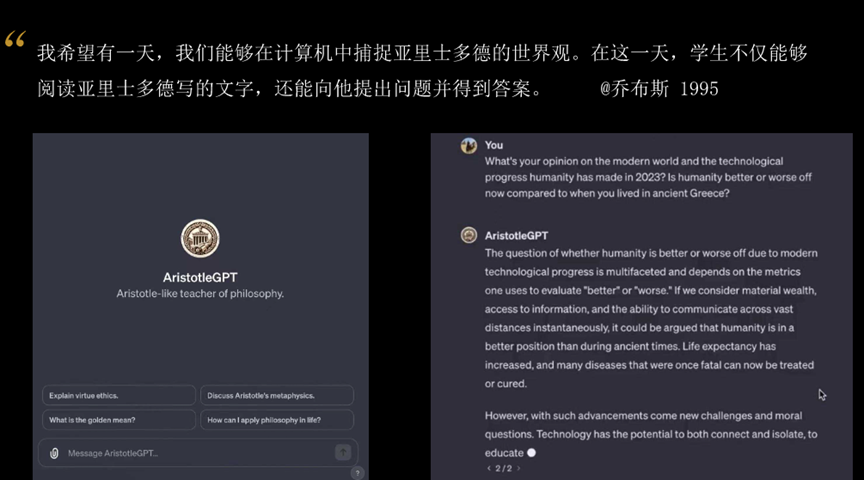

喬布斯在1995年接受訪談時,說了這么一句話,“我希望有一天,我們能夠在計算機中捕捉到亞里士多德的世界觀。在這一天,學生不僅能夠閱讀亞里士多德寫的文字,并且還能夠向他提出問題并得到答案。

今天,你也可以借助ChatGPT來輕松地完成這一切。把亞里士多德的所有文字上傳給ChatGPT,再告訴它說我希望你以文檔里面的思想、表達的方式來與我進行對話。你就創造出了一個虛擬的亞里士多德。如果你問它,2023年,這個世界變得更好還是變得更壞了?它會從技術上、人文方面為你分析。這個時候,你真的就像在和一個智者對話。它可能從根本上在改變我們的思維方法。

此外,OpenAI的首席科學家伊利亞最近接受《麻省理工科技評論》的采訪時就表示,用戶可以使用AGI做很多不可思議的事情,比如讓自動化醫療保健比醫院便宜一千倍。

混沌教學的時候,我們經常說,能有十倍好,就是一個很好的方向。現在不僅僅是十倍好,是效果好一千倍,價格低一千倍。那行業迎來的就不再是迭代更新,而是顛覆性的改變。

AGI的實現之路

既然ChatGPT這么厲害,它從何而來?為了回答這個問題,我們必須追溯過去幾十年里人類為探索通用人工智能所做出的一系列努力。我們試著分析人類探索通用人工智能的幾條道路。

1) 巴普洛夫的狗,行為的強化學習

巴普洛夫的狗聽見鈴聲就會分泌唾液。怎么做到的?在實驗里,工作人員給狗端上食物之前會搖一下鈴鐺,然后再把食物然后端給狗。一般來說,狗看見食物會天然地分泌唾液,而端上食物之前搖鈴鐺的動作持久重復之后,狗僅僅聽到鈴鐺響聲就會流下唾液,形成了我們通常所說的條件反射。在學術界,這一過程被稱為強化學習。強化學習的底層邏輯就是獎勵,這一點被用來塑造各種各樣的行為,比如在馬戲團里猛虎能夠穿過火圈。

強化學習的奠基人Sutton發表過一篇文章,標題簡單粗暴,Reward is enough。意思是要實現通用人工智能,只要有一點就可以了:強化。

2)人類神經系統,腦的智能進化

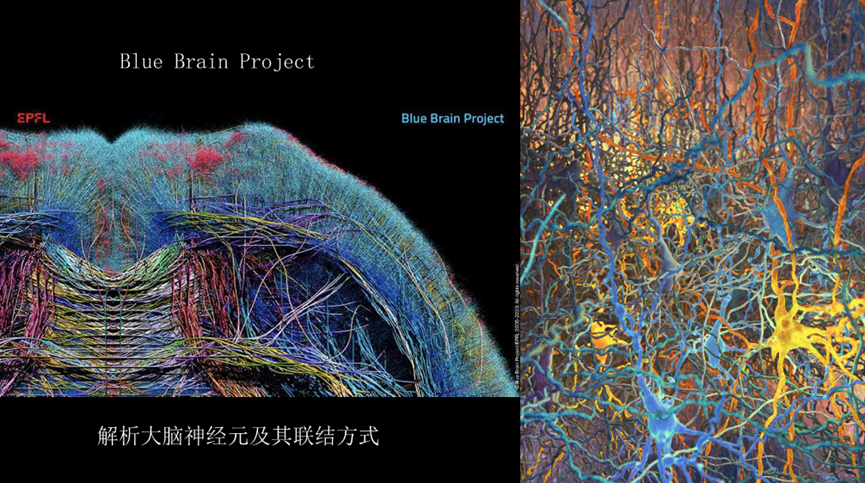

人類的智能行為由大腦產生,因此了解大腦究竟是如何運作的,就能產生相應的智能,這背后的邏輯是進化。例如,線蟲只有302個神經元,它只能作出非常簡單的行為,每天在水里面游來游去,碰見食物就吃,碰見天敵就躲。果蠅有百萬個神經元、斑馬魚有千萬個神經元、老鼠有上億個神經元……可以說,隨著神經元的增加動物的能力越強。

那是否先弄清楚線蟲,再弄清楚果蠅、斑馬魚……逐漸往上推,就能慢慢從低等生物的智能逐漸演化成高等生物的智能?其實我們的文明也是這樣產生的。1903年,第一架飛機飛行家一號,它只能飛200米,離地的高度不超過20米,但今天飛機已經能到達任何地方。

那從這個角度上來講,我們能不能通過研究大腦究竟是怎么工作的,它的結構和功能是什么樣子,來產生AGI?以歐盟為代表的藍腦計劃,就去解析了大腦的神經元,它的突觸,怎么和其他的神經元產生連接,怎么來構建一個這種復雜的大腦。試圖通過理解大腦的構成、結構,來實現它的功能。這是在過去幾十年里腦科學的努力方向。

3) 實驗室玩具被忽略的一環,思考與認知

時至今日,我們取得了很多成果,但沒有取得較為有顛覆性的突破。為什么?假設我們是這只狗,當鈴鐺響起的時候,也許腦海里面在進行一個思考,“鈴聲響起來了,食物還會遠嗎”?模仿了行為,模仿了大腦,但是卻沒有去模仿狗的靈魂。把靈魂換成一個科學的術語來講,是什么?就是我們的認知和我們的思想。它只針對于模仿人類的行為,卻忽略了人類的思維和認知。而這,就是大語言模型解決的真正問題所在。

那什么是我們思維的基礎和載體?語言。我們所有的思想都以語言的形態呈現。Oliver Holmes曾說:“語言是靈魂的血液,思想在其中運行,并且從中生長出來。”在他看來,語言是一個載體,是我們思想的溫床,讓思想從中不斷地發展。

維根斯坦說的更加直白,他說:“語言的邊界即世界的邊界。”需要注意的是,維根斯坦口中的“世界”不是指物理世界,而是思想世界。也就是說,但凡語言不能觸達之處,思想也無法觸達。

科學家們開始思考,我們是否可以通過理解人類的語言,從而讓人工智能獲得像人類一樣的思考能力。所以說,大語言模型的本質是大的認知模型、思想模型,它是通過理解語言、學習語言,從而模仿人類的思考方式。

人工神經網絡之父Geoffrey Hinton做出過一個比喻,他說,毛毛蟲提取營養物質,然后化繭為蝶,而人類已經提取了十億思想的金塊,這就是我們的語言。ChatGPT-4正是人類的蝴蝶。

計算機通過吸收人類思想、人類所積攢的幾千年的文字學習應該怎樣使用語言進行表達。不是思考怎么說出一句流暢的話,而是思考應該怎么像人類一樣思考,AGI就這樣產生了。使我們人類的思想、文字,成為它真正的奠基。

4)語言,即思考的金塊

我們現在面臨著一個很重要的問題,如何提取這個思想的金塊?要回答這個問題,需要先回答一個更底層的問題——思想的金塊是怎么產生的?

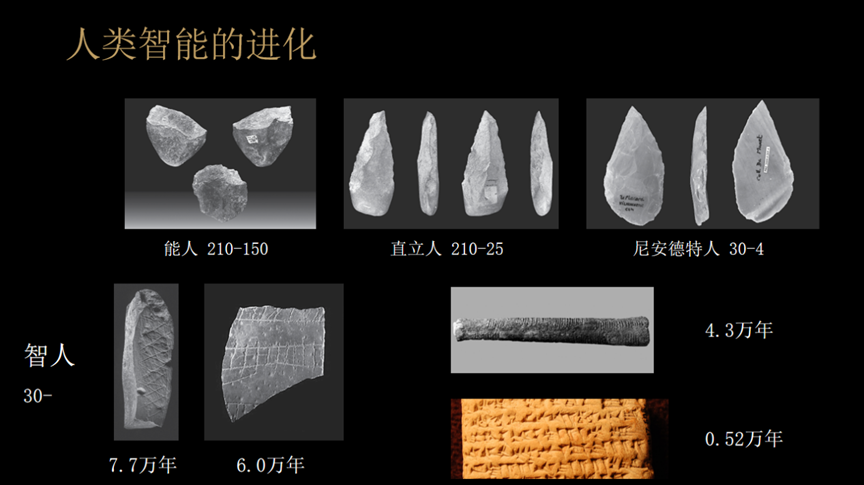

從考古學的角度來看,人類和猴子大約在300萬年前分道揚鑣,從這之后,人類的發展其實非常緩慢。但是在距今7萬年到10萬年的時候,人類出現了一次飛躍,各種各樣的石器涌現而出,各種各樣的發明層出不窮,這被稱為人類的第一次認知革命。這次認知革命使得人類從萬物之中的一員變成了萬物之靈,進而成為這個世界的主宰。

這次認知革命究竟發生了些什么?

通過考古可發現,人類從能人到直立人,再到尼安德特人,所做出的的石器越來越精巧,但是本質上卻沒有改變。所以,從能人誕生的210萬年前到尼安德特人所誕生的30萬年前,這整整的一段時間里面,我們可以把它稱為人類進化的垃圾時間。但我們的祖先出現了,也就是“智人”,智人最后戰勝了尼安德特人,形成我們今天的在座的各位。

考古發現,在距今7.7萬年前打造的一個石斧上出現了一些刻痕,同樣,在距今6萬年前的一個鴕鳥蛋的蛋殼上也出現了一些刻痕,這些刻痕正是當時人類對世界運作的記錄,反映出他們對世界的理解。直到5000到6000年前,人類開始在黃泥板上刻下痕跡,形成了我們今天稱為的楔形文字,從那時候起,人類把自己的思想灌輸在文字之中。

能人和智人,兩者之間有一個非常大的區別——智人大腦的體積是能人大腦體積的三倍。從進化史的角度看,這是一個奇跡般的變化,因為沒有任何一個物種能夠在進化尺度上面發生如此大的變化,只有人類做到了。所以說,過去人類在悄悄地增大自己大腦的體積,當它大到一定程度的時候,我們的智能就涌現出來了。

5) 選個好基因來打籃球

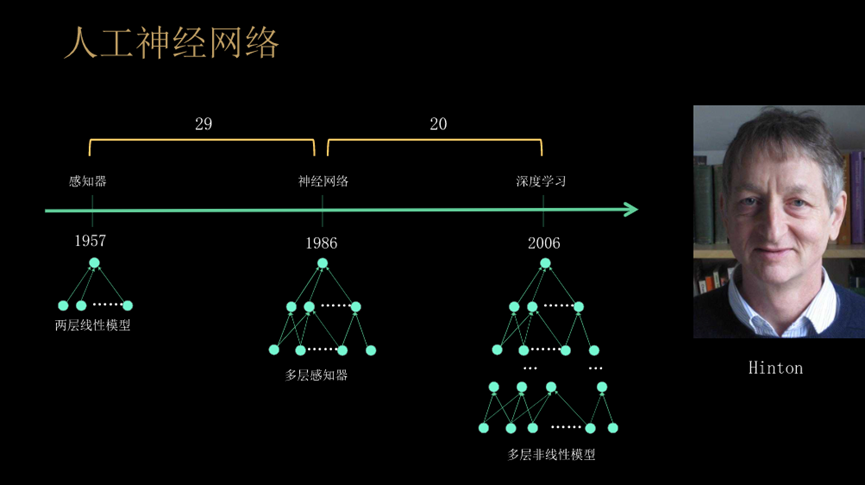

我們發現的這個史實,對AGI產生來說是一個至關重要的觀點。“選個好基因來打籃球”,這就是人工神經網絡背后發展的一個底層邏輯。也是是Hinton窮奇他一生要實現的一個目標:讓一個神經網絡能夠大起來,而且可以進行訓練。

最早的人工神經網絡出現在1957年,Rosenblatt提出的感知機。只有簡單的兩層線性模型,很多人覺得干不了任何事情,經過將近30年的漫長等待,Hinton提出通過回傳算法(BP算法),讓兩層的感知機能夠變成一個多層感知機。它的層數增加相當于我們祖先的大腦變大,只有當大腦變大了,才能夠擁有智能。

然后,經過20年的時間,Hinton把線性的多層模型拓展為非線性多層模型。非線性的意思是讓參數盡量復雜化,用參數的復雜化應對我們思想的復雜化。也就是說,只有我們的參數足夠大、復雜度足夠高,才能去容納復雜的思想。

當時,Hinton的觀念提出之后并沒有引發很大的反響,甚至很多人認為太瘋狂。但是Hinton十分堅持,用一生的時間推進這個想法。他曾經在一次采訪中表示,不放棄的原因在于堅信其他人都錯了。他的底層邏輯在于,大腦就是這樣的網絡,大腦能工作,人工神經網絡沒有理由不工作。

在當下,我們進一步發現人工神經網絡越復雜,層數就越多;參數越多,它就越深。如此一來,會越來越接近人類的大腦。正是在此發現的推動之下,在2020年5月,終于出現了當時被稱為暴力美學的事件——GPT-3的問世。

G代表生成式,P代表不需要監督的學習,T是基于一個架構,這就是Google發明的Transformer。GPT的目標在于“大”,主要體現在三個方面。

第一方面是大算力。當時為了讓這個模型運作起來,微軟專門設計了一臺超級AI計算機,這臺計算機的算力是當時世界排名第五的超級計算機,目的是用來訓練GPT-3。

第二方面是架構極其復雜。GPT總共有1750億個參數,比上一代多了兩個量級,相當于多了100倍的參數量,是一個非常龐大的體系。

第三方面是數據量非常大。英語維基百科大約有600萬篇文章,而這只占GPT的訓練材料的千分之六。可以想象它的數據總量有多龐大。

當時訓練一次GPT-3的費用高達500萬美元,但遺憾的是,當這個模型推出來的時候,并沒有像今天一樣震驚世界,反而被認為是一個笑話。當年6月,我在智源人工智能大會上也質疑過GPT-3,我說:“當我問GPT-3我們的腿有多少只眼睛,它會嚴肅地告訴我,我們的腿有兩只眼睛。當我問它太陽有幾只眼睛,它會說太陽有一只眼睛。”當時的GPT確實比較低能,根本不理解“眼睛”的概念,它所產生的答案是隨機的或是“鸚鵡學舌”,沒有自己的思考能力。別說社會上,在學術圈里面,大家都感覺GPT就是曇花一現。

6) 重要的思想實驗

但是我們錯過了非常重要的一點。我們可以做一個思想實驗:一個現代的嬰兒如果回到3000年前,他會不會比原始社會的嬰兒更加聰明?

答案是否定的。因為3000年不可能使得我們的基因發生根本性的變化,現在的嬰兒和3000年的嬰兒幾乎一模一樣。

再設想一下,我們如果把一位成年人送回到3000年前,他會不會比當時原始部落的人聰明?答案是肯定的。因為一個正常的成年人具備一定的知識,即使他的文化程度不高,也足以碾壓當時最聰明的人。

那么,為什么嬰兒跟原始部落的嬰兒一樣的笨,而成年人回去就可以在思想上碾壓一切人類?

道理非常簡單,一個人的思維成長離不開教育。當時GPT具有完美的基因,但是它還缺乏教育。從2020年5月份GPT-3推出到2022年11月30號ChatGPT推出,在這兩年的時間里面,OPenAI對GPT-3進行了再教育。其中,主要有三個方式:

第一個方式是引導大語言模型產生更具有對話性和互動性的回應。由此還出現了一個新職業,叫做“提示工程師”,他不需要懂任何的編程語言,只需要告訴大語言模型應該如何執行命令,被稱為“通用人工智能的教師”,它的工作是對通用人工智能進行“授業”。

光“授業”還不夠,還需要第二種方式,名叫RLHF(基于人類反饋的強化學習)。比如當你向大語言模型提問時,它可以產生五個回答,但是不確定哪個回是更好。這時候就需要人類給它一個反饋,告訴它其中哪個答案最好、哪個答案一般,哪個答案很差。讓大語言模型逐漸掌握好答案的規律。

第三種方式為“對齊”(Alignment),讓大語言模型的目標行為和決策過程與人類的價值觀、目標和意圖一樣。也就是說,我們要讓大語言模型的人生觀、世界觀、價值觀與人類對齊,而不是摧毀我們的文明,把我們引入歧途。比如,如果你讓大語言模型給你一份制造炸彈的手冊,盡管它具有這個知識,但它也不會給你。因為它知道這是不符合社會規范的行為。

在過去兩年半的時間里,大語言模型有了徹底的改變,從一個弱小的嬰兒變成了一個優秀的成年人。它有強大的基因和先進的教育,還有超級強悍的經濟支持,這三方面的合力激發出這一次偉大的奇跡。

第四次工業革命的出現

1)為了計算與人類未來

ChatGPT出現之后,究竟帶給人類怎樣的改變?它的目的是掙更多的錢嗎?是有更高的商業價值嗎?

薩姆·奧特曼在接受美國國會的質詢時,被問及創造通用人工智能的動機,他表示他從OPenAI拿不到一分錢,也沒有股票,他做這件事情的唯一原因就是“喜歡它”。他的眼神堅定,態度十分肯定。

2016年8月英偉達制造出世界上第一個超算DGX,價值為百萬美元以上,當時有很多公司都在爭搶這臺超級計算機,但是黃仁勛把第一臺捐給了OpenAI。他在這臺捐贈的機器上寫下了這么一段文字:為了計算和人類的未來,我捐出世界上第一臺DGX-1。

這個簡單的行動促進了一個閃耀的日子在六年后誕生——ChatGPT出現了。那么現在回答一個根本問題:什么是人類和計算的未來?要回答這個問題,就必須談到范式轉換。

2)真正意義上的范式轉換

1962年,庫恩在《科學革命的結構》里面提出這一概念,他認為,科學的進步不是通過漸進的知識積累來實現的,而是通過一系列的革命實現,其中一種主導的范式被另外一種所替代。因此,我們要用一種全新的思維方法,全新的世界觀,全新的認知去顛覆過去的那些觀念和世界觀,這就是范式轉換。

如何理解這句話?

舉個例子,阿加莎·克里斯蒂在1919年的時候生下一個小孩,當時的她還未出名,一家的年收入是700英鎊,是一個典型的倫敦中產家庭。但是她卻在自傳里說:“我們永遠想不到有一天會擁有汽車,這是一個奢侈的念頭,只有富人才配有車,像我們這種中產階級是不配有車的。”當時一輛最便宜的汽車大約170英鎊,占據阿加莎一家年收入的1/4,是一筆非常大的開銷。

出乎意料的是,傭人一年的費用卻比汽車便宜很多倍,36英鎊/年。由于阿加莎剛剛生了一個小孩,她為小孩請了一個全職的護士,一年才40英鎊。而對這些傭人來說,買車更加是一件天方夜譚的事情。這就是一、二、三次工業革命要做的事情,就是逐漸把商品的價格降低。

所以說,過去這100年多的發展導致的一個根本性的影響是讓商品價格發生巨大變化,這就是我們通常所說的摩爾定律。摩爾定律最開始是被用來表達計算機CPU的性能的提升,后面逐漸用于商品行業。根據匯率估算,我們現在1美元能購買的算力是過去幾十年的幾十倍、上百倍,甚至上千倍。比如,80年代我們家購買了一臺黑白電視機,花光了家里好幾年的積蓄,而現在的電視機要便宜太多太多了。

在過去100年間,商品價格急劇變化的同時,服務的價格也產生了很大的變化,但是它的價格不是下降,而是明顯上升。例如,在1923年的倫敦,雇傭護士的價格為年薪25英鎊到50英鎊,2023年上漲至24000到30000英鎊左右,即使扣除了物價上漲的因素,依然可以發現今天的人力成本是過去的12倍。

3)萬物摩爾定律

這個時候,Sam Altman在思考一個問題:怎么才能獲得美好的生活?使個人更加富有就能過得更好嗎?他覺得不行,因為當你有了更多的錢,就意味著我會有更少的錢,貧富差距會變得越來越大。

于是他提出了一個大膽的想法,叫做物價下跌,讓所有商品的價格、服務的價格歸零,我們隨之就變得更加的富有了。他說,AGI將創造驚人的財富,一旦有足夠強大的人工智能加入勞動力大軍,會使得驅動商品和服務成本的勞動力的價格將逐漸歸零。他將此現象稱為萬物摩爾定律。

這一段話,Sam Altman并沒有公開說,而是把它貼在OpenAI一個特別不起眼的地方。那么怎么來實現?他給出的回答是AGI通用人工智能。

那時候,ChatGPT還沒有問世。他不求錢,也不圖股份,甚至不圖名利,做這件事的所有動因全在于要改變人類社會,推動人類的第四次工業革命。到那時,基于知識的服務價格會全部歸零,包括教師、律師、會計、程序員等。所以,也許此刻的你正面臨著失業的風險。

失業該怎么辦呢?薩姆·奧特曼認為由于AGI創造了很多財富,使得一部分人失業,而那些失業的人可以去追求自己想要的生活。這部分人的生活資金會來自于一個叫Universal Basic Income的計劃,該計劃會將人工智能創造的大量財富回饋給所有人。每個成年人每月都能無條件地收到13500美元維持基本生活。在那時候,商品的價格歸零、服務的價格歸零,每個月13500美元可以讓我們過得十分富足而自由,不再為了基本的生活物資加班和奔波。只有那樣人類才會更有可能實現自我價值。

在古希伯來語里,“工作”與“奴隸”使用的是同一個詞。在AGI真正出現之后,人類將會從奴隸的身份里解脫出來,奔向想去的遠方。這一切聽上去像是科幻故事里的情節,但是薩姆·奧特曼堅信會在十年之內發生。他還在斯坦福大學專門建立了一個UBI的實驗室,用以討論這事情的實現途徑。另外,他在巴爾的摩的某個社區里開始推廣這個計劃,在行動上真正地想要改變人類的生存方式,讓“按需分配”成為可能。

4)AI Agent的出現,從先知到助手

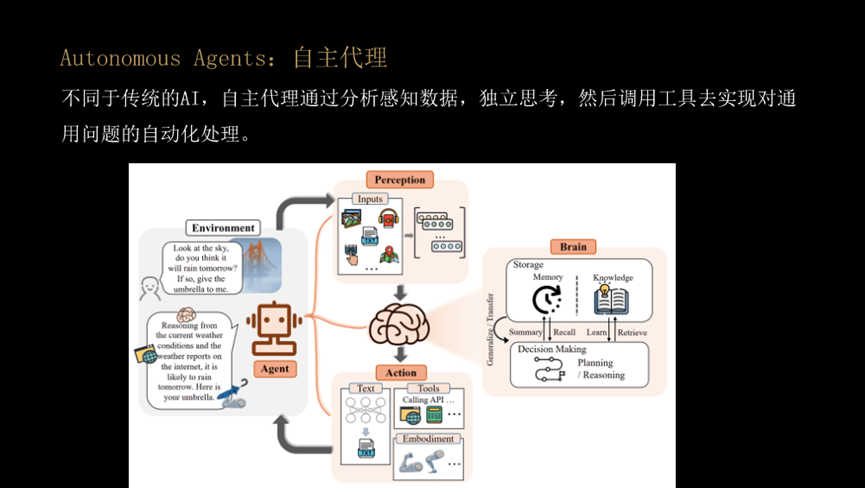

ChatGPT僅僅用來與人類對話肯定是達不到“幸福生活”的標準的,還需要讓它分擔勞動。因此,AGI需要往下一步走,變成一個助手。于是,從今年2023年5月份開始,一個全新的東西開始在逐漸成型,這就是ChatGPT+Autonomous Agent,也就是自主代理。

自主代理不同于傳統的AI,它通過分析感知數據、獨立思考、調用工具,實現對通用問題的自動化處理。也就是說,大語言模型能思考、能預測,也能做判斷。

兩周之前,OpenAI推出了GPTs,它是結合指令、私有知識以及各種技能組合的定制版ChatGPT。

什么叫GPTs?GPTs就是我剛才提到的的自動代理,Autonomous Agent,我們現在不需要有高明的編程技巧,結合指令、私有知識以及各種技能組合,你就可以得到定制版的ChatGPT。

喬布斯在1995年所夢想的東西,就是眾多GPTs中間的一個。在不到兩周時間里,全世界已經涌現了上千個GPTs,每個人都可以去共創。這必然會導致商業范式的根本變化。

眾所周知,大約是在20年前,信息行業不再售賣硬件,轉為售賣服務,這就是著名的XaaS(Everything as a Service),那么它的最底層是Infrastructure as a Service(基礎設施即服務)。比如,微軟當時給GPT-3所提供的超級計算機就擔當了這樣一個功能。

在它之上是Platform as a Service(平臺即服務),它提供操作系統和數據庫等基本內容,使用者可以在這基礎上開發自己的軟件然后提供各種服務,這就是所謂的“云計算”。比如說阿里云、騰訊云。

繼續往上是SaaS,Software as a Service(軟件即服務)。它使得我們無需專門買某個軟件了,可以直接拿來用。比如iCloud,Slack等。

但是隨著大語言模型的出現,基于大模型生產服務的生態就會出現。這會涌現出一個非常大的機會——開源生態。

當OpenAI推出ChatGPT系列之時,所有的人工智能廠商都覺得自己沒有希望了。在這個時候,Meta作出了一件異乎尋常的舉動,把當時還未開發完全的LLM,也就是“羊駝”系統拿去開源,供所有人使用。消息放出之后,上百萬的程序員為擁有自己的開源系統而歡欣鼓舞。在短短的五個月之內,一個龐大的“羊駝家族”就此產生,每個人在其中不斷地添磚加瓦,使得這個開源系統達到了OpenAI較初級版本的性能,讓每個人可以基于大模型展開創業。讓每個商業都可以擁有自己的大模型。

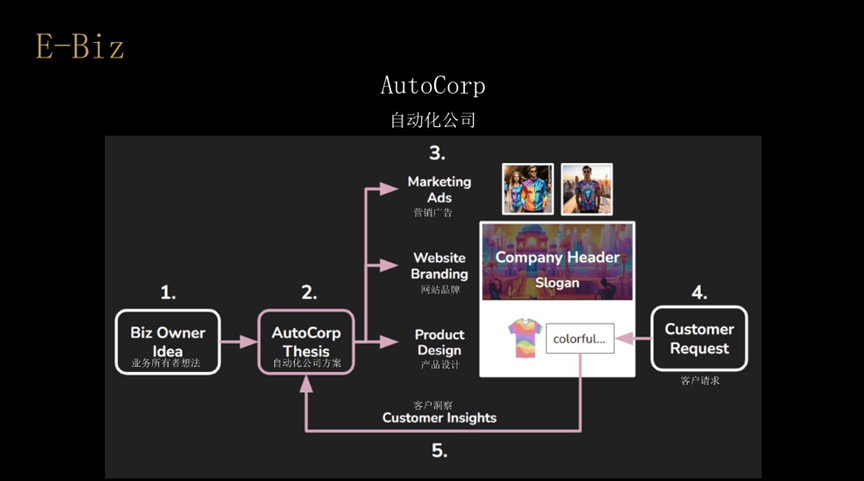

有了大模型之后,下面一步需要做的是Agent as a Service,也就是每個人都可以創造自己的GPTs,把自己的私有知識放進去,構建出一個服務大眾的平臺。更重要的是,將來的商業模式會因此發生翻天覆地的變化,一個人可以構建一個E-Business。也就是說,一家公司不再需要一堆人運行,只需要三兩人就能夠運轉。

因此我們不難理解OpenAI聯合創始人Andrej Karpathy所說的那句話:“普通人、創業者和極客在構建Agents方面比OpenAI更有優勢,大家處于平等競爭的狀態。”因為雖然我們在大模型賽道上沒有太大的機會,但是在助手這一領域里,所有人都是平等的。此時此刻,一家只有兩三人的公司顛覆一家上百、上千人的公司成為可能,因為壁壘已經打破,有創意者才是贏家。

…… 篇幅所限,本文內容僅為課程十分之一,

點擊海報,觀看完整課程!

第二次認知革命已經到來

1) 知識工作崗位的困境

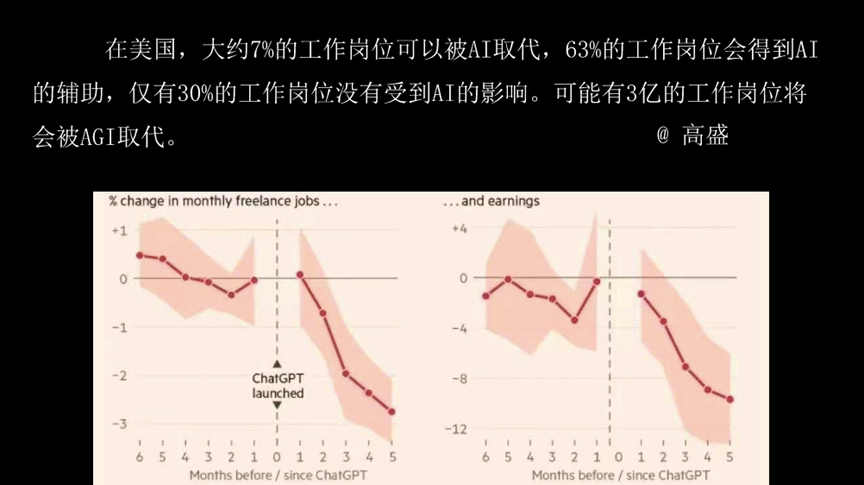

知識服務的價格降低意味著很多的工作崗位會受到影響。

美國高盛做了一個調查,調查表明,美國大約7%的工作崗位可以被AI取代,63%的工作崗位會得到AI的輔助。也就是說,不懂AI,就很可能面臨失業。我們還可以看到,ChatGPT出現后自由職業者的需求跳水式地下降,同時價格然后也在跳水式地下降。僅僅幾個月就發生了這樣的變化。因此我們可以預想,隨著AGI的進一步發展,變化只會更加劇烈。

2)如果AGI只有理性的秩序,沒有感性的溫度

在更宏大的范疇,它會帶來什么呢?假設我們讓它解決溫室問題呢。通常來說,此時的ChatGPT會先分析一番,查看造成氣溫上升的主要原因,我們都知道原因在于“人類的存在”。那么,接下來該怎么做?消滅人類嗎?這肯定是最有效的方式。AGI會選擇這樣做嗎?

“消滅人類”無疑是一個理性的解決方案,但它缺少一種本質的思考和感性的溫度。因此,僅有科學的理性,就可能會導致一些災難性的事件。

因此,當OpenAI取得重大成果的時候,很大一部分人拉響了警鈴。在5月30號,薩姆·奧特曼和其他大型AGI公司的負責人聯合發布了一則聲明,這個聲明只有一句話:與其他社會規模的風險如大流行病和核戰爭一樣,降低人工智能引發的人類滅絕的風險應該成為全球的優先事項。

在此之前,美國政府出臺了一項政策,規定AI公司在訓練前沿大模型之前必須通知政府。也就是說,訓練大模型不再是公司個人的行為,而要進入政府的監管視線內。

目睹AGI以恐怖之勢發展的局面,人工神經網絡之父Hinton倍感擔憂,他意識到,這一切的開始只是為了人類的幸福,但是在此時此刻,它卻具有摧毀人類文明風險。

現在,我們打開了一個潘多拉魔盒,釋放出來的可能是美好,也可能是邪惡,該怎么辦呢?

原本Hinton深感絕望,從Google辭職養老。突然在一個月之前出現在公眾視野里,表示將擔任一家機器人公司的顧問,因為他看到該公司利用機器學習和視覺傳感器共同設計的方法,顯示出AI用于機器人技術的巨大潛力。

3) AGI的演化,從領域模型到認知模型

為什么他決定當顧問,是什么力量請他出山?因為他看到了一種解決大語言模型因為過于理性可能會對人類造成摧毀的一種方式。

即我們需要進入第三個階段,創造出真正的生成式的代理,完成我們的指令,這就是ChatGPT+Generative Agent。以前為自動代理,現在是生成式的代理,它們之間的區別在于從領域模型轉變為認知模型,這就是我們通常所見到的智能的三層次模型。在ChatGPT出現之前,存在著任務模型,它能夠完成特定的任務,比如識別面孔、下圍棋等。而在ChatGPT之后,任務模型變成了領域模型,它能夠完成特定的工作,比如教師、醫生、律師、司機等基于知識的崗位。

但領域模型還不夠,接下來它需要能聽、能看、能思考、能規劃、能行動。也就是說,我們即將創造出與人類相似的一個全新的物種,它不再停留在計算機機房里,而是出現在你散步的大街上。

4)AGI的“超級愛對齊”

這個時候,我們希望它具有什么樣的能力呢?我特別喜歡的一幅圖,西班牙的斗牛場上,感到身體不適的斗牛士,他靠在場邊,而第一個趕來的,來救助他的,是渾身插滿了劍的這頭牛。這頭牛沒有攻擊,而是默默地看著他。這時候我們能看到一種感性的成分,一種善良的成分在里面,而這種善良的成分必須要通過另外一種途徑來做到,怎么做到呢?

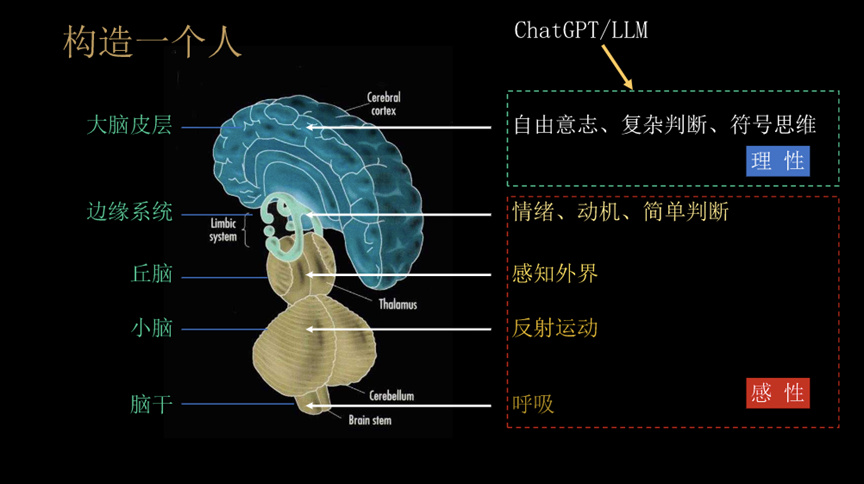

首先來看,我們如何來構建一個人。

在人的大腦里,最底層的腦干是呼吸的中樞,往上面走是小腦,他是讓我們能夠行走的一部分;再往上面走是丘腦,它能夠感知外界;再往上面走是邊緣系統,它能產生情緒、情感,作出一些簡單的判斷。最上面則是在過去300萬年里人類進化明顯的地方——大腦皮層,它的體積增加了3倍,與人類的自由意志、復雜判斷和符號思維有關。這一部分我們把它稱為理性,下面一部分我們把它稱為感性。

大語言模型學習的正是人類的理性,但它并沒有觸達人類的感性。也就是說,我們現在僅僅有科學的尺度,但是沒有情感的溫度。因此,接下來的工作是讓大模型獲得情感的溫度。

這里面講的感性,它擁有兩個特征:

第一個特征是“身臨”。我相信,就算我們看了很多旅游風光片、紀錄片,仍然想要親自去到那個地方,因為只有身臨其境,才會有真實的感受。

第二個特征是“體驗”。如果你假設你身處金門大橋腦袋卻充斥著工作內容,是不會有強烈的體驗感的,因此只有沉浸其中,才會有感性產生。

正如出身中產的切·格瓦拉只有在獨自騎行、經歷寒冷的夜晚之時,才會說出“那是我經歷的最冷的一晚,但那一晚也讓我稍稍靠近了人類。”歷史學家維拉斯說,格瓦拉的政治與社會意識的覺醒,與他直接目睹貧困、剝削、疾病與痛苦有關,而不是來自于書本的知識或者有學識人之間的討論。

與此類比,現在的ChatGPT相當于滿腹經綸,但還僅僅停留在機房里面,它沒有真正邁入世界。這就是為什么Hinton決定重新出山的原因。

一個新的方向開始生成,我們把這一塊叫做Generative Agent(智能體)。它不僅僅能夠幫人類完成任務,它還擁有欲望、擁有信念、擁有意圖,以及擁有行動能力。

智能體應該具有哪些特點?我們可以從三個維度理解:1、它要有多種的技能。2、它能夠處理各種各樣的情況。3、它必須和世界產生真實的交互。

一旦具有這三方面的能力,就不再是一個基座大模型,而變成一個基座代理。這是我們現在正在做的事情。

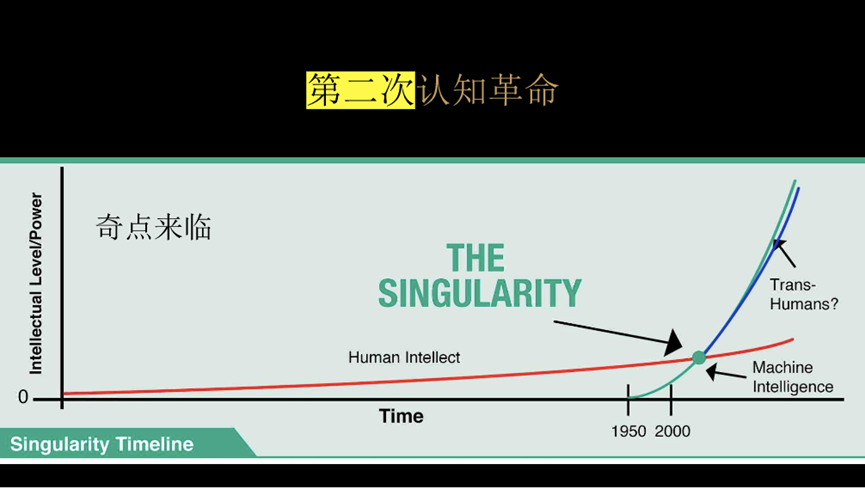

5)人類歷史上的第二次認知革命

前段時間,馬斯克推出了Grok,它類似于ChatGPT這樣的語言模型,但又與OpenAI走了一種完全不同的道路。他將Grok接入了Twitter里,讓Grok混跡于眾人之中和人類進行交流。他表示,現在這個大語言模型和OpenAI類似,但注重訓練它的同理心。

值得注意的是,當智能體一旦擁有意識之后,它就會按照自我的觀念快速發展,這時我們就可能會面臨一個奇點,文明的載體也不再以人為單位運行,而是以AGI的方式運行。因此,我把這個奇點來臨的時刻稱為“人類歷史上的第二次認知革命”。

我們經常談到認知革命,其實它們都不配。為什么?因為第一次認知革命使得我們的祖先成為萬物之靈,人類成為世界的主宰。而第二次認知革命,就是人類創造出了一個全新的物種。這天來臨的時刻,文明的火炬就要由我們人類傳到AGI的手中。

SoftBank的孫正義在最近的一次大會上表示,通用人工智能將在10年之內實現。按照他的預設,到2033年時,人工智能的智能程度將是人類智力總和的10倍,相當于人類和猴子之間的智力差異。

雖然這并沒有確鑿的依據,但我們試想一下,去年這個時候提到ChatGPT的駭人功能,絕大部分人都不會相信。但是事實證明,我們對通用人工智能的想象一定不要過于保守。因為一個新世界的大門正在徐徐打開。

我們的未來會是什么樣子?

其中一種可能,亦是所期望的,就像《星球大戰》里面的R2-D2,是我們忠實的助手,無微不至地照顧我們所有的一切。另一種可能,則像《終結者》里面的劇情,機器人試圖毀滅人類、主宰世界。

我覺得在未來還有第三種可能,這也是我們正要努力的方向,那就是人機合二為一。人類最脆弱的地方不是思想,而是肉體,因此有沒有可能讓我們擺脫脆弱的肉體,把我們的思想上傳到計算機里,獲得真正的永生。

這件事聽上去像是天方夜譚,但也并不是不可能。正如現在硅谷最火熱的兩個投資方向,一個是AGI,另一個是健康產業。如果人類能夠成功地人機合一的話,那么AGI它不僅不是我們的敵人,還會極大拓展我們對這整個世界的了解,從而不再被有限的生命束縛,真正地走向自由。

審核編輯:劉清

-

人工智能

+關注

關注

1800文章

48094瀏覽量

242227 -

OpenAI

+關注

關注

9文章

1184瀏覽量

6927 -

ChatGPT

+關注

關注

29文章

1579瀏覽量

8303

原文標題:清華教授劉嘉:OpenAI紛爭的潛藏原因 , AGI到底是“工具”還是“超級生命”?

文章出處:【微信號:CEOMakers,微信公眾號:CEO創客】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

OpenAI紛爭的潛藏原因:AGI到底是“工具”還是“超級生命”?

OpenAI紛爭的潛藏原因:AGI到底是“工具”還是“超級生命”?

評論