一、引言

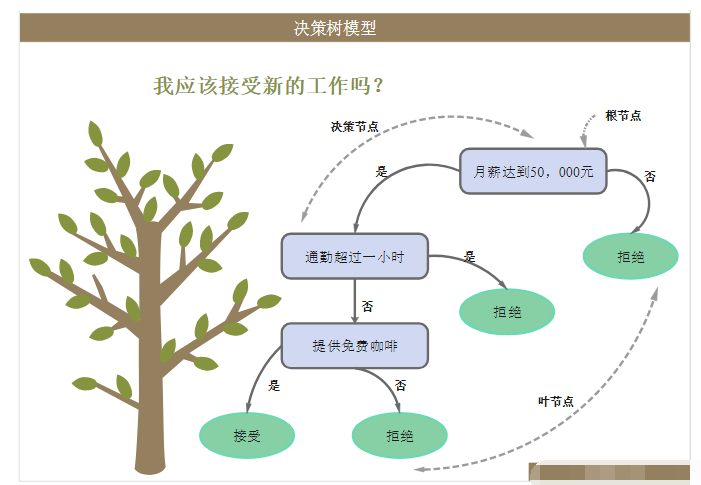

決策樹算法是機器學習領(lǐng)域的基石之一,其強大的數(shù)據(jù)分割能力讓它在各種預測和分類問題中扮演著重要的角色。從它的名字便能窺見其工作原理的直觀性:就像一棵樹一樣,從根到葉子的每一分叉都是一個決策節(jié)點,指引數(shù)據(jù)點最終歸類到相應的葉節(jié)點,或者說是最終的決策結(jié)果。

在現(xiàn)實世界中,決策樹的概念可以追溯到簡單而普遍的決策過程。例如,醫(yī)生在診斷病人時,會根據(jù)一系列的檢查結(jié)果來逐步縮小疾病的范圍,這個過程可以被視作一種決策樹的實際應用。從癥狀到測試,每一個節(jié)點都是決策點,攜帶著是否進一步檢查或是得出診斷的決策。

在機器學習的世界里,這種決策過程被數(shù)學化和算法化。我們不再是用肉眼觀察,而是讓計算機通過算法模擬這一過程。舉個例子,電子郵件過濾器就是決策樹應用的一個經(jīng)典案例。它通過學習識別垃圾郵件和非垃圾郵件的特征,比如關(guān)鍵詞的出現(xiàn)頻率、發(fā)件人信譽等,電子郵件過濾器能夠自動地將郵件分類為“垃圾郵件”或“正常郵件”。

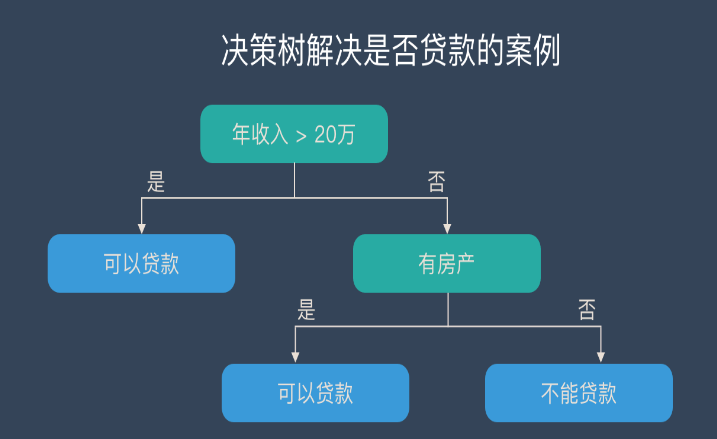

在更廣泛的機器學習應用領(lǐng)域,決策樹可以處理各種各樣的數(shù)據(jù),不論是數(shù)字還是分類數(shù)據(jù),它都能以其獨到的方式進行分析。例如,在金融領(lǐng)域,決策樹能夠幫助評估和預測貸款違約的可能性;在電子商務(wù)中,它可以用來預測用戶的購買行為,甚至在更復雜的領(lǐng)域,比如生物信息學中,決策樹可以輔助從復雜的基因數(shù)據(jù)中發(fā)現(xiàn)疾病與特定基因之間的關(guān)聯(lián)。

通過引入機器學習,我們讓決策樹這一概念超越了人類直覺的局限性,使它能處理遠超人腦處理能力的數(shù)據(jù)量和復雜度。它們不僅能夠基于現(xiàn)有數(shù)據(jù)做出判斷,還能從數(shù)據(jù)中學習,不斷優(yōu)化自身的決策規(guī)則,這是決策樹在現(xiàn)實世界中不可替代的意義。

決策樹之所以在機器學習中占有一席之地,還因為它的模型可解釋性強,這在需要透明決策過程的領(lǐng)域尤為重要。與深度學習的黑盒模型相比,決策樹提供的決策路徑是清晰可追蹤的。每一次分支都基于數(shù)據(jù)特征的顯著性進行選擇,這讓非專業(yè)人士也能夠理解模型的決策邏輯。

在本文中,我們將深入探討決策樹的核心技術(shù),從它的數(shù)學基礎(chǔ)到如何優(yōu)化算法以處理各類數(shù)據(jù)挑戰(zhàn),再到通過實際案例展示它們?nèi)绾谓鉀Q現(xiàn)實世界的問題。我們將走進決策樹的世界,了解這一技術(shù)如何在機器學習的眾多領(lǐng)域中發(fā)揮著它的重要作用。

二、決策樹基礎(chǔ)

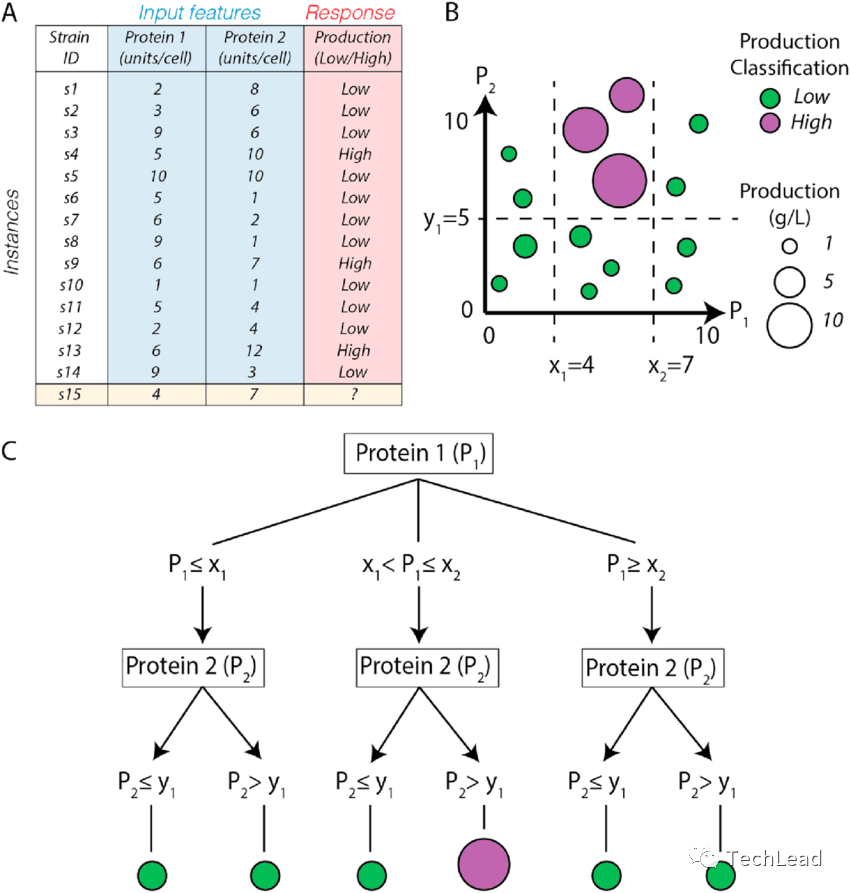

決策樹,作為一種符號學習方法,將復雜的決策規(guī)則轉(zhuǎn)化為一系列簡單的比較問題,從而對數(shù)據(jù)進行分類或回歸。它們通過遞歸分裂訓練數(shù)據(jù)集,構(gòu)建一個樹狀的模型。

決策樹模型概述

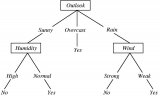

在決策樹中,每個內(nèi)部節(jié)點代表一個特征上的測試,每個分支代表測試的結(jié)果,而每個葉節(jié)點代表最終的決策結(jié)果。決策樹的構(gòu)建始于根節(jié)點,包含整個訓練集,通過分裂成子節(jié)點的過程,逐漸學習數(shù)據(jù)中的規(guī)律。

想象一下,我們面前有一籃水果,目的是區(qū)分蘋果和橘子。一棵決策樹可能首先詢問:“這個水果的顏色是紅色嗎?”如果答案是肯定的,它可能會將這個水果分類為蘋果;否則,它會繼續(xù)詢問:“這個水果的質(zhì)感是光滑的嗎?”這樣的一系列問題最終導致分類的結(jié)果,這就是決策樹的工作方式。

構(gòu)建決策樹的關(guān)鍵概念

特征選擇

決策樹如何確定在每個節(jié)點上提出哪個問題?這就涉及到一個關(guān)鍵的概念——特征選擇。特征選擇是決定用哪個特征來分裂節(jié)點的過程,它對決策樹的性能有著至關(guān)重要的影響。主要的特征選擇方法包括:

信息增益:度量分裂前后信息不確定性的減少,也就是說,它尋找能夠最好地清理數(shù)據(jù)的特征。

增益率:調(diào)整信息增益,解決偏向于選擇擁有大量值的特征的問題。

基尼不純度:常用于CART算法,度量數(shù)據(jù)集的不純度,基尼不純度越小,數(shù)據(jù)集的純度越高。

假設(shè)我們要從一個包含蘋果和橘子的籃子中分類水果,信息增益會衡量按照顏色或按照質(zhì)地分裂數(shù)據(jù)所帶來的信息純度提升。如果顏色的信息增益更高,那么顏色就是該節(jié)點的最佳分裂特征。

決策樹的生成

樹的生成是通過遞歸分裂的方式進行的。從根節(jié)點開始,使用特征選擇方法選擇最佳的分裂特征,創(chuàng)建分支,直到滿足某個停止條件,比如達到了設(shè)定的最大深度,或者節(jié)點中的樣本數(shù)量少于閾值。

舉一個現(xiàn)實生活中的例子,假如一個電信公司想要預測哪些客戶可能會流失。在構(gòu)建決策樹時,它可能會首先考慮賬單金額,如果賬單金額大于平均值,那么進一步考慮客戶的合同期限;如果合同期限短,那么客戶流失的可能性就更高。

決策樹的剪枝

為了防止過擬合——即模型對訓練數(shù)據(jù)過于敏感,從而無法泛化到新的數(shù)據(jù)上——決策樹需要進行剪枝。剪枝可以理解為對樹

進行簡化的過程,包括預剪枝和后剪枝。預剪枝意味著在樹完全生成之前停止樹的生長;后剪枝則是在樹生成之后去掉某些分支。

例如,在預測客戶流失的決策樹中,如果我們發(fā)現(xiàn)分裂后每個節(jié)點只包含極少量的客戶,那么這可能是一個過擬合的信號。通過預剪枝或后剪枝,我們可以移除這些僅對訓練數(shù)據(jù)有特定判斷能力的規(guī)則。

決策樹的基礎(chǔ)原理既直觀又深邃。它將復雜的決策過程簡化為易于理解的規(guī)則,并且通過學習數(shù)據(jù)中固有的模式,適用于各種機器學習任務(wù)。

三、算法研究進階

進入到算法研究的進階階段,我們將探討決策樹的深層次技術(shù)演進和最新研究成果,以及如何將這些先進的理念應用于解決更復雜的問題。

提升樹和隨機森林

決策樹的強大之處不僅在于它們單獨的決策能力,而且還在于它們可以組合成更強大的模型,如提升樹(Boosted Trees)和隨機森林(Random Forests)。

提升樹(Boosted Trees)

提升樹是通過結(jié)合多個弱決策樹構(gòu)建的,每一棵樹都試圖糾正前一棵樹的錯誤。使用梯度提升(Gradient Boosting)的方法可以系統(tǒng)地將新模型添加到已經(jīng)存在的模型集合中,從而逐步提升模型的準確率。

以預測房價為例,我們可能首先使用一個簡單的決策樹來預測價格,然后第二棵樹會專注于第一棵樹預測錯誤的部分,通過減少這些錯誤來提升模型的性能,直到達到一定的準確率或樹的數(shù)量。

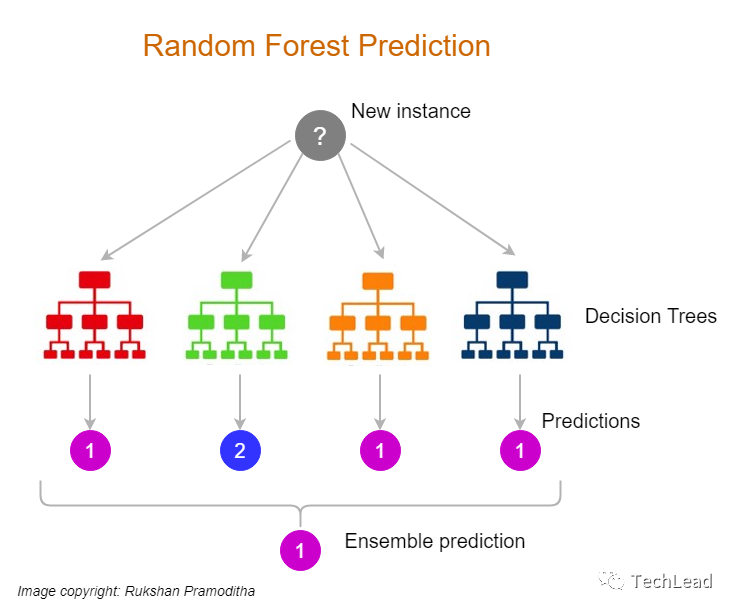

隨機森林(Random Forests)

隨機森林通過創(chuàng)建多個獨立的決策樹,并讓它們對最終結(jié)果進行投票,來提高決策樹的準確性和魯棒性。每一棵樹都是在數(shù)據(jù)集的一個隨機子集上訓練得到的,這種方法即提高了模型的泛化能力,也增加了結(jié)果的穩(wěn)定性。

設(shè)想一個信用評分的場景,單一決策樹可能會因為訓練數(shù)據(jù)中的隨機波動或噪聲而產(chǎn)生過度特定的規(guī)則。而隨機森林通過集成多個樹的決策來平均這些波動,生成更為穩(wěn)定和可靠的信用評分。

進化算法與決策樹

研究人員還在探索如何使用進化算法(Evolutionary Algorithms)來優(yōu)化決策樹的結(jié)構(gòu)和參數(shù)。進化算法模擬生物進化的過程,通過選擇、交叉和變異操作來優(yōu)化問題的解。

決策樹結(jié)構(gòu)的進化

在實踐中,可能會將決策樹的每一部分——分裂規(guī)則、特征選擇、甚至是剪枝策略——看作是個體的基因。通過定義適應度函數(shù)來評估樹的性能,進化算法會不斷迭代,選擇出性能最佳的樹進行繁衍,從而得到更加優(yōu)化的決策樹結(jié)構(gòu)。

例如,在電子商務(wù)推薦系統(tǒng)中,我們可以利用進化算法來不斷進化決策樹的結(jié)構(gòu),以提高推薦的準確性。不同的樹結(jié)構(gòu)被視為不同的“物種”,經(jīng)過迭代的“自然選擇”,最適應用戶行為模式的決策樹結(jié)構(gòu)會被保留下來。

多目標決策樹優(yōu)化

在某些復雜的機器學習任務(wù)中,我們不僅僅想要優(yōu)化單一的性能指標,如準確度,我們還可能關(guān)心模型的可解釋性、速

度或是占用的內(nèi)存大小。多目標優(yōu)化(Multi-Objective Optimization)技術(shù)能夠在這些不同的指標之間找到最佳的平衡。

應用實例:財務(wù)風險評估

在財務(wù)風險評估中,我們需要一個既準確又快速的模型來實時分析交易的風險。通過多目標優(yōu)化,我們可以設(shè)計出既能快速執(zhí)行又有著較高準確度的決策樹模型,以適應高頻交易環(huán)境的需求。

通過這一節(jié)的深入探討,我們看到了決策樹不僅僅是一個簡單的分類或回歸工具,而是一個可擴展的、能與其他算法相結(jié)合、并且能夠適應復雜應用需求的強大機器學習方法。

四、案例實戰(zhàn)

在本節(jié)中,我們將通過一個實戰(zhàn)案例來展示如何使用Python和PyTorch實現(xiàn)決策樹算法。我們將使用一個公開的銀行營銷數(shù)據(jù)集,目標是預測客戶是否會訂閱定期存款。這是一個典型的二分類問題。

場景描述

假設(shè)我們是一家銀行,希望建立一個模型來預測哪些客戶更有可能訂閱定期存款。成功預測出這些客戶可以幫助銀行更精準地進行營銷,提高資源利用效率。

數(shù)據(jù)預處理

在開始之前,我們需要進行數(shù)據(jù)預處理,包括加載數(shù)據(jù)、清洗數(shù)據(jù)、進行特征編碼等。

import pandas as pd from sklearn.model_selection import train_test_split from sklearn.preprocessing import LabelEncoder from sklearn.tree import DecisionTreeClassifier from sklearn.metrics import accuracy_score # 加載數(shù)據(jù) data = pd.read_csv('bank.csv', sep=';') # 數(shù)據(jù)預處理 # 將分類變量轉(zhuǎn)換為數(shù)值 labelencoder = LabelEncoder() data['job'] = labelencoder.fit_transform(data['job']) data['marital'] = labelencoder.fit_transform(data['marital']) # ...對其他分類變量進行編碼 # 定義特征集和標簽 X = data.iloc[:, :-1].values y = data.iloc[:, -1].values # 劃分訓練集和測試集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

決策樹模型

下面,我們將使用DecisionTreeClassifier來訓練模型,并對其進行評估。

# 創(chuàng)建決策樹分類器實例

clf = DecisionTreeClassifier(criterion='entropy', random_state=42)

# 訓練模型

clf.fit(X_train, y_train)

# 在測試集上進行預測

y_pred = clf.predict(X_test)

# 評估模型

accuracy = accuracy_score(y_test, y_pred)

print(f'模型準確率: {accuracy:.2f}')

結(jié)果分析

這段代碼會輸出模型的準確率,作為評估其性能的指標。在現(xiàn)實應用中,我們還會關(guān)注模型的召回率、精確率和F1分數(shù),以及通過混淆矩陣來進一步分析模型的性能。

在這個案例中,決策樹模型可以幫助銀行預測客戶是否會訂閱定期存款。通過準確率的高低,我們可以了解到模型在解決實際問題上的有效性。

輸出展示

輸出將直接顯示模型在測試數(shù)據(jù)上的準確率,為銀行提供了一個量化的工具來判斷營銷活動的潛在效果。

實際操作中,模型的輸出還會進一步轉(zhuǎn)換為決策支持,例如,通過模型預測的概率閾值來確定是否對某個客戶進行營銷活動。

總結(jié)

通過這個案例,我們展示了如何使用Python實現(xiàn)一個簡單的決策樹分類器,以及如何應用它在實際的商業(yè)場景中進行決策。這個實戰(zhàn)案例僅是決策樹應用的冰山一角,決策樹的強大和靈活性使其在各種不同的領(lǐng)域都有廣泛的應用。

五、總結(jié)

決策樹算法作為機器學習領(lǐng)域的基石之一,其直觀性和易于解釋的特性為其贏得了廣泛的應用。本文從決策樹的基礎(chǔ)知識出發(fā),逐步深入到算法優(yōu)化、研究進展,最終以一個實戰(zhàn)案例來集中展示其在實際問題中的應用。

在技術(shù)的深度和復雜性不斷提高的今天,決策樹算法仍然保持著其獨特的魅力。它能夠與新興的機器學習技術(shù)如深度學習、強化學習等相結(jié)合,創(chuàng)造出更為強大和適應性強的模型。例如,通過集成學習中的隨機森林或提升方法,決策樹的預測性能得到了顯著提升,同時保留了模型的可解釋性。

決策樹的結(jié)構(gòu)使其成為理解數(shù)據(jù)屬性和做出預測決策的有力工具,尤其是在需要快速決策和解釋決策過程的場景中。這對于處在法規(guī)要求高透明度決策過程的行業(yè),如金融和醫(yī)療保健,尤為重要。

然而,決策樹算法并不是沒有挑戰(zhàn)。過擬合和處理高維數(shù)據(jù)時的效率問題是其兩大主要的技術(shù)難題。盡管存在這些挑戰(zhàn),但隨著算法研究的不斷深入,例如引入剪枝技術(shù)、特征選擇和多目標優(yōu)化等方法,我們有望設(shè)計出更為高效和魯棒的決策樹模型。

在案例實戰(zhàn)中,我們利用Python和PyTorch展示了如何具體實現(xiàn)和應用決策樹,這樣的實操經(jīng)驗對于理解算法的實際效果和限制至關(guān)重要。

最后,可以預見,決策樹算法將繼續(xù)在人工智能的各個領(lǐng)域發(fā)揮其獨特的價值。其簡單、高效和易于解釋的特點,將使其在可解釋的AI(XAI)領(lǐng)域發(fā)揮重要作用,助力人類構(gòu)建更加公正、透明和可信的機器學習系統(tǒng)。

審核編輯:劉清

-

機器學習

+關(guān)注

關(guān)注

66文章

8485瀏覽量

133973 -

python

+關(guān)注

關(guān)注

56文章

4823瀏覽量

86043 -

決策樹

+關(guān)注

關(guān)注

3文章

96瀏覽量

13760 -

pytorch

+關(guān)注

關(guān)注

2文章

809瀏覽量

13737

原文標題:機器學習 - 決策樹:技術(shù)全解與案例實戰(zhàn)

文章出處:【微信號:OSC開源社區(qū),微信公眾號:OSC開源社區(qū)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

關(guān)于決策樹,這些知識點不可錯過

決策樹的生成資料

一個基于粗集的決策樹規(guī)則提取算法

改進決策樹算法的應用研究

決策樹的原理和決策樹構(gòu)建的準備工作,機器學習決策樹的原理

決策樹和隨機森林模型

決策樹的構(gòu)成要素及算法

決策樹的基本概念/學習步驟/算法/優(yōu)缺點

什么是決策樹模型,決策樹模型的繪制方法

評論