“大語(yǔ)言模型為 AI 產(chǎn)業(yè)帶來(lái)新的生機(jī),然而語(yǔ)言模型的應(yīng)用場(chǎng)景有限。要全面打開(kāi)生成式 AI 的想象力,還是要依托多模態(tài)大模型。”IDC 中國(guó)研究總監(jiān)盧言霞近日表示。Sora在文生視頻領(lǐng)域真正邁出了第一步,真正做到生成式 AI 驅(qū)動(dòng)生成短視頻。接下來(lái)也將刺激其他科技巨頭加快在該領(lǐng)域的技術(shù)攻關(guān)力度以及產(chǎn)品發(fā)布速度。

哪些公司有潛力快速推出類似產(chǎn)品呢?根據(jù)盧言霞的判斷,幾個(gè)最有潛力的群體包括,在大模型以及 AI 領(lǐng)域投入最為領(lǐng)先的科技巨頭,如 BAT、科大訊飛等;在計(jì)算機(jī)視覺(jué)領(lǐng)域擁有深厚積累的公司,比如商湯、海康一類的公司;以及短視頻類公司;更可大膽想象,也或許會(huì)培訓(xùn)出多模態(tài)大模型的全新創(chuàng)企。

多模態(tài)大模型將率先在短視頻、廣告、互娛、影視、媒體等領(lǐng)域采用,輔助人類員工生成視頻,既可以提高生產(chǎn)速度又可以提高生產(chǎn)數(shù)量,還可以創(chuàng)造全新的視覺(jué)感受,能夠幫助企業(yè)真正實(shí)現(xiàn)降本增效、提升用戶體驗(yàn)。

根據(jù)預(yù)測(cè),未來(lái) 5 年,生成式 AI 生成的文本類文件、圖像類文件、視頻類文件、軟件代碼類文件數(shù)量將會(huì)越來(lái)越平均。而這其中,與圖像文件相關(guān)的數(shù)據(jù)量可能是文本文件的 100 倍,視頻文件是圖像文件的 10 倍。整體來(lái)看,由于 GenAI 的采用和使用日益增多,近期和遠(yuǎn)期所創(chuàng)建數(shù)據(jù)的增長(zhǎng)速度都將快于近幾年。

盧言霞指出,多模態(tài)大模型行業(yè)發(fā)展的挑戰(zhàn)在于:

? 高質(zhì)量數(shù)據(jù)的稀缺:圖像、視頻類數(shù)據(jù)掌握在少數(shù)公司手中。這些數(shù)據(jù)也需要標(biāo)注,甚至重新采集,才能用于大模型的訓(xùn)練。

? 多模態(tài)大模型對(duì)算力的消耗更高,算力的可獲取性以及成本將是挑戰(zhàn)之一。

? 頂尖的大模型研發(fā)人才,也是行業(yè)發(fā)展的稀缺資源。

此外,多模態(tài)大模型將帶來(lái)更嚴(yán)峻的安全方面的挑戰(zhàn)。一方面多模態(tài)大模型將讀取更多的圖像、視頻類數(shù)據(jù),這些圖像視頻數(shù)據(jù)是否合規(guī)是否安全,需要得到保障;另一方面,生成的視頻與真實(shí)世界之間的差異,是否會(huì)影響到人身安全、社會(huì)穩(wěn)定、企業(yè)安全等,也需要注意。

當(dāng)前 Sora 生成的是1分鐘的視頻,對(duì)于行業(yè)已經(jīng)是重大突破,何時(shí)能生成2分鐘、5分鐘以上的視頻還未知,無(wú)論如何多模態(tài)大模型的應(yīng)用都將是顛覆性的。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

商湯日日新多模態(tài)大模型權(quán)威評(píng)測(cè)第一

成都匯陽(yáng)投資關(guān)于Sora 正式上線,多模態(tài)模型的里程碑

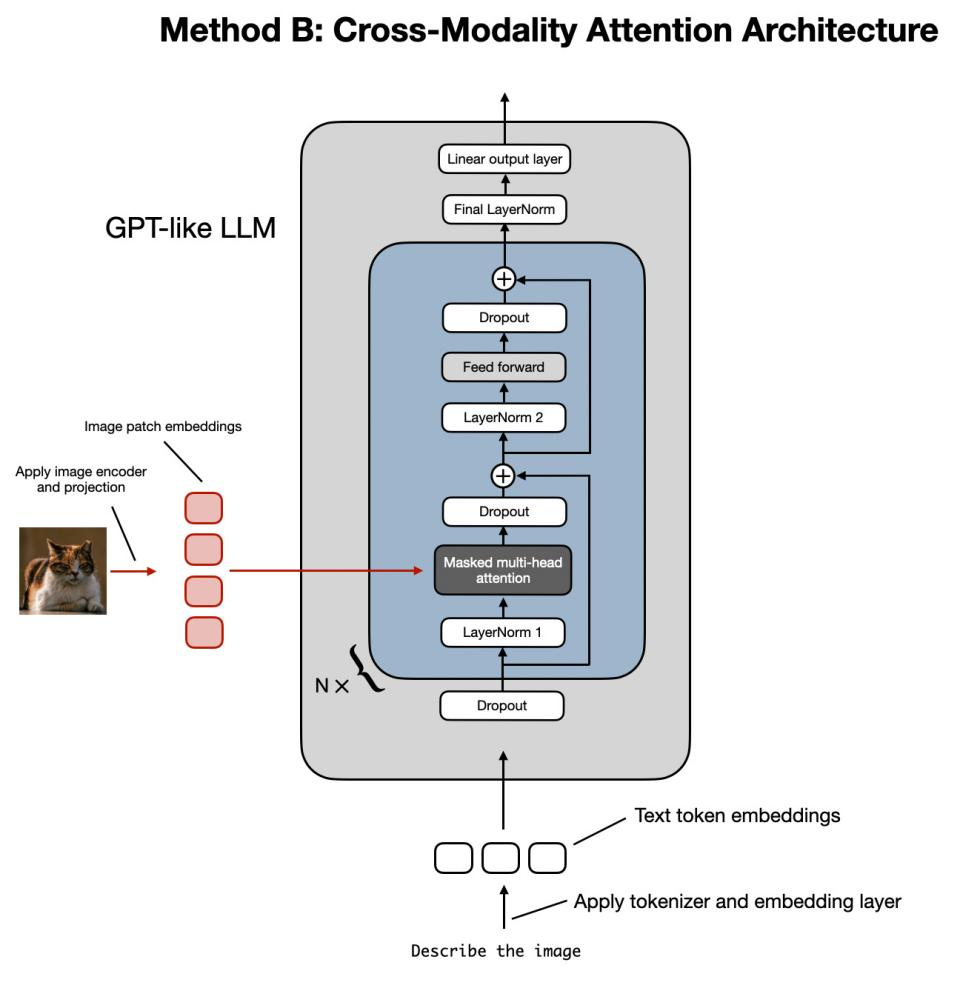

一文理解多模態(tài)大語(yǔ)言模型——上

利用OpenVINO部署Qwen2多模態(tài)模型

Sora短期不會(huì)向公眾開(kāi)放 還處于反饋獲取階段

sora模型中國(guó)可以使用嗎 sora模型是哪個(gè)公司

sora模型上市公司 sora模型對(duì)現(xiàn)實(shí)的影響

sora模型怎么使用 sora模型對(duì)現(xiàn)實(shí)的影響

字節(jié)跳動(dòng)辟謠推出中文版Sora 期待國(guó)產(chǎn)Sora大模型

奧特曼發(fā)布王炸模型Sora OpenAI首個(gè)文生視頻模型Sora正式亮相

OpenAI推出新款大模型Sora,引領(lǐng)多模態(tài)AI新潮流

機(jī)器人基于開(kāi)源的多模態(tài)語(yǔ)言視覺(jué)大模型

自動(dòng)駕駛和多模態(tài)大語(yǔ)言模型的發(fā)展歷程

從Google多模態(tài)大模型看后續(xù)大模型應(yīng)該具備哪些能力

Sora爆紅,多模態(tài)大模型是下一發(fā)展階段

Sora爆紅,多模態(tài)大模型是下一發(fā)展階段

評(píng)論