? 近日,美國人工智能公司OpenAI發布了首個視頻生成模型Sora。不同于此前許多AI大模型文生圖或視頻時,會出現人物形象前后不一致等問題,此次OpenAI展示的Sora生成的視頻中的主角、背景人物,都展現了極強的一致性,可以支持60秒一鏡到底,并包含高細致背景、多角度鏡頭,以及富有情感的多個角色,可謂是相當的“炸裂”。甚至有不少人疾呼,傳統視頻制作行業將會被“革命”!

相關內容參考“OpenAI視頻模型Sora替代品分析(2024)”、“一場AI“革命”開始,OpenAI文生視頻模型Sora”。

據OpenAI官網介紹,Sora“通過一次性為模型提供多幀的預測,我們解決了一個具有挑戰性的問題”。據了解,此次大模型完美繼承DALL·E 3的畫質和遵循指令能力,能生成長達1分鐘的高清視頻。并且在隨后公布的多段AI生成的視頻中,無論鏡頭如何切換,人物前后都保持了高度的穩定性。

總結來說,Sora大模型的強大之處主要有以下六點:

1、文本到視頻生成能力:Sora能夠根據用戶提供的文本描述生成長達60S的視頻,這些視頻不僅保持了視覺品質,而且完整準確還原了用戶的提示語。

2、復雜場景和角色生成能力:Sora能夠生成包含多個角色、特定運動類型以及主題精確、背景細節復雜的場景。它能夠創造出生動的角色表情和復雜的運鏡,使得生成的視頻具有高度的逼真性和敘事效果。

3、語言理解能力:Sora擁有深入的語言理解能力,能夠準確解釋提示并生成能表達豐富情感的角色。這使得模型能夠更好地理解用戶的文本指令,并在生成的視頻內容中忠實地反映這些指令。

4、多鏡頭生成能力:Sora可以在單個生成的視頻中創建多個鏡頭,同時保持角色和視覺風格的一致性。這種能力對于制作電影預告片、動畫或其他需要多視角展示的內容非常有用。

5、從靜態圖像生成視頻能力:Sora不僅能夠從文本生成視頻,還能夠從現有的靜態圖像開始,準確地動畫化圖像內容,或者擴展現有視頻,填補視頻中的缺失幀。

6、物理世界模擬能力:Sora展示了人工智能在理解真實世界場景并與之互動的能力,這是朝著實現通用人工智能(AGI)的重要一步。它能夠模擬真實物理世界的運動,如物體的移動和相互作用。 可以說,Sora的出現,預示著一個全新的視覺敘事時代的到來,它能夠將人們的想象力轉化為生動的動態畫面,將文字的魔力轉化為視覺的盛宴。在這個由數據和算法編織的未來,Sora正以其獨特的方式,或將重新定義我們與數字世界的互動。

OpenAI在模型公布后的不久,就公布了相關的技術論文《Video generation models as world simulators》。以下為論文的主要內容:

Sora的技術特點

三維空間的連貫性:Sora可以生成帶有動態相機運動的視頻。隨著相機移動和旋轉,人物和場景元素在三維空間中保持連貫的運動。

模擬數字世界:Sora還能模擬人工過程,如視頻游戲。Sora能夠同時控制Minecraft中的玩家,并高保真地渲染游戲世界及其動態。通過提及“Minecraft”的提示,可以零樣本地激發Sora的這些能力

長期連續性和物體持久性:對視頻生成系統來說,Sora通常能夠有效地模擬短期和長期的依賴關系。同樣,它能在一個樣本中生成同一角色的多個鏡頭,確保其在整個視頻中的外觀一致。

與世界互動:Sora有時能夠模擬對世界狀態產生簡單影響的行為。例如,畫家可以在畫布上留下隨時間持續的新筆觸,或者一個人吃漢堡時留下咬痕。

訓練過程

Sora 的訓練受到了大語言模型(Large Language Model)的啟發。這些模型通過在互聯網規模的數據上進行訓練,從而獲得了廣泛的能力。

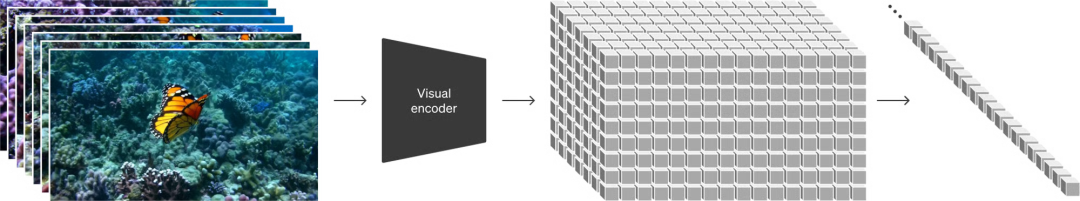

Sora實際上是一種擴散型變換器模型(diffusion transformer)。首先將視頻壓縮到一個低維潛在空間中,然后將這種表現形式分解成時空區塊,從而將視頻轉換為區塊。它能夠接受帶有噪聲的patch(和條件信息,如文本提示)作為輸入,隨后被訓練,來預測原始的“干凈”patch。

訓練了一個用于降低視覺數據維度的網絡。這個網絡以原始視頻為輸入,輸出在時間和空間上都被壓縮的潛在表示。Sora在這個壓縮的潛在空間上進行訓練,并在此空間中生成視頻。還開發了一個對應的解碼器模型,它能將生成的潛在表示映射回到像素空間。

對于給定的壓縮輸入視頻,提取一系列時空區塊,它們在變換器模型中充當標記(token)。這種方案同樣適用于圖像,因為圖像本質上是單幀的視頻。基于區塊的表示方法使Sora能夠針對不同分辨率、持續時間和縱橫比的視頻和圖像進行訓練。在推理過程中,可以通過在適當大小的網格中排列隨機初始化的區塊來控制生成視頻的大小。

隨著 Sora 訓練計算量的增加,樣本質量有了顯著提升。

Sora訓練時沒有對素材進行裁切,使得Sora能夠直接為不同設備以其原生縱橫比創造內容。針對視頻的原生縱橫比進行訓練,還可以提高構圖和取景的質量。

它還可以先以較低分辨率快速制作出視頻原型,再用相同的模型制作出全分辨率的視頻。

訓練文本到視頻的生成系統需要大量配有相應文本提示的視頻。應用了在DALL·E 3中引入的重新字幕技術到視頻上。

與DALL·E 3相似,也利用了GPT技術,將用戶的簡短提示轉換成更詳細的提示,然后發送給視頻模型。

論文關鍵點

OpenAI 的研究論文《Video generation models as world simulators》探討了在視頻數據上進行大規模訓練生成模型的方法。這項研究特別關注于文本條件擴散模型,這些模型同時在視頻和圖像上進行訓練,處理不同時長、分辨率和寬高比的數據。研究中提到的最大模型 Sora 能夠生成長達一分鐘的高保真視頻。以下是論文的一些關鍵點:

統一的視覺數據表示:研究者們將所有類型的視覺數據轉換為統一的表示,以便進行大規模的生成模型訓練。Sora 使用視覺補丁(patches)作為其表示方式,類似于大型語言模型(LLM)中的文本標記。

視頻壓縮網絡:研究者們訓練了一個網絡,將原始視頻壓縮到一個低維潛在空間,并將其表示分解為時空補丁。Sora 在這個壓縮的潛在空間中進行訓練,并生成視頻。

擴散模型:Sora 是一個擴散模型,它通過預測原始“干凈”的補丁來從輸入的噪聲補丁中生成視頻。擴散模型在語言建模、計算機視覺和圖像生成等領域已經顯示出了顯著的擴展性。

視頻生成的可擴展性:Sora 能夠生成不同分辨率、時長和寬高比的視頻,包括全高清視頻。這種靈活性使得 Sora 能夠直接為不同設備生成內容,或者在生成全分辨率視頻之前快速原型化內容。

語言理解:為了訓練文本到視頻生成系統,需要大量的視頻和相應的文本標題。研究者們應用了在 DALL·E 3 中引入的重新描述技術,首先訓練一個高度描述性的標題生成器,然后為訓練集中的所有視頻生成文本標題。

圖像和視頻編輯:Sora 不僅能夠基于文本提示生成視頻,還可以基于現有圖像或視頻進行提示。這使得 Sora 能夠執行廣泛的圖像和視頻編輯任務,如創建完美循環的視頻、動畫靜態圖像、向前或向后擴展視頻等。

模擬能力:當視頻模型在大規模訓練時,它們展現出了一些有趣的新興能力,使得 Sora 能夠模擬物理世界中的某些方面,如動態相機運動、長期一致性和對象持久性等。

雖然存在不足之處,但這不是關鍵

盡管 Sora 展示了作為模擬器的潛力,但它仍然存在許多局限性,例如在模擬基本物理交互時的準確性不足。

比如下面這個由 Sora 生成的視頻當中,動物的數量隨著時間的推移出現了明顯的錯亂,多個動物憑空出現又憑空消失了。此外,在一些生成的視頻當中還會出現違反物理規則的現象。但是,對于新生的Sora來說,這些都不是關鍵,后續完全能夠通過技術迭代來進行完善和改進。

這也是為什么,Sora雖然有一些不完美之處,但是外界仍一致認為它將會革命性地改變許多行業。

可以說,目前的Sora已經擁有了足以改變視頻廣告行業的能力,如果持續迭代,并在保持穩定性和一致性的前提下,進一步支持更復雜的交互、更長的視頻時長,并加入更為豐富的AI視頻編輯功能,必將對于現有的影視制作產業帶來革命。

試想一下,如果將一部小說輸入Sora就能夠生成一部高質量的電影,這將會是多么的激動人心!這將極大的降低視頻創作的門檻,并提升視頻的質量,這對于整個行業來說都將帶來更為積極的意義。當然,這也將會沖擊到現有的傳統視頻制作產業鏈上的諸多從業者,恐怕很多演員、導演、攝影師,以及很多相關的服裝、化妝、道具人員都將要失業了。

來源:芯智訊 原文:

https://mp.weixin.qq.com/s/_WIFlmCzQHS4K1fRSkgmYg

審核編輯:劉清

-

解碼器

+關注

關注

9文章

1143瀏覽量

40717 -

變換器

+關注

關注

17文章

2097瀏覽量

109262 -

人工智能

+關注

關注

1791文章

47183瀏覽量

238237 -

OpenAI

+關注

關注

9文章

1079瀏覽量

6480 -

Sora

+關注

關注

0文章

81瀏覽量

195

原文標題:一場AI“革命”開始,OpenAI文生視頻模型Sora要點分析

文章出處:【微信號:架構師技術聯盟,微信公眾號:架構師技術聯盟】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

智譜AI正在研發國產文生視頻模型,對標OpenAI Sora

智譜AI正研發對標Sora的國產文生視頻模型

OpenAI發布文生視頻大模型Sora、英偉達市值超谷歌

7萬張H100打造的OpenAI文生視頻Sora功能原理詳解|Sora注冊全攻略

OpenAI文生視頻模型Sora要點分析

OpenAI文生視頻模型Sora要點分析

評論